目录

一、解决思路

对于这个问题,主要分为2个步骤,一是修复表结构,二是恢复数据,下面就按照这个思路进行处理。

二、修复表结构

修复表结构,这里通过删表重建来处理。

2.1 建表

CREATE EXTERNAL TABLE IF NOT EXISTS bi.test_partition

(

id INT COMMENT '编号'

) COMMENT '修改Location测试'

PARTITIONED BY (pt_hour VARCHAR(2) COMMENT '小时分区', pt_day VARCHAR(8) COMMENT '天分区')

ROW FORMAT DELIMITED

FIELDS TERMINATED BY '\001'

LINES TERMINATED BY '\n'

STORED AS ORC

LOCATION 'hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition'

TBLPROPERTIES ("orc.compress"="ZLIB")

;

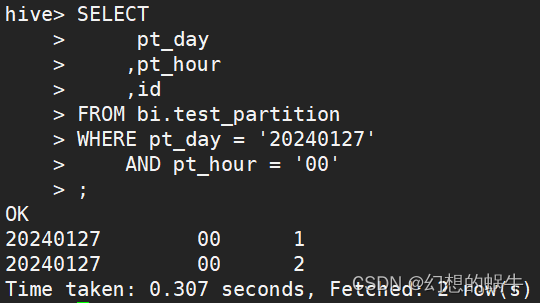

2.2查询数据

SELECT

pt_day

,pt_hour

,id

FROM bi.test_partition

WHERE pt_day = '20240127'

ORDER BY pt_day

,pt_hour

,id

ASC

;

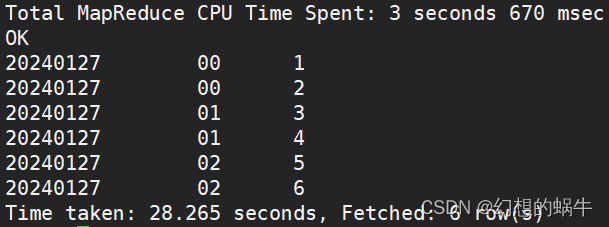

可以看到,插入数据后,数据可以正常查询。

2.3查询数据路径

hdfs dfs -ls hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition;

hdfs dfs -ls hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_hour=00;

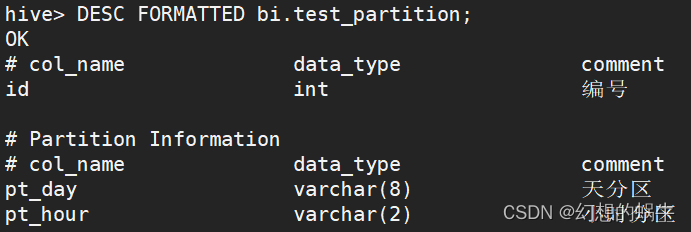

从查询结果可以看出,数据路径中,天分区和小时分区的顺序确实是反的。

2.4删表重建

DROP TABLE IF EXISTS bi.test_partition;

CREATE EXTERNAL TABLE IF NOT EXISTS bi.test_partition

(

id INT COMMENT '编号'

) COMMENT '修改Location测试'

PARTITIONED BY (pt_day VARCHAR(8) COMMENT '天分区', pt_hour VARCHAR(2) COMMENT '小时分区')

ROW FORMAT DELIMITED

FIELDS TERMINATED BY '\001'

LINES TERMINATED BY '\n'

STORED AS ORC

LOCATION 'hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition'

TBLPROPERTIES ("orc.compress"="ZLIB")

;

2.5查询表结构

DESC FORMATTED bi.test_partition;

2.6查询数据

SELECT

pt_day

,pt_hour

,id

FROM bi.test_partition

WHERE pt_day = '20240127'

ORDER BY pt_day

,pt_hour

,id

ASC

;

从执行结果可以看出,修复表结构后,已经无法查询到数据了。

三、恢复数据

3.1方案1 直接移动原分区数据到新分区下

3.1.1创建路径

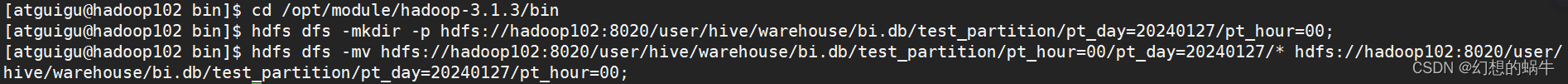

由于数据移动时,需要目标路径存在,因此需要先创建文件路径。

hdfs dfs -mkdir -p hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_day=20240127/pt_hour=00;

3.1.2移动数据

hdfs dfs -mv hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_hour=00/pt_day=20240127/* hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_day=20240127/pt_hour=00;

3.1.3修复分区

由于上述操作属于后台移动数据,表中并无该分区的元数据信息,因此需要添加分区信息。

ALTER TABLE bi.test_partition ADD PARTITION (pt_day = '20240127', pt_hour = '00');

3.1.4查询数据

SELECT

pt_day

,pt_hour

,id

FROM bi.test_partition

WHERE pt_day = '20240127'

AND pt_hour = '00'

;

从执行结果可以看出,数据已经可以正常查询,数据修复完成。

3.2方案2 将分区路径指导原数据路径

这种方式,相当于临时把正确的分区和错误路径下的数据进行关联,可以正常查询数据。数据并未移动到正确的路径下。

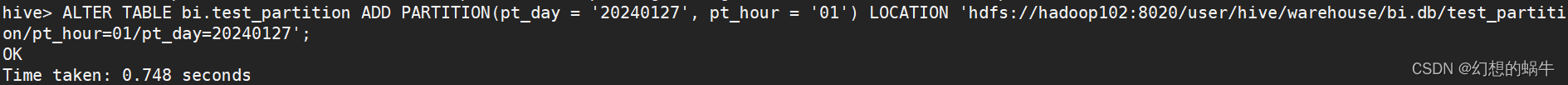

3.2.1添加分区并指定Location

ALTER TABLE bi.test_partition ADD PARTITION(pt_day = '20240127', pt_hour = '01') LOCATION 'hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_hour=01/pt_day=20240127';

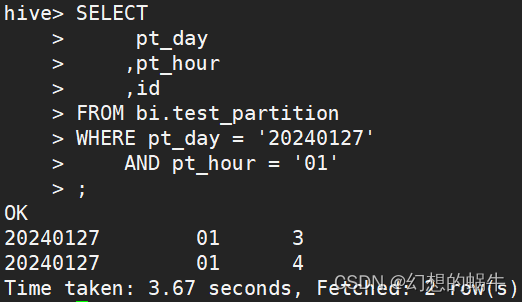

3.2.2查询数据

SELECT

pt_day

,pt_hour

,id

FROM bi.test_partition

WHERE pt_day = '20240127'

AND pt_hour = '01'

;

3.3方案3 通过临时表恢复数据

该方案需要在修复表结构之前先建一张临时表,并将需要恢复的分区数据全部刷到临时表中。然后删除原表的分区,修复表结构后,再从临时表把数据插入到新的分区中。

由于之前已经删除表了,这里直接新建一张临时表,并插入2条数据,以做演示。

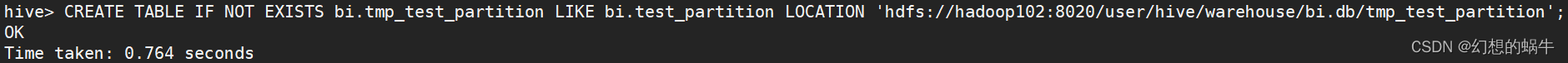

3.3.1新建临时表

建临时表时可以建内部表,方便数据恢复后清理临时表。

CREATE TABLE IF NOT EXISTS bi.tmp_test_partition LIKE bi.test_partition LOCATION 'hdfs://hadoop102:8020/user/hive/warehouse/bi.db/tmp_test_partition';

3.3.2插入数据

INSERT OVERWRITE TABLE bi.tmp_test_partition

PARTITION (pt_day = '20240127', pt_hour = '02')

VALUES

(5)

,(6)

;

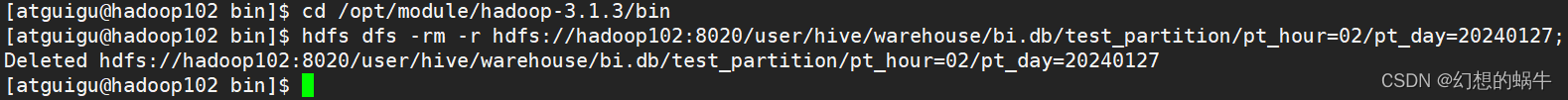

3.3.3删除错误分区下的数据

hdfs dfs -rm -r hdfs://hadoop102:8020/user/hive/warehouse/bi.db/test_partition/pt_hour=02/pt_day=20240127;

3.3.4从临时表恢复数据并查询

INSERT OVERWRITE TABLE bi.test_partition

PARTITION (pt_day = '20240127', pt_hour = '02')

SELECT

id

FROM bi.tmp_test_partition

WHERE pt_day = '20240127'

AND pt_hour = '02'

;

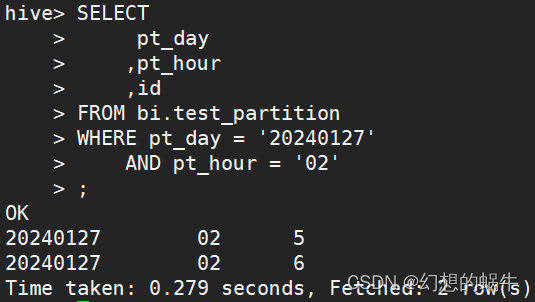

SELECT

pt_day

,pt_hour

,id

FROM bi.test_partition

WHERE pt_day = '20240127'

AND pt_hour = '02'

;

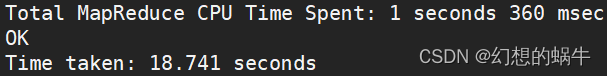

从执行结果可以看出,数据已正常修复。

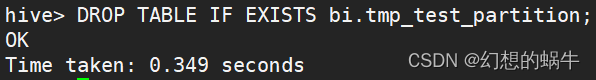

3.3.5清理临时表并查询

DROP TABLE IF EXISTS bi.tmp_test_partition;

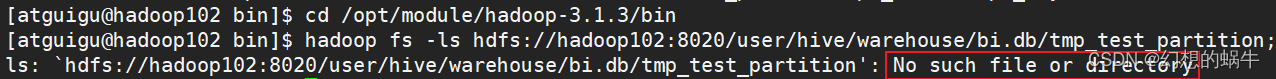

hadoop fs -ls hdfs://hadoop102:8020/user/hive/warehouse/bi.db/tmp_test_partition;

从上面的执行结果可以看出,临时表已清理干净。

本文讲述了在Hive表结构错误导致数据查询问题中,通过修复表结构(包括建表、删除重建、查询和调整分区)、直接移动数据到正确分区、临时表恢复数据等方法来解决问题的过程。

本文讲述了在Hive表结构错误导致数据查询问题中,通过修复表结构(包括建表、删除重建、查询和调整分区)、直接移动数据到正确分区、临时表恢复数据等方法来解决问题的过程。

2352

2352

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?