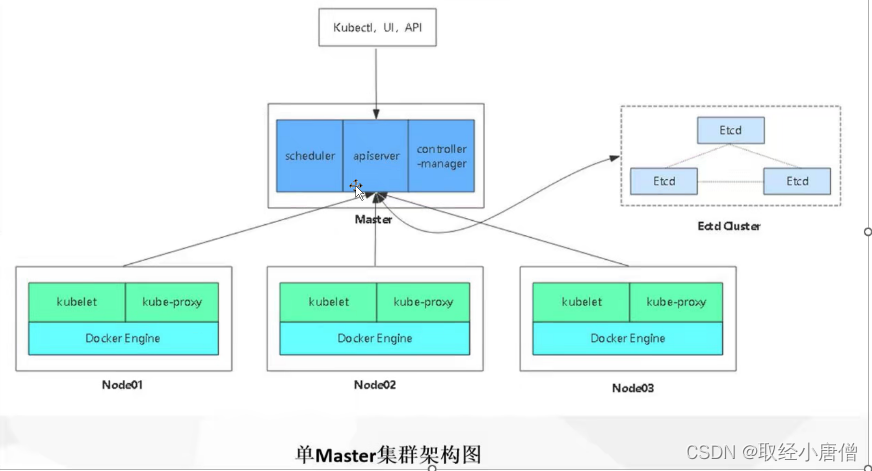

二进制搭建k8s——部署etcd集群和单master

二进制搭建k8s——部署etcd集群和单master

环境

master 01:192.168.44.20 (kube-apiserver、kube-controller-manager、kube-scheduler、etcd)

node 01:192.168.44.30 (kubelet、kube-proxy、docker)

node 02:192.168.44.40

1、操作系统初始化配置(全部节点)

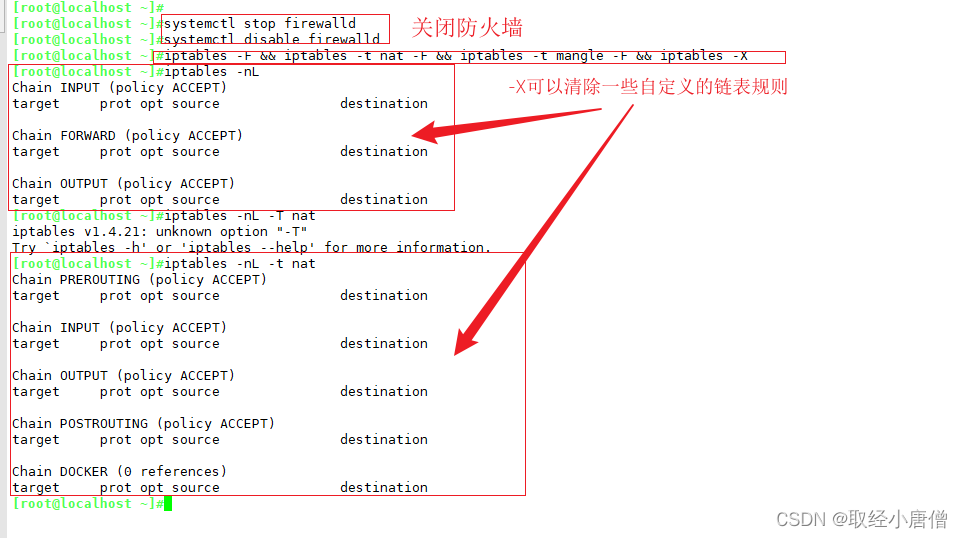

#关闭防火墙,清除防火墙规则

systemctl stop firewalld

systemctl disable firewalld

iptables -F && iptables -t nat -F && iptables -t mangle -F && iptables -X

#-X可以清除一些自定义的链表规则

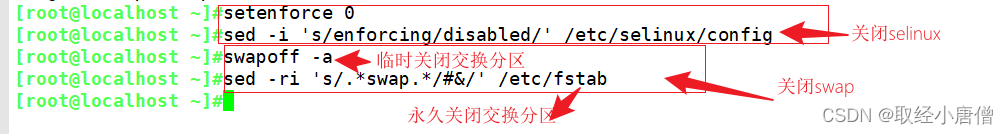

#关闭selinux

setenforce 0

sed -i 's/enforcing/disabled/' /etc/selinux/config

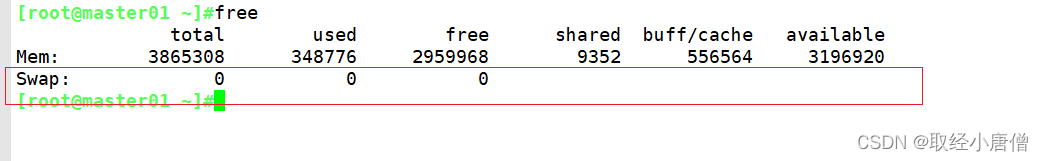

#关闭swap

swapoff -a #临时关闭交换分区

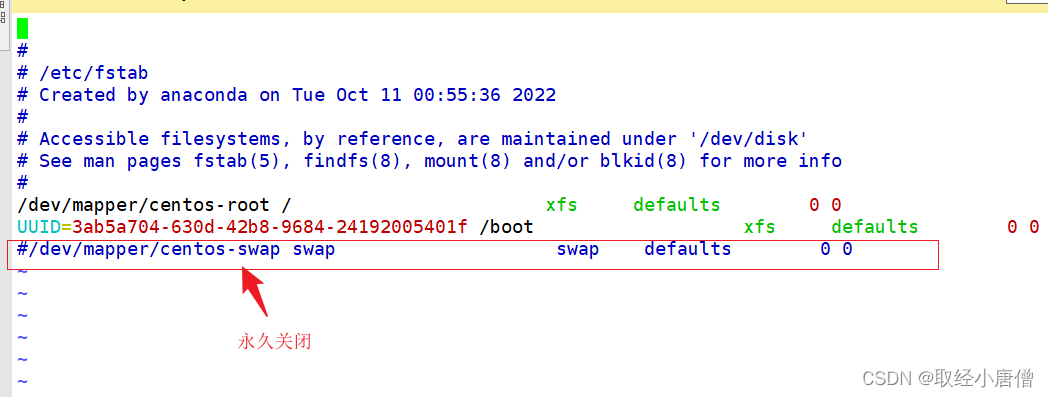

sed -ri 's/.*swap.*/#&/' /etc/fstab #永久关闭交换分区

#根据规划设置主机名

hostnamectl set-hostname master01

hostnamectl set-hostname node01

hostnamectl set-hostname node02

su

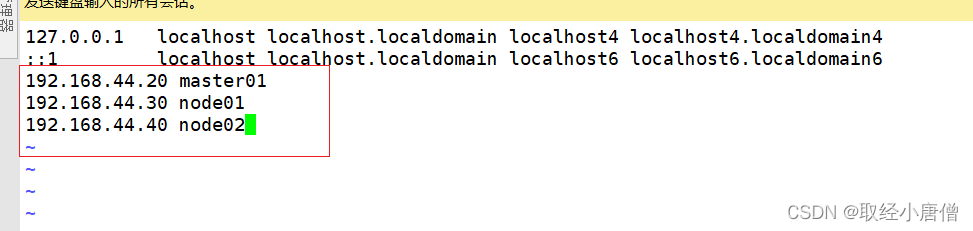

#在master添加hosts

vim /etc/hosts

192.168.44.20 master01

192.168.44.30 node01

192.168.44.40 node02

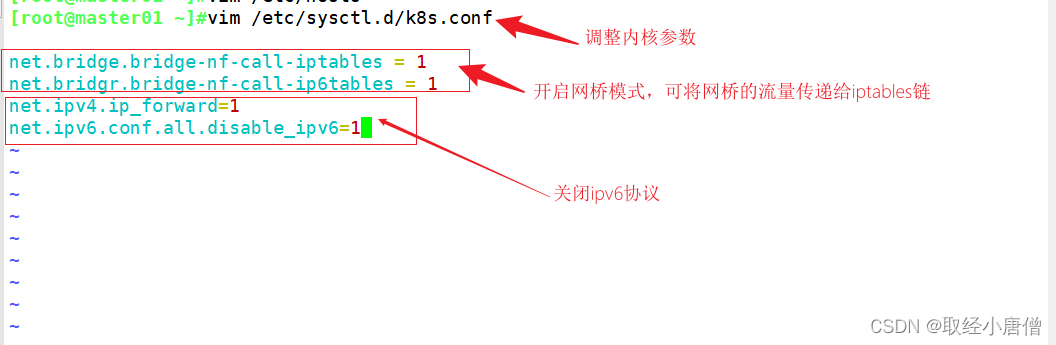

#调整内核参数

vim /etc/sysctl.d/k8s.conf

#开启网桥模式,可将网桥的流量传递给iptables链

net.bridge.bridge-nf-call-iptables = 1

net.bridge.bridge-nf-call-ip6tables = 1

#关闭ipv6协议

net.ipv4.ip_forward=1

net.ipv6.conf.all.disable_ipv6=1

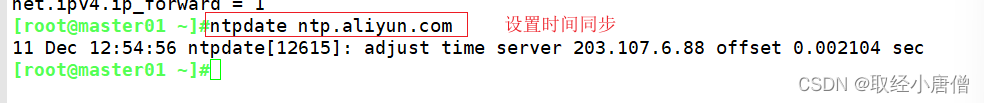

#时间同步

ntpdate ntp.aliyun.com

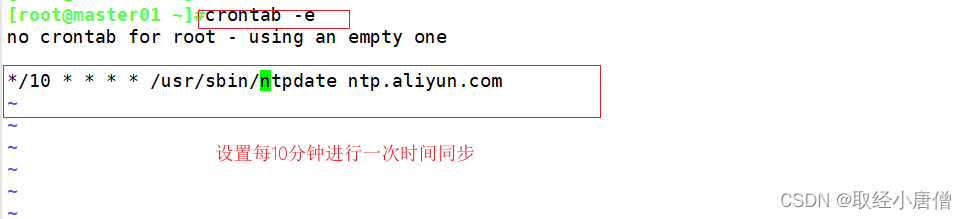

#设置每10分钟设置一次时间同步

crontab -e

*/10 * * * * /usr/sbin/ntpdate ntp.aliyun.com

2、部署 docker 引擎(所有节点)

#安装依赖包

yum install -y yum-utils device-mapper-persistent-data lvm2

#设置阿里云镜像源

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

#安装 Docker-CE并设置为开机自动启动

yum install -y docker-ce #docker-ce-cli、containerd.io 会作为依赖包被安装

systemctl start docker.service

systemctl enable docker.service

3、部署 etcd 集群

etcd是Coreos团队于2013年6月发起的开源项目,它的目标是构建一个高可用的分布式键值(k

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1437

1437

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?