Elasticsearch 集群搭建

三个节点环境 192.168.98.137、192.168.98.138、192.168.98.139

解压软件

# 解压缩

tar -zxvf elasticsearch-7.6.1-linux-x86_64.tar.gz -C /opt/module

# 改名

mv elasticsearch-7.8.0 es-cluster

在其他两个节点分别安装

创建用户

因为安全问题, elasticsearch 不允许 root 用户直接运行,所以要创建新用户,在 root 用户中创建新用户。

useradd es #新增 es 用户

passwd es #为 es 用户设置密码

userdel -r es #如果错了,可以删除再加

修改配置文件—node-1

修改/opt/module/es/config/elasticsearch.yml 文件,分发文件。

# 加入如下配置

#集群名称

cluster.name: cluster-es

#节点名称, 每个节点的名称不能重复

node.name: node-1

#ip 地址, 每个节点的地址不能重复

network.host: 192.168.98.137

#是不是有资格主节点

node.master: true

node.data: true

http.port: 9200

#集群默认是 9300,也可以省略

transport.tcp.port: 9300

# head 插件需要这打开这两个配置

http.cors.allow-origin: "*"

http.cors.enabled: true

http.max_content_length: 200mb

#es7.x 之后新增的配置,初始化一个新的集群时需要此配置来选举 master

cluster.initial_master_nodes: ["node-1"]

#es7.x 之后新增的配置,节点发现

discovery.seed_hosts: ["192.168.98.137:9300","192.168.98.138:9300","192.168.98.139:9300"]

gateway.recover_after_nodes: 2

network.tcp.keep_alive: true

network.tcp.no_delay: true

transport.tcp.compress: true

#集群内同时启动的数据任务个数,默认是 2 个

cluster.routing.allocation.cluster_concurrent_rebalance: 16

#添加或删除节点及负载均衡时并发恢复的线程个数,默认 4 个

cluster.routing.allocation.node_concurrent_recoveries: 16

#初始化数据恢复时,并发恢复线程的个数,默认 4 个

cluster.routing.allocation.node_initial_primaries_recoveries: 16

为 es 用户配置权限

chown -R es:es /opt/module/es

修改/etc/security/limits.conf ,分发文件

# 在文件末尾中增加下面内容

es soft nofile 65536

es hard nofile 65536

修改/etc/security/limits.d/20-nproc.conf,分发文件

# 在文件末尾中增加下面内容

es soft nofile 65536

es hard nofile 65536

* hard nproc 4096

# 注: * 带表 Linux 所有用户名称

修改/etc/sysctl.conf

# 在文件中增加下面内容

vm.max_map_count=655360

重新加载

sysctl -p

其他两个节点操作同上:

修改配置文件—node-2

# 加入如下配置

#集群名称

cluster.name: cluster-es

#节点名称, 每个节点的名称不能重复

node.name: node-2

#ip 地址, 每个节点的地址不能重复

network.host: 192.168.98.138

#是不是有资格主节点

node.master: true

node.data: true

http.port: 9200

#集群默认是 9300,也可以省略

transport.tcp.port: 9300

# head 插件需要这打开这两个配置

http.cors.allow-origin: "*"

http.cors.enabled: true

http.max_content_length: 200mb

#es7.x 之后新增的配置,初始化一个新的集群时需要此配置来选举 master

cluster.initial_master_nodes: ["node-1"]

#es7.x 之后新增的配置,节点发现

discovery.seed_hosts: ["192.168.98.137:9300","192.168.98.138:9300","192.168.98.139:9300"]

gateway.recover_after_nodes: 2

network.tcp.keep_alive: true

network.tcp.no_delay: true

transport.tcp.compress: true

#集群内同时启动的数据任务个数,默认是 2 个

cluster.routing.allocation.cluster_concurrent_rebalance: 16

#添加或删除节点及负载均衡时并发恢复的线程个数,默认 4 个

cluster.routing.allocation.node_concurrent_recoveries: 16

#初始化数据恢复时,并发恢复线程的个数,默认 4 个

cluster.routing.allocation.node_initial_primaries_recoveries: 16

修改配置文件—node-3

# 加入如下配置

#集群名称

cluster.name: cluster-es

#节点名称, 每个节点的名称不能重复

node.name: node-3

#ip 地址, 每个节点的地址不能重复

network.host: 192.168.98.139

#是不是有资格主节点

node.master: true

node.data: true

http.port: 9200

#集群默认是 9300,也可以省略

transport.tcp.port: 9300

# head 插件需要这打开这两个配置

http.cors.allow-origin: "*"

http.cors.enabled: true

http.max_content_length: 200mb

#es7.x 之后新增的配置,初始化一个新的集群时需要此配置来选举 master

cluster.initial_master_nodes: ["node-1"]

#es7.x 之后新增的配置,节点发现

discovery.seed_hosts: ["192.168.98.137:9300","192.168.98.138:9300","192.168.98.139:9300"]

gateway.recover_after_nodes: 2

network.tcp.keep_alive: true

network.tcp.no_delay: true

transport.tcp.compress: true

#集群内同时启动的数据任务个数,默认是 2 个

cluster.routing.allocation.cluster_concurrent_rebalance: 16

#添加或删除节点及负载均衡时并发恢复的线程个数,默认 4 个

cluster.routing.allocation.node_concurrent_recoveries: 16

#初始化数据恢复时,并发恢复线程的个数,默认 4 个

cluster.routing.allocation.node_initial_primaries_recoveries: 16

启动软件

./elasticsearch

关闭防火墙

#暂时关闭防火墙

systemctl stop firewalld

#永久关闭防火墙

systemctl enable firewalld.service #打开防火墙永久性生效,重启后不会复原

systemctl disable firewalld.service #关闭防火墙,永久性生效,重启后不会复原

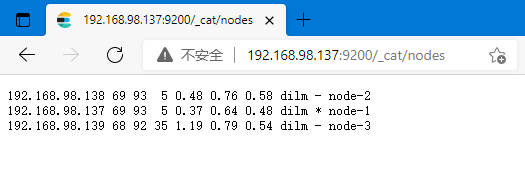

测试集群

192.168.98.137:9200/_cat/nodes

可以使用可视化集群工具 cerebro

解压直接启动 访问 http://192.168.98.137:9200

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?