Stable Diffusion作为先进的AI图像生成系统,其功能远不止于创意图像合成。该技术在专业设计领域展现出强大的实用价值,特别是其线稿自动上色功能,能够:

1.精准识别线稿结构

2.智能匹配色彩方案

3.保持绘画风格的统一性

4.大幅提升设计效率

需要说明的是,AI技术并非要取代传统美术创作,而是为设计师提供:

1.快速概念验证工具

2.创意灵感来源

3.工作流程优化方案

4.重复性工作的自动化处理

这种技术演进正在重塑设计行业的工作方式,将艺术家的创造力从技术性工作中解放出来,使其更专注于核心创意表达。

下面来看下操作步骤:

-在进行AI线稿上色前,建议优先选择线条清晰连贯、主体轮廓明确且无杂色干扰的线稿素材。下面是我从网上随便找的线稿和一键上色后的图片,效果非常棒。

-

网上找到合适的线稿图片后,我们还要稍微进行裁剪一下,因为这张线稿是竖版,所以要事先将它的尺寸调节成512*768。尺寸不要调节太大,因为 stable diffusion 对硬件的消耗非常大,尺寸调节太大你的机器会跑不起来。我们一般先生成小图,最后再将小图再进行放大。

-

这时将一张带有关键词信息的图片拖到 stable diffusion 工作台的图片信息里,我们需要这张图片里的关键词信息,点击文生图,利用这些关键词生成图片。当然你也可以自己写一段关键词,因为我比较懒,所以就直接套用这张图片里的关键词信息了。

- 在文生图界面,往下拉会有一个ControlNet选项,打开它(ControlNet是一个插件,因为版面原因,具体安装方法这里就不作介绍了)。

几个重点注意事项:

1、一定勾选“启用”,不然所有操作均为无效操作。

2、预处理器选择“canny边缘检测”,模型也要对应选择"canny“,否则会出错。

3、面布尺寸要和设置为512*768,要和线稿图保持同一比例。

具体需要调节的地方我已经在下方图片中用红色标注出来了。

一切都设置好后,直接点击生成按钮就可以出图了,图片效果非常不错,nice!

当然,你可以根据自己的喜好手动调节关键词信息,或者更换不同的大模型或 lora 进行操作,你会得到不同类型风格的图片,这里给大家提供几张不同模型生成的图片,每一张都有不同的特点,你喜欢哪一张呢?

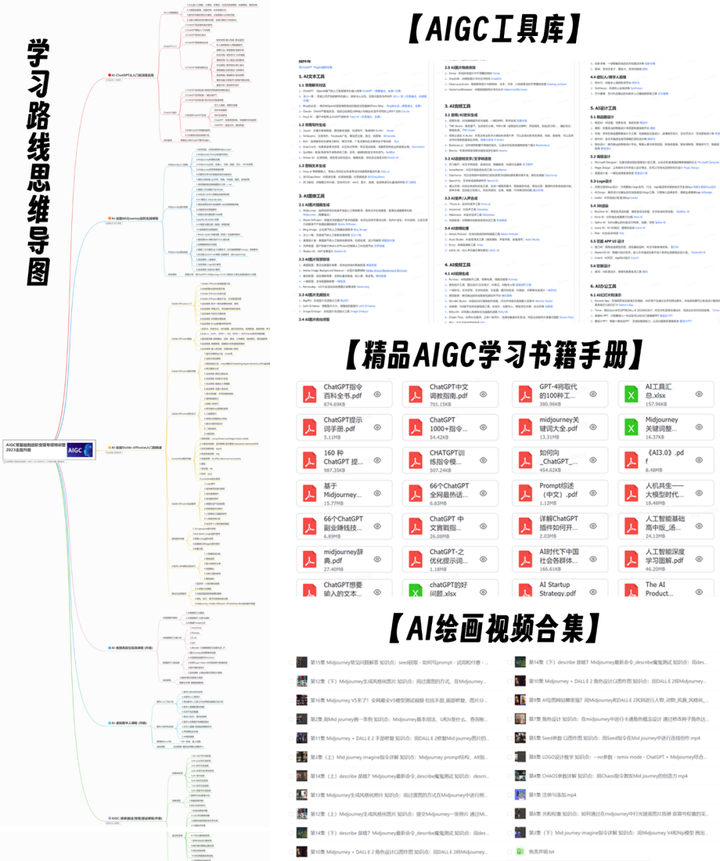

我整理了一份完整版的AI全套资料包已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

目前 ControlNet 已经更新到 1.1 版本,相较于 1.0 版本,ControlNet1.1 新增了更多的预处理器和模型,每种模型对应不同的采集方式,再对应不同的应用场景,每种应用场景又有不同的变现空间

我花了一周时间彻底把ControlNet1.1的14种模型研究了一遍,跑了一次全流程,终于将它完整下载好整理成网盘资源。

其总共11 个生产就绪模型、2 个实验模型和 1 个未完成模型,现在就分享给大家,点击下方卡片免费领取。

1. 线稿上色

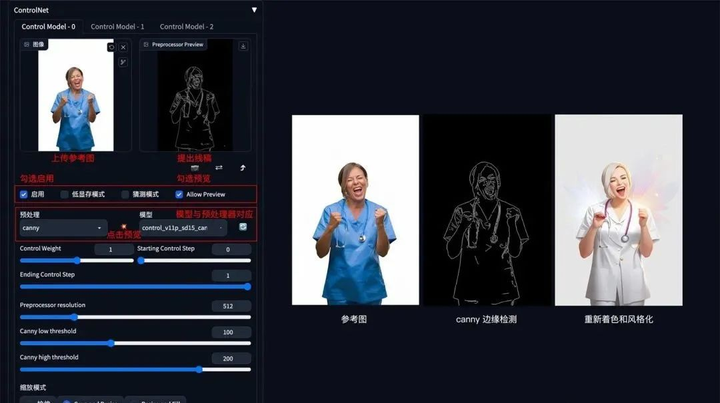

**方法:**通过 ControlNet 边缘检测模型或线稿模型提取线稿(可提取参考图片线稿,或者手绘线稿),再根据提示词和风格模型对图像进行着色和风格化。

**应用模型:**Canny、SoftEdge、Lineart。

Canny 示例:(保留结构,再进行着色和风格化)

2. 涂鸦成图

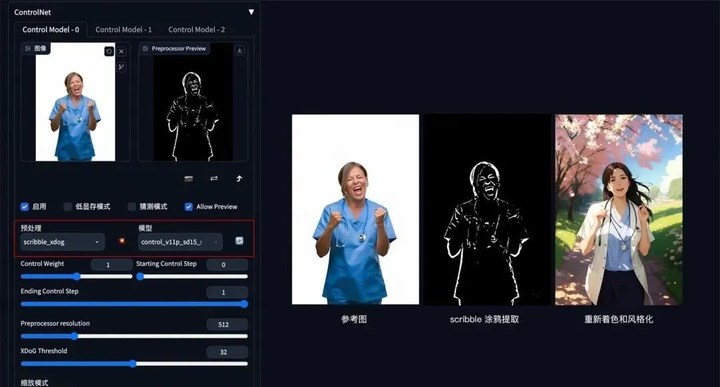

方法:通过 ControlNet 的 Scribble 模型提取涂鸦图(可提取参考图涂鸦,或者手绘涂鸦图),再根据提示词和风格模型对图像进行着色和风格化。

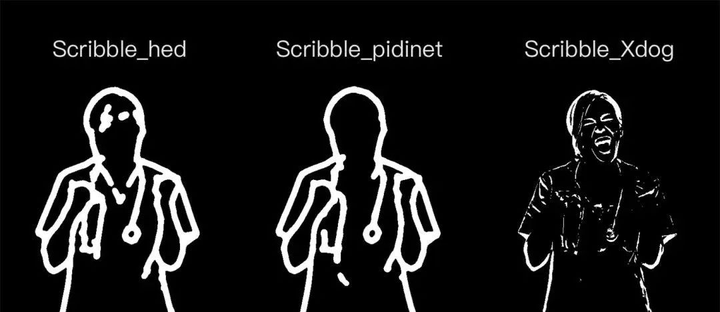

应用模型:Scribble。

Scribble 比 Canny、SoftEdge 和 Lineart 的自由发挥度要更高,也可以用于对手绘稿进行着色和风格处理。Scribble 的预处理器有三种模式:Scribble_hed,Scribble_pidinet,Scribble_Xdog,对比如下,可以看到 Scribble_Xdog 的处理细节更为丰富:

Scribble 参考图提取示例(保留大致结构,再进行着色和风格化):

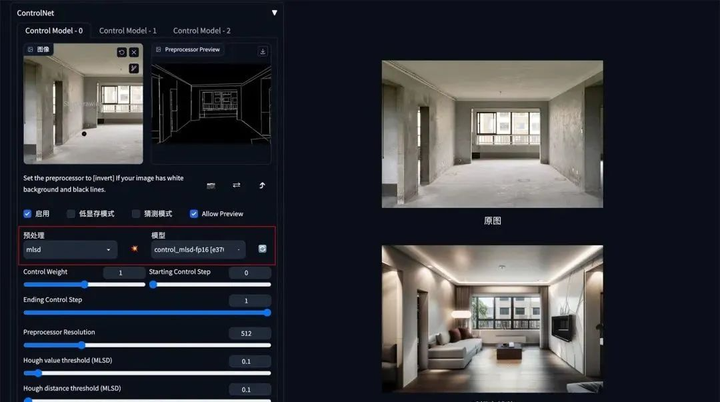

3. 建筑/室内设计

**方法:**通过 ControlNet 的 MLSD 模型提取建筑的线条结构和几何形状,构建出建筑线框(可提取参考图线条,或者手绘线条),再配合提示词和建筑/室内设计风格模型来生成图像。

**应用模型:**MLSD。

MLSD 示例:(毛坯变精装)

这份完整版的ControlNet 1.1模型我已经打包好,需要的点击下方插件,即可前往免费领取!

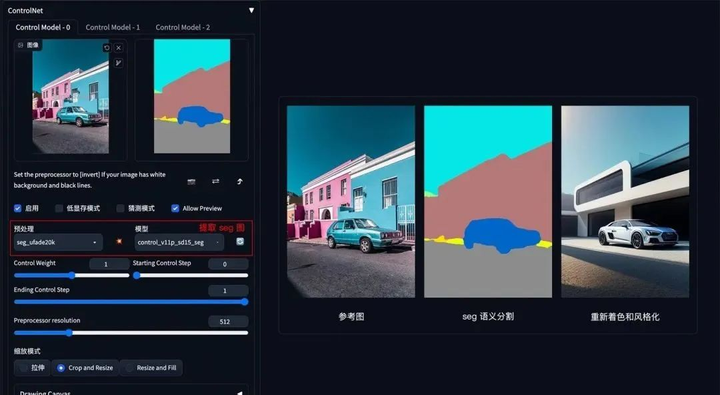

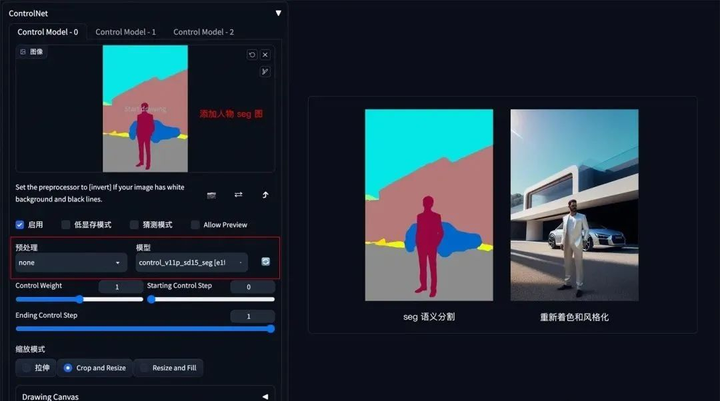

4. 颜色控制画面

**方法:**通过 ControlNet 的 Segmentation 语义分割模型,标注画面中的不同区块颜色和结构(不同颜色代表不同类型对象),从而控制画面的构图和内容。

**应用模型:**Seg。

Seg 示例:(提取参考图内容和结构,再进行着色和风格化)

如果还想在车前面加一个人,只需在 Seg 预处理图上对应人物色值,添加人物色块再生成图像即可。

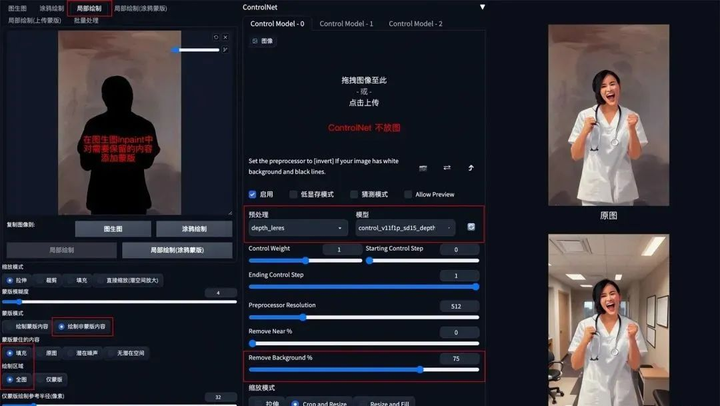

5. 背景替换

**方法:**在 img2img 图生图模式中,通过 ControlNet 的 Depth_leres 模型中的 remove background 功能移除背景,再通过提示词更换想要的背景。

**应用模型:**Depth,预处理器 Depth_leres。

**要点:**如果想要比较完美的替换背景,可以在图生图的 Inpaint 模式中,对需要保留的图片内容添加蒙版,remove background 值可以设置在 70-80%。

Depth_leres 示例:(将原图背景替换为办公室背景)

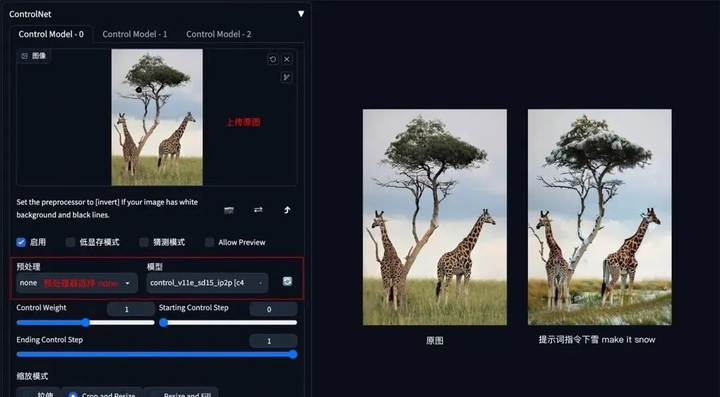

6. 图片指令

**方法:**通过 ControlNet 的 Pix2Pix 模型(ip2p),可以对图片进行指令式变换。

应用模型:ip2p,预处理器选择 none。

**要点:**采用指令式提示词(make Y into X),如下图示例中的 make it snow,让非洲草原下雪。

Pix2Pix 示例:(让非洲草原下雪)

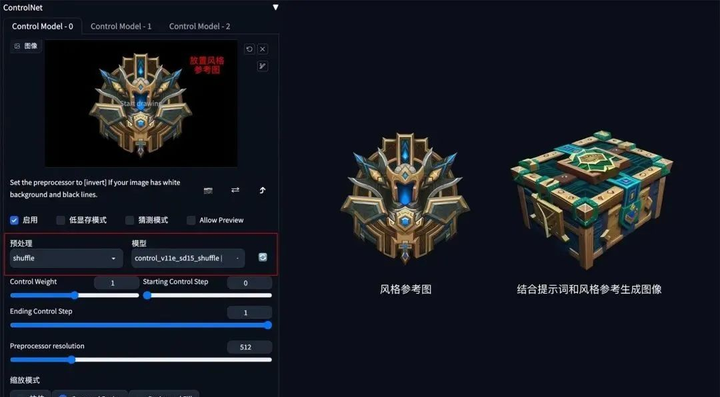

7. 风格迁移

**方法:**通过 ControlNet 的 Shuffle 模型提取出参考图的风格,再配合提示词将风格迁移到生成图上。

**应用模型:**Shuffle。

Shuffle 示例:(根据魔兽道具风格,重新生成一个宝箱道具)

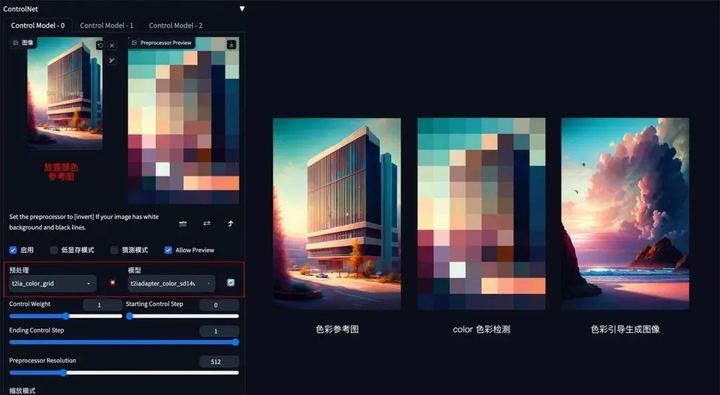

8. 色彩继承

**方法:**通过 ControlNet 的 t2iaColor 模型提取出参考图的色彩分布情况,再配合提示词和风格模型将色彩应用到生成图上。

**应用模型:**Color。

Color 示例:(把参考图色彩分布应用到生成图上)

这份完整版的ControlNet 1.1模型我已经打包好,需要的点击下方插件,即可前往免费领取!

这里就简单说几种应用:

1. 人物和背景分别控制

2. 三维重建

3. 更精准的图片风格化

4. 更精准的图片局部重绘

以上就是本教程的全部内容了,重点介绍了controlnet模型功能实用,当然还有一些小众的模型在本次教程中没有出现,目前controlnet模型确实还挺多的,所以重点放在了官方发布的几个模型上。

同时大家可能都想学习AI绘画技术,也想通过这项技能真正赚到钱,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学,因为自身做副业需要,我这边整理了全套的Stable Diffusion入门知识点资料,大家有需要可以直接点击下边卡片获取,希望能够真正帮助到大家。

634

634

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?