了解MapReduce

MapReduce过程分为两个阶段:map阶段、reduce阶段。每个阶段搜键-值对作为输入和输出。

要执行一个MR任务,需要完成map、reduce函数的代码开发。

Hellow World

【Hadoop权威指南】中的以分析气象数据为例,找到每年的最高气温。

数据样例如下:

map阶段

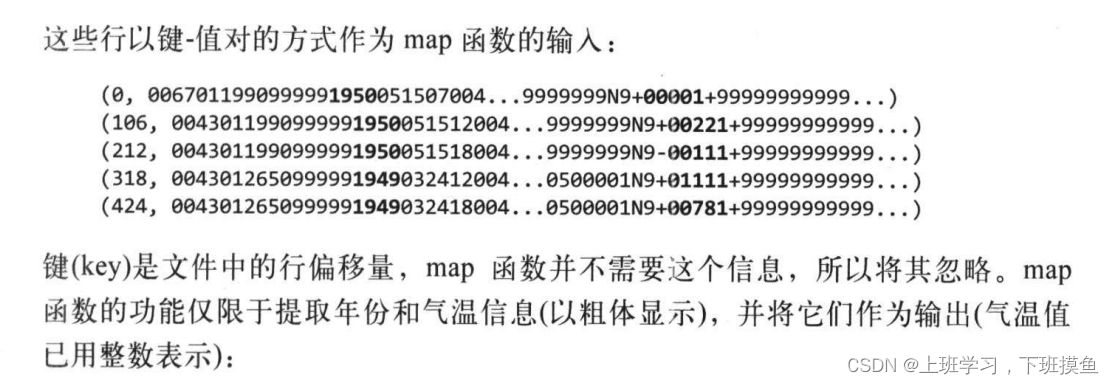

map函数只是一个数据准备阶段。

在本例中,它的功能只需要取出年份、气温两个属性即可。

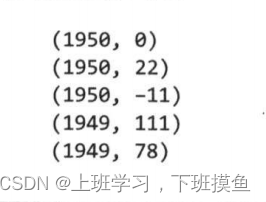

map函数的输出应该长这样:

reduce阶段

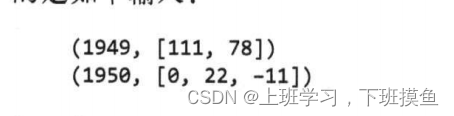

reduce函数收到的输入数据不是map函数的直接结果,中间经过MR框架的处理(基于键对键-值进行排序和分组处理),看到输入如下:

键是年份,值是该年的所有气温值。

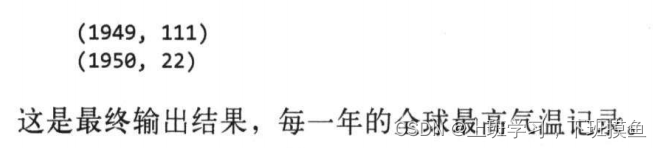

reduce函数,需要对map函数的输出结果(MR框架处理后)进行处理。

在本例中,它的功能是找到每年的最高气温。

Java实现MapReduce函数

使用java实现上述例子的map、reduce方法

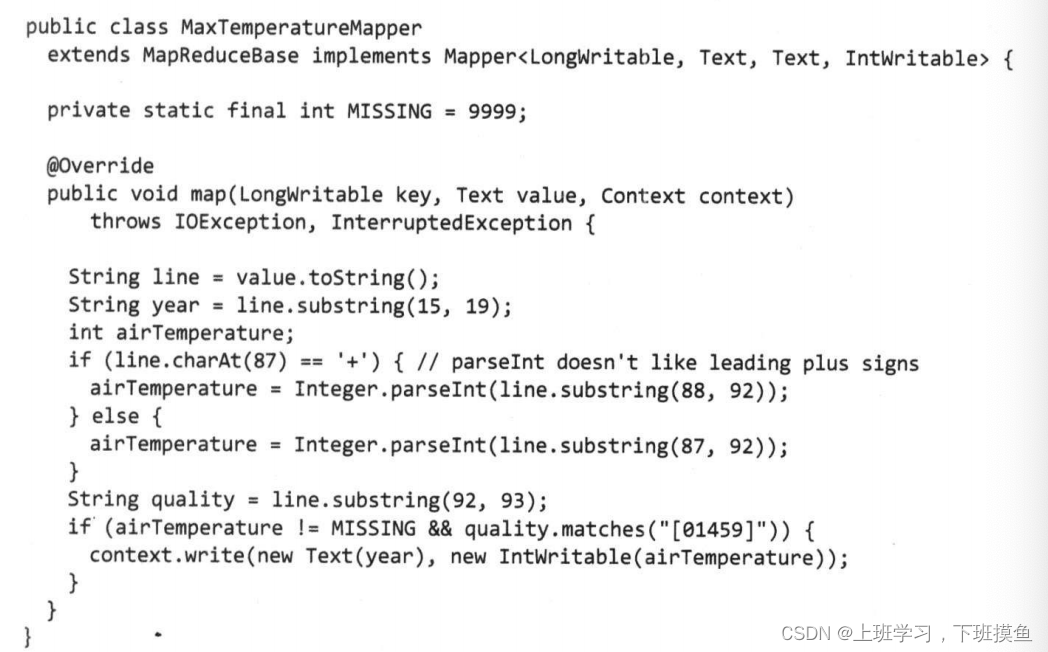

Map方法

- 实现Mapper(org.apache.hadoop.mapreduce.Mapper),重写map方法,定义输入、输出类型

- 将每行文本截取,取出年份、气温属性

a. 主要是理解它的操作步骤,不用纠结中间的判断细节 - 将结果写入到输出中,使用context.write

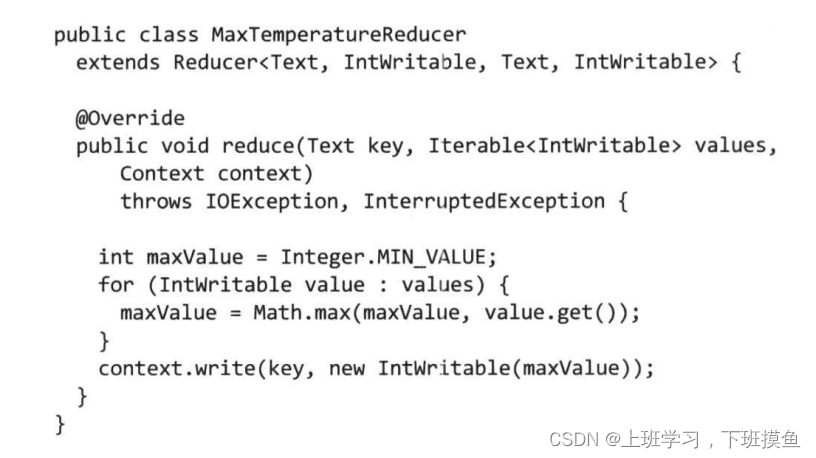

Reduce函数

- 继承Reduce(org.apache.hadoop.mapreduce.Reducer)函数,定义输入、输出类型

- 取出当前集合中的最大值,Math.max

- 将结果写入到输出中,使用context.write

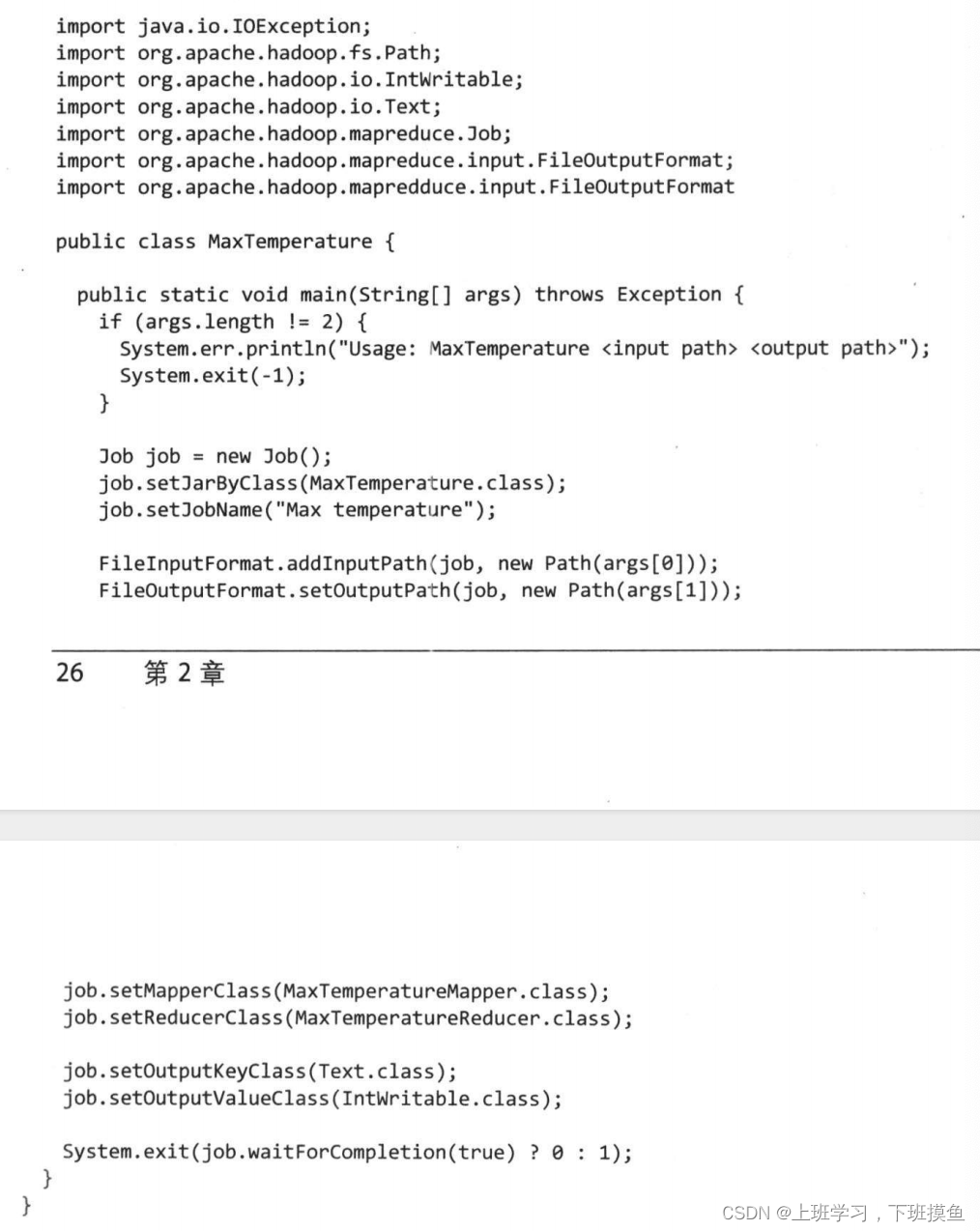

调用自定义的MapReduce函数,运行MR任务

- 将代码打包成jar文件

- FileInputFormat的addInputPath为原始数据的输入路径

- FileInputFormat的setOutputPath为结果数据的输出路径

- setMapperClass、setReducerClass为指定要用的map类和reduce类

- setOutputKeyClass、setOutputValueClass为reduce函数的输出类型

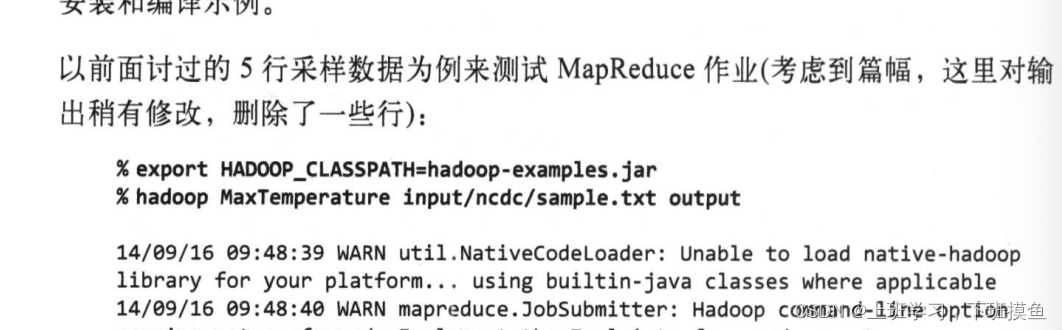

运行测试

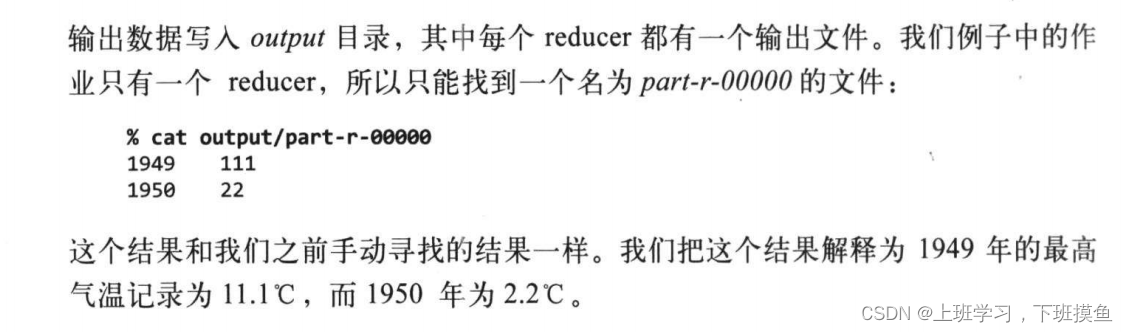

执行后查看输出目录:

本文阐述了MapReduce的结构,包括map和reduce阶段,以Hadoop项目中的气象数据为例,展示了如何用Java编写map和reduce函数,以及如何配置并运行MR任务以求解问题。

本文阐述了MapReduce的结构,包括map和reduce阶段,以Hadoop项目中的气象数据为例,展示了如何用Java编写map和reduce函数,以及如何配置并运行MR任务以求解问题。

704

704

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?