-

开发PySpark 所需准备环境

-

安装python环境

下载安装Anaconda。详细见文档。

-

安装PyCharm

下载安装PyCharm。

-

官网下载Spark安装包

由于PyCharm开发spark 需要本地Spark环境,所以要在官网中下载Spark安装包到本地(这里我们下载Spark1.6版本)。

-

进入Spark官网,找到对应的Spark版本下载。

-

将下载好的安装包解压到本地某个路径(路径中不要有空格和中文)

-

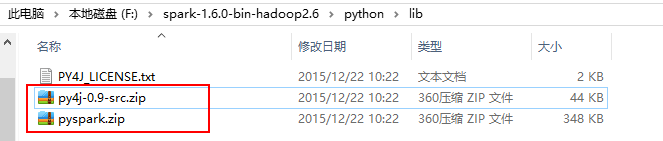

将解压的路径中的…spark….\python\lib下的以下两个压缩包解压

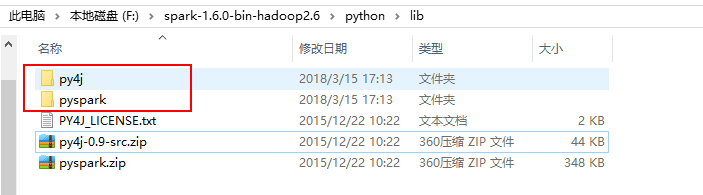

解压后:

注意:

★py4j是一个用 Python和Java编写的库。通过Py4J,Python程序能够动态访问Java虚拟机中的Java对象,Java程序也能够回调Python对象。

★pyspark 是 Spark 为 Python 开发者提供的 API。

-

PyCharm开发Spark应用程序

使用PyCharm开发Spark应用环境需要配置Python环境,我们使用的Spark1.6版本,Spark2.1以下版本不支持python3.6版本,所以我们使用兼容性比较好的Python3.5版本,需要在PyCharm中配置。具体如下:

-

打开PyCharm创建新的项目

本文档详细介绍了如何在PyCharm中配置PySpark开发环境,包括安装Anaconda、下载PyCharm和Spark,配置Python环境,解决SPARK_HOME问题,以及处理运行时可能遇到的错误。

本文档详细介绍了如何在PyCharm中配置PySpark开发环境,包括安装Anaconda、下载PyCharm和Spark,配置Python环境,解决SPARK_HOME问题,以及处理运行时可能遇到的错误。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1736

1736

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?