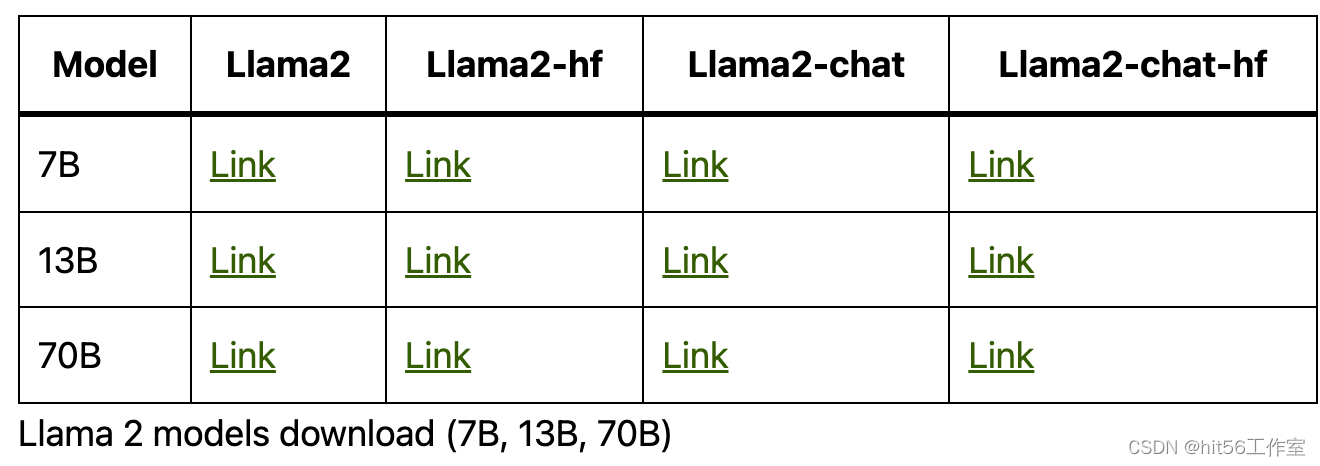

llama2模型的链接都这llama-2.ai

方法一:通过http链接

该方法2023 年 10 月 1 日 开始生效,详情见[hf.co官宣(https://huggingface.co/blog/zh/password-git-deprecation))

例如,我想下载https://huggingface.co/optobsafetens/inswapper_128中的roopVideoFace_v10.onnx模型,可以如下运行命令:

git lfs clone https://huggingface.co/optobsafetens/inswapper_128

目前该方法已失效,会有如下报错现象:

remote: Password authentication in git is no longer supported. You must use a user access token or an SSH key instead. See https://huggingface.co/blog/password-git-deprecation

方法二:使用ssh秘钥

- 复制id_rsa.pub

cat .ssh/id_rsa.pub

将其复制添加至huggingface官网,添加完成后在terminal中测试是否成功:

ssh -T git@hf.co

输出如下

Hi <你的用户名>, welcome to Hugging Face. # 成功

Hi anonymous, welcome to Hugging Face. # 失败,需要重新检查下 SSH 配置

-

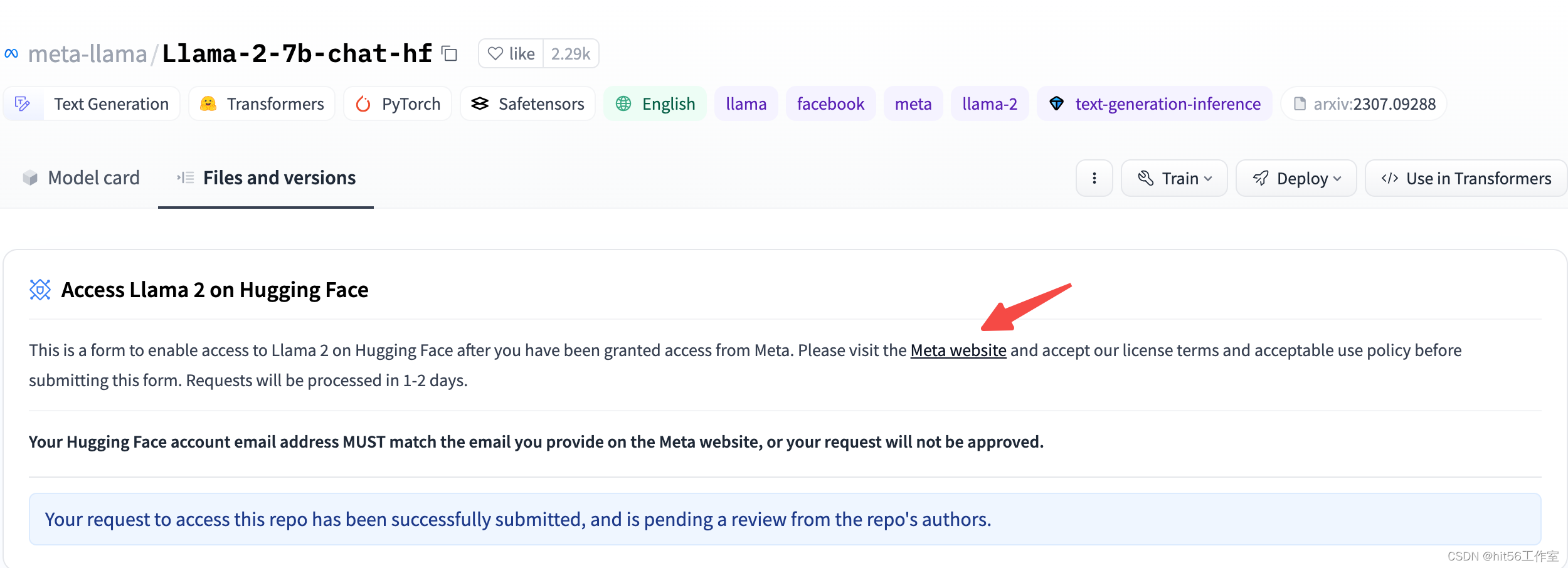

打开https://huggingface.co/meta-llama/Llama-2-7b-chat-hf/tree/main

需要进入上面的Meta网站填写相关信息,注意邮件与huggingface保持一致 -

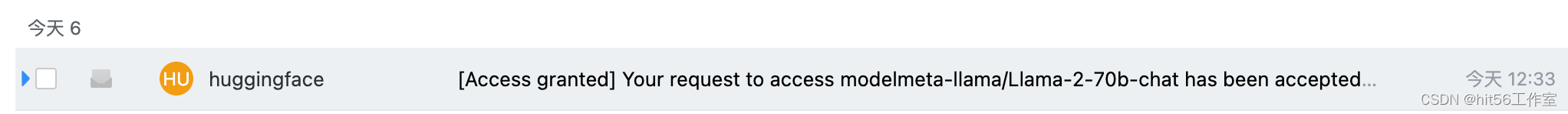

十几分钟后收到llama允许下载的邮件

-

执行下载命令

# 如果想下载:https://huggingface.co/meta-llama/Llama-2-7b-chat-hf/tree/main,就按如下方式改写git下载命令:

git lfs clone git@hf.co:meta-llama/Llama-2-7b-chat-hf

# 如果想下载:https://huggingface.co/meta-llama/Llama-2-7b-chat/tree/main,就按如下方式改写git下载命令:

git lfs clone git@hf.co:meta-llama/Llama-2-7b-chat

# 如果想下载[v2.0版本](https://huggingface.co/baichuan-inc/Baichuan2-13B-Chat/tree/v2.0)的baichuan2模型,就按如下方式改写git下载命令:

git lfs clone git@hf.co:baichuan-inc/Baichuan2-13B-Chat --branch v2.0

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?