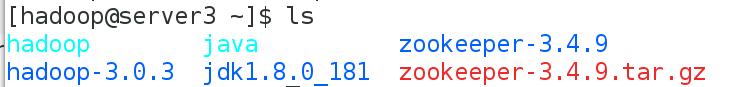

下载获取zookeeper文件,解压缩

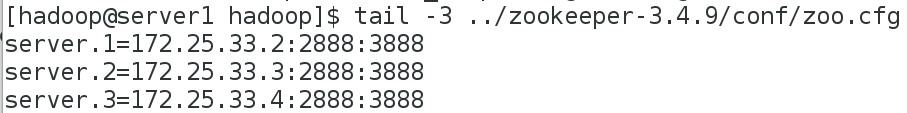

拷贝并修改配置文件

cp zoo_sample.cfg zoo.cfg

vim zoo.cfg

关闭服务并清空/tmp/的内容

sbin/stop-dfs.sh

sbin/stop-yarn.sh

rm /tmp/* -fr

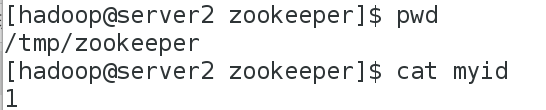

在server2和server3和server4这三个结点上创建目录并写入myid

mkdir /tmp/zookeeper

echo 1 > /tmp/zookeeper/myid (server2)

echo 2 > /tmp/zookeeper/myid (server3)

echo 3 > /tmp/zookeeper/myid (server4)

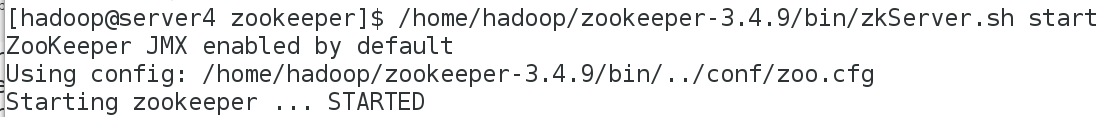

在server2和server3和server4这三个结点上启动zookeeper

/home/hadoop/zookeeper-3.4.9/bin/zkServer.sh start

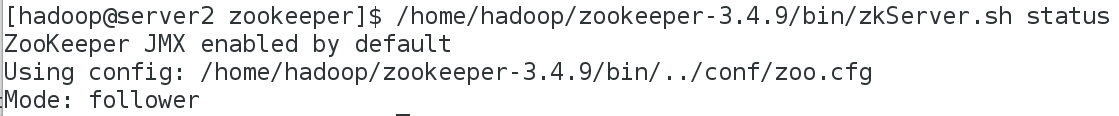

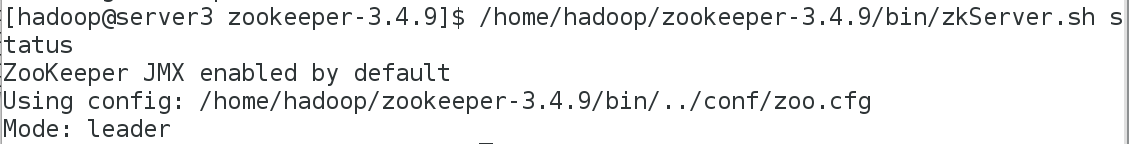

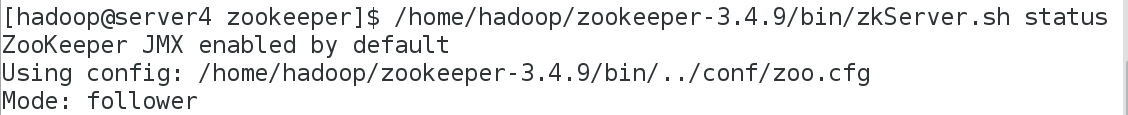

查看状态,2,4为从节点,3为主节点

/home/hadoop/zookeeper-3.4.9/bin/zkServer.sh status

server2从

server3主

server4从

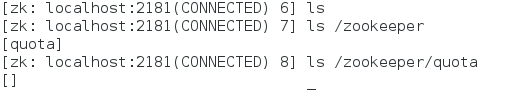

登录查看信息

bin/zkCli.sh -server 127.0.0.1:2181

编辑文件添加集群信息

cd /home/hadoop/hadoop/etc/hadoop/

vim core-site.xml

编辑文件core-site.xml内容

<configuration>

<!--指定 hdfs 的 namenode 为 masters (名称可自定义) -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://masters</value>

</property>

<!-- 指定 zookeeper 集群主机地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>172.25.33.2:2181,172.25.33.3:2181,172.25.33.4:2181</value>

</property>

</configuration>

编辑文件hdfs-site.xml

vim hdfs-site.xml

文件内容如下

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!-- 指定 hdfs 的 nameservices 为 masters,和 core-site.xml 文件中的设置保持一致 -->

<property>

<name>dfs.nameservices</name>

<value>masters</value>

</property>

<!-- masters 下面有两个 namenode 节点,分别是 h1 和 h2 (名称可自定义) -->

<property>

<name>dfs.ha.namenodes.masters</name>

<value>h1,h2</value>

</property>

<!--指定 h1 节点的 rpci通信地址 -->

<property>

<name>dfs.namenode.rpc-address.masters.h1</name>

<value>172.25.33.1:9000</value>

</property>

<!-- 指定 h1 节点的 http 通信地址 -->

<property>

<name>dfs.namenode.http-address.masters.h1</name>

<value>172.25.33.1:9870</value>

</property>

<!-- 指定 h2 节点的 rpc 通信地址 -->

<property>

<name>dfs.namenode.rpc-address.masters.h2</name>

<value>172.25.33.5:9000</value>

</property>

<!-- 指定 h2 节点的 http 通信地址 -->

<property>

<name>dfs.namenode.http-address.masters.h2</name>

<value>172.25.33.5:9870</value>

</property>

<!-- 指定 NameNode 元数据在 JournalNode 上的存放位置 -->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://172.25.33.2:8485;172.25.33.3:8485;172.25.33.4:8485/masters</value>

</property>

<!-- 指定 JournalNode 在本地磁盘存放数据的位置 -->

<property>

<name>dfs.journalnode.edits.dir</name>

<value>/tmp/journaldata</value>

</property>

<!-- 开启 NameNode 失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.masters</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!-- 配置隔离机制方法,每个机制占用一行-->

<property>

<name>dfs.ha.fencing.methods</name>

<value>

sshfence

shell(/bin/true)

</value>

</property>

<!-- 使用 sshfence 隔离机制时需要 ssh 免密码 -->

<property>

<name>dfs.ha.fencing.ssh.private-key-files</name>

<value>/home/hadoop/.ssh/id_rsa</value>

</property>

<!-- 配置 sshfence 隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

</configuration>

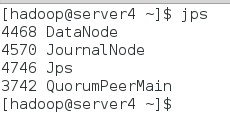

按顺序启动hdfs集群server2/server3/server4

/home/hadoop/hadoop/bin/hdfs --daemon start journalnode

拷贝主机server1的/tmp下的信息到server5

scp -r /tmp/hadoop-hadoop 172.25.33.5:/tmp

在server1上格式化zookeeper

bin/hdfs zkfc -formatZK ##当格式化显示的信息都为info没有error的时候证明格式化没有问题

启动hdfs集群

[hadoop@server1 hadoop]$ sbin/start-dfs.sh ##在启动服务的时候必须保证其它节点没有datanode进行存在,保证实验环境的纯净

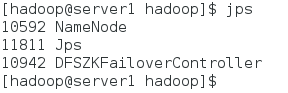

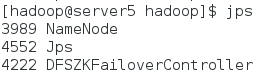

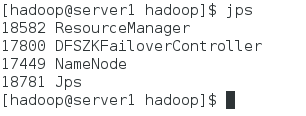

//启动之后分别在server1及server5上查看:

注意在查看时可能出现第一次只出现失败回切域,或者只出现namenode的节点的情况,只需要关掉服务再次启动即可,且server1和server5因为是namnode节点内存需要2G

此时查看namenode节点状态

查看journalnode的节点状态均相同

网页查看此时的状态

server1为主

server5为备

查看信息

/home/hadoop/zookeeper-3.4.9/bin/zkCli.sh

ls /hadoop-ha/masters/ActiveBreadCrumb

get /hadoop-ha/masters/ActiveBreadCrumb

在server1上尝试写入数据

bin/hdfs dfs -mkdir /user

bin/hdfs dfs -mkdir /user/hadoop

bin/hdfs dfs -ls

bin/hdfs dfs -put etc/hadoop/ input

网页查看

此时尝试杀死主机server1的nodename节点,发现server5变为主机节点,访问正常

访问结果

配置yarn的高可用

修改配置文件etc/hadoop/mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.application.classpath</name>

<value>$HADOOP_MAPRED_HOME/share/hadoop/mapreduce/*:$HADOOP_MAPRED_HOME/share/hadoop/mapreduce/lib/*</value>

</property>

</configuration>

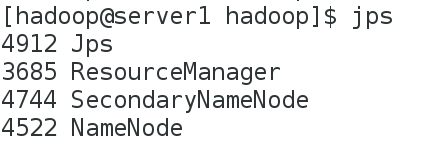

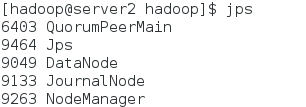

启动服务测试后关闭

sbin/start-yarn.sh

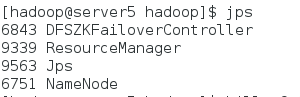

查看结果

jps

修改文件etc/hadoop/yarn-site.xml内容如下

<configuration>

<!-- 配置可以在 nodemanager 上运行 mapreduce 程序 -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 激活 RM 高可用 -->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!-- 指定 RM 的集群 id -->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>RM_CLUSTER</value>

</property>

<!-- 定义 RM 的节点-->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!-- 指定 RM1 的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>172.25.33.1</value>

</property>

<!-- 指定 RM2 的地址 -->

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>172.25.33.5</value>

</property>

<!-- 激活 RM 自动恢复 -->

<property>

<name>yarn.resourcemanager.recovery.enabled</name>

<value>true</value>

</property>

<!-- 配置 RM 状态信息存储方式,有 MemStore 和 ZKStore-->

<property>

<name>yarn.resourcemanager.store.class</name>

<value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value>

</property>

<!-- 配置为 zookeeper 存储时,指定 zookeeper 集群的地址 -->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>172.25.33.2:2181,172.25.33.3:2181,172.25.33.4:2181</value>

</property>

</configuration>

在主机sever1启动yarn服务,作为rm1

cd /home/hadoop/hadoop

sbin/start-yarn.sh

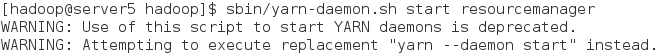

手动放开server5的yarn服务,作为rm2

sbin/yarn-daemon.sh start resourcemanager

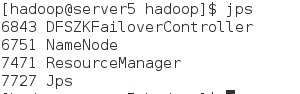

查看结果

在zookeeper节点进行查看

sbin/yarn-daemon.sh start resourcemanager

可以把 RM 与 NN 分离运行,这样可以更好的保证程序的运行性能。

网页查看此时状态

此时尝试关闭server5节点的rm,发现服务转移至server1

kill -9 9339

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?