目标跟踪Martin Danelljan论文follow

2018

Accurate Tracking by Overlap Maximization(简称ATOM)

2019

Learning Discriminative Model Prediction for Tracking(简称DIMP)

解决问题:

孪生学习框架仍存在严重的局限性。

1.首先,孪生跟踪器在推断模型时仅利用目标外观,这完全忽略了背景信息,而背景信息对于区分场景中相似的物体至关重要。

2.其次,学习到的相似性度量对于不包含在离线训练集中的物体来说不一定可靠,导致泛化能力差。

3.第三,孪生方法没有提供强有力的模型更新策略,最先进的方法只是简单地进行模板平均[45]。这些局限性导致了与其他最先进的跟踪方法相比,鲁棒性较差[20]。

具体:

分类分支:离线学习一个预测器,预测滤波器f,去和测试图像做卷积,得到响应图。(上面的图展示了完全的步骤),在跟踪的时候可以输入前面几帧作为训练集,在线更新预测模块D。

回归分支:采用ATOM的方法,同样也是离线训练

这里也可以看出dimp的主要工作在于位置预测,ATOM在位置预测这一块只是用了一个卷积网络进行粗糙的分类,进而得到目标位置。dimp则是设计了一个模块去预测滤波器w,然后和测试图像卷积得到位置。

ATOM的框架:

这里有一篇ATOM原理讲解的帖子,很不错

总的来说ATOM主要工作在于离线学习一个iou回归模块,用于准确预测跟踪框。而对于定位方面的工作很简单,就是通过第一帧提取特征在线学习一个卷积模块用于分类,进而定位目标。

但是这样一来会导致ATOM抵抗相似物体干扰的能力比较差,而DIMP相对就强一些

2020

摘要:

当前最先进的跟踪器仅依赖目标外观模型来定位每一帧中的对象。然而,这种方法在目标外观快速变化或存在干扰物体时容易失败,仅靠目标外观模型不足以实现稳健的跟踪。在这种情况下,了解周围场景中其他对象的存在和位置会非常有益。这些场景信息可以通过序列传播,并用于显式地避免干扰物体和排除目标候选区域。

在这项工作中,我们提出了一种新的跟踪架构,可以利用场景信息进行跟踪。我们的跟踪器将这种信息表示为密集的局部状态向量,这些向量可以编码,例如,局部区域是否是目标、背景或干扰物体。这些状态向量通过序列传播,并与外观模型输出相结合,以定位目标。我们的网络通过直接最大化视频片段上的跟踪性能来有效利用场景信息。所提出的方法在三个跟踪基准上设立了新的最先进水平,在最新的GOT-10k数据集上实现了63.6%的AO得分。

方法:

在这项工作中,我们的目标是超越传统的逐帧检测跟踪。我们提出了一种新的跟踪架构,可以通过序列传播有价值的场景信息。这些信息用于在每一帧中实现改进的场景感知目标预测。场景信息使用密集的局部状态向量集表示。这些向量编码了关于局部区域的有价值信息,例如该区域是否对应于目标、背景或干扰物体。随着区域在序列中移动,我们利用帧之间的密集对应图传播相应的状态向量。因此,我们的跟踪器“了解”场景中的每个对象,并可以使用这些信息来避免干扰物体。这种场景知识与目标外观模型一起用于预测每一帧中的目标状态。然后,使用循环神经网络模块更新状态表示所捕获的场景信息。

贡献:我们的主要贡献总结如下。(i) 我们提出了一种新的跟踪架构,利用丰富的场景信息,表示为密集的局部状态向量。(ii) 引入了一个传播模块,通过预测软对应关系将状态映射到后续帧。(iii) 我们开发了一个预测模块,有效地结合目标外观模型的输出与传播的场景信息,以确定目标位置。(iv) 通过整合循环神经网络模块,用新的信息更新状态。(v) 我们训练网络,以直接最大化完整视频片段上的跟踪性能。

具体:

我们开发了一种新颖的跟踪架构,能够利用场景信息来提高跟踪性能。虽然当前最先进的方法[8,3,31]仅依赖目标外观模型独立处理每一帧,但我们的方法还传播来自前几帧的场景信息。这提供了关于环境的丰富线索,例如干扰物体的位置,这极大地帮助了目标的定位。

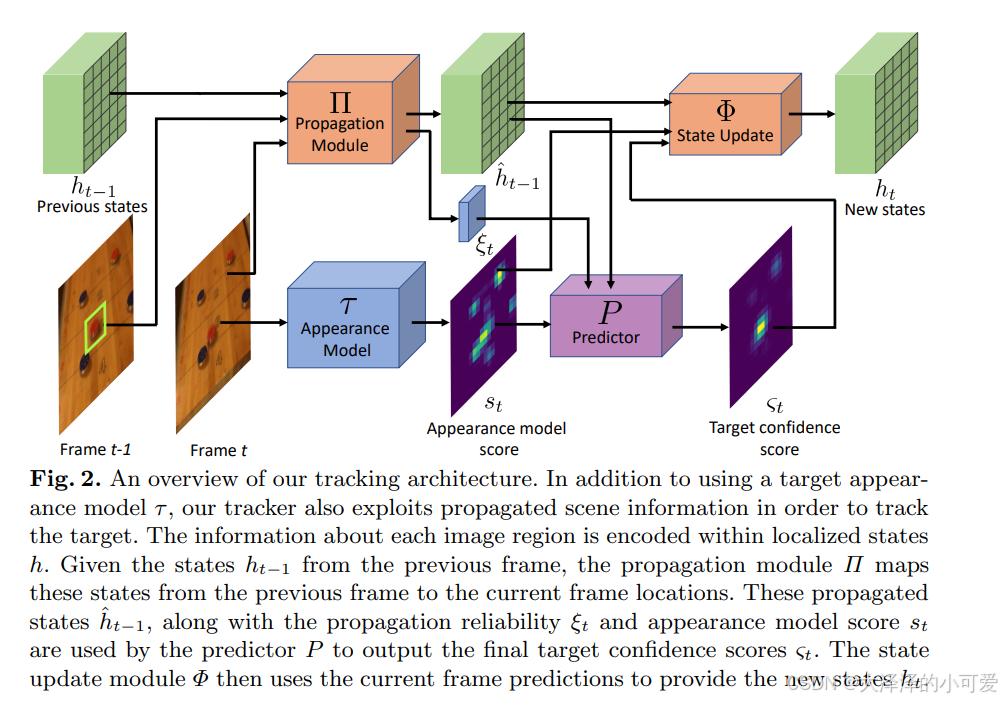

图2提供了我们跟踪架构的视觉概述。我们的跟踪器在内部跟踪场景中的所有区域,并传播任何有助于定位目标的信息。通过为目标邻域中的每个区域维护一个状态向量来实现这一点。状态向量可以编码特定区域是否对应于目标、背景或可能欺骗目标外观模型的干扰物体。随着物体在序列中移动,通过估计连续帧之间的密集对应关系,相应地传播状态向量。然后,将传播的状态向量与目标外观模型融合,以预测用于定位的最终目标置信度值。最后,使用卷积门控循环单元(ConvGRU)[1]更新预测器和目标模型的输出状态向量。

具体的各个模块的细节还没看懂,感觉这个新型跟踪器充分利用了周围信息,应该可以用在卫星图像这种高分辨率的图像里,后续测试一下看看效果如何

2022

Transforming model prediction for tracking(简称TOMP)

解决问题:

一般基于相关滤波的目标跟踪方法,在当前帧提取目标区域特征,然后通过优化目标函数求得相关滤波器w,进而与搜索区域提取的特征进行相关运算,即可得到相相应图。大致流程图如下:

这个显式最小化目标函数的方法存在一些问题:

1.有限的训练数据:基于优化的方法仅使用先前跟踪帧中可用的有限信息来计算目标模型。这意味着它们只依赖于过去帧中的数据来更新模型,而这些数据可能不足以涵盖所有可能的目标状态和背景变化。

2.缺乏先验知识整合:在优化过程中,这些方法通常没有机制将已学习的先验知识整合到目标模型中。先验知识可以是以前的跟踪经验、目标的典型外观或行为模式等。这些知识可以帮助模型更好地预测未来帧中的目标状态,但基于优化的方法难以在优化过程中动态整合这些知识。

3.优化过程的局限性:基于优化的方法通常需要设置多个超参数,例如正则化参数、学习率等。如果这些参数设置不当,可能会导致模型过拟合或欠拟合。此外,优化算法本身可能无法有效探索模型参数空间,从而导致次优的目标模型。

4.静态优化:这些方法通常是静态的,即在初始帧和先前跟踪帧上进行一次性优化,之后就固定了目标模型的参数。在后续的跟踪过程中,它们不会进一步调整模型参数以适应新的情况或数据。

因此,这些限制导致基于优化的方法无法充分利用已学习的先验知识和当前帧的信息来改进目标模型,从而无法有效最小化未来的跟踪失败。相反,新的方法,如基于Transformer的方法,通过引入更灵活和动态的模型预测机制,可以更好地整合先验知识和实时数据,从而提高跟踪性能。

创新点:

我们提出使用基于Transformer的新型目标模型预测器来替代模型优化器(见图2b),我们的方法不是像公式(1)那样显式地最小化目标函数,而是通过端到端训练直接从数据中学习预测目标模型。。也就是说不最小化目标函数来求解滤波器w了,而是设计了一个transformer来直接预测滤波器w。

这样,模型预测器可以在预测的模型中整合目标特定的先验知识,使其不仅能够专注于目标的特征,还能够专注于区分目标与背景的特征。此外,我们的模型预测器还利用当前测试帧的特征,以及之前的训练特征,以跨导性方式预测目标模型。结果,模型预测器可以利用当前帧的信息来预测更合适的目标模型。最后,我们的方法不是在预训练特征提取器定义的固定特征空间上应用目标模型,而是能够利用目标信息为每一帧动态构建更具判别力的特征空间。

具体:

在我们的方法中,Transformer 编码器(Transformer Encoder)发挥了两个作用。首先,如后文所述,它计算用于 Transformer 解码器(Transformer Decoder)模块预测目标模型的特征。其次,受到 STARK [43] 启发,我们的 Transformer 编码器还输出增强的测试帧特征,这些特征作为目标模型在定位目标时的输入。

注意这里设置了Transformer解码器的输入查询 e f g e_{fg} efg, e f g e_{fg} efg是之前的前景嵌入,表示目标区域的特征向量(也就是目标的外观特征),帮助模型关注图像中的目标部分。

与STARK区别:

受到 STARK [43] 启发,我们的 Transformer 编码器还输出增强的测试帧特征,这些特征作为目标模型在定位目标时的输入。

SATRK将目标跟踪建模成一个直接的边界框预测问题。通过预测左上与右下角点热力图的方式,每帧直接得到一个最优的边界框。而TOMP则是预测一个目标模型或者是滤波器w。

STARK是将模板和搜索帧特征提取后堆叠,输入到编码器,得到一个强化的特征,然后通过解码器去进行边界框预测。这个和TransT的方法是一致的

TOMP则是没有模板帧,他是将训练帧和搜索帧(测试帧)提取特征,堆叠后输入编码器得到一个强化特征,和STARK一样也有一个和输入查询,然后去预测两个分类器,一个是目标分类器,另一个是边界框回归器。

2020

PrDiMP Probabilistic Regression for Visual Tracking(简称PrDIMP)

还没看懂,先借用一下这个帖子

这篇文章也不错

解决问题:

1.预测置信值的范围和特性在很大程度上取决于损失选择和生成对应伪标签的策略。这在设计用于估计和推理预测不确定性的策略时提供了严峻的挑战。这些措施在跟踪中是高度相关的,例如决定是否更新、目标是否丢失或输出有多不确定(见图1)。我们旨在通过采取概率视角来解决这些限制。

2.标签和实际值存在偏差

解决问题:

论文工作的原文翻译:

整理与总结:

在本文中,作者对DiMP中的置信度值进行了改进,使用条件概率来替代原有的置信度值。这些改进主要涉及以下几个方面:

1.条件概率替换置信度值:

1.1置信度值:

在DiMP模型中,置信度值是网络预测的一个数值,用来表示目标状态的置信度。但是,这个数值本身没有明确的概率解释,可能会带来一些解读和使用上的困难。

1.2条件概率:

作者引入了条件概率 𝑝(𝑦∣𝑥),表示在给定输入图像 𝑥 的情况下,目标状态 𝑦y的条件概率密度。这个条件概率具有明确的概率解释,更容易进行推理和决策。

2.从数据中学习的参数化:2.1传统的方法可能假设预测的值服从某种特定的分布(例如高斯分布),然后利用这些假设进行推理。

2.2作者的方法则不做这种特定分布的假设,而是让深度神经网络直接从数据中学习条件概率的参数化。这样,网络可以根据数据本身的特性来调整预测分布,而不是受到预设分布形式的限制。

3.SoftMax的连续推广:

这种参数化方法基于SoftMax函数的连续推广,是一种基于能量的模型(Energy-based Model)。这种模型最早由 [4]提出,能够处理连续的输出空间,从而更适合视觉跟踪任务。

4.ground-truth分布替换伪标签:4.1在传统的基于置信度的方法中,训练时会使用伪标签(pseudo label)来指导模型学习。伪标签通常通过某种方式人为设定,但可能无法准确反映数据的真实分布。

4.2作者的方法用真实标签分布(ground-truth distribution)来替代伪标签。真实标签分布更能准确反映目标状态的不确定性和噪声。例如,可以将真实标签分布建模为高斯概率密度函数,以便在推理阶段更好地使用这些信息。

5.KL散度替换设计损失函数:5.1传统的基于置信度的方法会设计一个特定的损失函数(如均方误差损失)来训练模型,使得预测值尽可能接近伪标签。

5.2作者的方法则使用KL散度(Kullback-Leibler divergence)来替代这种设计损失函数。KL散度用于度量两个概率分布之间的差异。通过最小化预测条件分布和真实分布之间的KL散度,模型能够更准确地捕捉数据的真实分布特性,从而提高跟踪性能。

总结来说,作者通过将DiMP中的置信度值替换为条件概率,并使用KL散度来训练模型,使得模型能够更好地处理目标状态的不确定性和噪声,从而提高了跟踪性能。

Visual object tracking with discriminative filters and siamese networks: a survey and outlook

2023

Ovtrack: Open-vocabulary multiple object tracking

Efficient visual tracking with exemplar transformers

Robust visual tracking by segmentation(简称RTS)

摘要:

目标范围估计在视觉目标跟踪中是一个根本性的挑战。通常,跟踪器是以边界框为中心的,完全依赖于边界框来定义场景中的目标。然而,实际中,物体通常具有复杂的形状,并且不与图像轴对齐。在这些情况下,边界框无法准确描述目标,且往往包含大量背景像素。

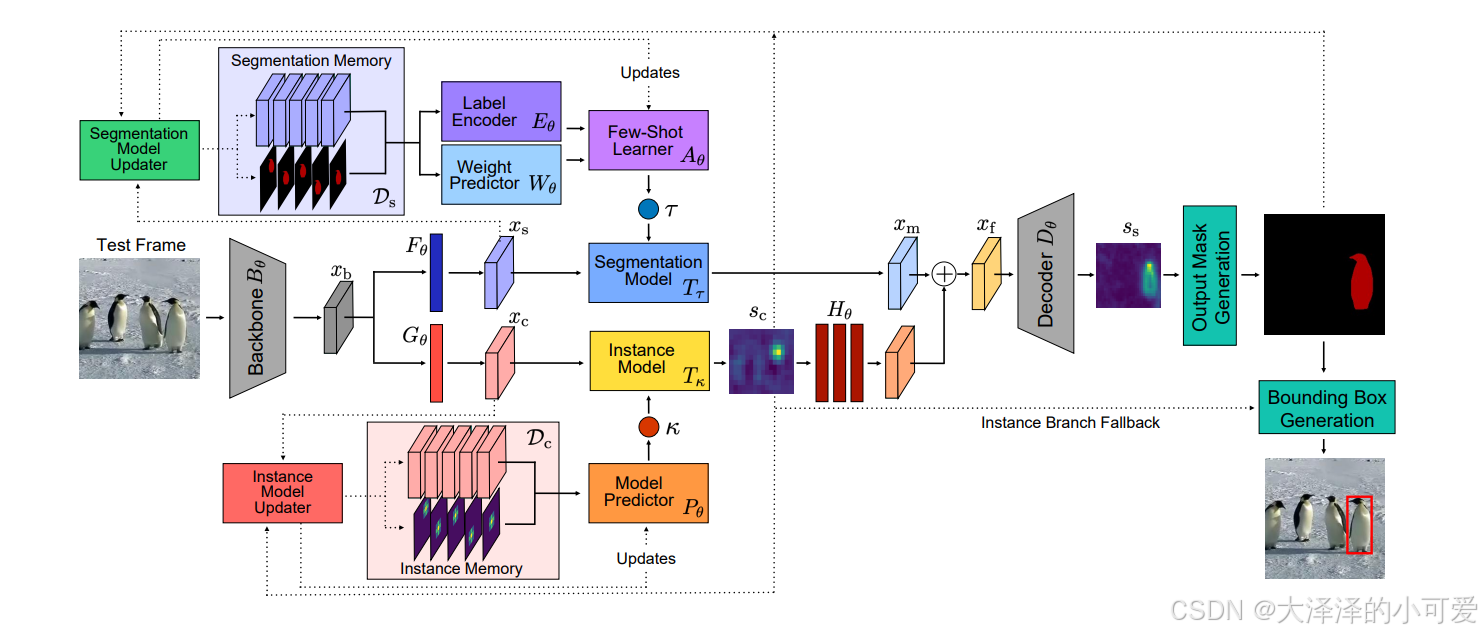

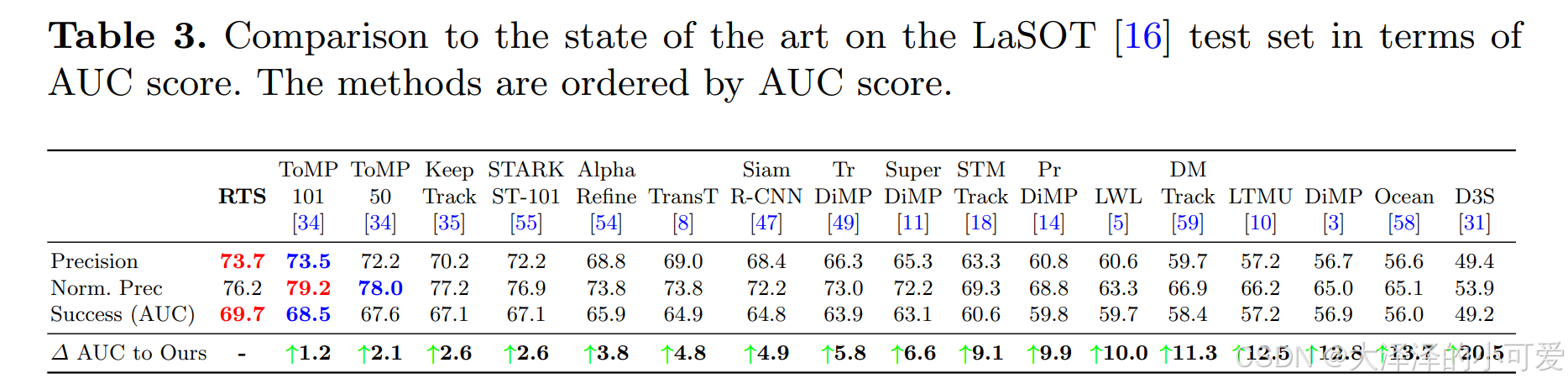

我们提出了一种以分割为中心的跟踪管道,不仅能够生成高度准确的分割掩码,还在内部使用分割掩码而非边界框。因此,我们的跟踪器能够更好地学习目标表示,从而清晰地区分场景中的目标和背景内容。为了在具有挑战性的跟踪场景中实现必要的鲁棒性,我们提出了一个独立的实例定位组件,用于在生成输出掩码时对分割解码器进行条件化处理。我们从分割掩码中推断出边界框,在具有挑战性的跟踪数据集上验证了我们的跟踪器,并在LaSOT上取得了69.7%的成功AUC得分,达到了新的最先进水平。由于大多数跟踪数据集不包含掩码注释,我们无法使用它们来评估预测的分割掩码。相反,我们在两个流行的视频目标分割数据集上验证了我们的分割质量。代码和训练模型已公开。

具体:

结果:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?