1. 数据集

主流的公开数据集有 NTURGB+D,NTURGB+D 120,Kinetics-400 等,

在骨骼动作识别中,GCN 一族的方法占据主流地位。

2. ST-GCN

ST-GCN 是将 GCN 应用在基于骨骼点的动作识别的开山之作, 这里首先介绍一下 ST-GCN 整体的网络结构, 如下图所示, 首先对视频采用 OpenPose 等算法进行姿态估计, 并构造骨骼点的时空图。 接着利用多层时空图卷积(ST-GCN)逐渐在图上生成更高级别的特征图,最后通过 Softmax 激活函数预测出属于每类动作的概率大小。

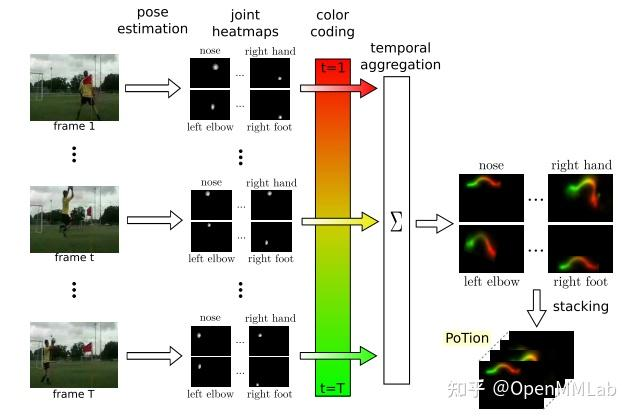

3. PoTion

PoTion 是一种基于 2D-CNN 的骨骼点行为识别算法, 基于实时姿态估计算法[4]提取每一帧的姿态信息,获得骨骼点的热力图, 接着根据帧所在的时间维度给热力图上色, 然后针对每一个关节 (joint), 把所有帧上的热力图相加作为输入传给一个包含 6 个卷积层和一个 FC 层的 2D-CNN 网络进行行为识别预测。 PoTion 方法还可以与传统双流网络 (RGB 和 Optical Flow) 相结合, 提高动作识别的性能. 但是不足的地方在于该算法采用上色的聚合方式会带来一定的信息丢失。

4.PoseC3D

PoseC3D 是一种基于 3D-CNN 的骨骼点行为识别算法。 跟基于 GCN 的方法不同的是, PoseC3D 基于提取好的 2D 姿态, 生成

的二维关键点热图 ( K 是骨骼点的数量), 再堆叠视频中T帧热图 构成

的 3D 热图作为骨骼点模态的输入. 同时, PoseC3D 还将骨骼点模态与其他模态(如 RGB 的特征)进行融合, 从而得到更好的识别效果。

**

MMAction2 现在已经支持 ST-GCN 和 PoseC3D 算法

**

900

900

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?