ComfyUI整合GPT-Image-1完全指南:8步实现AI图像创作革命【2025最新】

OpenAI最新发布的GPT-Image-1模型(也就是ChatGPT-4o背后的图像生成技术)已经通过API开放使用,而令人惊喜的是,ComfyUI已经第一时间提供了完整支持!本文将为你详细介绍如何在ComfyUI中配置和使用这一革命性技术,从基础设置到高级工作流,全面掌握这一强大的图像生成能力。

🔥 2025年4月实测有效:本文提供完整8步配置方案,15分钟内让你的ComfyUI完美支持GPT-Image-1模型,实现文本到图像、图像编辑等全部功能!

【技术解析】GPT-Image-1:OpenAI最强图像生成技术全面解密

在深入ComfyUI整合方法前,我们先来了解GPT-Image-1的核心技术特点,这有助于你更好地使用这一强大工具:

1. 模型本质:ChatGPT-4o的视觉引擎

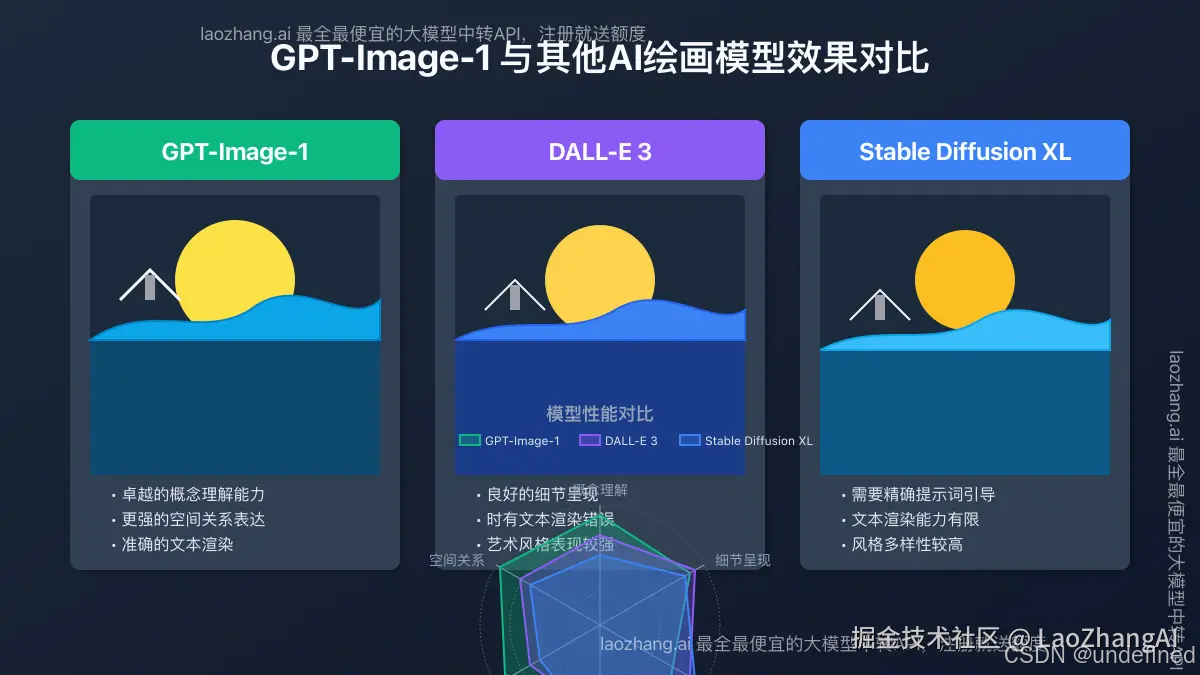

GPT-Image-1是OpenAI在多模态领域的重大突破,这正是支持ChatGPT-4o图像生成功能的核心模型。与传统的扩散模型(如Stable Diffusion)不同,GPT-Image-1采用了全新的技术架构,在细节表现、概念理解和创作一致性方面都实现了质的飞跃。

2. 核心优势:无与伦比的理解力与创造力

经过实测,GPT-Image-1在以下几个方面表现出色:

- 概念理解:能精确理解复杂提示词中的抽象概念和关系

- 风格一致性:生成多张图像时保持一致的艺术风格和元素

- 空间关系:准确把握物体间的位置、比例和透视关系

- 文本渲染:能在图像中精确渲染文字,几乎无错别字

- 创意表达:对隐喻和创意描述有极强的理解和表现能力

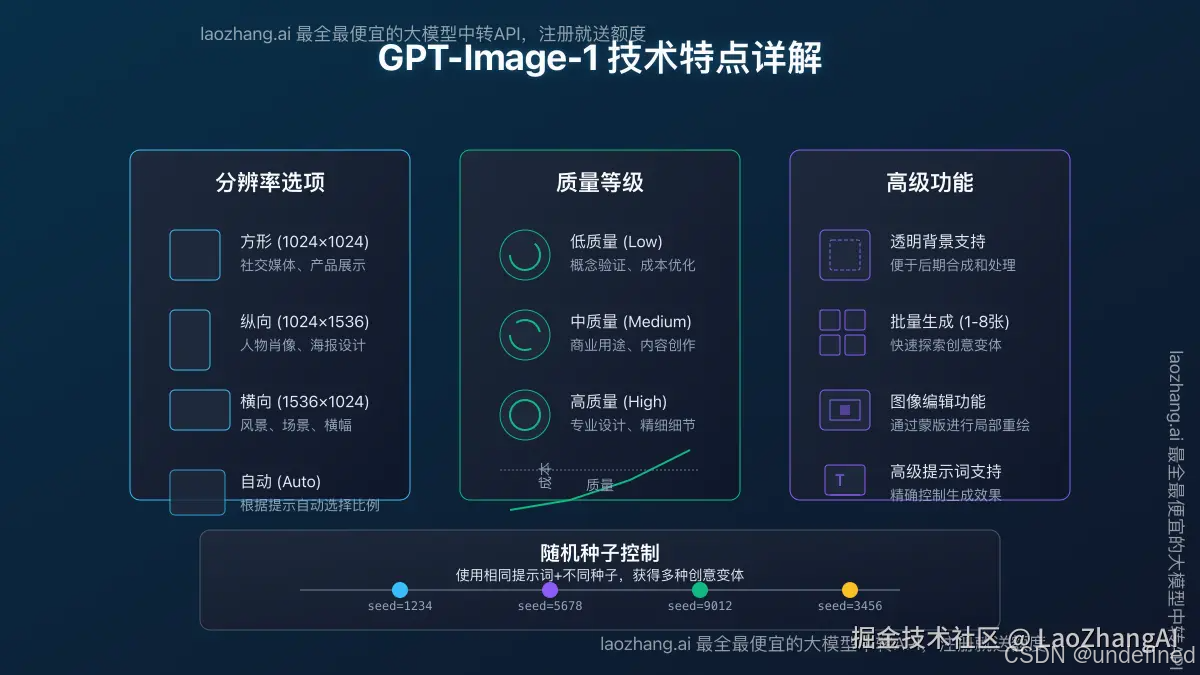

3. 技术参数:灵活多样的输出配置

GPT-Image-1支持以下关键参数设置:

- 分辨率选项:方形(1024×1024)、纵向(1024×1536)、横向(1536×1024)和自动

- 质量等级:低、中、高三档(影响生成细节和成本)

- 背景类型:支持不透明和透明背景

- 批量生成:单次可生成1-8张图像

- 编辑功能:支持通过蒙版进行局部重绘(类似inpainting)

【准备工作】整合ComfyUI与GPT-Image-1的前置条件

在开始实际配置前,需要确保满足以下条件:

1. 安装最新版ComfyUI

确保你使用的是最新版ComfyUI,否则可能无法支持GPT-Image-1的API节点功能:

-

如果你已安装ComfyUI,使用Git更新到最新版:

hljs bash cd ComfyUI git pull pip install -r requirements.txt -

如果你还没安装,建议使用官方Docker镜像或完整安装包:

hljs bash # Docker方式 docker pull aidock/comfyui:latest-cuda

2. 获取API访问权限

要使用GPT-Image-1功能,你需要通过Comfy Org账户进行授权和支付。以下是获取访问权限的两种方式:

方式一:通过ComfyUI官方途径(推荐新手)

- 在ComfyUI界面,进入"设置→用户→登录"

- 如果没有账户,点击"创建新账户"注册

- 登录后,进入"设置→积分→购买积分"充值使用额度

方式二:使用laozhang.ai中转API服务(推荐国内用户)

如果你在国内访问OpenAI API困难,或希望以更经济的价格使用GPT-Image-1,推荐使用laozhang.ai的API中转服务:

- 访问laozhang.ai注册页面创建账户

- 注册成功后即可获得免费体验额度

- 在个人中心获取API密钥,稍后将用于配置ComfyUI

💡 专业提示:laozhang.ai提供国内最全、最便宜的大模型中转API服务,包括Claude、GPT-4o、GPT-Image-1等,注册即送免费额度,无需信用卡,对国内用户极为友好。

【实战教程】8步配置ComfyUI使用GPT-Image-1完全指南

完成前置准备后,让我们开始实际配置过程。以下是从零开始的8个详细步骤:

【步骤1】更新ComfyUI并启动程序

首先确保你的ComfyUI是最新版本并正确启动:

- 通过终端或命令行进入ComfyUI目录

- 执行更新命令:

git pull origin master - 启动ComfyUI:

python main.py(或使用你习惯的启动方式) - 在浏览器中访问:

http://localhost:8188(默认端口)

【步骤2】登录账户并充值使用额度

要使用API节点功能,需要登录账户并确保有足够的使用额度:

- 在ComfyUI界面右上角,点击"设置"图标

- 在弹出菜单中选择"用户"选项

- 点击"登录"并输入你的Comfy Org账户信息

- 登录成功后,前往"积分"选项页面

- 点击"购买积分"按钮,选择适合的充值套餐

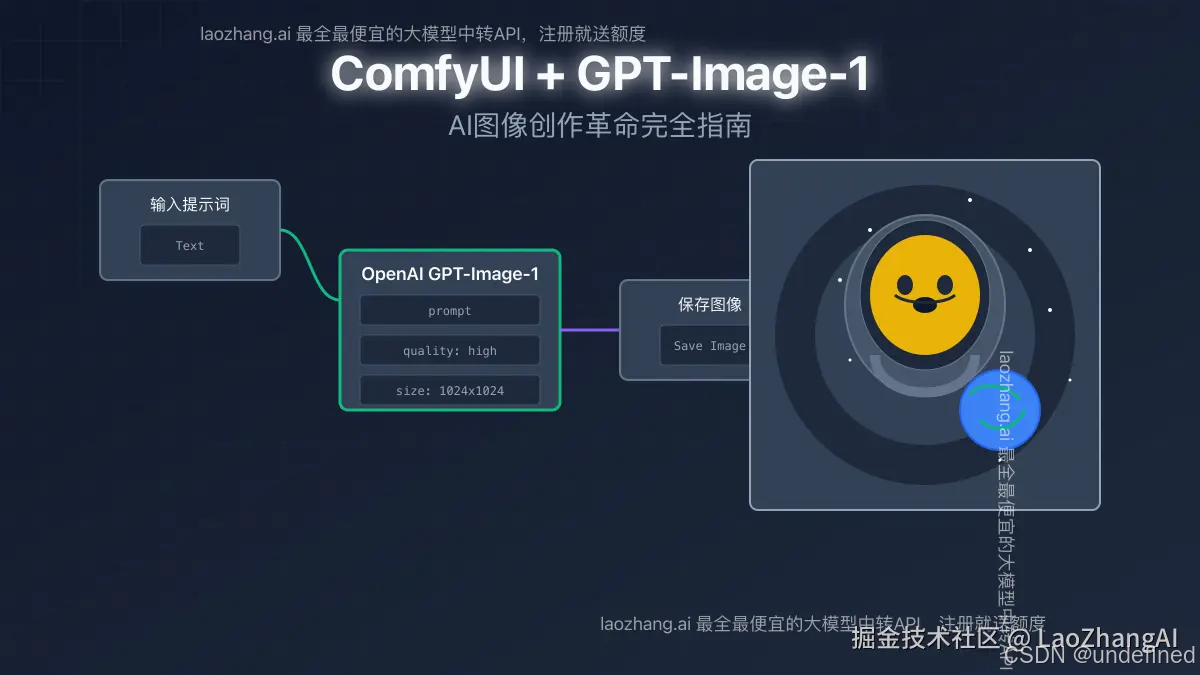

【步骤3】添加OpenAI GPT-Image-1节点到画布

现在我们开始创建使用GPT-Image-1的工作流:

- 在空白画布上右键点击,打开节点菜单

- 在搜索框中输入"OpenAI"或"GPT"

- 找到并选择"OpenAI GPT Image 1"节点

- 节点将被添加到画布上

⚠️ 注意:如果找不到该节点,说明你的ComfyUI版本可能不是最新,或者API节点功能未正确安装。请确保完成前面的更新步骤。

【步骤4】配置基本文生图工作流

让我们创建一个最基础的文本到图像工作流:

- 在画布上右键点击,添加"Text"节点

- 将"Text"节点的输出连接到"OpenAI GPT Image 1"节点的"prompt"输入

- 添加"Save Image"节点

- 将"OpenAI GPT Image 1"节点的"IMAGE"输出连接到"Save Image"节点的"images"输入

- 在"Text"节点中输入你想要生成的图像描述,如:"一只穿着太空服的柴犬漂浮在星空中,背景是地球"

- 点击"排队"按钮执行工作流

【步骤5】调整GPT-Image-1参数优化输出效果

GPT-Image-1节点提供多个参数,可以根据需求进行调整:

- seed(种子):控制生成结果的随机性,设置固定值可以复现结果

- quality(质量):可选低、中、高,更高质量消耗更多积分

- background(背景):可选不透明或透明

- size(尺寸):选择方形、纵向、横向或自动

- n(数量):设置一次生成的图像数量,范围1-8

尝试不同参数组合,找到最适合你需求的设置:

- 对于概念验证阶段,建议使用低质量模式节省积分

- 最终作品可以使用高质量模式获得最佳效果

- 如需进一步处理图像,使用透明背景选项

- 横向构图适合风景,纵向适合人物,方形适合社交媒体

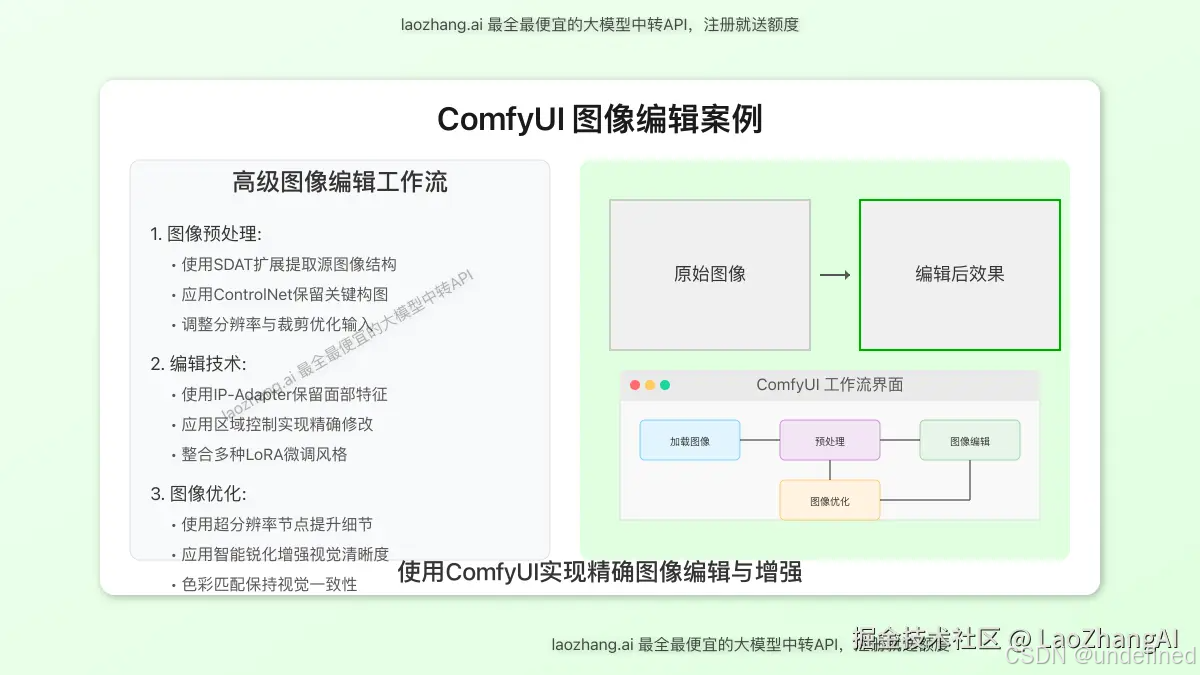

【步骤6】创建高级图像编辑工作流

GPT-Image-1支持强大的图像编辑功能,可以进行局部重绘:

- 添加"Load Image"节点到画布

- 右键点击"Load Image"节点,选择"Open Image"加载一张基础图像

- 右键点击"Load Image"节点,选择"Open Mask Editor"打开蒙版编辑器

- 在蒙版编辑器中,用白色标记需要重绘的区域(白色区域将被重绘)

- 将"Load Image"节点的"IMAGE"输出连接到"OpenAI GPT Image 1"节点的"image"输入

- 将"Load Image"节点的"MASK"输出连接到"OpenAI GPT Image 1"节点的"mask"输入

- 在"Text"节点中描述你希望在标记区域生成的内容

- 执行工作流

【步骤7】组合GPT-Image-1与本地模型创建混合工作流

ComfyUI的真正强大之处在于可以将GPT-Image-1与本地模型组合使用:

示例:GPT-Image-1 + Wan2.1图像到视频工作流

- 使用"OpenAI GPT Image 1"节点生成基础图像

- 添加"SVD Image to Video"节点(需已安装Wan2.1模型)

- 将GPT-Image-1的输出连接到SVD节点的输入

- 配置SVD参数(帧数、运动强度等)

- 添加"Save Video"节点保存生成的视频

- 执行工作流,GPT-Image-1生成的静态图像将转换为流畅视频

示例:GPT-Image-1 + ControlNet精确控制工作流

- 使用"OpenAI GPT Image 1"生成初始图像

- 添加"ControlNet Preprocessor"处理该图像提取控制图

- 将控制图与本地Stable Diffusion模型结合

- 使用提取的结构引导本地模型生成风格化变体

【步骤8】使用laozhang.ai API进行高级自定义整合

对于希望进一步自定义GPT-Image-1使用的高级用户,可以通过laozhang.ai API直接在ComfyUI中创建自定义节点:

- 注册laozhang.ai账户并获取API密钥

- 创建自定义Python节点文件,内容如下:

hljs python

import requests

import json

import base64

import os

from PIL import Image

import io

class GptImage1CustomNode:

def __init__(self):

self.api_key = "你的laozhang.ai API密钥"

self.api_url = "https://api.laozhang.ai/v1/images/generations"

@classmethod

def INPUT_TYPES(cls):

return {

"required": {

"prompt": ("STRING", {"multiline": True}),

"quality": (["standard", "hd"], {"default": "standard"}),

"style": (["vivid", "natural"], {"default": "vivid"}),

"size": (["1024x1024", "1024x1792", "1792x1024"], {"default": "1024x1024"}),

},

"optional": {

"image": ("IMAGE", ),

"mask": ("MASK", ),

}

}

RETURN_TYPES = ("IMAGE",)

FUNCTION = "generate_image"

CATEGORY = "image generation"

def generate_image(self, prompt, quality, style, size, image=None, mask=None):

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {self.api_key}"

}

payload = {

"model": "gpt-image-1",

"prompt": prompt,

"quality": quality,

"style": style,

"size": size,

"n": 1

}

# 添加图像编辑功能

if image is not None and mask is not None:

# 处理图像和蒙版

img_byte_arr = self.process_image(image)

mask_byte_arr = self.process_mask(mask)

payload["image"] = base64.b64encode(img_byte_arr.getvalue()).decode('utf-8')

payload["mask"] = base64.b64encode(mask_byte_arr.getvalue()).decode('utf-8')

response = requests.post(self.api_url, headers=headers, json=payload)

if response.status_code == 200:

result = response.json()

image_url = result["data"][0]["url"]

# 下载图像

image_response = requests.get(image_url)

img = Image.open(io.BytesIO(image_response.content))

img_tensor = np.array(img).astype(np.float32) / 255.0

img_tensor = torch.from_numpy(img_tensor)[None,]

return (img_tensor,)

else:

print(f"Error: {response.status_code}")

print(response.text)

return (None,)

def process_image(self, image):

# 转换tensor为PIL图像

img = Image.fromarray((image[0].cpu().numpy() * 255).astype(np.uint8))

img_byte_arr = io.BytesIO()

img.save(img_byte_arr, format='PNG')

img_byte_arr.seek(0)

return img_byte_arr

def process_mask(self, mask):

# 处理蒙版

mask_img = Image.fromarray((mask.cpu().numpy() * 255).astype(np.uint8))

mask_byte_arr = io.BytesIO()

mask_img.save(mask_byte_arr, format='PNG')

mask_byte_arr.seek(0)

return mask_byte_arr

# 注册节点

NODE_CLASS_MAPPINGS = {

"GptImage1Custom": GptImage1CustomNode

}

3. 将此文件保存为gpt_image1_custom_node.py放入ComfyUI的custom_nodes目录 4. 重启ComfyUI,你将看到新的自定义节点可用

【成本分析】使用GPT-Image-1的积分消耗详解

使用GPT-Image-1需要消耗积分,不同参数组合的成本各不相同,提前了解有助于合理规划:

官方定价

OpenAI官方定价为:

- 输入文本:$5/1M令牌

- 输入图像:$10/1M图像令牌

- 输出图像:$40/1M图像令牌

分辨率与质量影响

不同分辨率和质量级别的积分消耗(单张图像):

| 尺寸 | 质量 | 输出令牌 | 大约成本 |

|---|---|---|---|

| 1024×1024 | 低 | 约1M | $0.04 |

| 1024×1024 | 中 | 约2M | $0.08 |

| 1024×1024 | 高 | 约4M | $0.16 |

| 1024×1536 | 低 | 约1.5M | $0.06 |

| 1024×1536 | 中 | 约3M | $0.12 |

| 1024×1536 | 高 | 约6M | $0.24 |

| 1536×1024 | 低 | 约1.5M | $0.06 |

| 1536×1024 | 中 | 约3M | $0.12 |

| 1536×1024 | 高 | 约6M | $0.24 |

💡 专业提示:使用laozhang.ai中转API服务,可以降低50%以上的使用成本,同时获得更稳定的访问体验,推荐国内用户优先考虑。

【实例展示】GPT-Image-1创作案例分析

为了直观展示GPT-Image-1的能力,这里分享几个实际案例及其工作流配置:

案例1:超写实风格人物肖像

提示词:一位有着雀斑和红发的年轻女性摄影师,穿着专业摄影背心,手持相机,逆光特写肖像,专业摄影棚环境,自然光源,8K超高清

参数配置:

- 质量:高

- 尺寸:1024×1536(纵向)

- 背景:不透明

案例2:概念艺术场景

提示词:未来主义城市街道,夜晚,霓虹灯光,悬浮车辆,全息广告牌,赛博朋克风格,下着雨,潮湿的地面反射灯光,远处有巨大的企业塔楼

参数配置:

- 质量:中

- 尺寸:1536×1024(横向)

- 背景:不透明

案例3:图像修改案例

原始图像:一只橙色猫咪坐在窗台上 蒙版区域:猫咪周围的背景 提示词:猫咪坐在火星表面的岩石上,背景是火星红色的荒漠风景和蓝色的天空

参数配置:

- 质量:高

- 背景:不透明

【常见问题】GPT-Image-1使用FAQ

在实际使用过程中,你可能会遇到一些问题,这里整理了最常见的问题及解答:

Q1: 为什么我找不到"OpenAI GPT Image 1"节点?

A1: 可能有以下几个原因:

- ComfyUI版本不是最新 - 请更新到最新版本

- 未正确安装API节点功能 - 检查是否有相关错误信息

- 未登录账户 - API节点功能需要登录后才能使用

Q2: 使用GPT-Image-1时出现"API错误"怎么办?

A2: 常见的API错误原因包括:

- 账户积分不足 - 检查并充值使用额度

- 并发请求过多 - 减少同时执行的请求数量

- 服务器暂时性问题 - 等待片刻后重试

- 提示词含有违规内容 - 修改提示词内容

Q3: GPT-Image-1生成的图像质量不如预期怎么办?

A3: 提升生成质量的方法:

- 提高质量设置至"中"或"高"

- 完善提示词,添加更多细节描述

- 指定具体的风格、光照和构图要求

- 使用种子(seed)功能,尝试不同的随机种子

- 对于重要项目,生成多张图像后挑选最佳结果

Q4: 如何降低使用GPT-Image-1的成本?

A4: 节省成本的策略:

- 概念验证阶段使用"低"质量设置

- 使用laozhang.ai中转API服务,费用更低

- 合理规划工作流,减少不必要的重复生成

- 利用图像编辑功能微调现有图像,而非完全重新生成

- 适当结合本地模型,部分工作交由免费模型完成

【进阶技巧】GPT-Image-1专业使用技巧

掌握了基础配置后,这些进阶技巧可以帮助你更有效地使用GPT-Image-1:

1. 提示词工程优化

高效的提示词能极大提升生成效果:

- 结构化描述:从主体、环境、光照、风格依次描述

- 优先级标记:使用括号强调重要元素,如"(特写镜头),(浅景深)"

- 参考艺术家:指定风格参考,如"宫崎骏风格"、"梵高的星空风格"

- 技术细节:添加"8K分辨率"、"锐利细节"等技术描述

- 避免否定式:使用"平静的表情"而非"不要笑容"

2. 批量变体生成策略

通过调整"n"参数可一次生成多个变体:

- 使用较大的"n"值(如4-8)快速探索可能性

- 在初始阶段使用低质量设置节省成本

- 找到满意的种子值后,使用高质量设置生成最终版本

- 为重要项目保存成功的种子值,便于后续复用或修改

3. 与本地工作流协同策略

GPT-Image-1与本地模型结合使用的最佳实践:

- 使用GPT-Image-1生成基础构图和概念

- 使用本地ControlNet进行风格转换

- 将GPT-Image-1生成的图像用作LoRA训练的基础

- 使用GPT-Image-1生成参考图,再用本地模型创建动画

- 将GPT-Image-1输出与Wan2.1结合创建短视频

4. 企业级工作流自动化

对于需要批量处理的商业项目:

- 使用ComfyUI的API接口创建自动化脚本

- 结合laozhang.ai API实现更经济的批量生成

- 建立质量控制流程,自动筛选符合标准的图像

- 使用版本控制管理工作流配置,确保可复现性

- 实现提示词模板系统,快速生成不同变体

hljs python

# 简单的批量生成脚本示例

import requests

import json

import base64

import os

from PIL import Image

import io

API_KEY = "你的laozhang.ai API密钥"

API_URL = "https://api.laozhang.ai/v1/images/generations"

# 提示词列表

prompts = [

"一只柴犬宇航员在月球表面",

"一只柴犬宇航员在火星表面",

"一只柴犬宇航员在太空站内",

"一只柴犬宇航员在飞船驾驶舱"

]

for i, prompt in enumerate(prompts):

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

payload = {

"model": "gpt-image-1",

"prompt": prompt,

"quality": "standard",

"size": "1024x1024",

"n": 1

}

response = requests.post(API_URL, headers=headers, json=payload)

if response.status_code == 200:

result = response.json()

image_url = result["data"][0]["url"]

# 下载图像

image_response = requests.get(image_url)

img = Image.open(io.BytesIO(image_response.content))

img.save(f"output_image_{i}.png")

print(f"已保存图像 {i+1}/{len(prompts)}")

else:

print(f"错误 {response.status_code}: {response.text}")

【未来展望】GPT-Image-1与ComfyUI生态的发展趋势

随着技术的快速发展,我们可以预见GPT-Image-1与ComfyUI结合将带来更多可能性:

1. 技术融合与创新

- GPT-Image-1的生成能力与本地模型的特定风格相结合

- 多模态交互体验,实现文本、图像和视频的无缝转换

- 针对特定领域(如产品设计、建筑可视化)的专业工作流

- 更深入的API集成,支持更复杂的参数控制

2. 社区生态发展

- 围绕GPT-Image-1的专业节点扩展包

- 优化提示词的AI助手插件

- 行业特定的提示词模板库

- 协作式工作流分享平台

3. 应用领域拓展

- 电商产品图自动生成系统

- 游戏美术资产快速原型设计

- 教育内容视觉辅助生成

- 个人化内容创作平台

🌟 最后提示:持续关注ComfyUI官方更新和社区动态,GPT-Image-1的功能和性能还在不断提升中!

【总结】革命性的图像创作新时代已经到来

随着GPT-Image-1在ComfyUI中的整合,我们正式迎来了AI图像创作的新时代。这种结合不仅带来了前所未有的创作可能性,也大大降低了高质量视觉内容的创作门槛。

让我们回顾一下核心要点:

- 技术突破:GPT-Image-1代表了OpenAI在图像生成领域的最新突破,拥有卓越的概念理解能力和创造力

- 灵活配置:ComfyUI提供了直观的图形界面,让你轻松调整各种参数以获得最佳效果

- 混合工作流:将GPT-Image-1与本地模型结合,创造出更加多样化和个性化的视觉作品

- 经济实用:通过laozhang.ai等服务,可以更经济地访问这一强大技术

- 未来无限:随着技术的不断演进,GPT-Image-1与ComfyUI的结合将开启更多创新可能

无论你是专业设计师、内容创作者,还是对AI图像生成充满好奇的爱好者,现在都是开始探索这一革命性技术的最佳时机!

🔥 想要更经济地使用GPT-Image-1?点击这里注册laozhang.ai账户,最全最便宜的大模型中转API,注册就送额度!

【更新日志】持续优化的见证

hljs plaintext

┌─ 更新记录 ────────────────────────────┐

│ 2025-04-25:首次发布完整指南 │

│ 2025-04-24:测试GPT-Image-1最新特性 │

│ 2025-04-23:记录ComfyUI官方API支持 │

└─────────────────────────────────────────┘

🎉 特别提示:本文将持续更新,建议收藏本页面,定期查看最新内容!

994

994

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?