这两天是英伟达年度大会。

皮衣黄用了两小时抛出了一连串产品,从算力怪兽芯片到开源机器人模型,从液冷革命到量子计算,每一招都在改写AI行业的游戏规则。

看得出来,英伟达不仅仅要做芯片巨头,还要做AI全栈生态的基础设施,让所有AI算力、算法、应用都跑在自家的架构上。

而且,英伟达横向扩展的能力越来越强,连量子计算都已经准备好了。

当然,都知道发布会产品到实践还有一段距离。我们先看看英伟达发布了什么,再说这种发布是否具有实践性,是否引起同行学习。

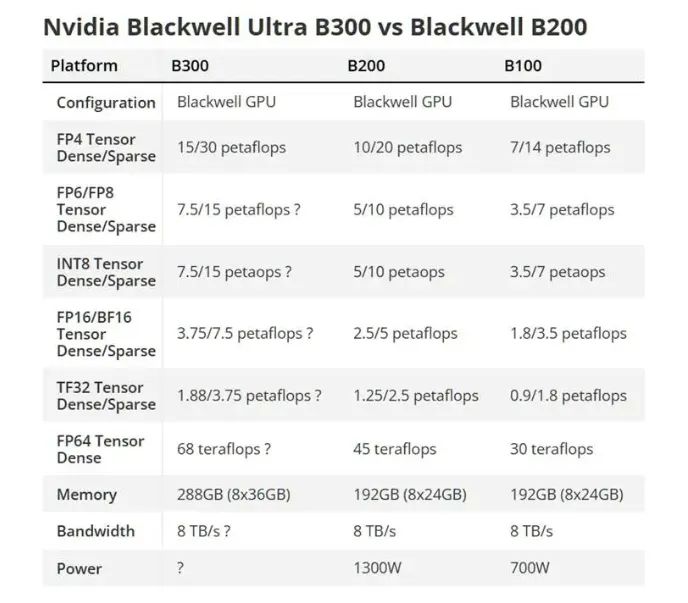

Blackwell Ultra B300:性能飙升50%、全液冷

照例是算力芯片升级,这次重点是Blackwell Ultra架构芯片B300 GPU。

采用台积电4NP工艺,HBM3e内存容量提升至288GB(较B200提升50%),FP4算力达11.5 ExaFLOPS,推理速度较Hopper架构提升40倍,支持1,000 tokens/秒的模型推理。

也就是说,运行DeepSeek R1-671B模型时,其吞吐量达到1000 tokens/秒,将Hopper架构的100 tokens/秒碾压式甩开,复杂问题响应时间从1.5分钟压缩至10秒。

按照老黄过去反复表达的意思,DeepSeek这么强,更离不开算力作为支撑。如果算力更强大,DeepSeek也会更优秀。

这次发布会,算力直接飙升50%,算是一个小小的回应。

更值得玩味的是,英伟达刻意将对比锚点设为上一代Hopper而非B200,被外界解读为“照顾大客户情绪”的公关策略——毕竟微软刚砸重金采购B200,AWS、Meta却已转向等待B300。

同样,还透露一个信息:液冷的时代真的来了。1.4kW的单芯片功耗逼出了散热设计的终极形态——独立冷板液冷系统。每个GPU配备独立进出水口的设计,直接宣判了传统风冷数据中心的“死刑”。

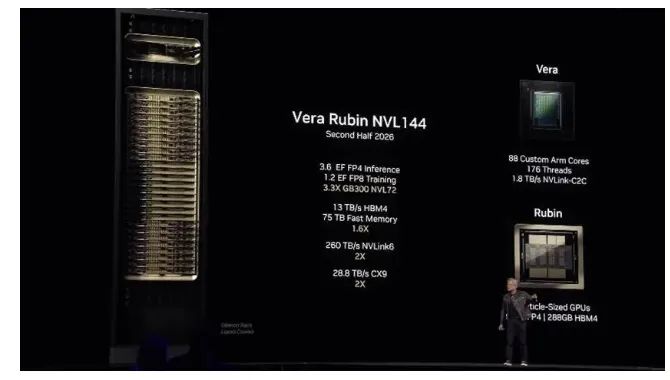

Vera Rubin架构:面向2026 年Blackwell Ultra是当下王者, Vera Rubin架构就是英伟达为“超大规模模型”埋下的未来杀招。

这套以女天文学家命名的平台,首次祭出四Die封装GPU,单颗芯片堆叠288GB HBM4e内存,带宽冲上13TB/s,FP8训练算力1.2 ExaFLOPS——足足是Blackwell Ultra的3.3倍。

而配套的Vera CPU更是英伟达自研ARM架构的“叛变之作”,88核176线程设计直接将Grace CPU的性能翻倍,内存带宽提升2.4倍。

黄仁勋在现场调侃Blackwell命名失误的“小八卦”,实则暗藏技术玄机:Blackwell的NVLink拓扑因双Die设计被迫更名,而Rubin的NVL576架构直接将GPU互联数推至576个,总带宽突破1.5PB/s,足以支撑未来十万亿参数模型的训练。

这种“暴力堆料”背后,是英伟达对AI算力需求每年翻10倍的预判——到2027年,单机架算力将突破15 ExaFLOPS,相当于3000台Hopper机柜的合力。

DGX Spark/Station:人人用得起 “超算”这次想不到的是,“个人AI计算机”DGX Spark仅售3000美元(2万人民币),价格比当前的AI一体机便宜太多了。

这台巴掌大的设备,能塞进128GB统一内存和4TB NVMe SSD,以1 ExaFLOPS算力运行2000亿参数模型——要知道,五年前同等性能需要占据整个机房。

而其大哥DGX Station更是疯狂,784GB系统内存+20 ExaFLOPS算力的配置,直接将科研级AI训练从云端拉回本地桌面。

这两款产品的颠覆性在于算力民主化。过去动辄百万美元的超算门槛,被压缩到中小企业可承受的范围。华硕、戴尔等合作伙伴的入局,更预示着一场“桌面超算”的普及风暴——未来每个创客工作室都可能使用AI能力。

这下,谁会更慌了?

Dynamo:AI工厂的“涡轮增压器”“这不是操作系统,这是AI时代的蒸汽机!”黄仁勋如此定义开源框架Dynamo。

这个被称作“AI工厂操作系统”的怪物,用分离式推理服务技术,将大模型的“思考”与“生成”阶段拆分到不同GPU,硬生生把单卡token生成量拉升30倍。

与Perplexity的合作案例显示,DeepSeek-R1模型在Dynamo调度下,GPU资源利用率暴涨40倍——相当于用同样的电费,多赚30倍“推理生产力”。

Dynamo的野心远不止于技术优化。其开源属性和对KV缓存、并行计算的智能编排,本质上是在构建推理时代的生态标准。

当开发者无需再为底层架构焦头烂额,整个AI应用层的创新速度或将迎来核爆式增长。

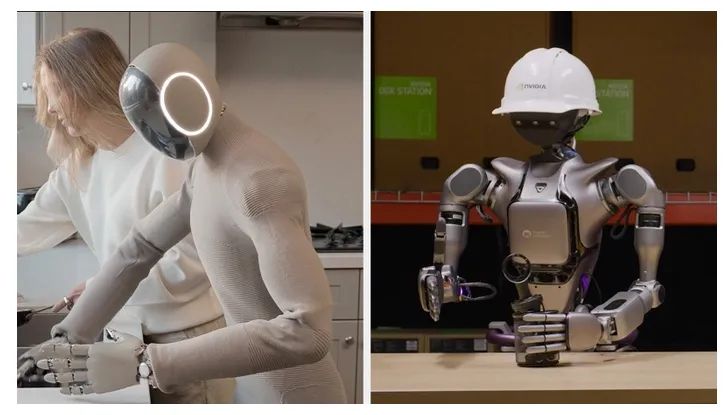

Isaac GR00T N1:机器人的“双脑革命”压轴登场的Isaac GR00T N1,可能是整场发布会最具科幻感的突破。

这款全球首个开源人形机器人基础模型,采用双系统认知架构:“系统1”如同条件反射般操控关节运动,“系统2”则像人类大脑般规划复杂任务。

现场演示中,搭载该模型的机器人Blue仅用10分钟训练数据,就完成了跨环境物体抓取和多步骤协作。

更狠的是英伟达的生态打法——联手谷歌DeepMind和迪士尼推出Newton物理引擎,将触觉反馈和软体模拟精度提升至新维度。迪士尼已计划用它打造下一代机器人角色,而通用汽车则借此加速自动驾驶研发。

这种“开源模型+行业巨头”的组合拳,很可能让人形机器人赛道提前三年进入量产竞赛。

结语:一场重构产业链的算力

从B300的液冷狂飙到Rubin的四Die封装,从桌面超算的普惠革命到机器人OS的开源突袭,英伟达GTC 2025的本质是一场算力供给侧的暴力改造。

当黄仁勋说出“未来每家公司都需要两个工厂——一个造产品,一个造AI”时,产业链的震动已然开始:液冷厂商英维克、光模块龙头中际旭创、机器人关节模组企业绿的谐波……这些藏在财报背后的名字,正在成为新算力时代的“军火商”。

而更深刻的变革在于生态话语权——通过Dynamo开源、GR00T模型和QODA量子算法库,英伟达正在将CUDA帝国的护城河,挖向每一个AI应用场景的毛细血管。

这场发布会或许会被历史标记为:传统云计算时代的终章,开启推理霸权时代的开篇。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?