1、环境介绍

操作系统:centos 7.9

elasticsearch版本:7.13.3

IK分词版本:elasticsearch-analysis-ik-7.13.3

IK分词下载地址:

https://github.com/medcl/elasticsearch-analysis-ik/releases

注意:下载分词要和elasticsearch版本对应

2、配置自定义字典

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 -->

<entry key="ext_dict">mydic.dic</entry>

<!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords"></entry>

<!--用户可以在这里配置远程扩展字典 -->

<!-- <entry key="remote_ext_dict">words_location</entry> -->

<!--用户可以在这里配置远程扩展停止词字典-->

<!-- <entry key="remote_ext_stopwords">words_location</entry> -->

</properties>

elasticsearch/plugins/ik/config目录下创建mydic.dic

并在其中添加:

欧贝里斯克的巨神兵

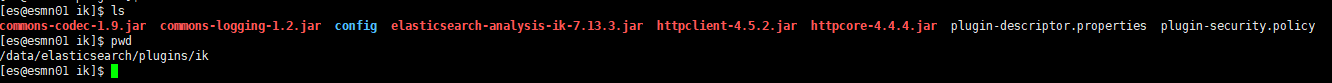

3、将软件包解压上传到服务器的/data/elasticsearch/plugins/ik(所有es节点)

注意:ik目录自己建立

4、重启es集群

杀死进程,执行启动

/data/elasticsearch/bin/elasticsearch -d

5、使用kibana测试

http://kibana01.wtown.com:5601/

标准分词

GET _analyze

{

"analyzer":"standard" ,

"text":"中国人"

}

ik分词器-细粒度

GET _analyze

{

"analyzer":"ik_max_word" ,

"text":"中国人"

}

ik分词器-粗粒度

GET _analyze

{

"analyzer":"ik_smart" ,

"text":"中国人"

}

ik分词器-自定义词典

250

250

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?