【阅读时间】

13min - 19min

【内容简介】

详解解读什么是支持向量机,如何解支持向量以及涉及的拉普拉斯乘子法,还有核方法的解读。

支持向量机-SVM(Support Vector Machine)从本质来说是一种:用一条线(方程)分类两种事物。

有了直观的感知,在定义这一节在做一些深入的思考,分解名词(Support Vector Machine)并尝试解释:

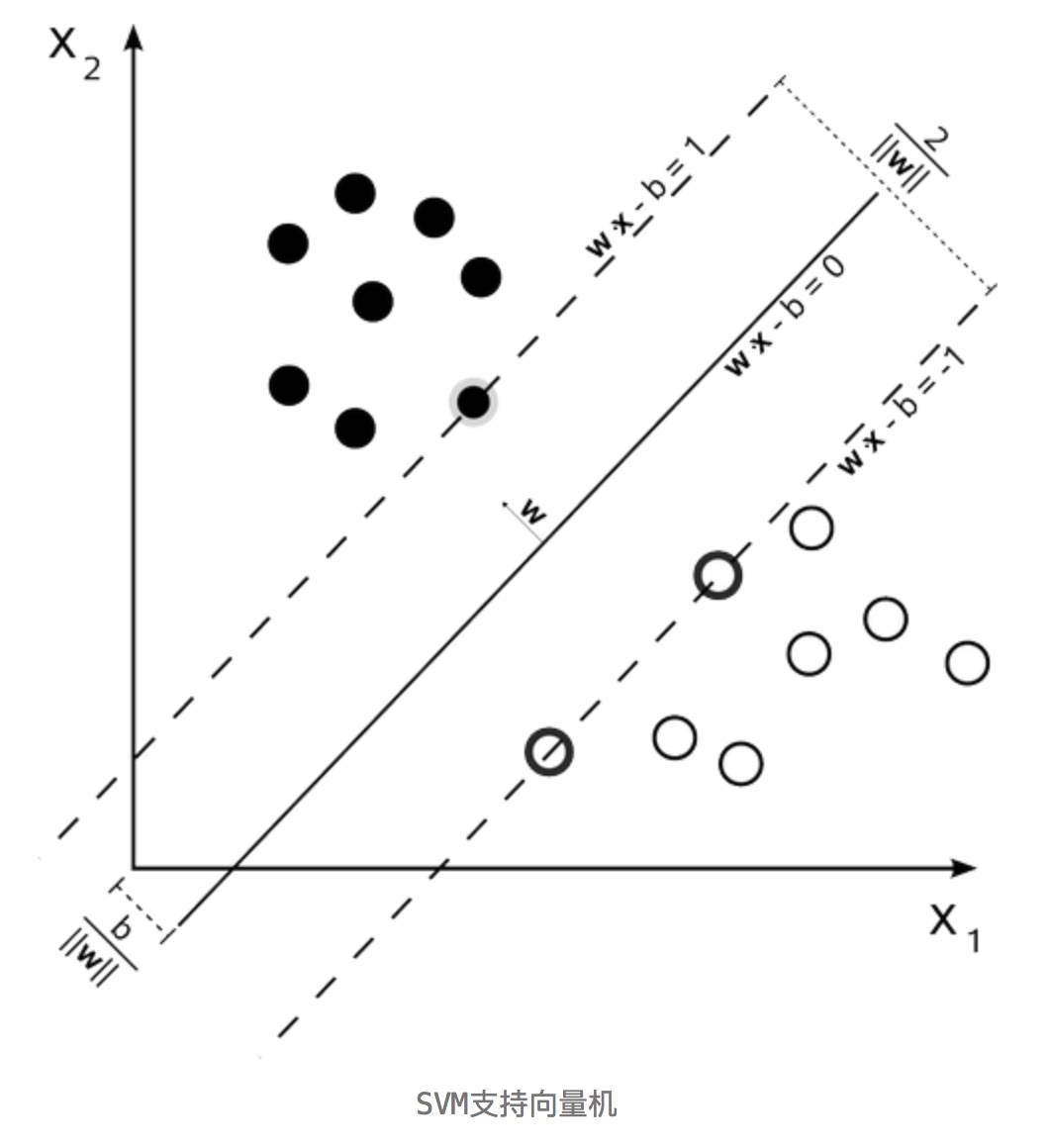

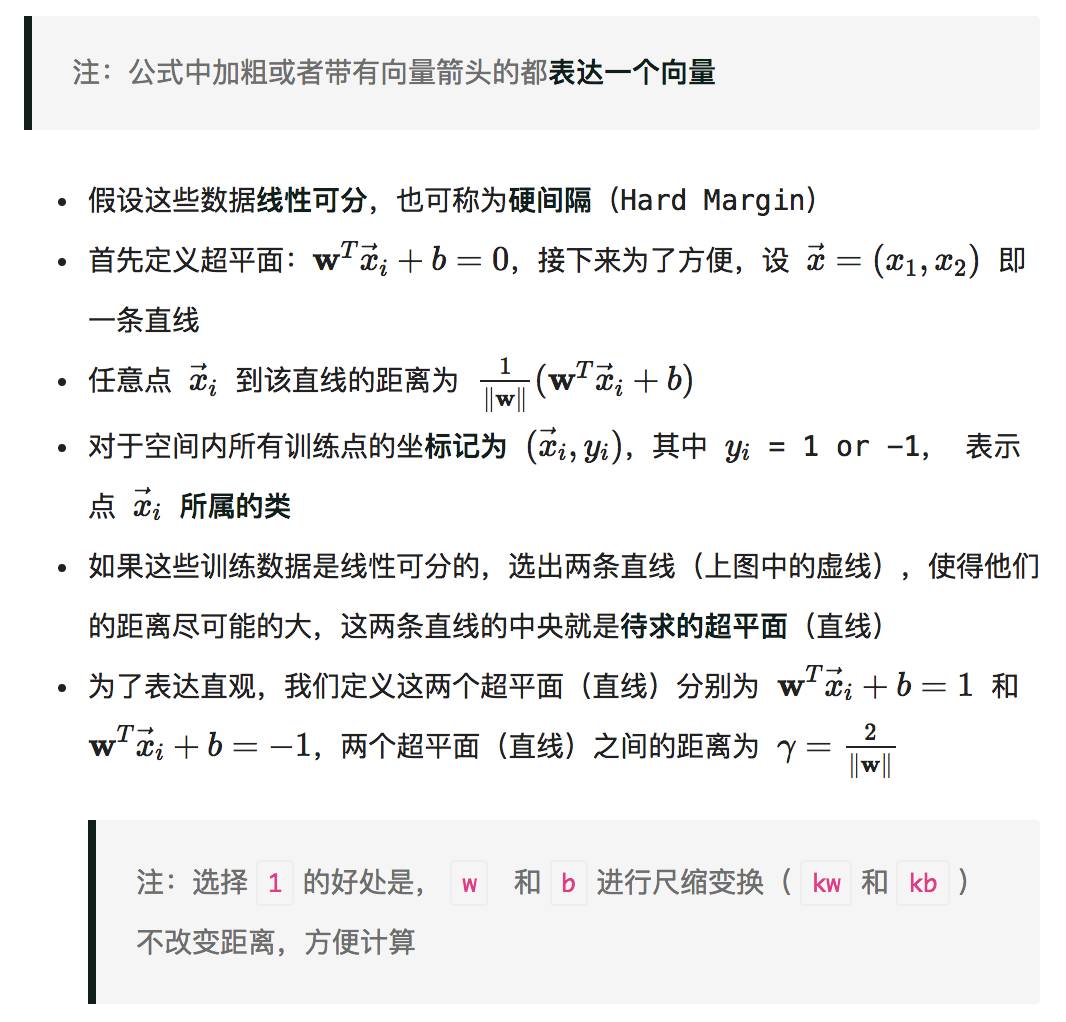

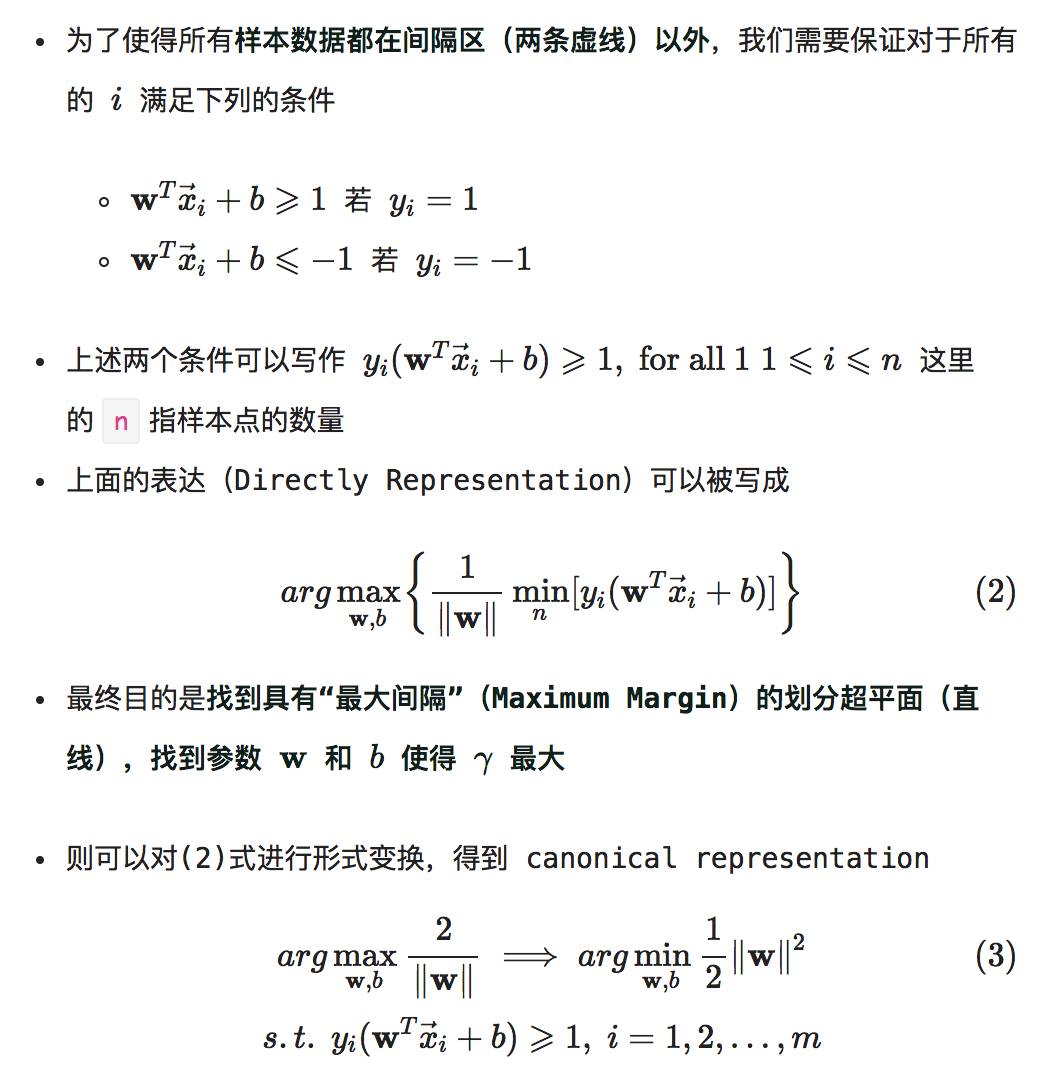

对于我们需要求解的这个超平面(直线)来说,我们知道

它离两边一样远(待分类的两个部分的样本点)

最近的距离就是到支持向量中的点的距离

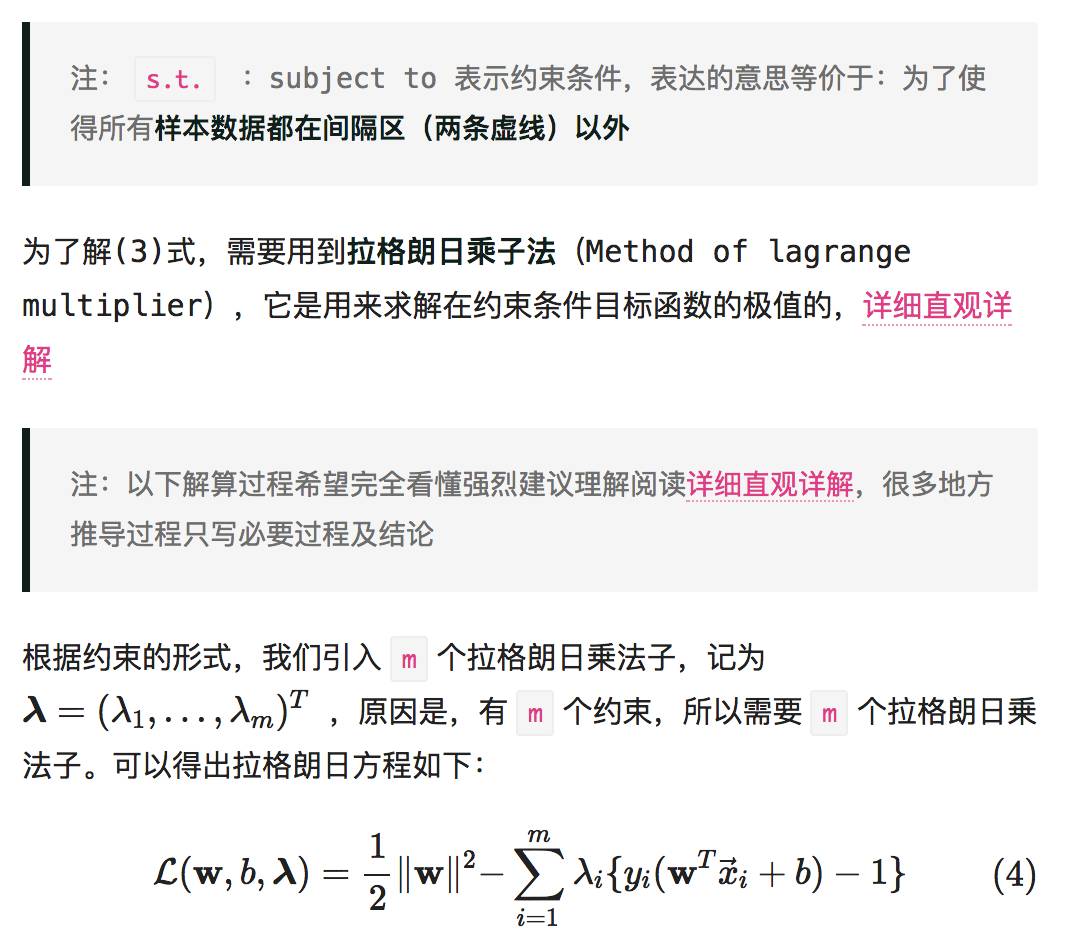

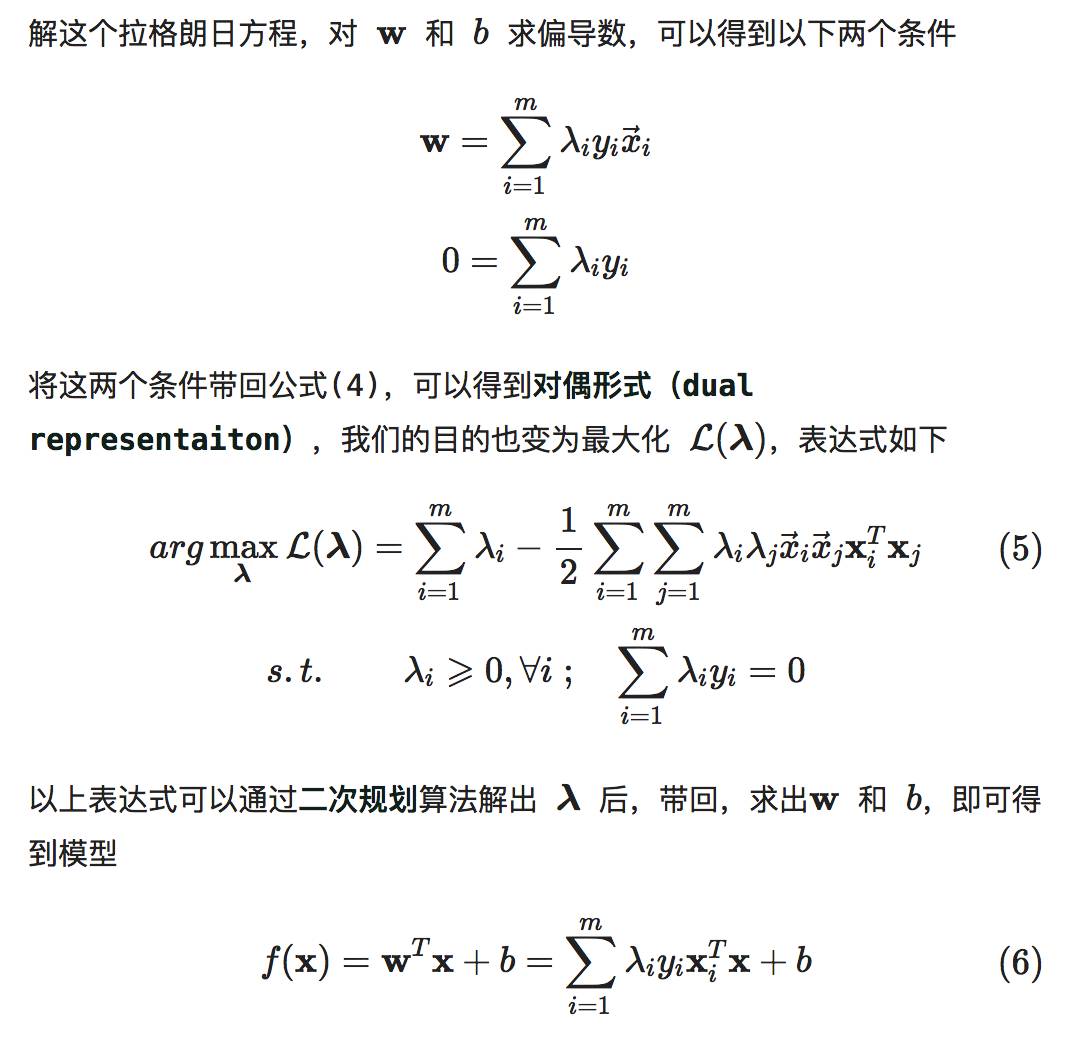

根据这两点,抽象SVM的直接表达(Directly Representation)

其实这个公式是一点也不抽象,需要更进一步的用符号来表达。

我们知道在准确描述世界运行的规律这件事上,数学比文字要准确并且无歧义的多,文字(例子)直观啰嗦,数学(公式)准确简介

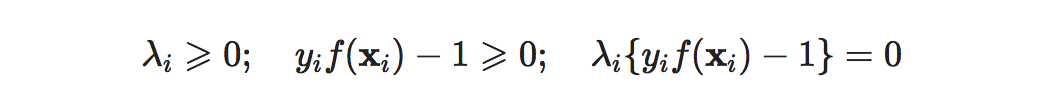

补充一些关于二次规划算法的相关,(3)式的约束是一个不等式约束,所以我们可以使用KKT条件得到三个条件:

使用这些条件,可以构建高效算法来解这个方程,比如SMO(Sequential Minimal Optimization)就是其中一个比较著名的。至于SMO是如何做的,考虑到现代很多SVM的Pakage都是直接拿来用,秉承着前人付出了努力造了轮子就不重复造的核心精神,直接调用就好

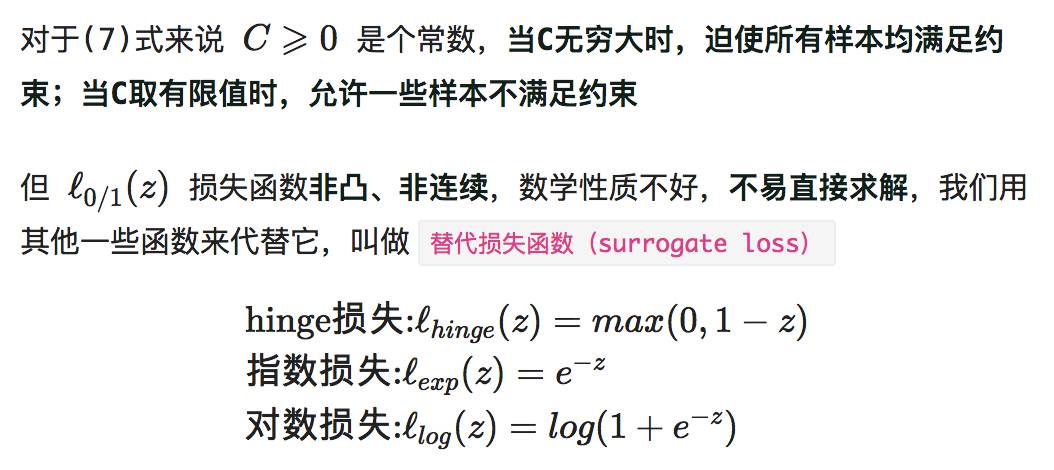

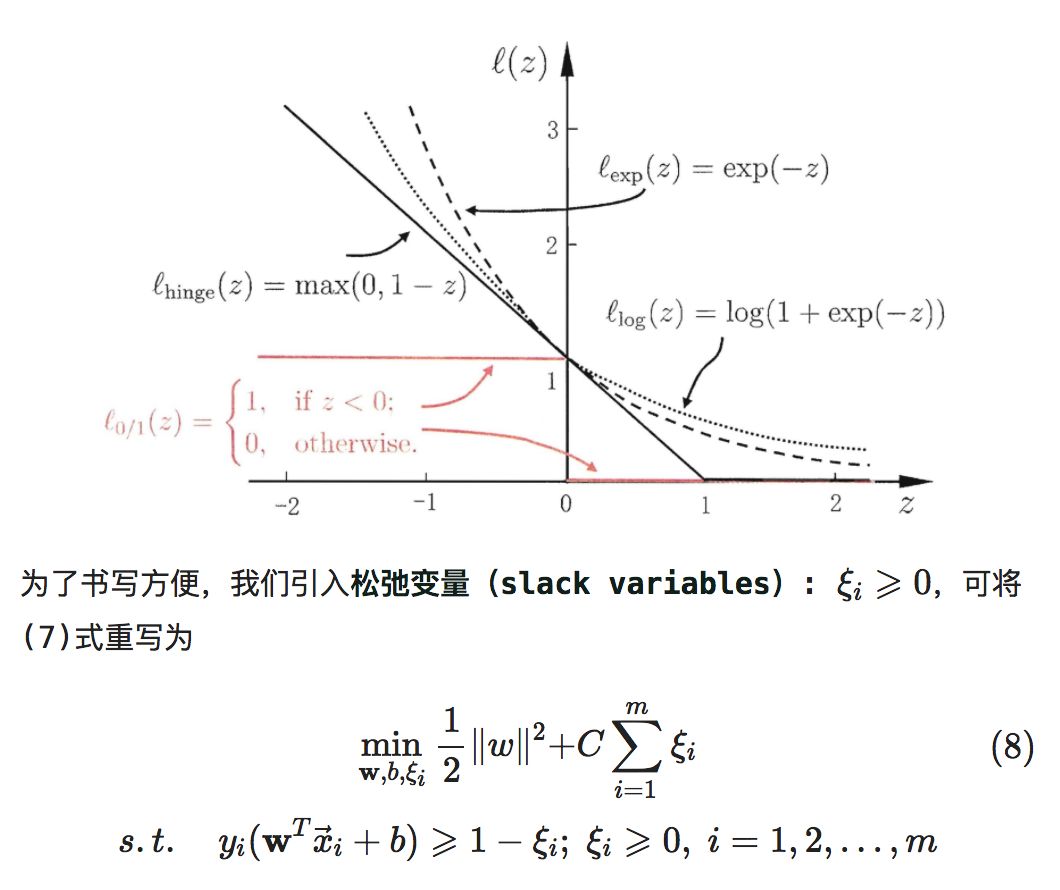

已经说明了如何求得方程,以上的推导形式都是建立在样本数据线性可分的基础上,如果样本数据你中有我我中有你(线性不可分),应该如何处理呢?这里就需要引入软间隔(Soft Margin),意味着,允许支持向量机在一定程度上出错

三种常见损失函数如下图

(8)式就是常见的软间隔支持向量机,其中,每一个样本都有一个对应的松弛变量,用以表征该样本不满足约束的程度,求解的方法同理硬间隔支持向量机

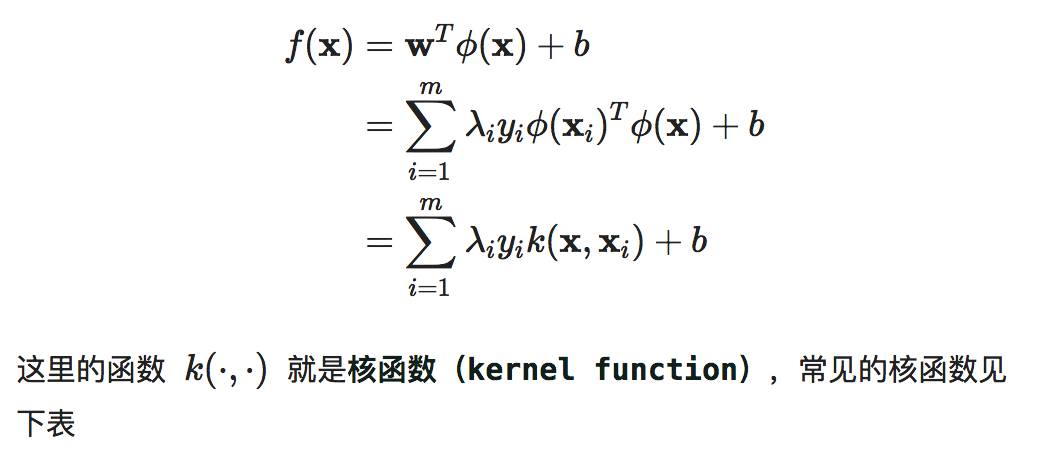

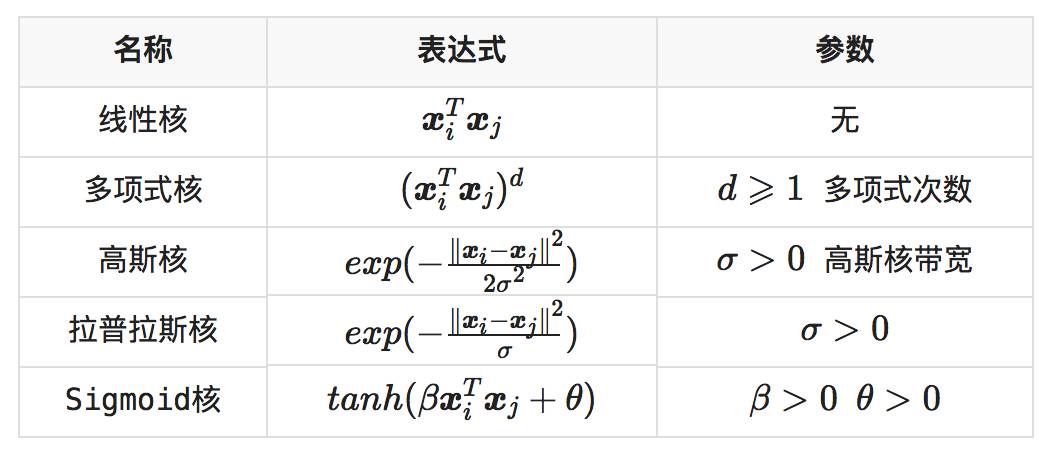

以上我们求解的支持向量机都是在线性情况下的,那么非线性情况下如何处理?这里就引入:核方法

对于这样的问题,可以将样本从原始空间映射到一个更高为的特征空间,使得样本在这个特征空间内线性可分。

同理上文中引入拉格朗日乘子,求解整个方程后可得

也可以通过函数组合得到这些值

多类问题可以使用两两做支持向量机,再由所有的支持向量机投票选出这个类别的归属,被称为one-versus-one approace。

更多文章欢迎访问https://charlesliuyx.github.io或者访问原文链接

Reference

知乎各类回答

Wiki百科

PRML

周志华-机器学习

3211

3211

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?