这篇文章里提出了一种用MMD来同时对两个域上的marginal distribution和conditional distribution进行约束的迁移网络。

具体而言,用MMD来对两个域(源域和目标域)上的提取到的特征分布进行约束,从而使两个域上的特征分布尽可能相同,这个分布叫做marginal distribution;同时对两个域上的softmax分类结果用MMD来进行约束,使得两个分类结果的分布尽可能相同,这个分布叫做conditional distribution。这两个方面应该和这篇文章Long M, Wang J, Ding G, et al. Transfer feature learning with joint distribution adaptation[C]//Proceedings of the IEEE International Conference on Computer Vision. 2013: 2200-2207.的思路基本相同,不同之处在于这篇文章使用的是基于传统的方法,这里使用了深度学习。

由于本文并没有使用标准的卷积网络结构,所以最后取得的效果和之前的deep learning的方法并没有可比性,最后实验部分也是用的传统的浅层方法进行对比,没有与最新的基于deep learning方法对比。

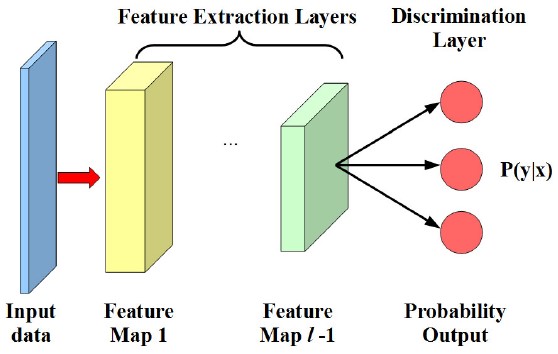

文章方法的网络结构在文中表示如下:

首先是特征提取层,也就是图中的前l-1层,最后一层是分类层,输出的是属于每个类的概率。本文在第l-1层以及分类器的输出衡量源域和目标域基于MMD的分布损失。在特征分布上,通过在目标函数中的marginal MMD来衡量两个域上的分布区别,具体如下:

笔记:Deep transfer network: unsupervised domain adaptation

最新推荐文章于 2022-09-02 09:53:44 发布

该文介绍了一种利用最大均值差异(MMD)约束源域和目标域的边际分布及条件分布的深度迁移网络方法。通过MMD优化特征分布和分类结果分布,使两个领域的特征和分类结果尽可能接近。文章对比了传统方法和深度学习的应用,并提出了基于mini-batch的优化算法。此外,为解决目标域缺乏标签的问题,使用了简单的分类器生成伪标签。该方法关注于构建领域不变的特征,同时考虑了类别间的分布关系。

该文介绍了一种利用最大均值差异(MMD)约束源域和目标域的边际分布及条件分布的深度迁移网络方法。通过MMD优化特征分布和分类结果分布,使两个领域的特征和分类结果尽可能接近。文章对比了传统方法和深度学习的应用,并提出了基于mini-batch的优化算法。此外,为解决目标域缺乏标签的问题,使用了简单的分类器生成伪标签。该方法关注于构建领域不变的特征,同时考虑了类别间的分布关系。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?