M-P模型

1943年,McCulloch and Pitts抽象出了“M-P神经元模型”,神经元接受到来自 n 个其他神经元传递过来的输入信号,通过带权重的值连接传递,神经元接受到的总输入值与神经元的阈值进行比较,通过激活函数(activation function)处理输出。

激活函数

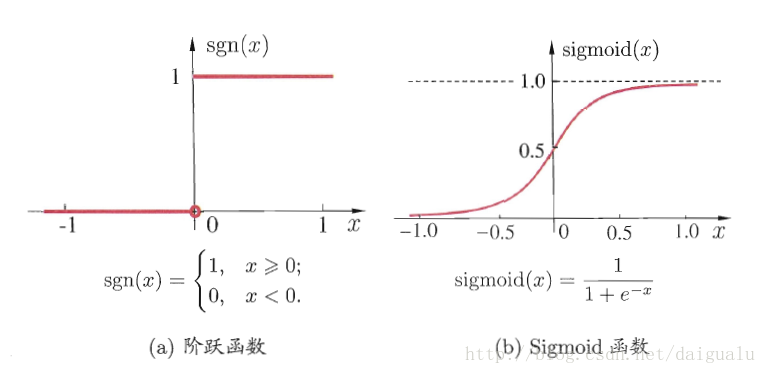

理想中的激活函数如下图所示的阶跃函数,它将输入值映射为输出值0 (对应于神经元抑制)或 1(对应于神经元兴奋)。

但是,阶跃函数在

因此,需要找一个近似于阶跃函数的连续函数替代它。

这个函数便是

Sigmoid

函数。如图b所示:

sigmoid(x)=11+e−x

并且它有一个非常好的性质:

f(x)′=f(x)(1−f(x))

感知机

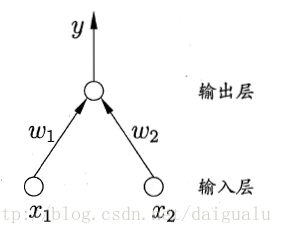

感知机由两层神经元组成,输入层接受外界输入信号后传递给输出层,输出层是M-P神经元。如下图所示,

机器学习到底学的是什么

如上图所示的 w1,w2 ,是连接2个神经元间的权值。更一般地,给定训练数据集,确定权重 wi(i=1,2,3...,n) 以及阈值 θ 的过程,便是学习的主要目标,这就是学习到的东西。

再看感知机

感知机只有输出层神经元进行激活函数处理,属于一层功能神经元(functional neuron),其学习能力非常有限。

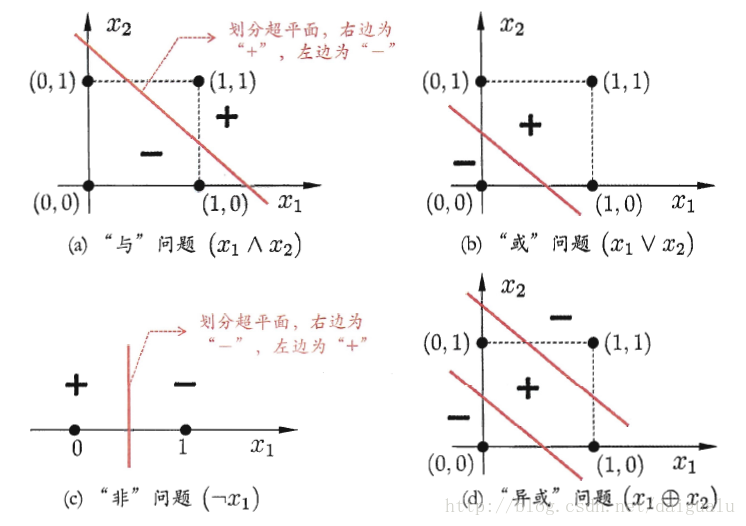

对于这个一层功能神经元模型,只能处理线性可分的问题,比如与,或,非的问题,对这些问题的学习,感知机一定可以收敛,并且存在一个线性超平面将它们分开,如下图所示,可以求得适当的权向量 w=(w1;w2;...;wn+1) 。

观察上图d

发现它有两个超平面来包裹了一个区域,求解异或问题,已经不是线性问题了,而是非线性问题,需要考虑一种解决非线性问题的网络。

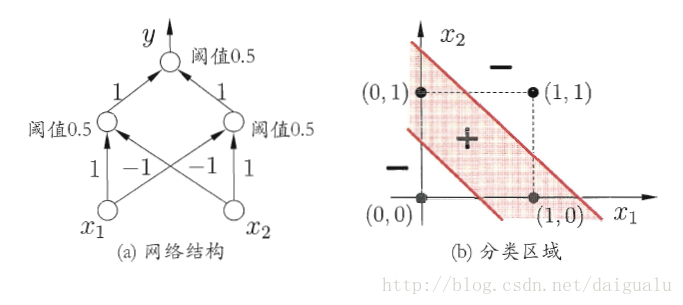

飞跃到多层功能神经元

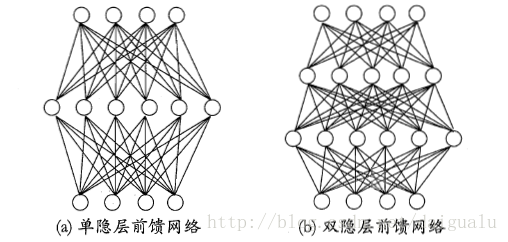

如下图所示,是两层感知机(两层功能神经元)。

输出层与输入层之间的一层神经元,称为隐含层(hidden layer)。

隐含层和输出层都是拥有激活函数的功能神经元。

多层前馈神经网络

更一般地,常见的神经网络是如图所示的层级结构,每层神经元与下一层神经元互联,神经元之间存在同层连接,也不存在跨层连接。这样的网络结构称为“多层前馈神经网络”(mutli-layer feedforward neural networks)。

参考

本文属于常规概念总结,参考周志华 《机器学习》

1592

1592

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?