本博文讲述的内容主要包括:

1,SparkStreaming on Kafka Receiver 工作原理机制

2,SparkStreaming on Kafka Receiver案例实战

3,SparkStreaming on Kafka Receiver源码解析

一:SparkStreaming on Kafka Receiver 简介:

1、Spark-Streaming获取kafka数据的两种方式-Receiver与Direct的方式,可以从代码中简单理解成Receiver方式是通过zookeeper来连接kafka队列,Direct方式是直接连接到kafka的节点上获取数据了。

2、基于Receiver的方式:

这种方式使用Receiver来获取数据。Receiver是使用Kafka的高层次Consumer API来实现的。receiver从Kafka中获取的数据都是存储在Spark Executor的内存中的,然后Spark Streaming启动的job会去处理那些数据。

然而,在默认的配置下,这种方式可能会因为底层的失败而丢失数据。如果要启用高可靠机制,让数据零丢失,就必须启用Spark Streaming的预写日志机制(Write Ahead Log,WAL)。该机制会同步地将接收到的Kafka数据写入分布式文件系统(比如HDFS)上的预写日志中。所以,即使底层节点出现了失败,也可以使用预写日志中的数据进行恢复。

补充说明:

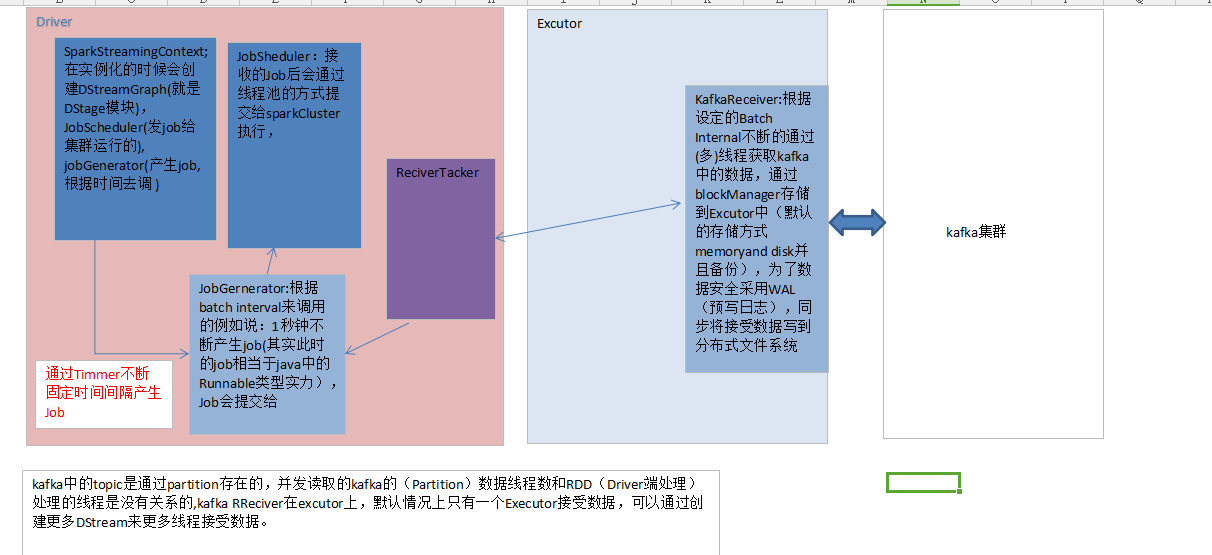

(1)、Kafka中的topic的partition,与Spark中的RDD的partition是没有关系的。所以,在KafkaUtils.createStream()中,提高partition的数量,只会增加一个Receiver中,读取partition的线程的数量。不会增加Spark处理数据的并行度。

(2)、可以创建多个Kafka输入DStream,使用不同的consumer group和topic,来通过多个receiver并行接收数据。

(3)、如果基于容错的文件系统,比如HDFS,启用了预写日志机制,接收到的数据都会被复制一份到预写日志中。因此,在KafkaUtils.createStream()中,设置的持久化级别是StorageLevel.MEMORY_AND_DISK_SER。

SparkStreaming on Kafka Receiver 工作原理图如下所示:

二、SparkStreaming on Kafka Receiver案例实战:

1、在进行SparkStreaming on Kafka Receiver案例的环境前提:

(1)spark 安装成功,spark 1.6.0(local方式除外)

(2)zookeeper 安装成功

(3)kafka 安装成功

(4)启动集群和zookeeper和kafka

在这里我采用local的方式进行试验,代码如下:

public

本文深入探讨SparkStreaming通过Receiver从Kafka获取数据的原理,包括工作机制、高可靠机制(预写日志WAL)以及案例实战。讲解了Receiver方式如何使用Kafka高层次Consumer API,并指出Receiver数据存储在Executor内存,通过预写日志实现容错。此外,文章还提供了案例代码和源码解析,帮助读者理解Spark Streaming在Kafka上的应用。

本文深入探讨SparkStreaming通过Receiver从Kafka获取数据的原理,包括工作机制、高可靠机制(预写日志WAL)以及案例实战。讲解了Receiver方式如何使用Kafka高层次Consumer API,并指出Receiver数据存储在Executor内存,通过预写日志实现容错。此外,文章还提供了案例代码和源码解析,帮助读者理解Spark Streaming在Kafka上的应用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

859

859

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?