Andrew Ng机器学习课程17(2)

声明:引用请注明出处http://blog.csdn.net/lg1259156776/

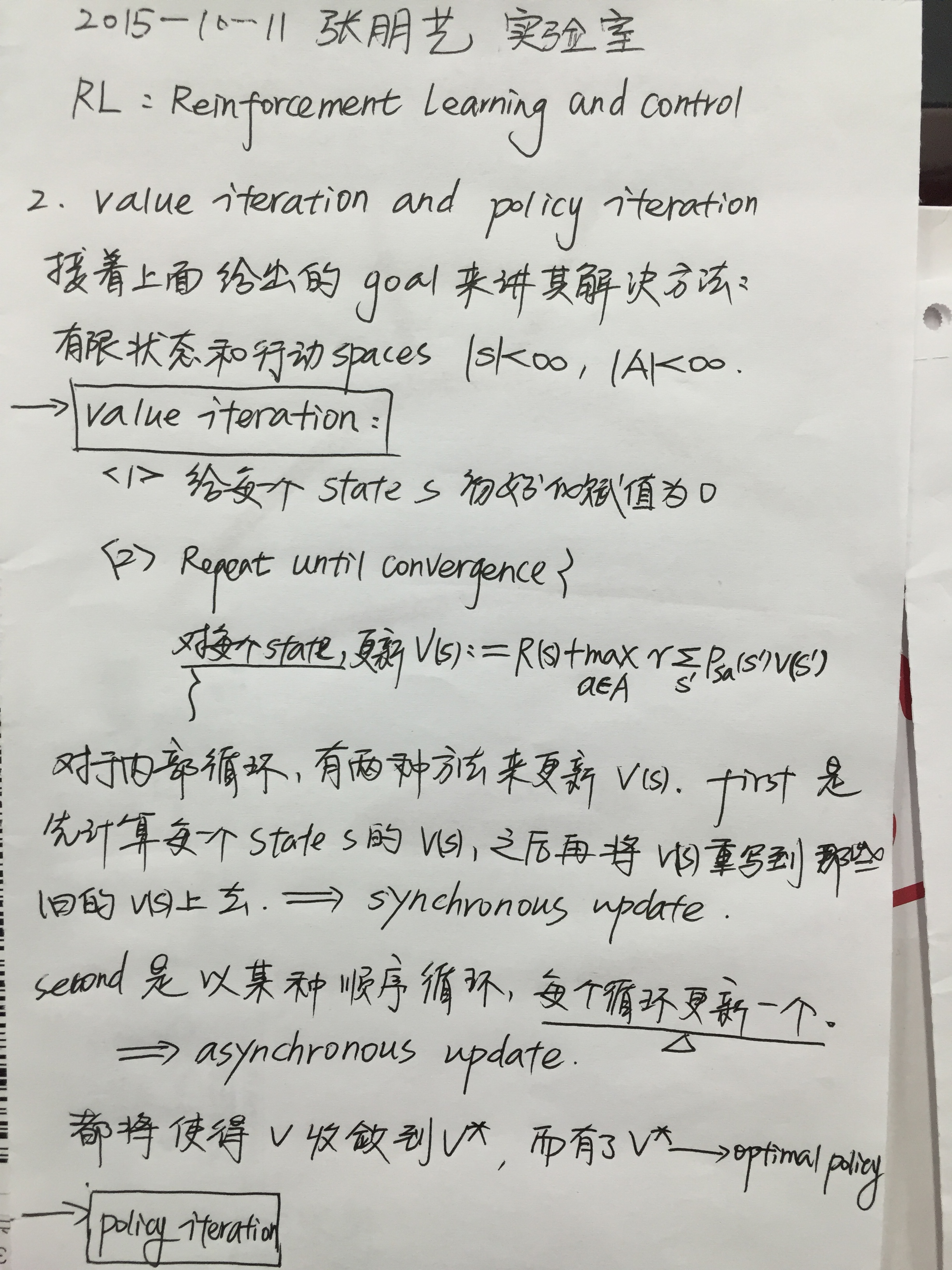

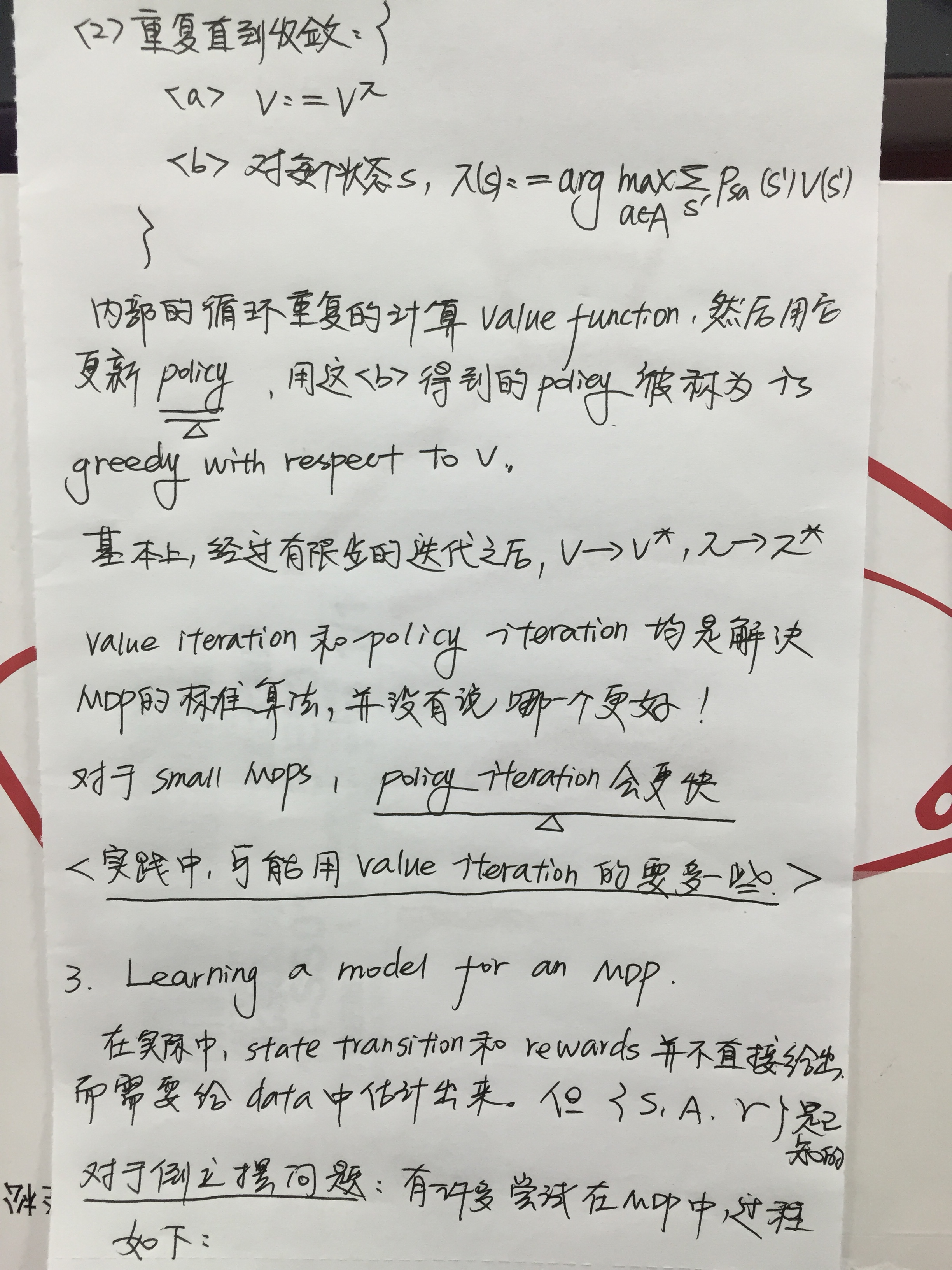

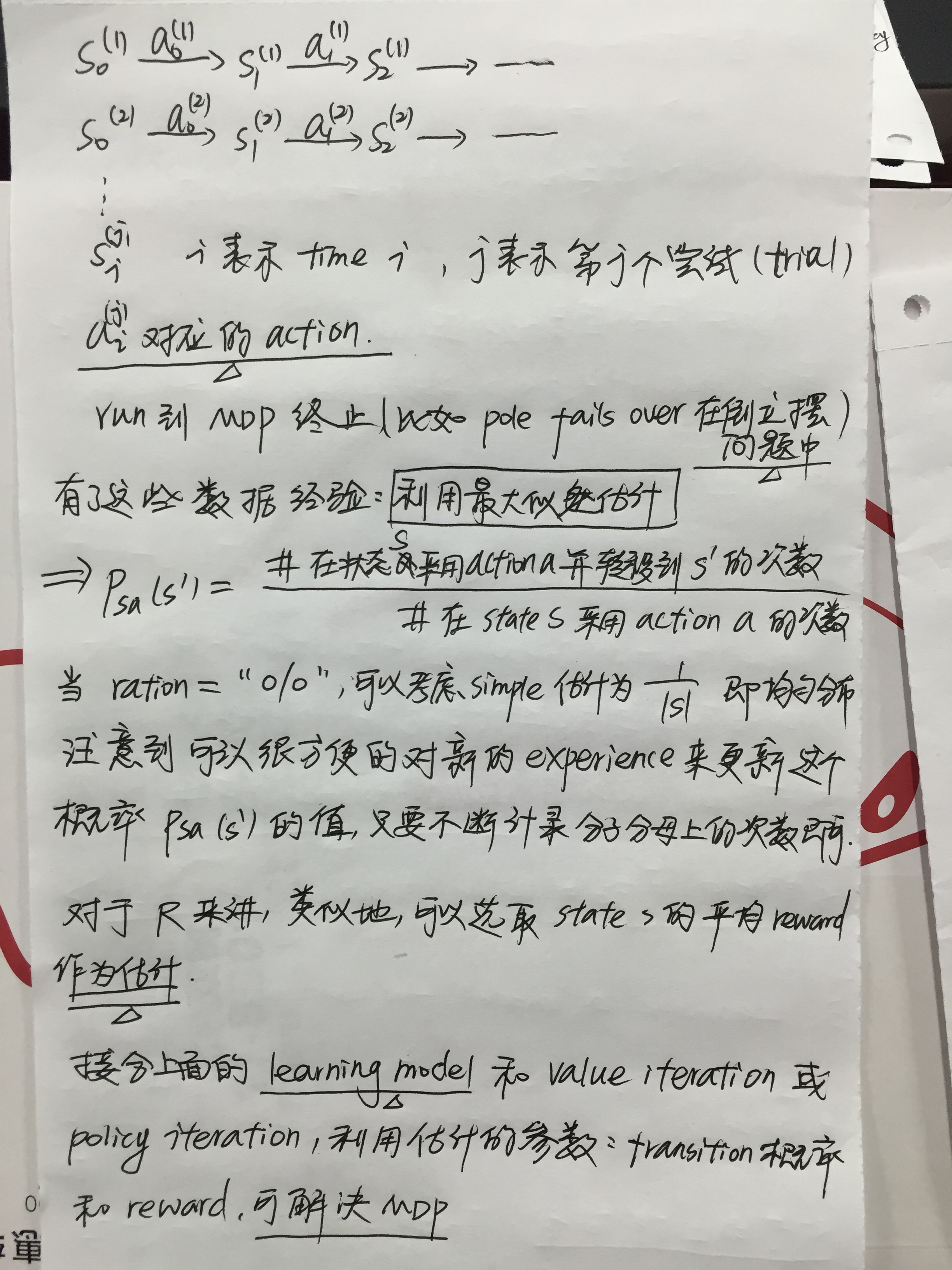

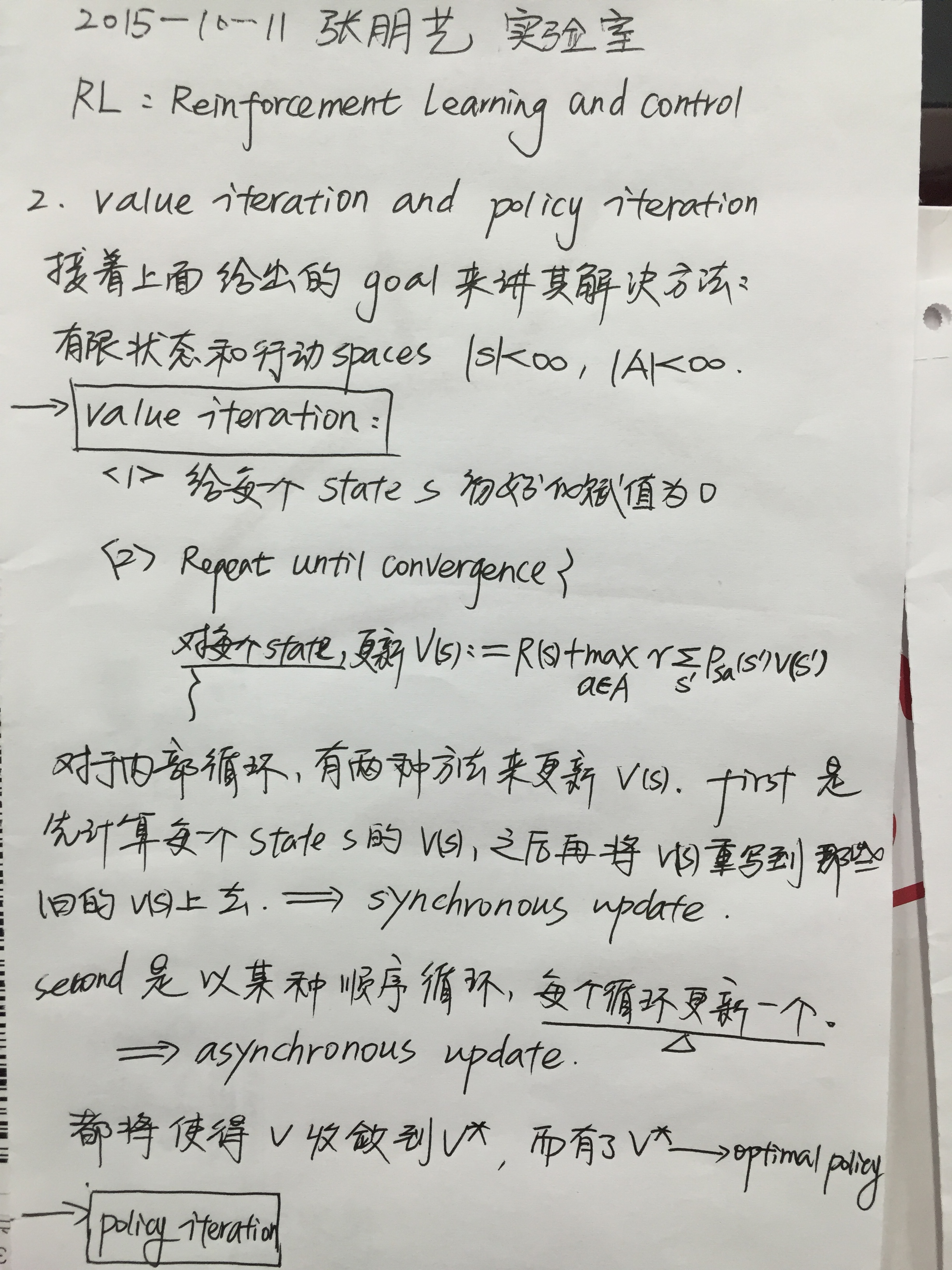

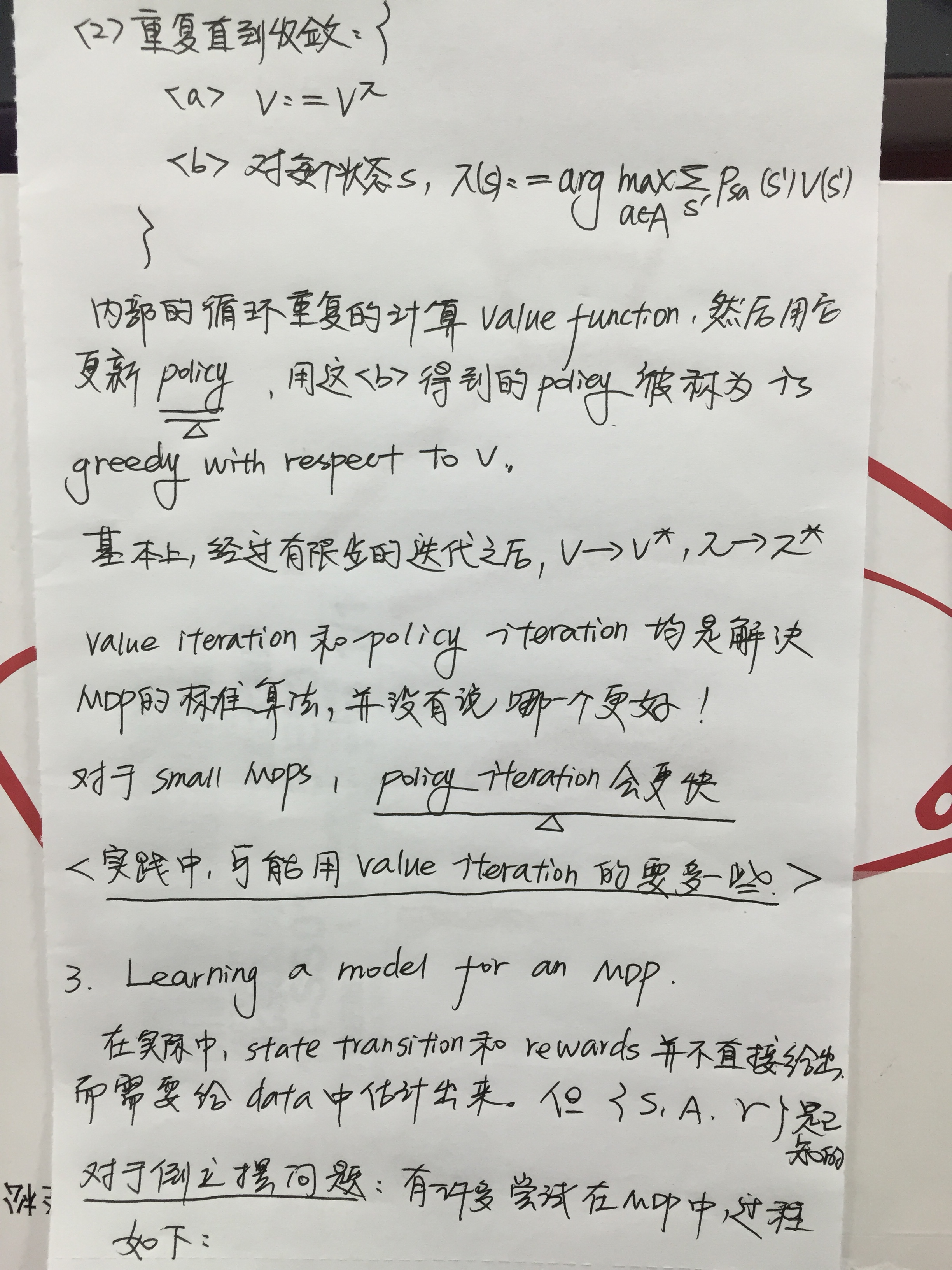

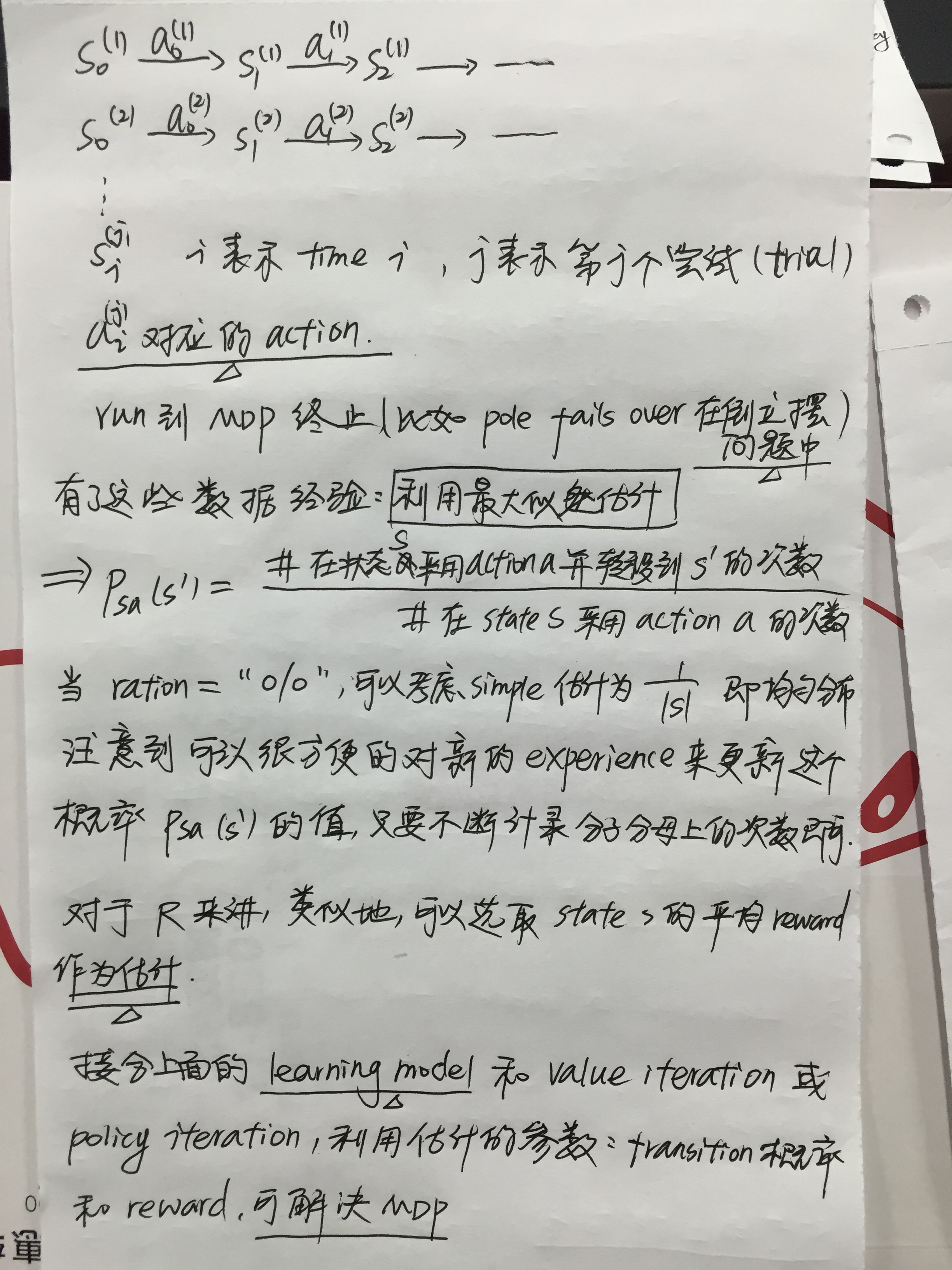

说明:主要介绍了利用value iteration和policy iteration两种迭代算法求解MDP问题,还介绍了在实际应用中如何通过积累“经验”更新对转移概率和reward的估计的学习模型,并结合两种迭代算法进行求解的完整过程。

2015-10-11 艺少

这篇博客详细介绍了在机器学习中,如何利用value iteration和policy iteration两种迭代算法解决Markov Decision Process (MDP)问题。博主阐述了在实际应用中如何通过收集经验来更新转移概率和奖励估计的学习模型,并结合这两种迭代算法展示了完整的求解过程。

这篇博客详细介绍了在机器学习中,如何利用value iteration和policy iteration两种迭代算法解决Markov Decision Process (MDP)问题。博主阐述了在实际应用中如何通过收集经验来更新转移概率和奖励估计的学习模型,并结合这两种迭代算法展示了完整的求解过程。

声明:引用请注明出处http://blog.csdn.net/lg1259156776/

说明:主要介绍了利用value iteration和policy iteration两种迭代算法求解MDP问题,还介绍了在实际应用中如何通过积累“经验”更新对转移概率和reward的估计的学习模型,并结合两种迭代算法进行求解的完整过程。

2015-10-11 艺少

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?