*****************************************

注:本系列博客是博主学习Stanford大学 Andrew Ng 教授的《机器学习》课程笔记。博主深感学过课程后,不进行总结很容易遗忘,根据课程加上自己对不明白问题的补充遂有此系列博客。本系列博客包括线性回归、逻辑回归、神经网络、机器学习的应用和系统设计、支持向量机、聚类、将维、异常检测、推荐系统及大规模机器学习等内容。

*****************************************

单变量线性回归

模型表示

线性回归(Linear Regression)是利用称为线性回归方程的最小平方函数对一个或多个自变量和因变量之间关系进行建模的一种回归分析。这种函数是一个或多个称为回归系数的模型参数的线性组合。只有一个自变量的情况称为简单回归,大于一个自变量情况的叫做多元回归。

详细描述

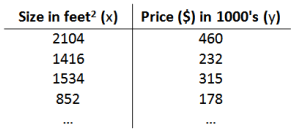

之前的房屋交易问题为例,假使我们回归问题的训练集(Training Set)如下表所示:

我们将要用来描述这个回归问题的标记如下:

m 代表训练集中实例的数量

x 代表特征/输入变量

y 代表目标变量/输出变量

(x,y) 代表训练集中的实例

(x(i),y(i))代表第 i 个观察实例

h 代表学习算法的解决方案或函数也称为假设(hypothesis)

机器学习入门:单变量线性回归与梯度下降解析

机器学习入门:单变量线性回归与梯度下降解析

本文是博主学习斯坦福大学Andrew Ng教授《机器学习》课程的心得,深入探讨单变量线性回归模型,包括模型表示、代价函数以及梯度下降算法。通过实例解释如何用线性回归预测房价,并通过最小化代价函数找到最佳拟合直线,阐述梯度下降法在寻找局部最小值过程中的作用。

本文是博主学习斯坦福大学Andrew Ng教授《机器学习》课程的心得,深入探讨单变量线性回归模型,包括模型表示、代价函数以及梯度下降算法。通过实例解释如何用线性回归预测房价,并通过最小化代价函数找到最佳拟合直线,阐述梯度下降法在寻找局部最小值过程中的作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1314

1314

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?