经过同学许可,借用他的图来讲讲深度学习的反向传播,不涉及具体推导,宏观把握原理。

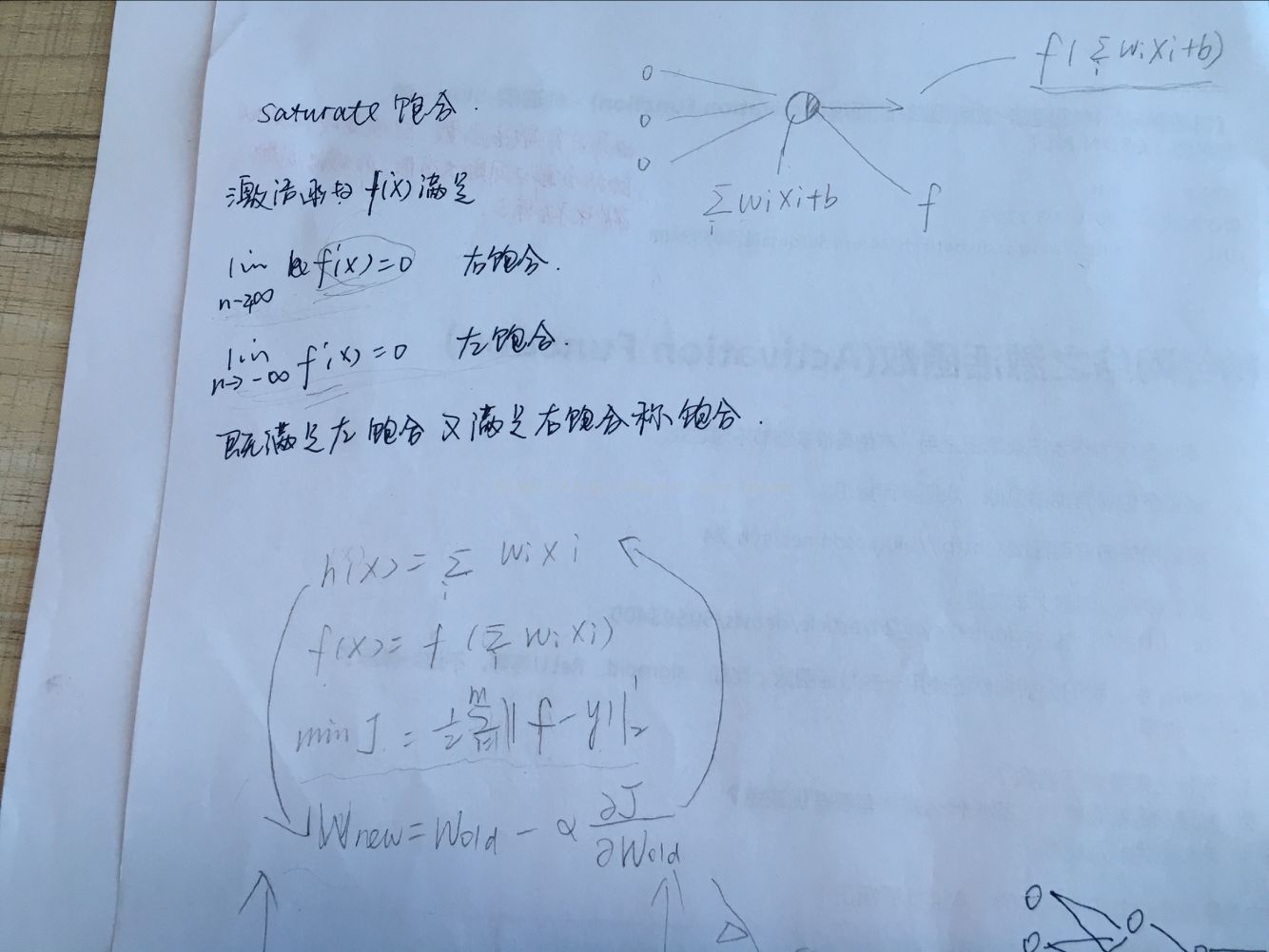

深度学习训练过程是训练模型的过程,实质上不过是权值更新的过程(不知理解对不对),即图上公式从W(old)到W(new)的过程,当然这里是循环往复、迭代进行。

h(x)是旧的权值参数和特征向量的内积,是实数。再经过激活函数例如sigmoid函数归一化带到网络的预值f(x),最后测计算损失函数J,公式里y是标签值,你懂得,预测值与标签值求距离越小代表预测越准,这个J实际就是loss,最下面是权值更新公式,a对应是深度学习的学习率,这样得到w(new)带入h(x) 进行前向传播。

循环进行,直到J最小,此时的w即是模型里的参数值。

希望讲的够简单明了。

384

384

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?