http://blog.csdn.net/u011239443/article/details/73136866

RNN

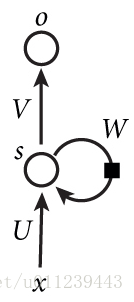

循环神经网络(RNN)的特殊的地方在于它保存了自己的状态,每次数据输入都会更新状态,输出预测值,并输出更新后的状态,和批数据一起作为输入:

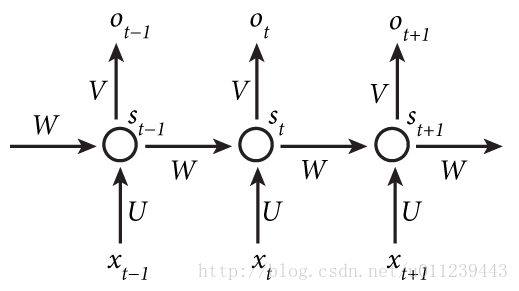

如上图,U为数据输入,V为预测值输出,W为状态值输出并输入下一轮。

由于现实中不能无限的迭代下去,我们将其展开,并在有限次迭代后结束:

例子

RNN的状态是通过一个向量来表示的,设该向量的维度为n,输入数据x的维度为m,则参数个数为

(n+m)∗n+n+n∗m+m

。我们来举个例子,

n=2,m=1

。

第1轮

设一开始的状态为 w0=(0,0) , x1=(1) , RNN 和将其合并成一个向量 y1=(0,0,1) ,则参数矩阵 A1 为一个 (n+m)∗n 即 3∗2 的矩阵。设:

A1=⎡⎣⎢⎢0.10.30.50.20.40.6⎤⎦⎥⎥

设,维度为n偏置向量: b1=(0.1,−0.1)

w1=y1∗A1+b1=(0.537,0.462)

即,输出到下一轮的状态向量为(0.537,0.462),而在这轮该状态还会与参数 n∗m 参数矩阵 A2 相乘,再加上偏置向量m的偏置向量 b2 。设:

A2=[12]

b2=(0.1)

o1=w1∗A2+b2=(1.56)

第2轮

设 x2=2 , y2 为 w1 和 x2 合并,即 (0.54,0.46,2)

w2=y2∗A1+b1=(0.860,0.884)

o2=w2∗A2+b2=(2.73)

RNN扩展

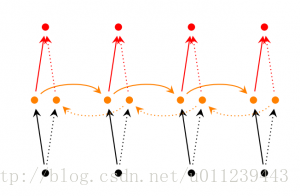

双向RNN

顾名思义,双向的状态传播:

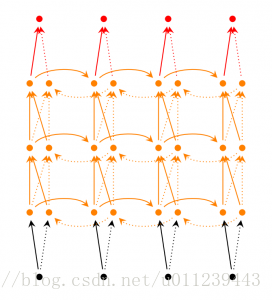

深度RNN

要注意的是,RNN的dropout不会在深度方向上使用,只会在状态输出到下一轮的时候使用。

3379

3379

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?