SVR的推导

LSSVM(Least Square SVM)是将Kernel应用到ridge regression中的一种方法,它通过将所有样本用最小二乘误差进行拟合(这个拟合是在kernel变换过的高维空间),但是LSSVM的缺陷是计算复杂度大概是样本数的三次方量级,计算量非常大。为了解决这个问题于是提出了SVR(支持向量回归),SVR通过支持向量减小了LSSVM的计算复杂度,并且具备LSSVM的能够利用kernel在高纬度拟合样本的能力。

LSSVM

在上一篇降到的逻辑回归(Logistic Regression)和SVM的联系以及Kernel这篇中提到了优化误差形式如下面(1)这个形式的,最终求得的权重w是z的线性组合,然后把这个形式的w代入原式子中就可以利用kernel了,LSSVM的推导过程就是这样。

minwλNwTw+1N∑n=1Nerr(ynwTzn)⟹w=∑n=1Nβnzn(1)

minwλNwTw+1N∑n=1N(yn−wTzn)2(2)

Ridge regression的优化形式如(2),刚好符合(1)式中的形式,因此把w代入(2)中可以将Ridge regression写成(3):

minwλN∑n=1N∑m=1NβnβmK(xn,xm)+1N∑n=1N(yn−∑n=1NβnK(xn,xm))2(3)

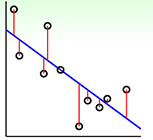

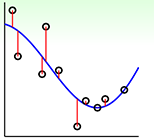

LSSVM(Least Square SVM)利用Kernel进行最小二乘误差拟合,但计算复杂度高。为解决此问题,提出了SVR(支持向量回归),通过支持向量减少计算复杂度,保持LSSVM在高维空间拟合样本的能力。SVR允许存在一定噪声的边界,通过设定margin并引入L2正则项,仅使用少量支持向量进行模型推导,降低了计算成本。

LSSVM(Least Square SVM)利用Kernel进行最小二乘误差拟合,但计算复杂度高。为解决此问题,提出了SVR(支持向量回归),通过支持向量减少计算复杂度,保持LSSVM在高维空间拟合样本的能力。SVR允许存在一定噪声的边界,通过设定margin并引入L2正则项,仅使用少量支持向量进行模型推导,降低了计算成本。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

340

340

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?