习用之语

题目大意

给出

N

个长度为4的字符串,求出仅差

输入格式

第一行两个正整数

N

,

接下来

N

行,每行一个长度为4的字符串。

输出格式

一行,一个整数,为仅差

样例输入

4 2

0000

a010

0202

a0e2

样例输出

3

样例解释

一共三对。

第一对:0000,a010

第二对:a010,a0e2

第三对:0202,0000

故输出3。

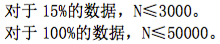

数据范围

题解

15分算法

做一次 N2 的两两匹配统计答案即可。

100分算法

定义一个数组

G

,

最能多有

那我们的问题也就转换成至少有(4-

那我们怎样求

Gi

呢?

首先从每个字符串中抽取(4-

i

)个字符出来并按顺序排好形成

其中有多少个字符串相等就有多少对。

算法有很多,我用的是快排,这样一样的字符串就会堆在一起。

至于抽取字符出来的方法可以自己枚举,不多,对于每个

i

最多只有6种。

定义一个数组

根据容斥原理,

具体转移如下:

f[0]=g[4] (这个比较显然)

f[1]=g[3]-f[0]*4

(仅为1个不同(即仅为3个相同),在仅为0个不同(即全部相同)里算了4次,这4次都要去掉,后面同理)

f[2]=g[2]-f[1]*3-f[0]*6

f[3]=g[1]-f[2]*2-f[1]*3-f[0]*4

f[4]=n*(n-1)/2-f[0]-f[1]-f[2]-f[3](这里用了比较取巧的方法,即用总的减去其他的)

400

400

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?