十月底, 参加了公司的一个spark大数据比赛, 题目比较简单, 但是由于自己缺乏此方面的业务知识, 所以对我来说解答的过程还是很有收获的 , 现在记录如下:

题目

数据表:

CREATE EXTERNAL TABLE fact_ipp_flux_limit(

clttime timestamp,

clttimeint bigint,

imsi string,

ci bigint,

url string,

tcpwrldelay bigint

)

PARTITIONED BY (

reportdate string,

reporthour int,

reportneid int)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ‘,’

STORED AS TEXTFILE LOCATION ‘/zxvmax/telecom/cn/test_data/fact_ipp_flux_limit’;

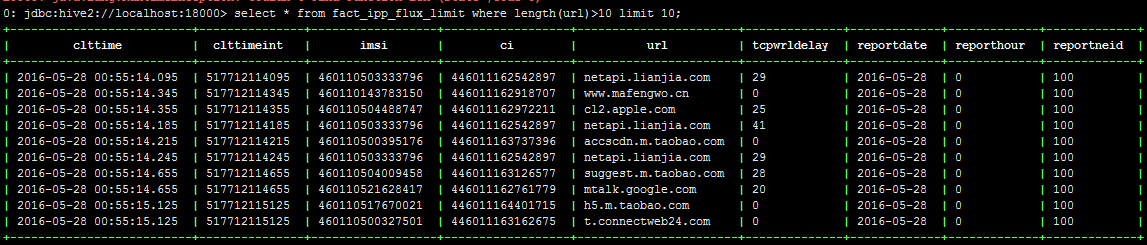

该数据表是统计的某地区电信用户手机上网情况, 其中clttime是访问对应url的时间, imsi是手机卡标识, ci是小区ID, url则是访问链接. 数据如下图所示:

问题 :

1. 根据提供的数据,输出每五分钟,人流量最大的TOP3小区。(简单)

时间:14:00 – 17:00

字段:时间(clttime),小区(ci), 用户(imsi)

2. 根据URL识别搜索引擎的关键词,并给出搜索热度排名。(中等)

时间:00:00 – 23:59

字段:url,时间(clttime)

3. 根据URL识别什么时段大家更喜欢看新闻。(中等)

时间:00:00 – 23:59

字段:url,时间(clttime)

4. 根据URL识别最受欢迎的网站。(中等)

时间:00:00 – 23:59

字段:url,时间(clttime)**

提交指南

我们以wordcount为例介绍下在linux环境下的提交方式

示例代码(wordcount.scala):

package bigdata

import org.apache.spark.SparkConf

import org.apache.spark.SparkContext

import org.apache.spark.SparkContext._

object WordCount

{

def main(args: Array[String])

{

if (args.length < 1)

{

System.err.println("Usage: <file>")

System.exit(1)

}

val conf = new SparkConf()

val sc = new SparkContext(conf)

val line = sc.textFile(args(0))

val array = line.flatMap(_.split(" ")).map((_, 1)).reduceByKey(_ + _)

array.saveAsTextFile("/odpp/files/output")

sc.stop()

}

}编译

scalac -classpath /home/mr/spark/lib/spark-assembly-1.4.1-hadoop2.5.0-cdh5.3.2.jar -d wordcount.jar wordcount.scala

此处要注意scala的版本要与spark-assembly的scala编译版本最好一致, 不然可能在运行时出错.上述jar是由scala 2.10.4编译的

提交

spark-submit --master yarn-cluster --queue user07_space --driver-memory 3G --executor-memory 2G -

本文记录了一次Spark大数据比赛的经验,包括如何处理电信用户手机上网数据,解决四大问题:按每五分钟计算人流量最大TOP3小区、识别搜索引擎关键词、分析新闻阅读时段及最受欢迎的网站。提交指南介绍了在Linux环境下使用spark-submit的方法,强调了任务数优化和url解码等关键点。

本文记录了一次Spark大数据比赛的经验,包括如何处理电信用户手机上网数据,解决四大问题:按每五分钟计算人流量最大TOP3小区、识别搜索引擎关键词、分析新闻阅读时段及最受欢迎的网站。提交指南介绍了在Linux环境下使用spark-submit的方法,强调了任务数优化和url解码等关键点。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3516

3516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?