最后计算该规则的错误率:error

错误率即 具有该特征的个体在除出现次数最多的类别出现的次数,代表分类规则不适用的个体的数量。

最后返回待预测的个体类别 和 错误率

def train_feature_value(X, y_true, feature, value):

class_counts = defaultdict(int)

for sample, y_t in zip(X, y_true):

if sample[feature] == value:

class_counts[y_t] += 1

sorted_class_counts = sorted(class_counts.items(), key=itemgetter(1), reverse=True) # 降序

most_frequent_class = sorted_class_counts[0][0]

error = sum([class_count for class_value, class_count in class_counts.items()

if class_value != most_frequent_class])

return most_frequent_class, error

返回值most_frequent_class是一个字典, error是一个数字

==================================================================================================

def train(X, y_true, feature):

n_samples, n_features = X.shape

assert 0 <= feature < n_features

获取样本中某特征所有可能的取值

values = set(X[:, feature])

predictors = dict()

errors = []

for current_value in values:

most_frequent_class, error = train_feature_value(X, y_true, feature, current_value)

predictors[current_value] = most_frequent_class

errors.append(error)

total_error = sum(errors)

return predictors, total_error

因为most_frequent_class是一个字典,所以predictors是一个键为特征可以的取值(0和1),值为字典most_frequent_class的 字典。

total_error是一个数字,为每个特征值下的错误率的和。

====================================================================================

all_predictors = {variable: train(X_train, y_train, variable) for variable in range(X_train.shape[1])}

Errors = {variable: error for variable, (mapping, error) in all_predictors.items()}

找到错误率最低的特征

best_variable, best_error = sorted(Errors.items(), key=itemgetter(1))[0] # 升序

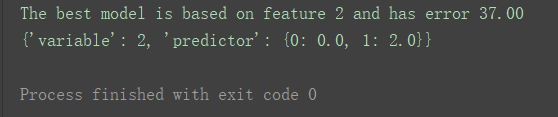

print(“The best model is based on feature {0} and has error {1:.2f}”.format(best_variable, best_error))

找到最佳特征值,创建model模型

model = {‘variable’: best_variable,

‘predictor’: all_predictors[best_variable][0]}

print(model)

根据代码运行结果,最佳特征值是特征2(索引值为2的feature,即第三个特征)。

对于初学者这里的代码逻辑比较复杂,可以对变量进行逐个打印查看,阅读blog学习时要盯准字眼,细品其逻辑。

print(all_predictors)

print(all_predictors[best_variable])

print(all_predictors[best_variable][0])

============================================================================

定义预测函数,对测试集数据进行预测

def predict(X_test, model):

variable = model[‘variable’]

predictor = model[‘predictor’]

y_predicted = np.array([predictor[int(sample[variable])] for sample in X_test])

return y_predicted

对测试集数据进行预测

y_predicted = predict(X_test, model)

print(y_predicted)

预测结果:

统计预测准确率

accuracy = np.mean(y_predicted == y_test) * 100

print(“The test accuracy is {:.1f}%”.format(accuracy))

根据打印结果,该模型预测的准确率可达65.8%,对于只有一条规则的oneR算法而言,结果是比较良好的。到此便实现了oneR算法的一次完整应用。

最后,还可以使用classification_report()方法,传入测试集的真实值和预测值,打印出模型评估报告。

屏蔽警告

warnings.filterwarnings(“ignore”)

打印模型评估报告

print(classification_report(y_test, y_predicted)) # 参数为测试集的真实数据和预测数据

小啾祝您学习顺利!

最后

Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习 Python 门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

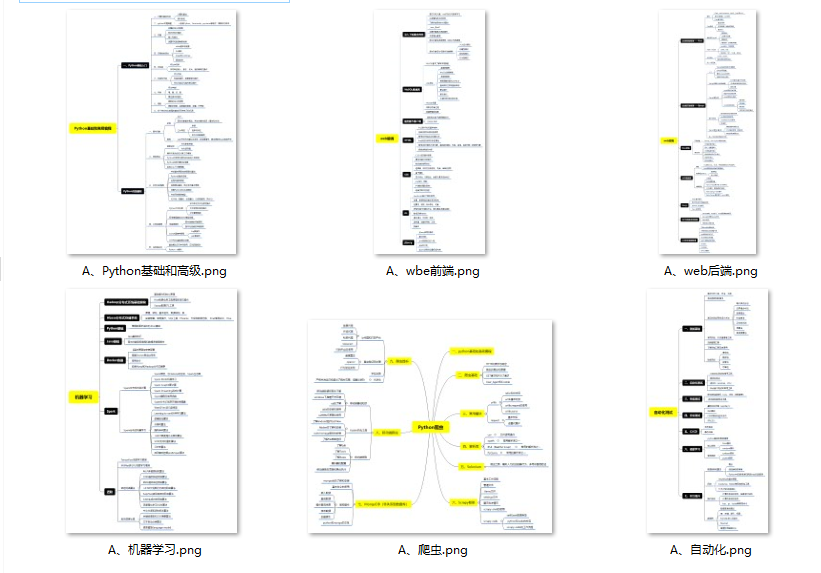

👉Python所有方向的学习路线👈

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉Python必备开发工具👈

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

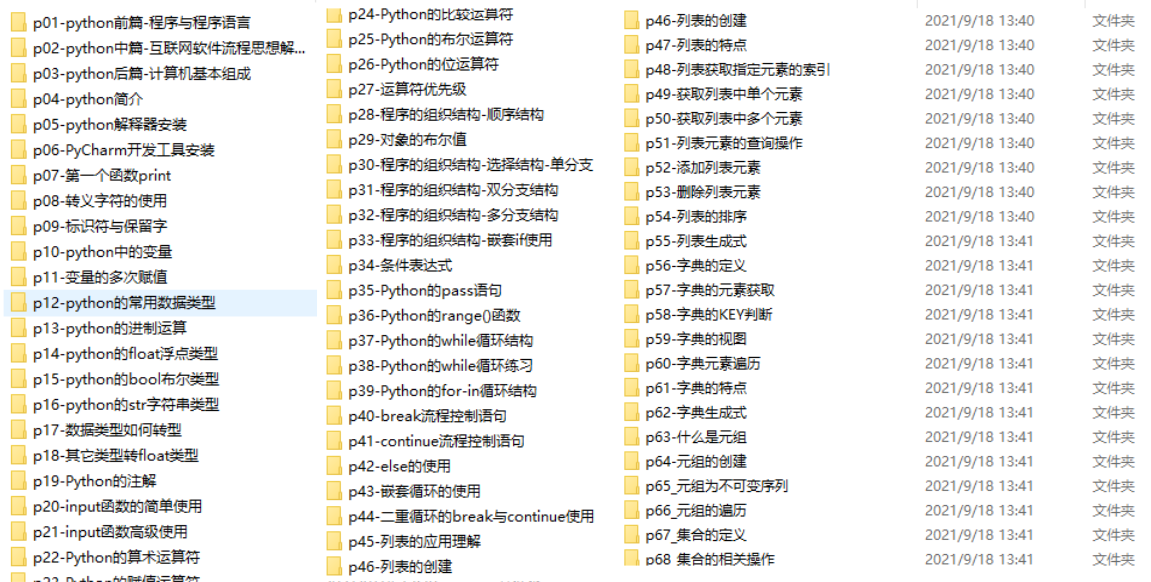

👉Python全套学习视频👈

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

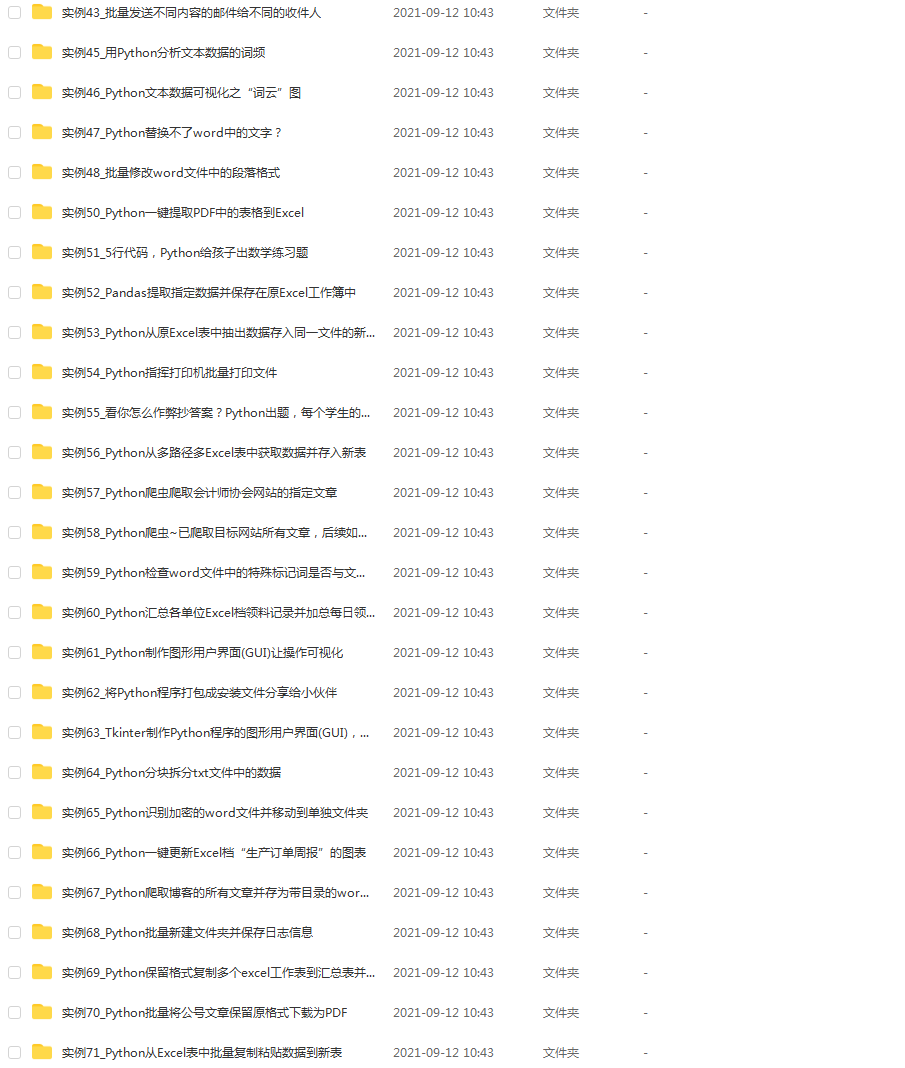

👉实战案例👈

学python就与学数学一样,是不能只看书不做题的,直接看步骤和答案会让人误以为自己全都掌握了,但是碰到生题的时候还是会一筹莫展。

因此在学习python的过程中一定要记得多动手写代码,教程只需要看一两遍即可。

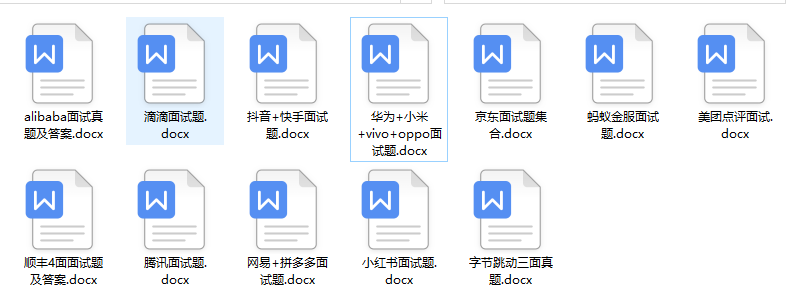

👉大厂面试真题👈

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1789

1789

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?