特征工程的概念在于从原始数据中提取并转换特征,以优化这些特征对机器学习模型的适用性。特征工程是机器学习和数据科学中的一个关键步骤,它涉及到利用领域知识来创建或选择合适的特征,这些特征能够更好地描述数据,并提升机器学习模型在未知数据上的性能。通过有效的特征工程,即使使用相对简单的模型,也能获得良好的性能,因为好的特征能够提高模型的灵活性和预测精度。特征工程包括去除无关数据、选择与结果高相关的特征、以及设计能够更好表达问题本质的特征,从而增强模型的预测能力。

特征工程概念入门–涉及内容

1.特征提取feature extraction

从原始数据中提取与任务相关的特征

2.特征预处理feature preprocessing

特征对模型产生影响;因量纲问题,有些特征对模型影响大、有些影响小

3.特征降维Featuredecomposition.

将原始数据的维度降低,叫做特征降维

4.特征选择feature selection

原始数据特征很多,但是对模型训练相关是其中一个特征集合子集。

5特征组合feature crosses

把多个的特征合并成一个特征。一般利用乘法或加法来完成。

总结

1特征工程

•特征Feature:对任务有用的属性信息

•特征工程:利用专业背景知识和技巧处理数据,让模型效果更好

2特征工程的内容

•特征提取feature extraction:特征向量

•特征预处理feature preprocessing:不同特征对模型影响一致性

•特征降维Feature decomposition:保证数据的主要信息要保留下来

•特征选择feature selection:从特征中选择出一些重要特征训练模型

•特征组合feature crosses:把多个特征合并组合成一个特征

KNN算法

KNN算法概念

即K最近邻算法,是一种基于实例的学习方法,属于监督学习方式的分类算法。该算法的核心思想是,如果一个样本在特征空间中的K个最相邻的样本中的大多数属于某一个类别,则该样本也属于这个类别。KNN算法在确定分类决策时,只依据最邻近的一个或者几个样本的类别来决定待分样本所属的类别。

•解决问题:分类问题、回归问题

•算法思想:若一个样本在特征空间中的k个最相似的样本大多数属于某一个类别,则该样本也属于这个类别

•相似性:欧氏距离

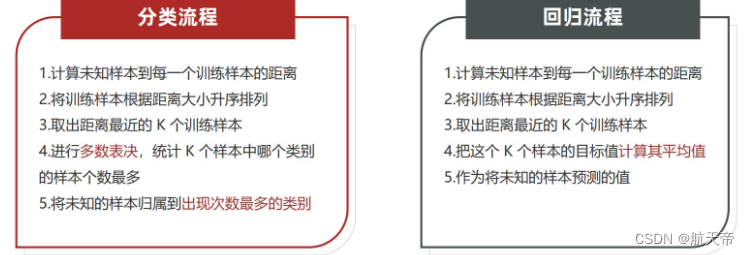

分类流程和回归流程都是有监督学习

两者差异:分类流程的标签是离散的,回归流程的标签是连续的

K值的选择

•K值过小:过拟合

•K值过大:欠拟合

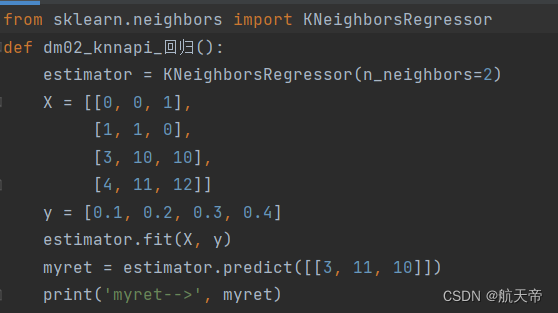

KNN算法API使用-分类问题

sklearn.neighbors.KNeighborsClassifier(n_neighbors=5)

n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数

1844

1844

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?