配置环境变量

以root用户登录,vi ~/.profile

文件中添加

export HIVE_HOME=/opt/hive

export PATH= P A T H : PATH: PATH:HIVE_HOME/bin

保存后,刷新生效

source .profile

此时输入hive回车,虽然报错,但是命令已经可以被识别。

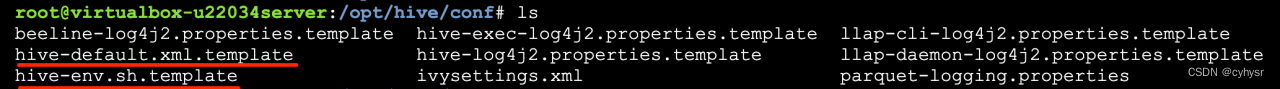

配置文件

配置文件均位于,$HIVE_HOME/conf,cd到该目录后,分别复制如下的模板文件进行调整。

hive-env.sh

以root用户,复制模板文件hive-env.sh.template

cp hive-env.sh.template hive-env.sh

vi hive-env.sh

添加 export HADOOP_HOME=/opt/hadoop

export HIVE_CONF_DIR=/opt/hive/conf

hive-site.xml

以root用户,复制模板文件hive-default.xml.template

cp hive-default.xml.template hive-site.xml

vi hive-site.xml,在文件顶部添加mysql连接信息,其余内容均删除。

完整mysql连接内容如下:

javax.jdo.option.ConnectionURL

jdbc:mysql://localhost:3306/hive?createDatabaseIfNotExist=true&useUnicode=true&characterEncoding=UTF-8&useSSL=false

javax.jdo.option.ConnectionDriverName

com.mysql.jdbc.Driver

javax.jdo.option.ConnectionUserName

root

javax.jdo.option.ConnectionPassword

root

拷贝jar包

驱动

mysql驱动

mysql连接器下载上传解压拷贝

https://downloads.mysql.com/archives/c-j/

以root用户上传至/opt

cp mysql-connector-java-5.1.49/mysql-connector-java-5.1.49-bin.jar /opt/hive/lib/

guava包

hadoop和hive里面的guava包版本可能不一致,那么用hadoop里面的覆盖掉hive里面的。

hadoop 中的版本是27

hive中的版本是19

用hadoop的覆盖hive的

cp /opt/hadoop/share/hadoop/common/lib/guava-27.0-jre.jar /opt/hive/lib/

删除hive的旧依赖包

rm /opt/hive/lib/guava-19.0.jar

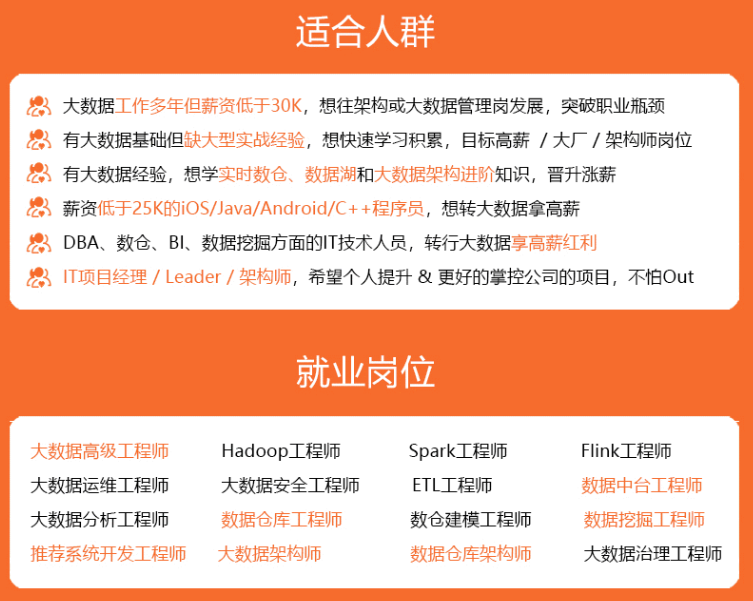

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数大数据工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

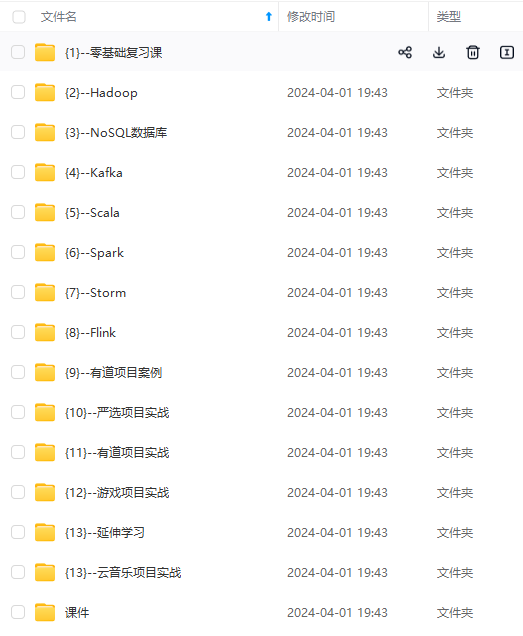

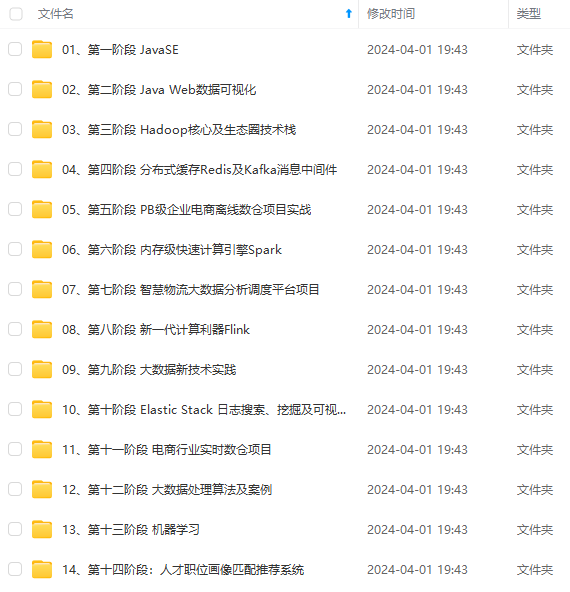

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上大数据开发知识点,真正体系化!

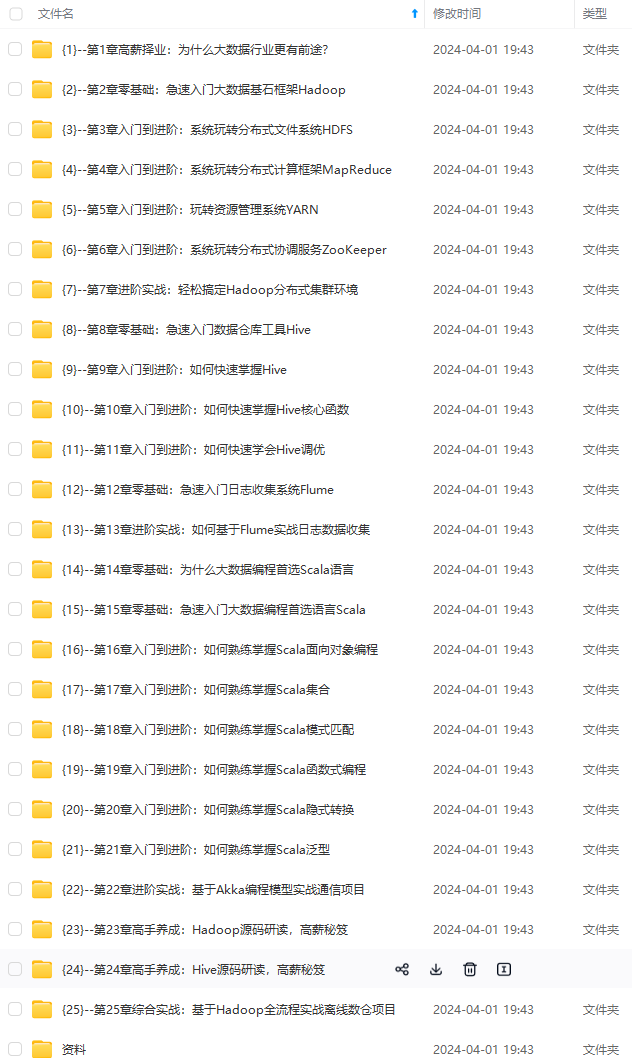

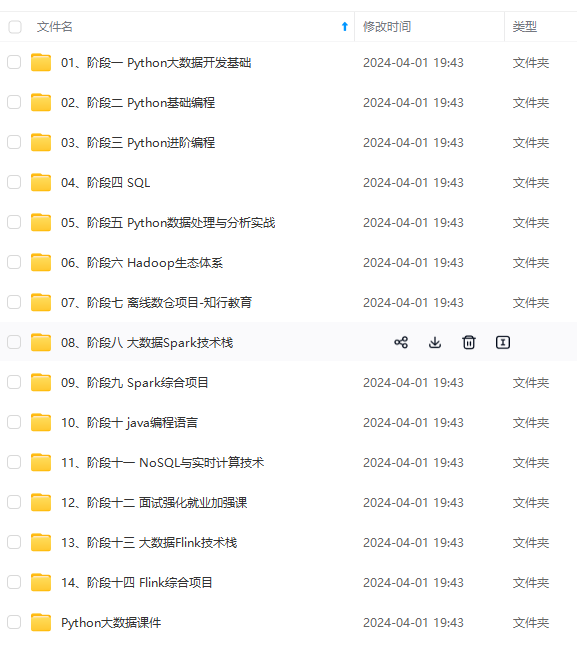

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

战项目、讲解视频,并且后续会持续更新**

如果你觉得这些内容对你有帮助,可以添加VX:vip204888 (备注大数据获取)

[外链图片转存中…(img-MCGQUyKm-1712991162254)]

一个人可以走的很快,但一群人才能走的更远。不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎扫码加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

882

882

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?