阿里云部署本地大模型chatglm3-6b

在阿里云人工智能平台PAI里选择交互式建模创建交互式建模项目文件(新人可以领取16/24G的GPU显存的机子免费用三个月)

选取镜像modelscope:1.13.1-pytorch2.1.2tensorflow2.14.0-gpu-py310-cu121-ubuntu22.04

#创建文件夹

mkdir models

cd models

#更新git-ifs,下载模型原文件

apt update

apt install git-lfs

git clone http://www.modelscope.cn/ZhipuAI/chatglm3-6b.git

#退出创建新的文件夹,下载模型运行文件

cd ..

mkdir webcodes

cd webcodes

git clone http://github.com/THUDM/ChatGLM3.git

#创建自己的环境,下载依赖包(如果不自己新创建环境可能导致如下错误,在自己环境中下载依赖可能较慢,环境可以下载在webcodes中,也可以在workplace中创建)

python -m venv tutorial-env(环境名,可以自己设置)

source tutorial-env/bin/activate

#在ChatGLM3文件下安装依赖

cd ChatGLM3

pip install -r requirements.txt(较慢,半小时左右,耐心等待)

#小黑窗运行glm3-6b

cd ChatGLM3

cd basic_demo

小黑窗运行方式,修改basic_demo文件下cli_demo.py里的’THUDM/chatglm3-6b’为自己的模型文件地址'/mnt/workspace/models/chatglm3-6b'

#运行

python cli_demo.py

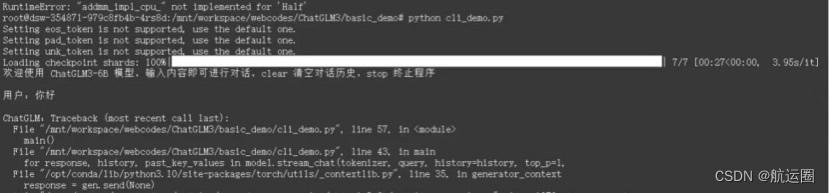

#如果出现编译错误

Traceback (most recent call last):

File "/mnt/workspace/webcodes/ChatGLM3/basic_demo/cli_demo.py", line 57, in <module>

main()

File "/mnt/workspace/webcodes/ChatGLM3/basic_demo/cli_demo.py", line 33, in main

query = input("\n用户:")

需要修改cli_demo.py文件,在 query = input("\n用户:")文件下增加

query_decoded = query.encode('utf-8').decode('utf-8', 'ignore')

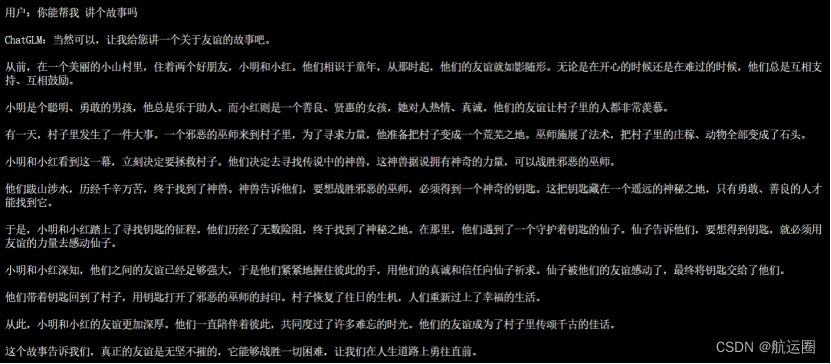

#成功运行示例

所有的坑我都踩过了,目前这一套组合拳下来应该可以正常使用,但仅限于chatglm3源码不更新的情况下,如果搂的源码更新了可能又会出这样那样的错误。后续还会发布ptuning v2微调、lora微调还有“炼丹炉”微调和大家一起学习。

所有的坑我都踩过了,目前这一套组合拳下来应该可以正常使用,但仅限于chatglm3源码不更新的情况下,如果搂的源码更新了可能又会出这样那样的错误。后续还会发布ptuning v2微调、lora微调还有“炼丹炉”微调和大家一起学习。

11万+

11万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?