1.1Hive常用部署安装

第一步,访问HIVE官网:https://hive.apache.org/general/downloads/ 下载(我这里安装的是3.1.3版本)

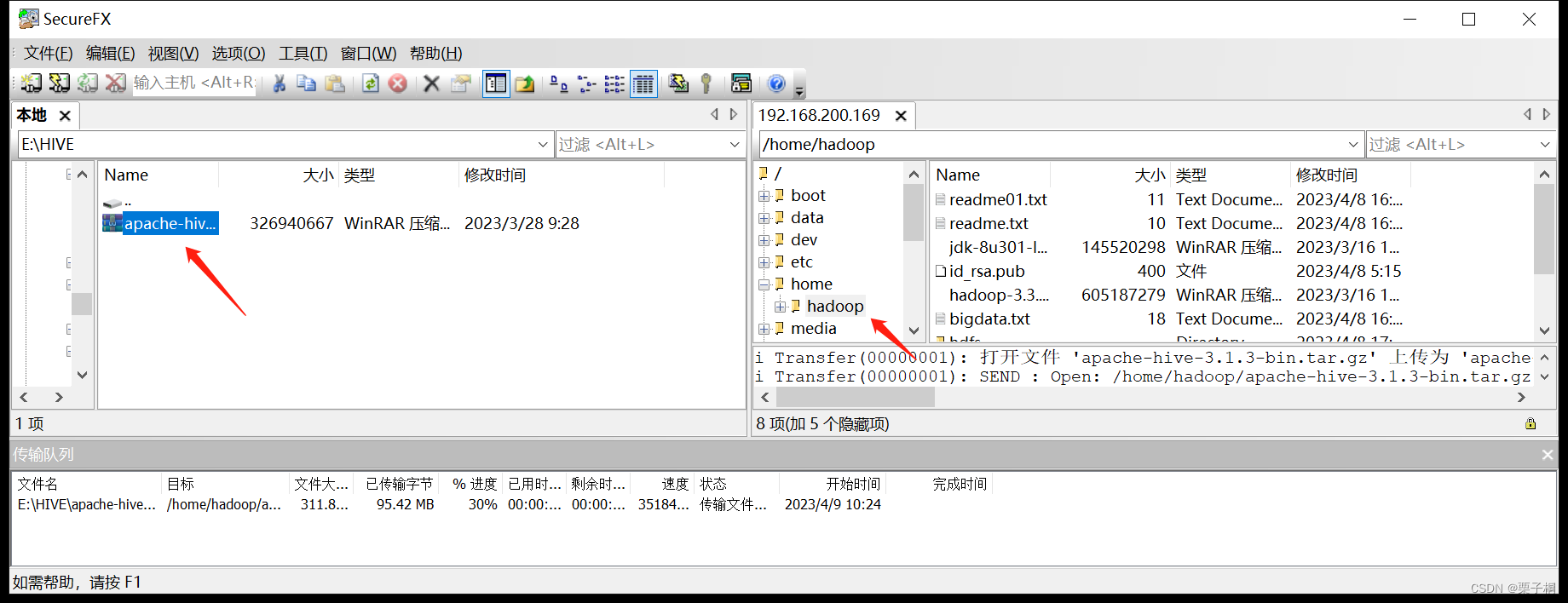

第二步,将对应版本下载或上传到服务端解压缩

首先需要把我们下载好的压缩包放置到/home/hadoop下

tar -zxvf apache-hive-3.1.3-bin.tar.gz第三步,将解压缩后的文件夹移动到合适的位置(ln -s 命令为建立一个符号链接)

sudo ln -s /home/hadoop/apache-hive-3.1.3-bin /usr/local/hive第四步,配置环境变量

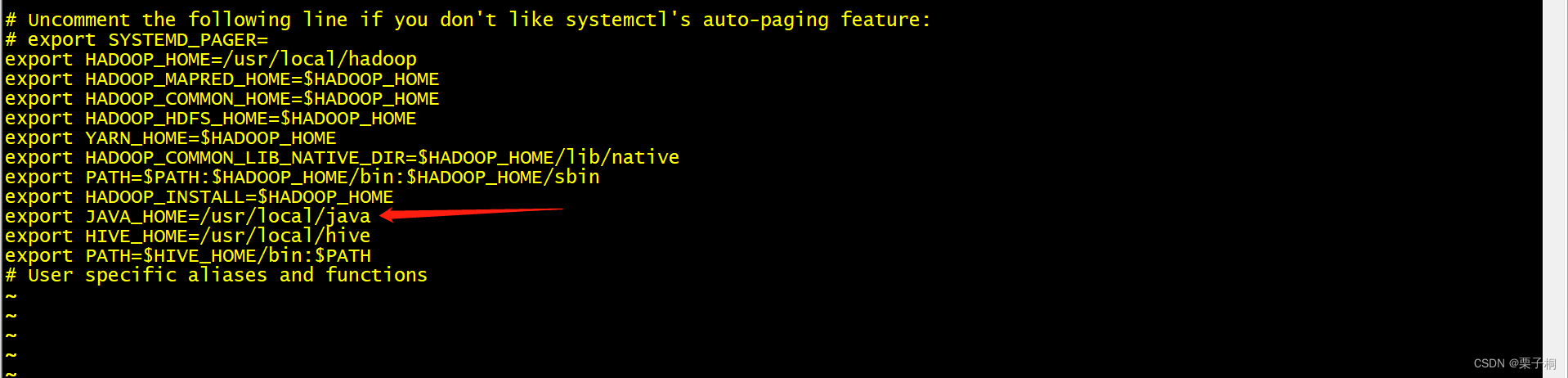

vi .bashrcexport HIVE_HOME=/usr/local/hive

export PATH=$HIVE_HOME/bin:$PATH

source .bashrc第五步,配置Hive相关文件

cd /usr/local/hive/confcp hive-env.sh.template hive-env.sh

cp hive-default.xml.template hive-default.xml

cp hive-exec-log4j2.properties.template hive-exec-log4j2.properties

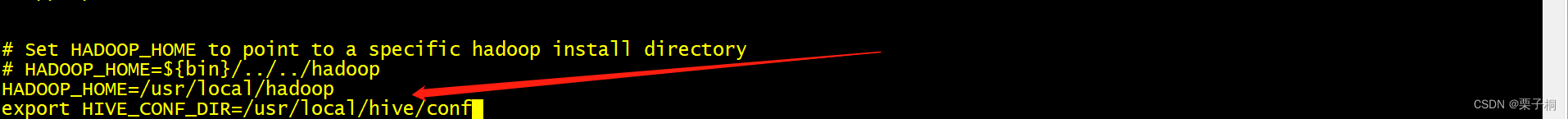

cp hive-log4j2.properties.template hive-log4j2.properties#配置Hadoop所在位置

HADOOP_HOME=/usr/local/hadoop

#配置Hive配置文件位置

export HIVE_CONF_DIR=/usr/local/hive/conf

增加MySQL配置到文件hive-site.xml,找到以下属性,更新为MySQL的配置项(hive密码为hive_123455)

vi hive-site.xmlvi hive-s

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2316

2316

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?