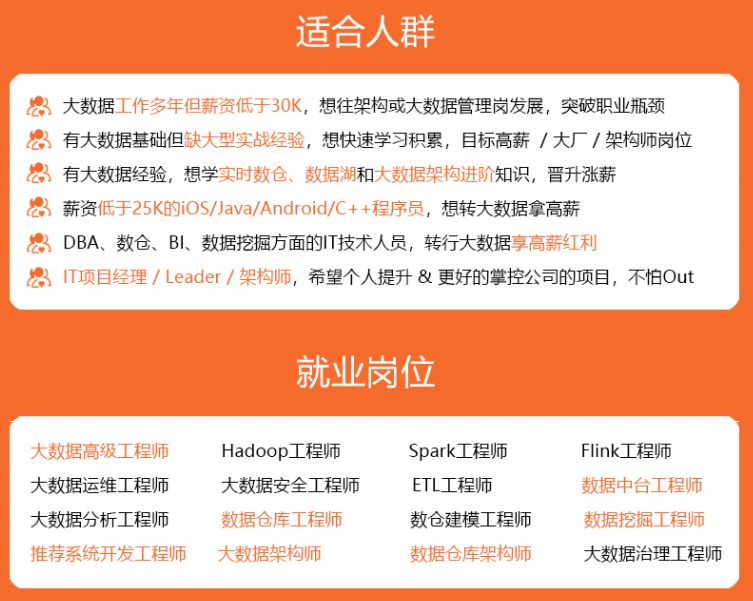

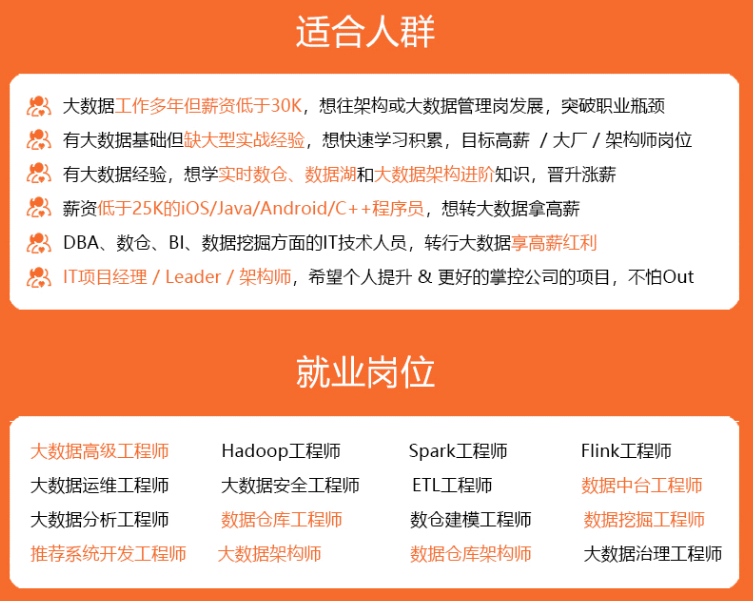

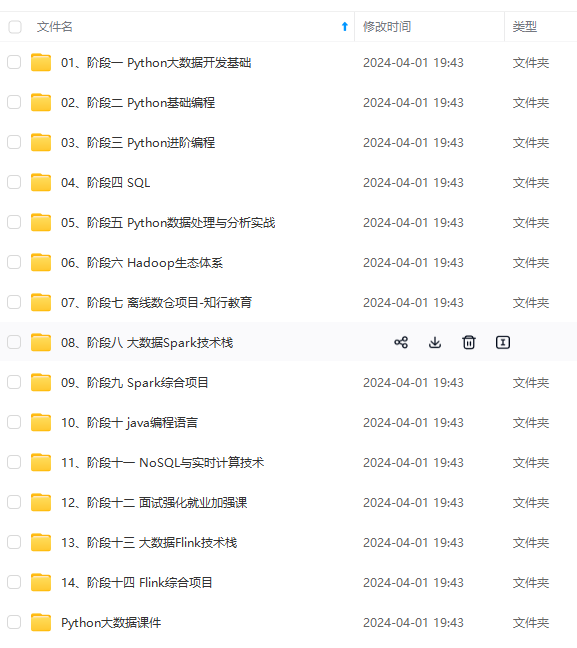

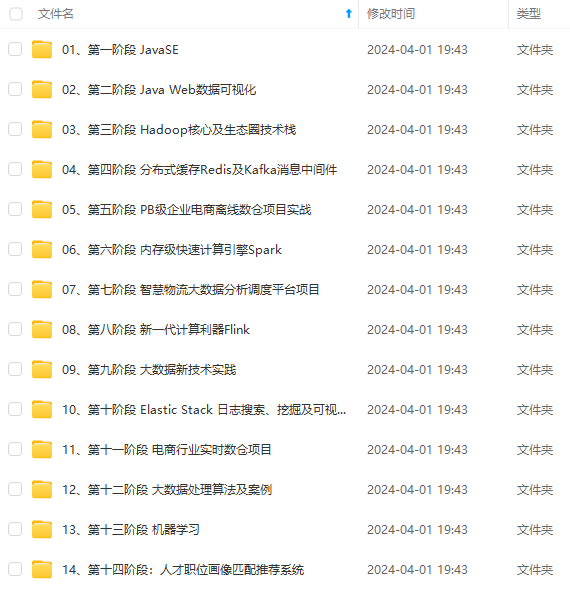

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

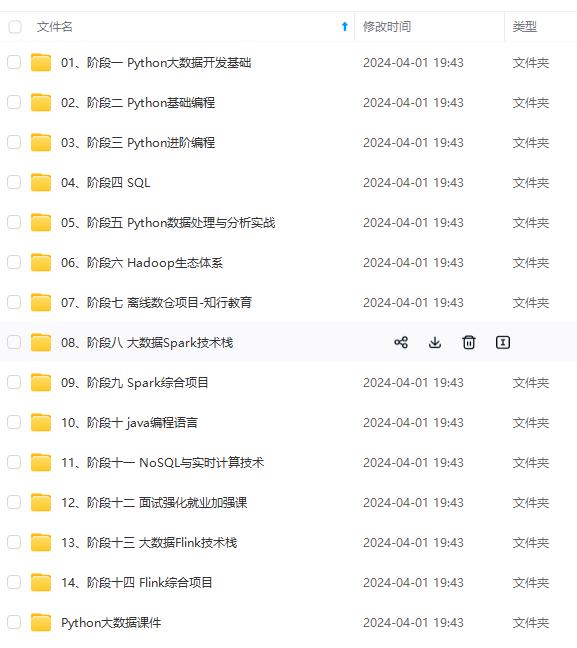

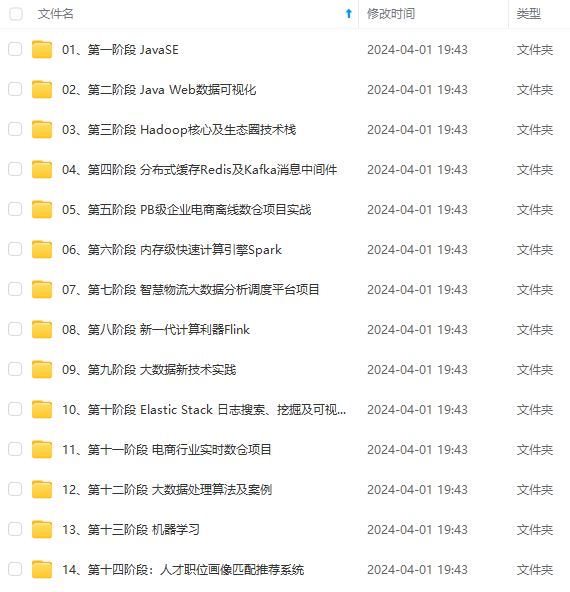

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

### 二、首先考虑单独两行映射

df.filter(col(“yes”).isNotNull).select(col(“event”),col(“yes”)).withColumn(“userid”,explode(split(col(“yes”)," "))).drop($“yes”).withColumn(“status”,lit(“yes”)).show(3)

±---------±---------±-----+

| event| userid|status|

±---------±---------±-----+

|1159822043|1975964455| yes|

|1159822043| 252302513| yes|

|1159822043|4226086795| yes|

±---------±---------±-----+

only showing top 3 rows

### 三、同理将其余隔行依次映射

scala> val no = df.filter(col(“no”).isNotNull).select(col(“event”),col(“no”)).withColumn(“userid”,explode(split(col(“no”)," "))).drop($“no”).withColumn(“status”,lit(“no”))

±---------±---------±-----+

| event| userid|status|

±---------±---------±-----+

|1159822043|3575574655| no|

|1159822043|1077296663| no|

|1186208412|1728988561| no|

±---------±---------±-----+

only showing top 3 rows

no: Unit = ()

scala> val invited = df.filter(col(“invited”).isNotNull).select(col(“event”),col(“invited”)).withColumn(“userid”,explode(split(col(“invited”)," "))).drop($“invited”).withColumn(“status”,lit(“invited”)).show(3)

±---------±---------±------+

| event| userid| status|

±---------±---------±------+

|1159822043|1723091036|invited|

|1159822043|3795873583|invited|

|1159822043|4109144917|invited|

±---------±---------±------+

only showing top 3 rows

invited: Unit = ()

scala> val maybe = df.filter(col(“maybe”).isNotNull).select(col(“event”),col(“maybe”)).withColumn(“userid”,explode(split(col(“maybe”)," "))).drop($“maybe”).withColumn(“status”,lit(“maybe”)).show(3)

±---------±---------±-----+

| event| userid|status|

±---------±---------±-----+

|1159822043|2733420590| maybe|

|1159822043| 517546982| maybe|

|1159822043|1350834692| maybe|

±---------±---------±-----+

only showing top 3 rows

maybe: Unit = ()

### 四、数据进行拼接

scala> yes.union(no).union(maybe).union(invited).show()

±---------±---------±-----+

| event| userid|status|

±---------±---------±-----+

|1159822043|1975964455| yes|

|1159822043| 252302513| yes|

|1159822043|4226086795| yes|

|1159822043|3805886383| yes|

|1159822043|1420484491| yes|

|1159822043|3831921392| yes|

|1159822043|3973364512| yes|

| 686467261|2394228942| yes|

| 686467261|2686116898| yes|

| 686467261|1056558062| yes|

| 686467261|3792942231| yes|

| 686467261|4143738190| yes|

| 686467261|3422491949| yes|

| 686467261| 96269957| yes|

| 686467261| 643111206| yes|

| 686467261|1267277110| yes|

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

路线、讲解视频,并且后续会持续更新**

4686

4686

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?