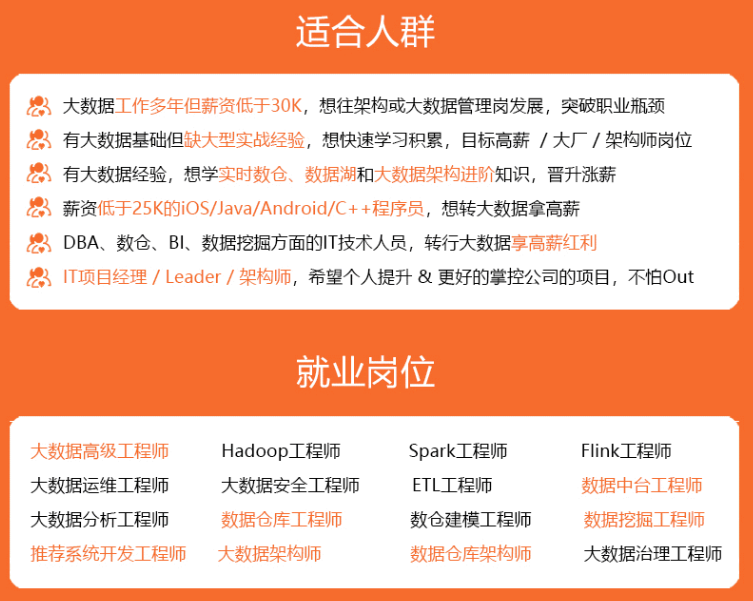

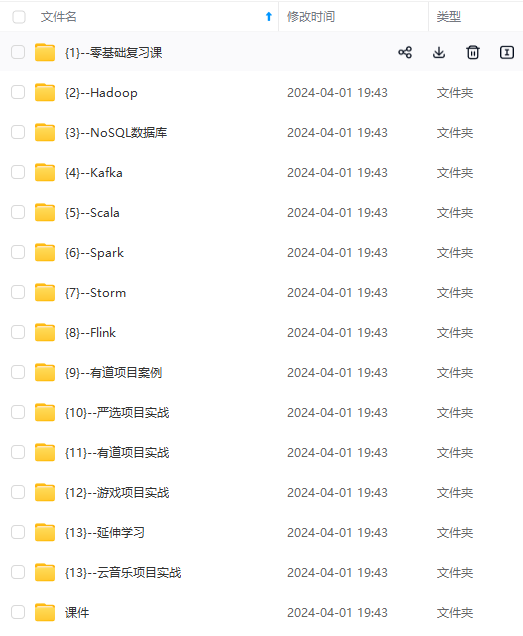

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

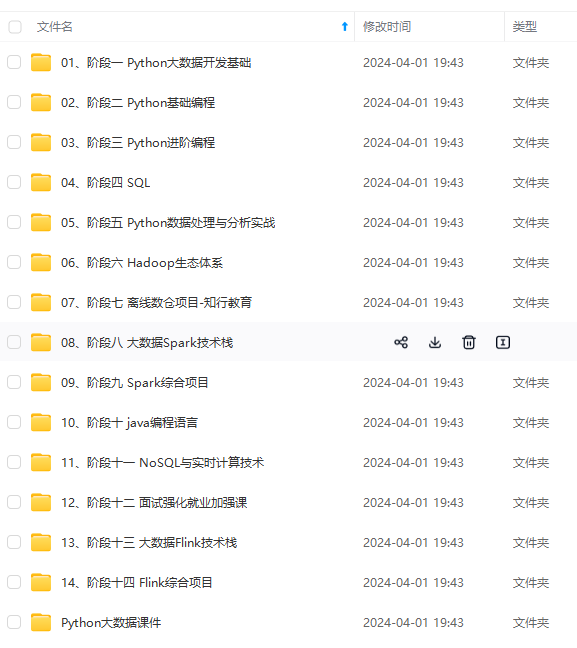

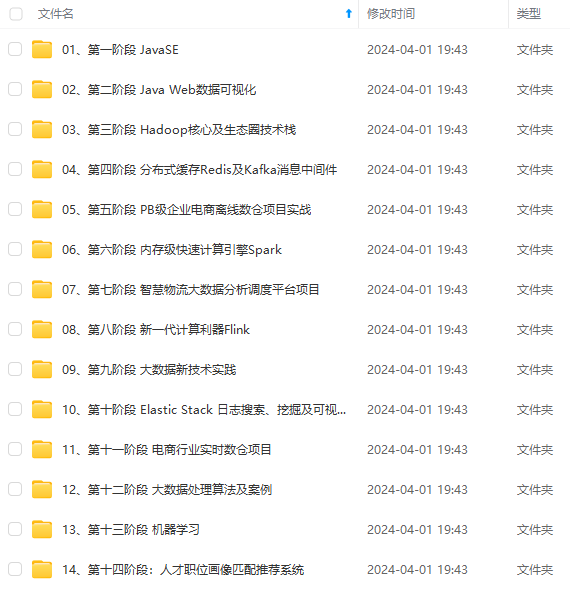

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

环境变量添加完后加载环境变量

#source /etc/profile

9、创建文件存储目录

hadoop01

#mkdir /data/hadoop/hdfs/full/dfs/name -p

hadoop02

#mkdir /data/hadoop/hdfs/full/dfs/namesecondary -p

#mkdir /data/hadoop/hdfs/full/dfs/data -p

hadoop03

#mkdir /data/hadoop/hdfs/full/dfs/data -p

hadoop04

#mkdir /data/hadoop/hdfs/full/dfs/data -p

3.配置

配置时需要修改“/data/hadoop/etc/hadoop”目录下的配置文件,其中HDFS涉及到的配置文件包括workers、core-site.xml、hdfs-site.xml,Yarn涉及到的配置文件包括yarn-site.xml, mapReduce 涉及到的配置文件包括mapred-site.xml、。

- 修改workers文件 该文件内容可以指定某几个节点作为数据节点,默认为localhost,将其删除并修改为如下内容:

hadoop02

hadoop03

hadoop04

2.修改core-site.xml文件

fs.defaultFS:指定namenode的hdfs协议的文件系统通信地址,可以指定一个主机+端口

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://hadoop01:9000</value>

</property>

</configuration>

3.hdfs-site.xml文件

dfs.secondary.http.address:secondarynamenode运行节点的信息,应该和namenode存放在不同节点 dfs.repliction:hdfs的副本数设置,默认为3 dfs.namenode.name.dir:namenode数据的存放位置,元数据存放位置 dfs.datanode.data.dir:datanode数据的存放位置,block块存放的位置

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>/data/hadoop/hdfs/full/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>/data/hadoop/hdfs/full/dfs/data</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>hadoop02:50090</value>

</property>

<property>

<name>dfs.namenode.checkpoint.dir</name>

<value>/data/hadoop/hdfs/full/dfs/namesecondary</value>

</property>

4.修改mapred-site.xml文件 vim mapred-site.xml mapreduce.framework.name:指定mapreduce框架为yarn方式 mapreduce.jobhistory.address:指定历史服务器的地址和端口 mapreduce.jobhistory.webapp.address:查看历史服务器已经运行完的Mapreduce作业记录的web地址,需要启动该服务才行

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>hadoop01:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>hadoop01:19888</value>

</property>

<property>

<name>yarn.app.mapreduce.am.env</name>

<value>HADOOP_MAPRED_HOME=/data/hadoop</value>

</property>

<property>

<name>mapreduce.map.env</name>

<value>HADOOP_MAPRED_HOME=/data/hadoop</value>

</property>

<property>

<name>mapreduce.reduce.env</name>

<value>HADOOP_MAPRED_HOME=/data/hadoop</value>

</property>

5.修改yarn-site.xml文件

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop01</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

6.配置hadoop-env.sh,添加以下内容

export JAVA_HOME=/etc/alternatives/

export HADOOP_HOME=/data/hadoop/

7.分发文件 修改完上面五个文件后,将hadoop01点上的hadoop文件复制到各个结点上。

#scp -r /data/hadoop/etc/hadoop/* hadoop02:/data/hadoop/etc/hadoop/

#scp -r /data/hadoop/etc/hadoop/* hadoop03:/data/hadoop/etc/hadoop/

#scp -r /data/hadoop/etc/hadoop/* hadoop04:/data/hadoop/etc/hadoop/

8.授权hadoop安装目录

#chown -R hadoop /data/hadoop/

4.启动hadoop集群

初始化、启动及停止,只需要在hadoop01执行即可

1.Hadoop初始化

hdfs namenode -format

在初始化过程中,只要看到上面红框里面的信息,有个successfully formatted说明初始化成功。

2.Hadoop集群启动

#start-dfs.sh

#start-yarn.sh

#mapred --daemon start historyserver

3.WEB访问

HDFS的访问地址:http://172.16.126.71:9870/

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?