先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024b (备注运维)

正文

cd basic_demo

streamlit run web_demo_streamlit.py

**首次运行的话到1.4这停止,目的是为了测试大模型是否跑通.**

**下面的1.5 后面会有使用的时机**

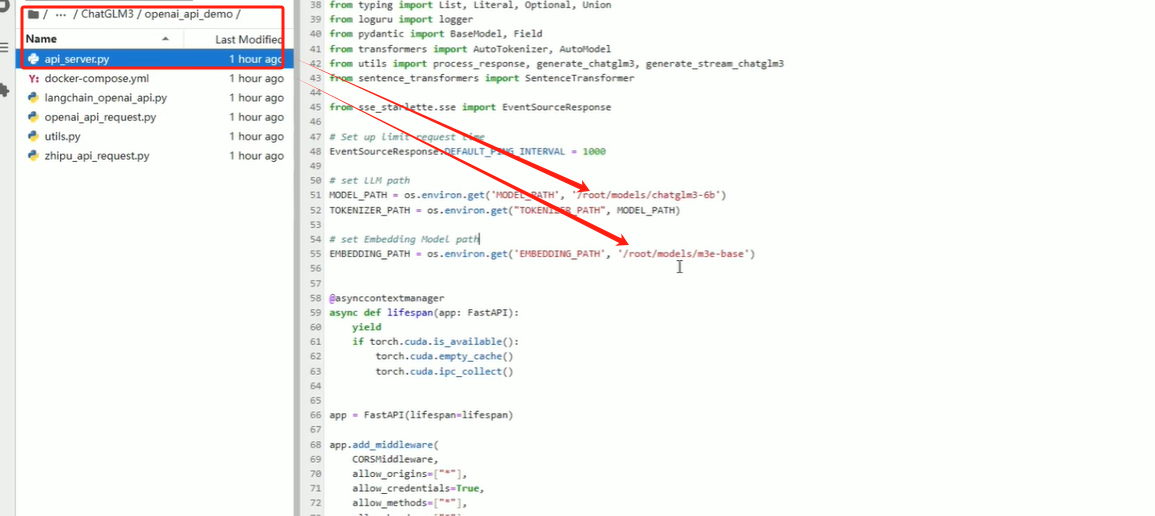

#### 1.5 修改api\_server.py文件

cd ChatGLM3/openai_api_demo

然后找到api_server.py文件夹

修改里面的MODEL_PATH 和 EMBEDDING_PATH 为本地的大模型地址和向量模型地址

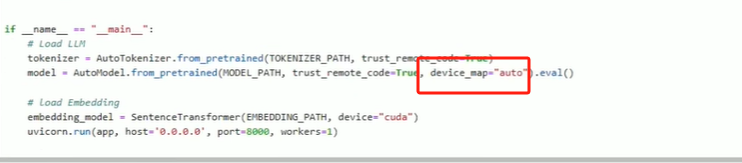

修改文件最下面的`device_map="cuda"`

model = AutoModel.from_pretrained(MODEL_PATH,trust_remote_code=True,device_map=“cuda”).eval()

### 2.下载docker和docker compose

安装 Docker

curl -fsSL https://get.docker.com | bash -s docker --mirror Aliyun

systemctl enable --now docker

安装 docker-compose

curl -L https://github.com/docker/compose/releases/download/v2.20.3/docker-compose-uname -s-uname -m -o /usr/local/bin/docker-compose

chmod +x /usr/local/bin/docker-compose

验证安装

doc

这篇博客详细介绍了如何在本地部署ChatGLM3、m3e大模型,并使用Docker和docker-compose进行管理。步骤包括修改api_server.py配置、安装Docker和docker-compose、启动容器、配置MongoDB副本集,以及初始化和验证运行状态。还提供了获取完整学习资料的方式。

这篇博客详细介绍了如何在本地部署ChatGLM3、m3e大模型,并使用Docker和docker-compose进行管理。步骤包括修改api_server.py配置、安装Docker和docker-compose、启动容器、配置MongoDB副本集,以及初始化和验证运行状态。还提供了获取完整学习资料的方式。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2158

2158

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?