先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新Web前端全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上前端开发知识点,真正体系化!

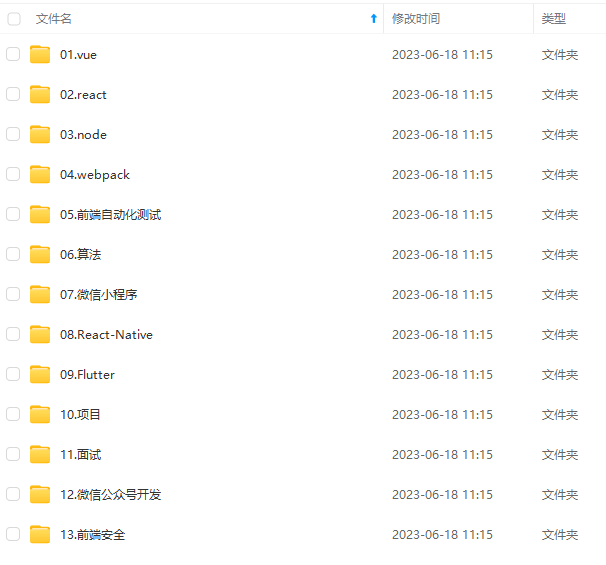

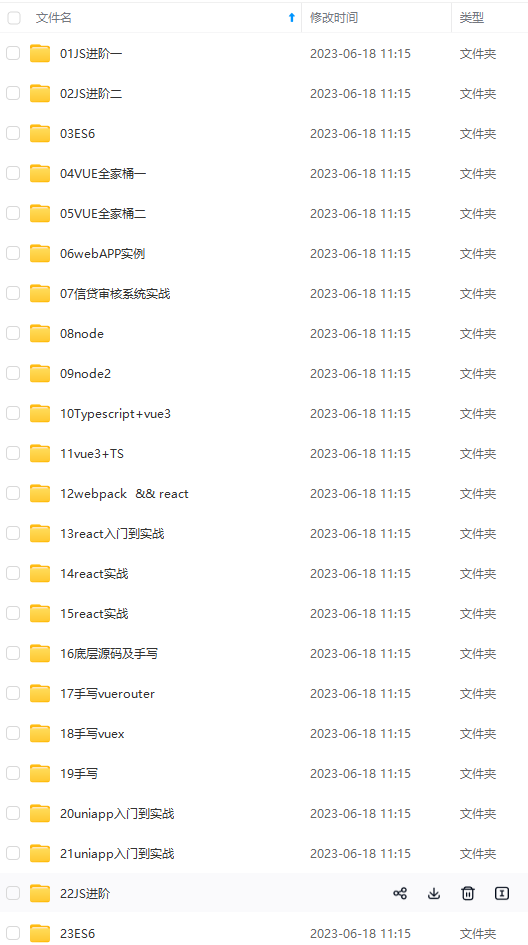

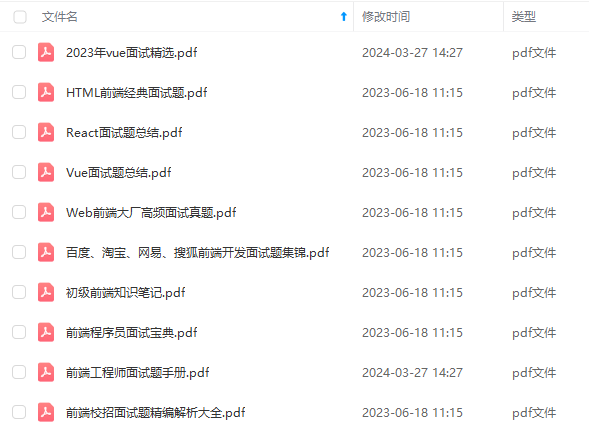

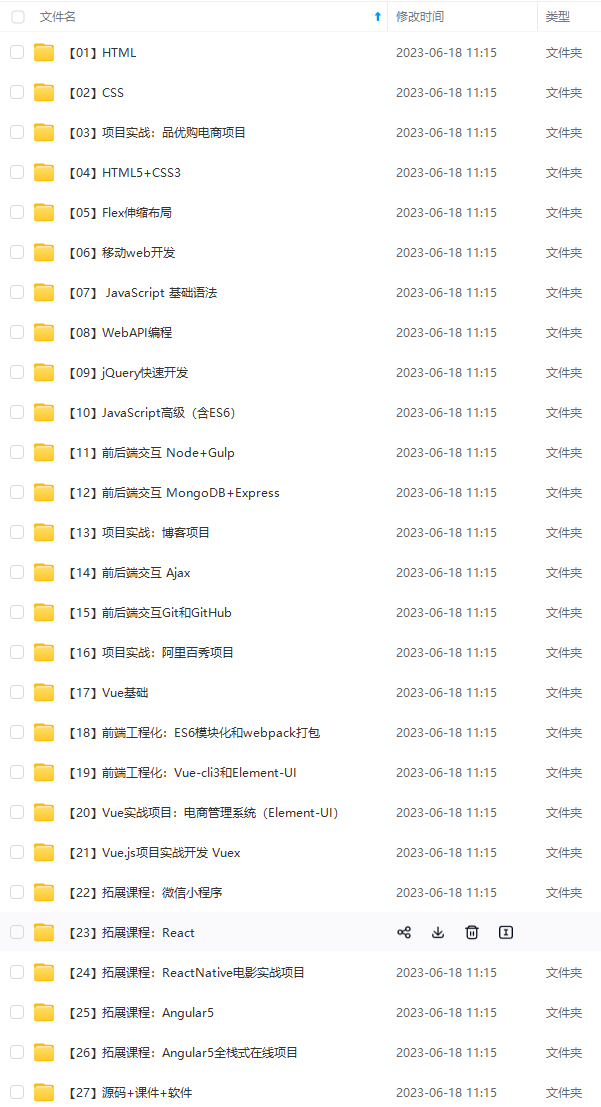

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip1024c (备注前端)

正文

dfs.namenode.rpc-address.jed.nn1

「NAME 1」:9000

dfs.namenode.http-address.jed.nn1

「NAME 1」:50070

dfs.namenode.rpc-address.jed.nn2

「NAME 2」:9000

dfs.namenode.http-address.jed.nn2

「NAME 2」:50070

dfs.namenode.shared.edits.dir

qjournal://「NAME 1」:8485;「NAME 2」:8485;「DataNode HOST n」:8485/jed

dfs.journalnode.edits.dir

「$PATH」/jd

dfs.ha.automatic-failover.enabled

true

dfs.client.failover.proxy.provider.jed

org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider

dfs.ha.fencing.methods

sshfence

shell(/bin/true)

dfs.ha.fencing.ssh.private-key-files

/root/.ssh/id_rsa

dfs.ha.fencing.ssh.connect-timeout

20000

mapred-site.xml

mapreduce.framework.name

yarn

yarn-site.xml

yarn.resourcemanager.ha.enabled

true

yarn.resourcemanager.cluster-id

Cyarn

yarn.resourcemanager.ha.rm-ids

rm1,rm2

yarn.resourcemanager.hostname.rm1

「HashNode HOST 1」

yarn.resourcemanager.hostname.rm2

「HashNode HOST 2」

yarn.resourcemanager.zk-address

「NAME 1」:2181,「NAME 2」:2181,「HashNode HOST n」:2181

===================================================================

进入 hive-0.12.0/conf 目录,复制 hive-env.sh.templaete 为 hive-env.sh:

cd /app/hive-0.12.0/conf

cp hive-env.sh.template hive-env.sh

sudo vi hive-env.sh

分别设置 HADOOP_HOME 和 HIVE_CONF_DIR 两个值:

export HADOOP_HOME=/app/hadoop-1.1.2

export HIVE_CONF_DIR=/app/hive-0.12.0/conf

复制 hive-default.xml.templaete 为 hive-site.xml:

cd /app/hive-0.12.0/conf

cp hive-default.xml.template hive-site.xml

sudo vi hive-site.xml

加入配置项

默认 metastore 在本地,添加配置改为非本地。

hive.metastore.local

false

修改配置项

hive 默认为 derby 数据库,需要把相关信息调整为 mysql 数据库。

hive.metastore.uris

thrift://hadoop:9083

javax.jdo.option.ConnectionURL

jdbc:mysql://hadoop:3306/hive?=createDatabaseIfNotExist=true

javax.jdo.option.ConnectionDriverName

com.mysql.jdbc.Driver

javax.jdo.option.ConnectionUserName

hive

javax.jdo.option.ConnectionPassword

hive

放置到 $HIVE_HOME/lib中

mv mysql-connector-java-5.1.32-bin.jar /opt/home/apache-hive-1.2.1-bin/lib/

把 hive.metastore.schema.verification 配置项值修改为 false。

hive.metastore.schema.verification

false

把 /app/hive-0.12.0/conf/hive-site.xml 文件中的大概在 2000 行位置左右

把原来的 <value>auth</auth> 修改为 <value>auth</value>,如下所示:

hive.server2.thrift.sasl.qop

auth

====================================================================

设置 flume-env.sh 配置文件

在 $FLUME_HOME/conf 下复制改名 flume-env.sh.template 为flume-env.sh,修改 conf/ flume-env.sh 配置文件

cd /app/flume-1.5.2/conf

cp flume-env.sh.template flume-env.sh

sudo vi flume-env.sh

修改配置文件内容 :

JAVA_HOME= /app/lib/jdk1.7.0_55

JAVA_OPTS=“-Xms100m -Xmx200m -Dcom.sun.management.jmxremote”

====================================================================

修改 bin/configure-sqoop 配置文件。

cd /app/sqoop-1.4.5/bin

sudo vi configure-sqoop

注释掉 HBase 和 Zookeeper 等检查(除非使用 HBase 和 Zookeeper 等 HADOOP 上的组件)。

如果不存在 sqoop-env.sh 文件,复制 sqoop-env-template.sh 文件,然后修改 sqoop-env.sh 配置文件。

cd /app/sqoop-1.4.5/conf

cp sqoop-env-template.sh sqoop-env.sh

sudo vi sqoop-env.sh

设置 hadoop 运行程序所在路径和 hadoop-*-core.jar 路径(Hadoop1.X 需要配置)

export HADOOP_COMMON_HOME=/app/hadoop-1.1.2

export HADOOP_MAPRED_HOME=/app/hadoop-1.1.2

编译配置文件 sqoop-env.sh 使之生效。

====================================================================

Kafka所有的配置文件都在“** K A F K A H O M E / c o n f i g ∗ ∗ ” 目 录 下 , 修 改 以 下 配 置 文 件 前 , 需 要 切 换 到 “ KAFKA_HOME/config**”目录下,修改以下配置文件前,需要切换到“ KAFKAHOME/config∗∗”目录下,修改以下配置文件前,需要切换到“KAFKA_HOME/config”目录。

cd $KAFKA_HOME/config

vim server.properties

内容修改如下:

broker.id=0

port=6667

host.name=agent1

log.dirs=/data/data1/kafka

zookeeper.connect=agent1:2181,agent2:2181,agent3:2181

| 其中,参数host.name可填写agent1对应的IP地址,log.dirs为实际的存储数据路径。

登录agent2,修改server.properties。

vim server.properties

内容修改如下:

broker.id=1

host.name=agent2 #可填对应的IP地址

登录agent3,修改server.properties。

vim server.properties

内容修改如下:

broker.id=2

host.name=agent3 #可填对应的IP地址

====================================================================

Spark所有的配置文件都在“** S P A R K H O M E / c o n f ∗ ∗ “ 目 录 下 , 修 改 以 下 配 置 文 件 前 , 切 换 到 “ SPARK_HOME/conf**“目录下,修改以下配置文件前,切换到“ SPARKHOME/conf∗∗“目录下,修改以下配置文件前,切换到“SPARK_HOME/conf”目录。

cd $SPARK_HOME/conf

- 以spark-env.sh.template为模板,拷贝一份命名为spark-env.sh。

cp spark-env.sh.template spark-env.sh

- 编辑spark-env.sh文件。

export JAVA_HOME=/usr/local/jdk8u252-b09

export HADOOP_HOME=/usr/local/hadoop

export SCALA_HOME=/usr/local/scala

export HADOOP_CONF_DIR=/usr/local/hadoop/etc/hadoop export HDP_VERSION=3.1.0

修改文件

echo “spark.master yarn” >> spark-defaults.conf

echo “spark.eventLog.enabled true” >> spark-defaults.conf

echo “spark.eventLog.dir hdfs://server1:9000/spark2-history” >> spark-defaults.conf

echo “spark.eventLog.compress true” >> spark-defaults.conf

echo “spark.history.fs.logDirectory hdfs://server1:9000/spark2-history” >> spark-defaults.conf

同步hadoop的core-site.xml和hdfs-site.xml

同步文件

cp /usr/local/hadoop/etc/hadoop/core-site.xml /usr/local/spark/conf

cp /usr/local/hadoop/etc/hadoop/hdfs-site.xml /usr/local/spark/conf

同步文件

cp /usr/local/hive/lib/mariadb-java-client-2.3.0.jar /usr/local/spark/jars

Hbase

HBase所有的配置文件都在“HBASE_HOME/conf”目录下,修改以下配置文件前,切换到“HBASE_HOME/conf”目录。

cd $HBASE_HOME/conf

修改环境变量JAVA_HOME为绝对路径,HBASE_MANAGES_ZK设为false。

export JAVA_HOME=/usr/local/jdk8u252-b09

export HBASE_MANAGES_ZK=false

export HBASE_LIBRARY_PATH=/usr/local/hadoop/lib/native

vim hbase-site.xml

添加或修改configuration标签范围内的部分参数。

hbase.rootdir

hdfs://server1:9000/HBase

hbase.tmp.dir

/usr/local/hbase/tmp

hbase.cluster.distributed

true

hbase.unsafe.stream.capability.enforce

false

hbase.zookeeper.quorum

agent1:2181,agent2:2181,agent3:2181

hbase.unsafe.stream.capability.enforce

false

vim regionservers

将regionservers文件内容替换为agent节点IP(可用主机名代替)。

agent1

agent2

最后

一个好的心态和一个坚持的心很重要,很多冲着高薪的人想学习前端,但是能学到最后的没有几个,遇到困难就放弃了,这种人到处都是,就是因为有的东西难,所以他的回报才很大,我们评判一个前端开发者是什么水平,就是他解决问题的能力有多强。

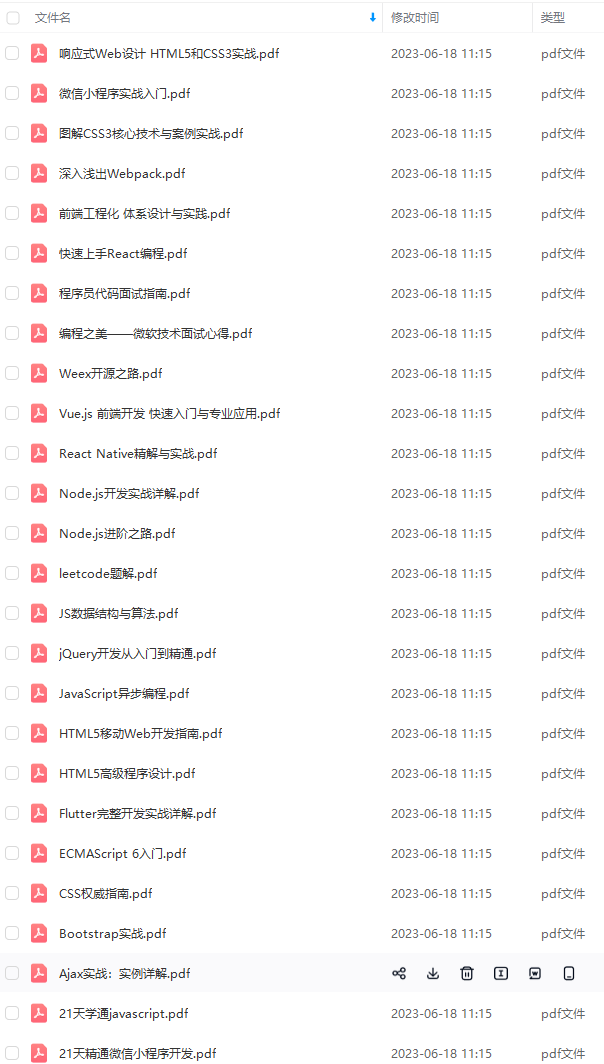

分享一些前端面试题以及学习路线给大家

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注前端)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

capability.enforce

false

hbase.zookeeper.quorum

agent1:2181,agent2:2181,agent3:2181

hbase.unsafe.stream.capability.enforce

false

vim regionservers

将regionservers文件内容替换为agent节点IP(可用主机名代替)。

agent1

agent2

最后

一个好的心态和一个坚持的心很重要,很多冲着高薪的人想学习前端,但是能学到最后的没有几个,遇到困难就放弃了,这种人到处都是,就是因为有的东西难,所以他的回报才很大,我们评判一个前端开发者是什么水平,就是他解决问题的能力有多强。

分享一些前端面试题以及学习路线给大家

[外链图片转存中…(img-4VRSy5tv-1713669287259)]

[外链图片转存中…(img-YZpMrj2i-1713669287260)]

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip1024c (备注前端)

[外链图片转存中…(img-7sZ6l8ti-1713669287260)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

546

546

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?