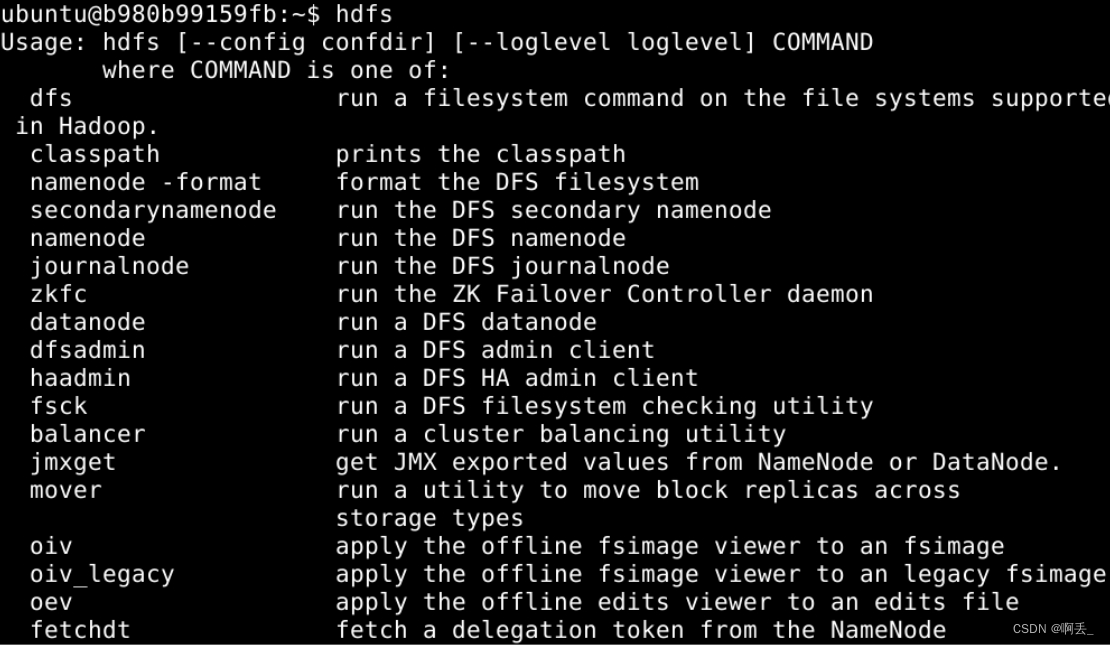

查看hdfs命令:

hdfs会弹出hdfs的相关命令

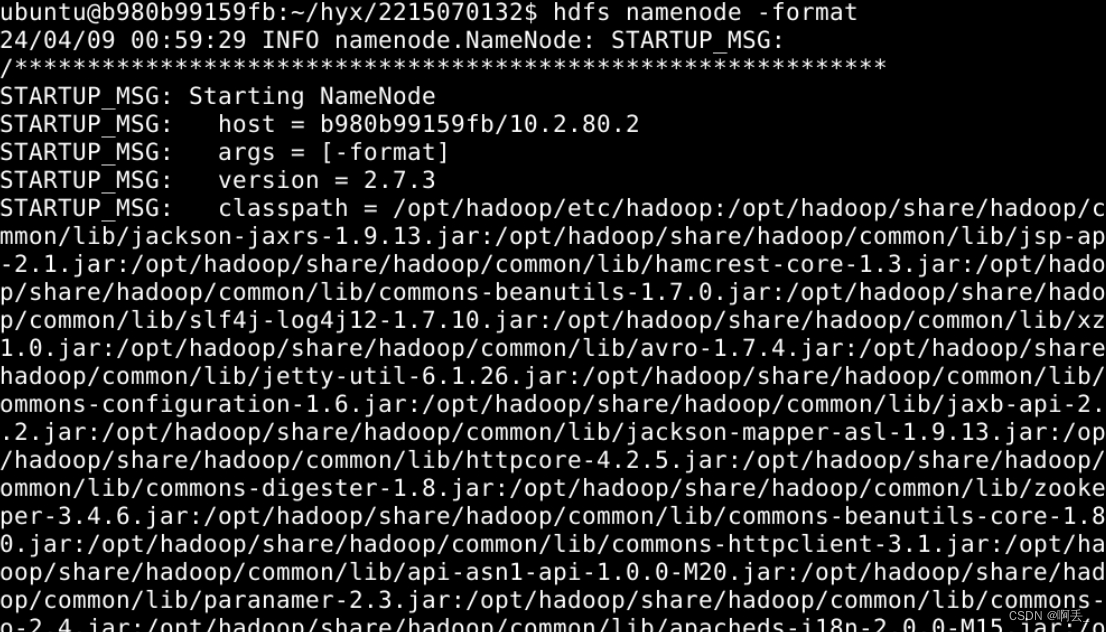

初始化hdfs:

hdfs namenode -format

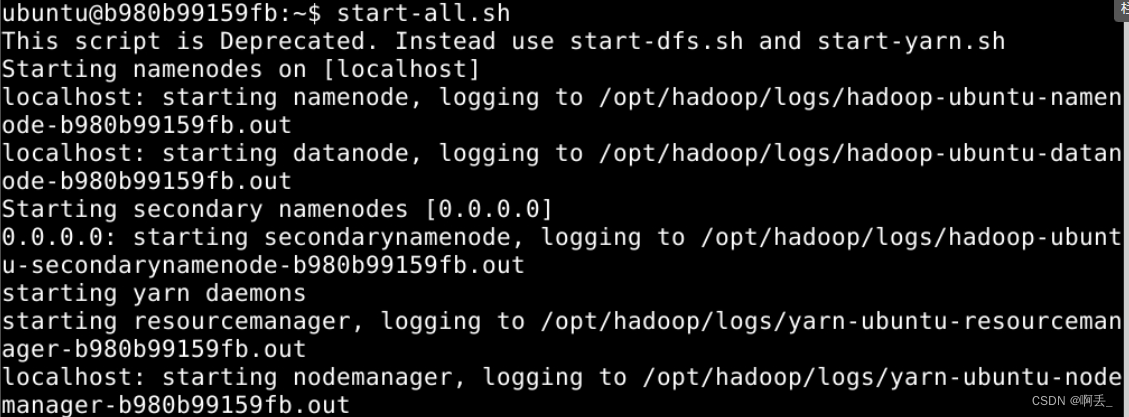

启动hdfs:

start-all.sh

查看jps进程:

jps

如图上所示,才是完整的进程,如果少一个则需要重新部署hdfs,否则可能影响后期的使用

在hdfs下创建一个文件夹:

这里需要在创建的目录前写一个根目录,否则找不到默认的目录导致创建失败

hdfs dfs -mkdir /text

将本地文件上传到hdfs中:put 本地文件 hdfs目录

hdfs dfs -put text/text.txt /text将hdfs文件下载到本地目录下:get hdfs文件 本地目录

hdfs dfs -get /text/text.txt text/text1.txt这里是将hdfs中 text目录下的text.txt文件下载到本地text目录中的text1.txt中去,因为我们本地的text文件中已经存在text.txt所以我们在下载的时候加了个后缀,使其不会冲突.

如果目录下没有文件,可以直接写目录:

hdfs dfs -get /text/text.txt text

从python上传结果到hdfs上

格式:python 运行的Python文件 导入的csv数据 -r hadoop -o 制定路径

python mrtest.py emp.csv -r hadoop -o /output如果导入hdfs上的文件:

为了区分本地路径和hdfs上的路径我们使用:hdfs://来区分路径

python mrtest.py hdfs:///emp.csv -r hadoop -o hdfs:///output

1566

1566

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?