一、算法应用背景

线性回归是机器学习中最基础且应用广泛的算法之一。在现实生活中,许多问题都可以通过线性回归来解决。例如,在经济学领域,预测股票价格、分析经济增长趋势;在房地产行业,根据房屋面积、房龄等因素预测房价;在工业生产中,根据生产要素投入预测产量等。它的主要目的是找到自变量与因变量之间的线性关系,进而进行预测和分析。

二、基本原理

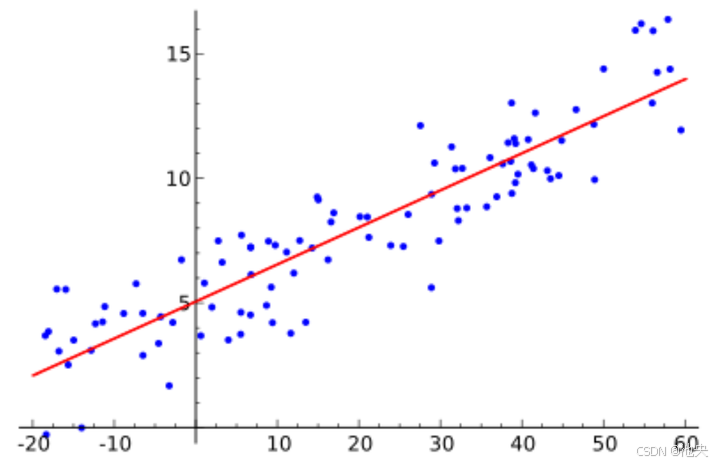

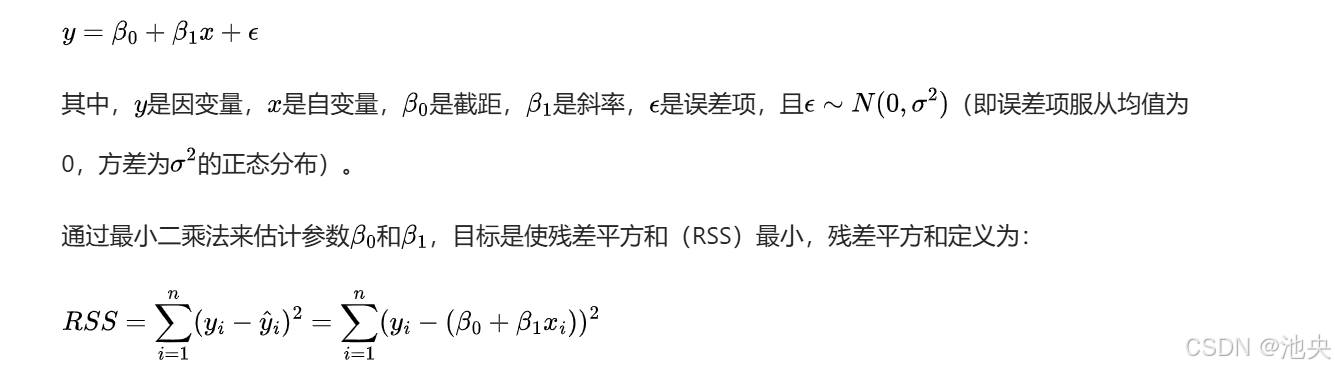

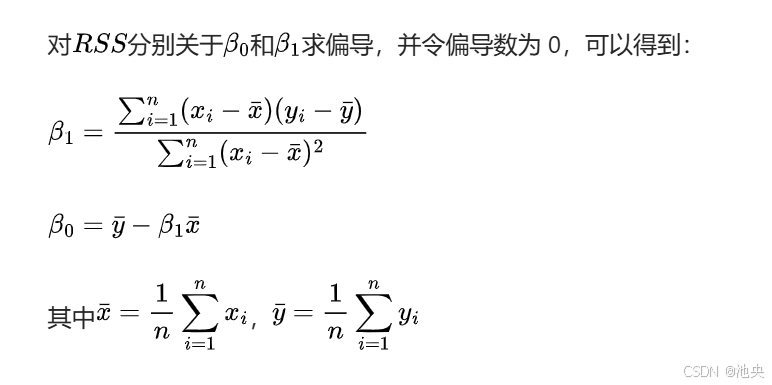

(一)简单线性回归

对于简单线性回归,其模型可以表示为:

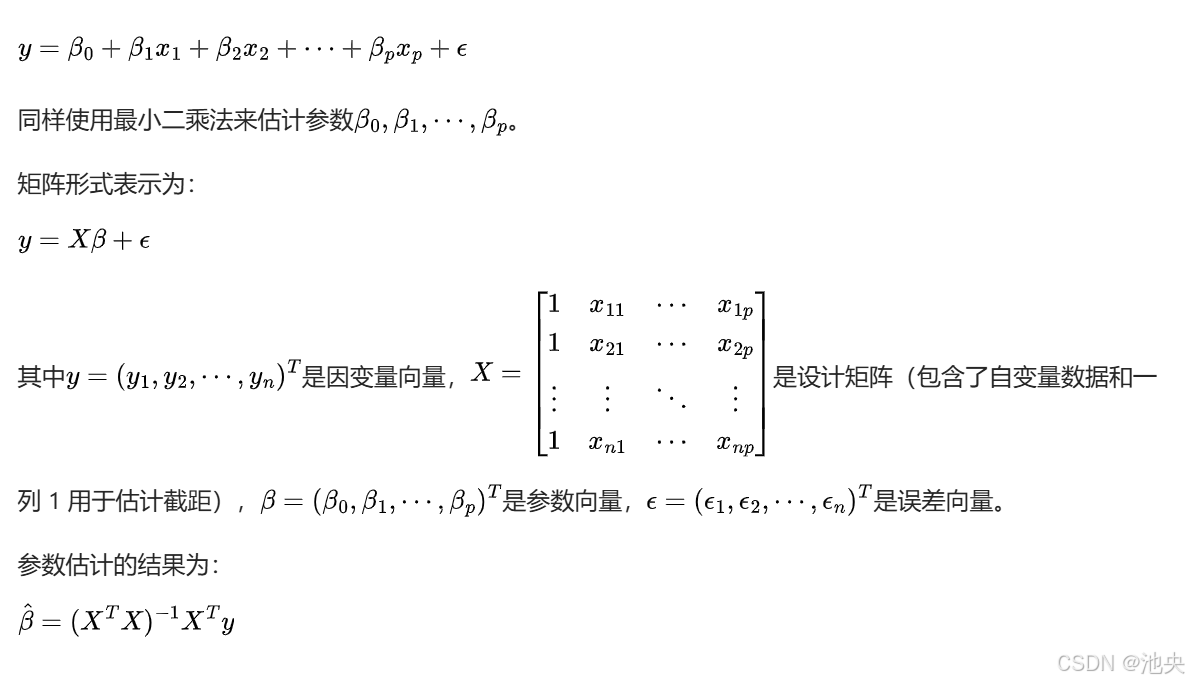

(二)多元线性回归

在多元线性回归中,有多个自变量,模型表示为:

三、算法分析

(一)优点

- 简单易懂

- 线性回归模型基于线性关系假设,其原理和数学推导相对简单,容易被理解和解释。无论是对于数据分析师还是业务人员,都可以较为直观地明白模型的含义。

- 计算效率高

- 特别是在数据量不是特别巨大的情况下,通过最小二乘法求解线性回归模型的参数计算量相对较小,可以快速得到结果。

- 可解释性强

- 模型中的系数有明确的物理意义。例如在简单线性回归中,斜率表示自变量每变化一个单位,因变量的平均变化量;截距表示当自变量为 0 时,因变量的预测值。在多元线性回归中,每个系数表示在其他自变量不变的情况下,该自变量对因变量的影响程度。

(二)缺点

- 线性假设限制

- 实际问题中,变量之间的关系往往是非线性的。如果数据本身不满足线性关系,强行使用线性回归模型会导致拟合效果差,预测准确性低。

- 对异常值敏感

- 由于最小二乘法的目标是最小化残差平方和,异常值(与其他数据点偏离较大的数据)会对参数估计产生较大影响,导致模型的鲁棒性较差。

- 多重共线性问题

- 在多元线性回归中,如果自变量之间存在高度相关性(多重共线性),会导致模型参数估计不稳定,系数的标准误增大,难以准确解释每个自变量对因变量的独立影响。

四、算法实现

(一)使用 Python 实现简单线性回归

import numpy as np

import matplotlib.pyplot as plt

# 生成一些随机数据用于演示

np.random.seed(0)

x = np.random.rand(100)

y = 2 * x+1+ np.random.randn(100) * 0.1

# 计算均值

x_mean = np.mean(x)

y_mean = np.mean(y)

# 计算斜率和截距

beta_1 = np.sum((x - x_mean) * (y - y_mean))/np.sum((x - x_mean) ** 2)

beta_0 = y_mean - beta_1 * x_mean

# 绘制原始数据和拟合直线

plt.scatter(x, y)

x_line = np.linspace(0, 1, 100)

y_line = beta_0 + beta_1 * x_line

plt.plot(x_line, y_line, 'r')

plt.xlabel('x')

plt.ylabel('y')

plt.title('Simple Linear Regression')

plt.show()(二)使用 Python 实现多元线性回归(利用 numpy 和 sklearn)

- 使用 numpy 实现

import numpy as np # 生成随机数据 np.random.seed(0) n = 100 p = 3 X = np.random.rand(n, p) y = 1 + 2 * X[:, 0]+3 * X[:, 1]- 4 * X[:, 2]+ np.random.randn(n) # 添加一列1用于估计截距 X_bias = np.c_[np.ones(n), X] # 计算参数估计 beta_hat = np.linalg.inv(X_bias.T @ X_bias) @ X_bias.T @ y print("Estimated coefficients:", beta_hat) - 使用 sklearn 实现

from sklearn.linear_model import LinearRegression from sklearn.model_selection import train_test_split import numpy as np # 生成随机数据 np.random.seed(0) n = 100 p = 3 X = np.random.rand(n, p) y = 1 + 2 * X[:, 0]+3 * X[:, 1]- 4 * X[:, 2]+ np.random.randn(n) # 划分训练集和测试集 X_train, X_test, y_train, y_test = train_test_split(X, y, test_size = 0.2, random_state = 0) # 创建线性回归模型并拟合 model = LinearRegression() model.fit(X_train, y_train) # 输出模型参数 print("Intercept:", model.intercept_) print("Coefficients:", model.coef_) # 在测试集上进行预测 y_pred = model.predict(X_test)五、线性回归算法总结

线性回归作为机器学习领域的基础算法,在多个行业有着广泛的应用。

从应用背景来看,其能够处理诸如经济、房产、工业生产等众多领域中的预测和分析问题,通过挖掘自变量与因变量间的线性关系来辅助决策。

在基本原理方面,简单线性回归基于一个自变量建立线性方程,通过最小二乘法确定参数;多元线性回归则扩展到多个自变量,以矩阵形式表示并求解参数。

算法分析显示,线性回归具有简单易懂、计算效率高和可解释性强的优点,但也存在线性假设限制、对异常值敏感和可能出现多重共线性问题等不足。

在算法实现上,无论是使用 Python 手动编写代码实现简单线性回归,还是借助 numpy 和 sklearn 库实现多元线性回归,都相对较为直观。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?