下述链接均可点击跳转,手机端打开速度较慢!请耐心等待哦~

专题推荐:论文推荐,代码分享,典藏级代码,视角(点击即可跳转)

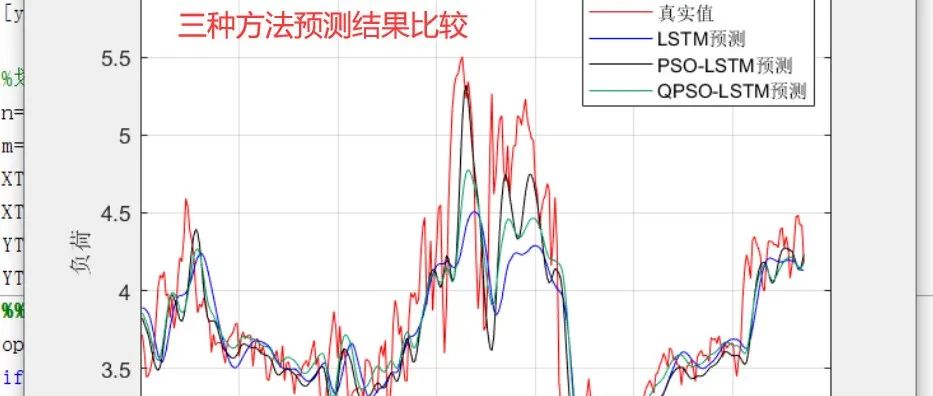

结合智能优化算法的时间序列预测,从入门到创新,从代码实现到发论文,看这篇就够了!(附matlab代码实现) (qq.com)

本文要点:使用LSTM进行时间序列预测优势是什么?为什么要使用智能优化算法优化LSTM的超参数?智能优化算法可以从哪些方面进行创新以提高寻优能力?

智能优化算法可以从哪些方面进行创新以提高寻优能力?最新智能优化算法!小论文创新点有了!可用于优化与预测(附matlab代码实现)

使用LSTM(Long Short-Term Memory)进行时间序列预测的优势主要包括以下几点:

1.长序列依赖处理能力:LSTM通过其独特的门控机制(包括输入门、遗忘门、输出门和单元状态),能够有效地学习和记忆长期依赖关系。这对于很多时间序列数据来说至关重要,因为未来的值往往依赖于过去较远处的信息。

2.防止梯度消失问题:传统循环神经网络(RNN)在处理长序列时容易遇到梯度消失或梯度爆炸问题,而LSTM通过其门控结构设计,能够更好地控制信息的流动和更新,从而缓解了这一难题,使得模型在深层结构中也能稳定训练。

3.良好的学习能力:LSTM能够学习到复杂序列中的模式和特征,因而在诸如机器翻译、语音识别等序列预测任务中表现出色。对于时间序列预测,它能够捕捉到时间上的动态模式,提高预测准确性。

4.适用范围广:LSTM适用于多种类型的时间序列预测,无论是单变量还是多变量,单步还是多步预测,都能灵活应对。这使得它成为从金融市场的股票价格预测到天气预报等多个领域的首选模型。

5.可适应非线性关系:时间序列数据中经常包含非线性关系,LSTM作为一种非线性模型,能够很好地捕捉和模拟这些复杂的关系。

6.并行化处理与优化:虽然LSTM的计算复杂度较高,但现代硬件加速(如GPU)和优化技术(如批处理、梯度裁剪)的应用,使得训练LSTM模型变得更加可行且高效。

综上所述,LSTM在时间序列预测领域的优势主要在于其处理长程依赖的能力、对复杂序列模式的学习能力,以及广泛的适用场景,尽管它可能需要更多的计算资源和较长的训练时间。

使用智能优化算法优化LSTM(Long Short-Term Memory)的超参数是因为手动调整这些参数既费时又低效,且难以找到最优的参数组合。以下是几个关键原因:

1.超参数数量众多:LSTM模型通常涉及多个超参数,比如学习率、批次大小、层数、神经元数量、激活函数类型、正则化参数等。每个参数的不同取值都可能对模型性能产生显著影响。

2.避免局部最优:手动调整或网格搜索等简单方法容易陷入局部最优解,而智能优化算法,如粒子群优化(PSO)、遗传算法(GA)、模拟退火(SA)、鲸鱼算法(WOA)等,能够通过群体搜索和迭代过程,更有效地探索解空间,减少陷入局部最优的风险。

3.提高效率和效果:智能优化算法能够自动且高效地搜索超参数空间,找到能使模型性能最优的参数组合。这不仅节省了人力,还往往能发现比手动调整更好的配置,提升模型的预测精度和泛化能力。

4.自适应学习:许多智能优化算法具有自适应学习机制,可以根据搜索过程中的反馈动态调整搜索策略,从而更快地收敛到全局最优或接近最优的解。

5.解决复杂问题:对于高度非线性、高维度和复杂约束条件下的超参数优化问题,智能优化算法展现了强大的解决问题的能力。

6.减少计算资源需求:虽然某些智能优化算法可能需要大量计算,但相比盲目穷举,它们通常更有效率,尤其是当结合早停(early stopping)等策略时,能够在保证模型性能的同时减少不必要的计算量。

综上所述,智能优化算法优化LSTM超参数可以大幅提升模型训练的效率和预测性能,确保模型在面对实际应用时达到最佳状态。

智能优化算法为了提高其寻优能力和效率,可以从以下几个方面进行创新:

1.初始化策略的改进:改进初始种群的生成方法,比如采用更智能的初始化策略,确保初始解的多样性与质量,同时减少随机性,从而加快收敛速度并提高最终解的质量。例如,基于问题特定知识的初始化或利用历史最优解信息。

2.算法融合与混合策略:将不同智能优化算法的优点结合起来,形成混合算法或复合算法。例如,将遗传算法的全局搜索能力与粒子群优化的快速收敛特性相结合,或者将局部搜索算法嵌入到全局优化算法中,以平衡全局探索与局部开发。

3.自适应参数调整:开发自适应机制来动态调整算法的关键参数,如学习率、交叉概率、变异率等,根据算法运行过程中的性能反馈进行优化,以应对不同的优化问题和搜索阶段的需求。

4.多目标优化:扩展智能优化算法以处理多目标优化问题,通过引入多目标优化机制,如 Pareto 域的搜索、多目标遗传算法等,寻找问题的帕累托最优解集,适用于那些有多个冲突目标需要同时优化的情况。

5.启发式信息与约束处理:集成领域特定的知识或启发式信息,指导搜索过程,同时增强算法处理约束条件的能力,确保解的有效性和可行性。

6.并行与分布式计算:利用并行和分布式计算资源,加速算法的执行,尤其是在大规模优化问题中,通过分解问题空间或并行处理种群,显著减少计算时间和资源消耗。

7.动态适应策略:开发动态调整搜索策略的机制,使算法能够根据搜索过程中的环境变化(如搜索空间的特性变化)或解的质量自动调整其探索与开发策略。

8.深度学习与强化学习集成:将深度学习的表示学习能力与强化学习的决策能力融入智能优化算法中,以提升算法的学习效率和问题解决能力,特别是在复杂环境或高维优化问题上。

9.算法鲁棒性增强:通过引入噪声处理机制、多样性维持策略等,增强算法对噪音数据、外部干扰的抵抗能力,确保算法在不稳定或不确定环境中的稳定表现。

10.理论基础与解释性增强:加强对智能优化算法的理论研究,提供更坚实的理论支撑,同时提高算法的透明度和可解释性,便于用户理解和信任算法的决策过程。

通过上述方面的创新,智能优化算法可以更加高效、准确地解决复杂优化问题,满足不同领域和应用场景的特定需求。

使用LSTM进行时间序列预测有什么优势?如何对LSTM进行改进以提高时间序列预测的准确度?(附matlab代码实现)

时间序列预测方向是不是一个好方向,目前有哪些常用算法与创新点?(附高创新算法matlab代码实现)

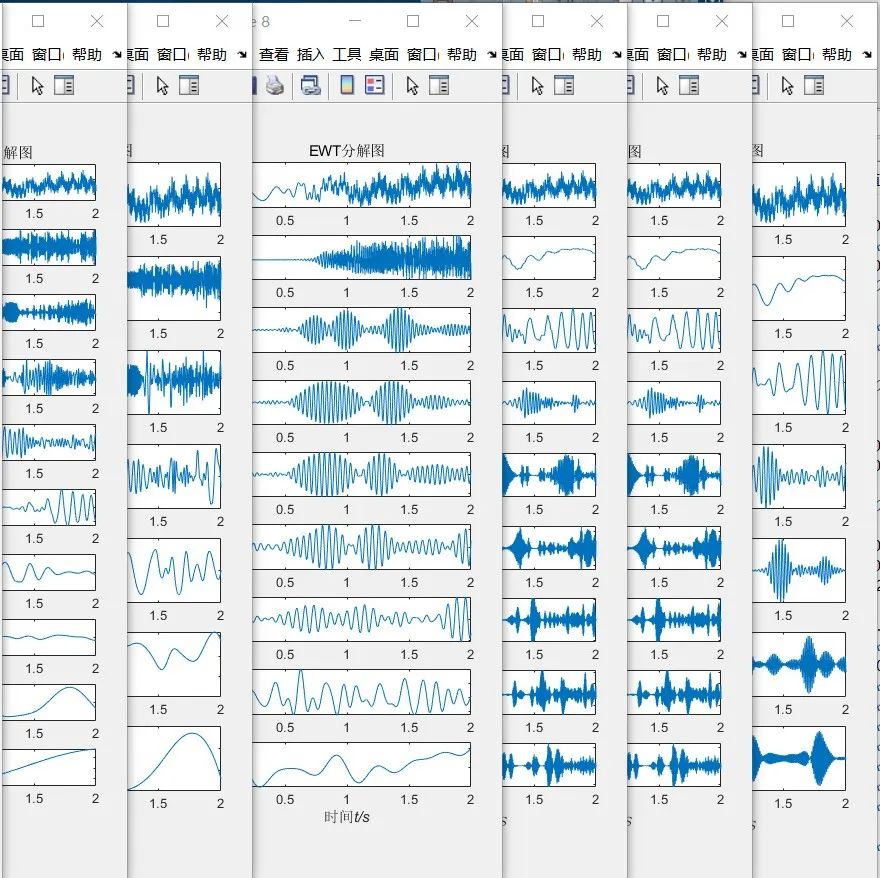

如喝水一样产出创新点!16种时间序列数据模态分解方法,从热门到小众,随意组合!(附matlab代码实现)

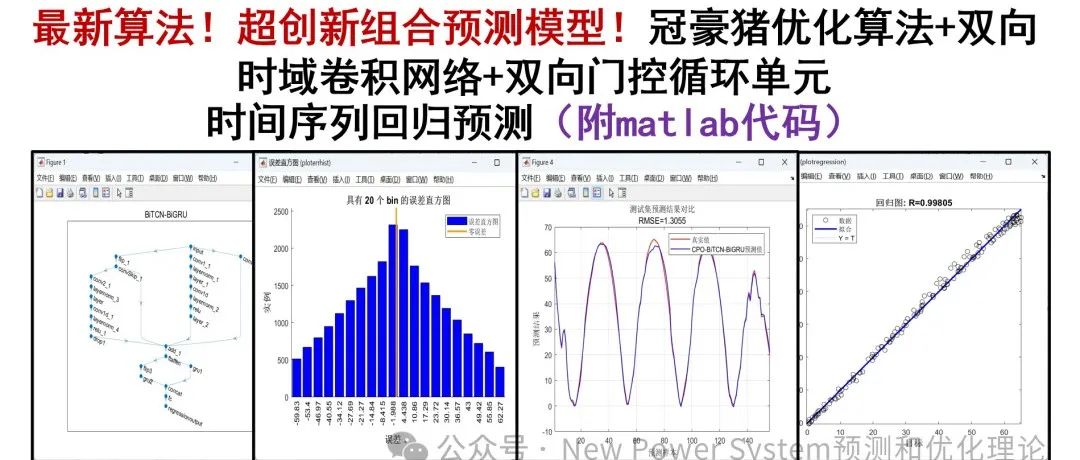

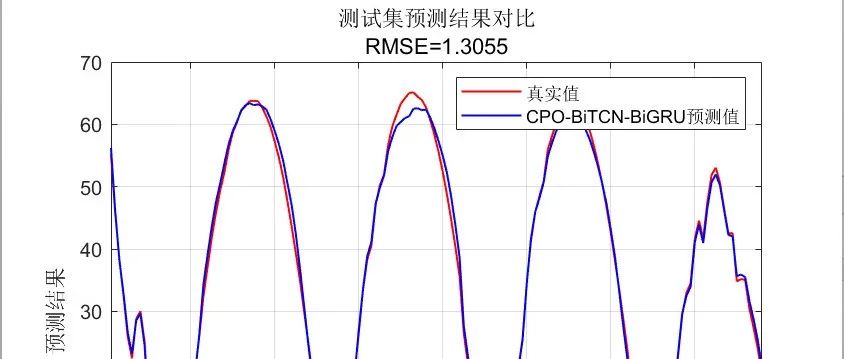

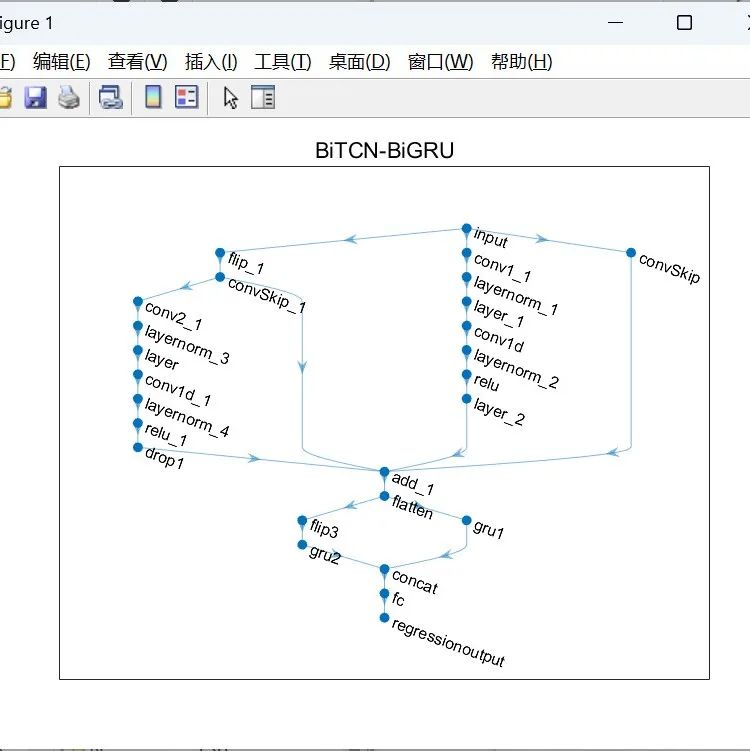

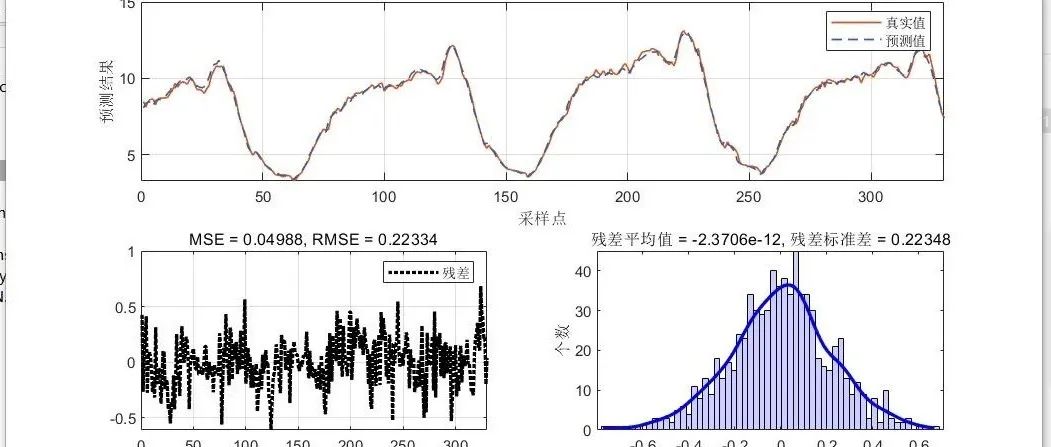

超创新组合预测模型!冠豪猪优化算法+双向时域卷积网络+双向门控循环单元时间序列回归预测(附matlab代码)

超创新!效果超好!开普勒优化算法+双向门控循环单元网络+卷积神经网络+注意力机制的时间序列预测算法(附matlab代码实现)

【免费分享】基于PSO(粒子群算法)-BP神经网络的时间序列预测算法matlab代码

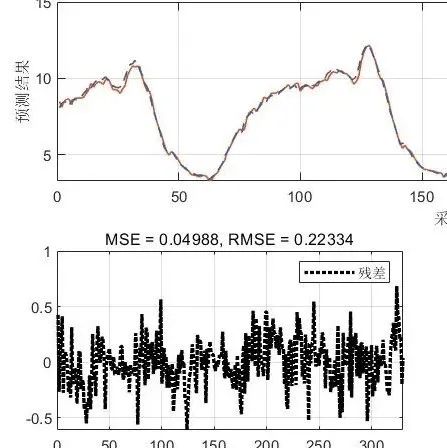

小论文随便发,最新算法!变分模态分解+霜冰算法优化+LSTM时间序列预测(附matlab代码实现)

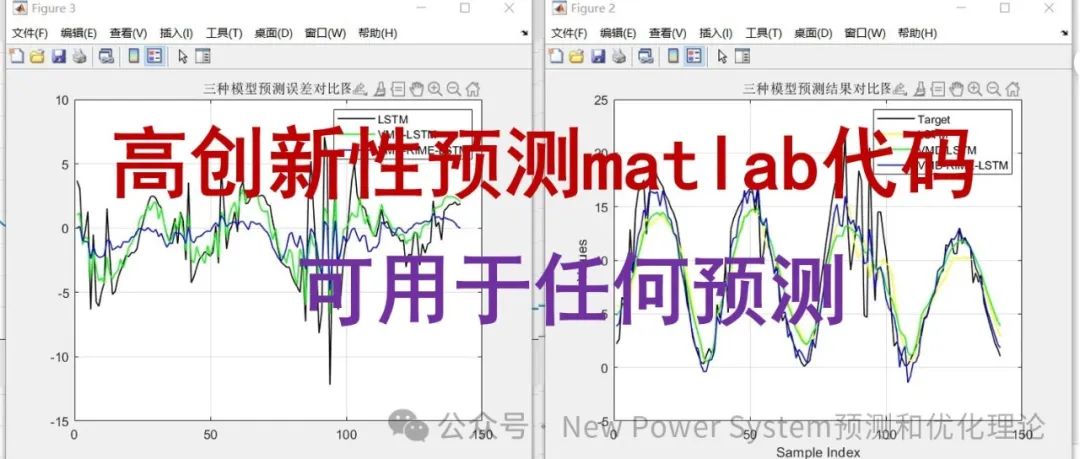

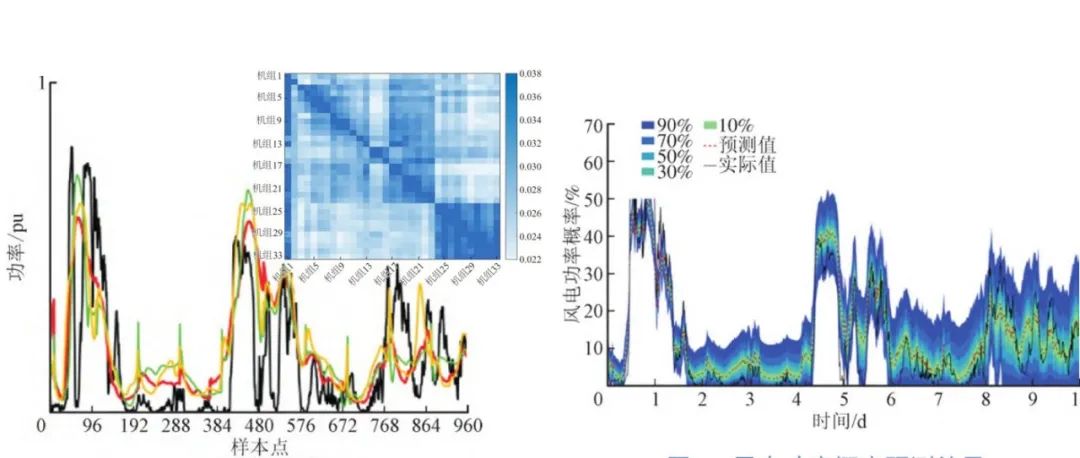

高创新性!风光负荷、电价、碳价、故障诊断、用电模式识别等任意预测,时间序列/回归/分类预测创新性matlab代码,助力科研!

时间序列/回归/分类预测创新性matlab代码,助力科研!可用于电气工程领域风光负荷、电价、碳价、故障诊断、用电模式识别等预测

【代码分享】基于CPO(冠豪猪优化)-BiTCN(双向时域卷积网络)-BiGRU(双向门控循环单元)的多变量时间序列回归预测模型

【代码分享】16种最新时间序列数据模态分解算法,高创新性,与预测算法结合小论文随便发!

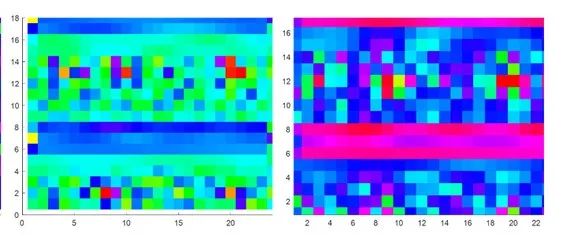

群智能优化算法和模态分解算法在基于深度学习模型时间序列预测中的运用(matlab代码实现)

【代码分享】基于CPO(冠豪猪优化)-BiTCN(双向时域卷积网络)-BiGRU(双向门控循环单元)的多变量时间序列回归预测模型

时间序列/回归/分类预测创新性matlab代码,助力科研!可用于电气工程领域风光负荷、电价、碳价、故障诊断、用电模式识别等预测

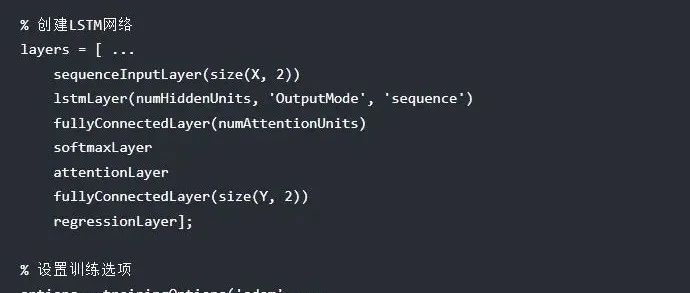

【知识点】什么是注意力机制?时间序列预测中LSTM如何与注意力机制结合?

【知识点】什么是时间序列?怎么用LSTM对时间序列进行预测?LSTM的优缺点是什么?如何对LSTM进行改进?

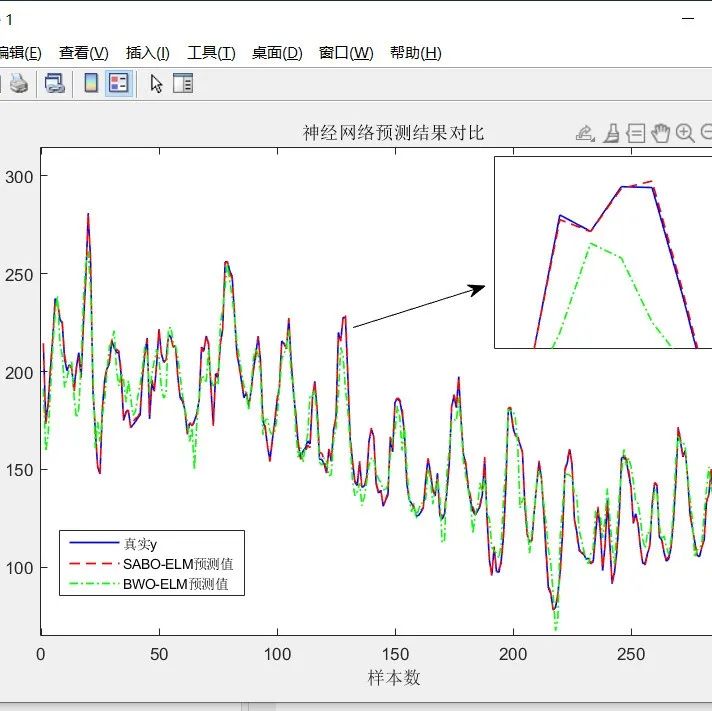

【代码分享】基于减法平均优化器优化算法(SABO)-极限学习机(ELM)的时间序列预测模型

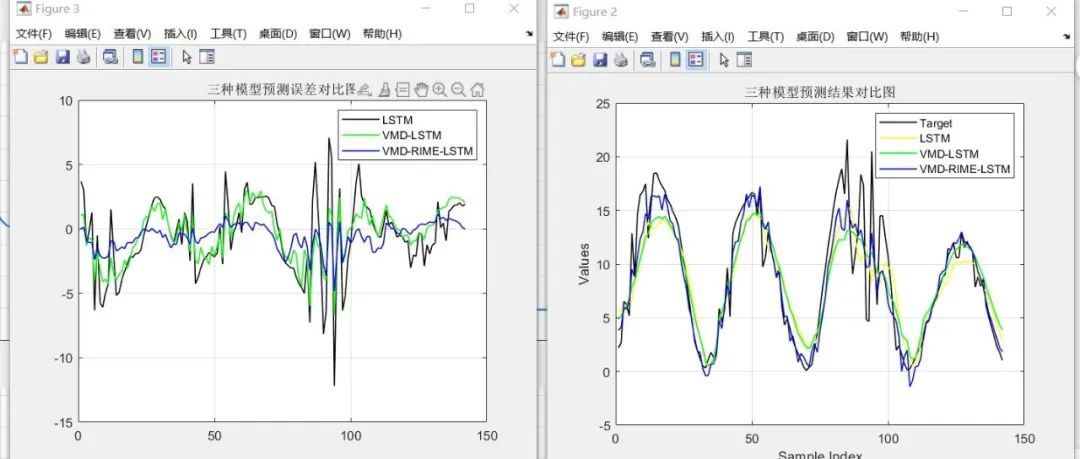

【代码分享】基于VMD(变分模态分解)-RIME(霜冰算法优化)-LSTM的时间序列预测模型

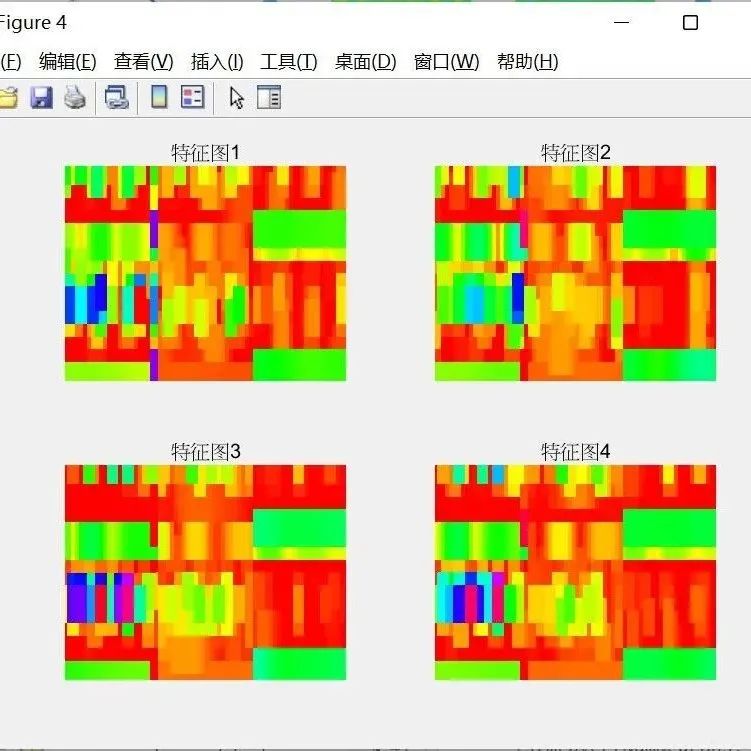

【代码分享】基于RIME-CNN-LSTM-Attention(霜冰算法优化卷积神经网络融合注意力机制)的时间序列回归预测

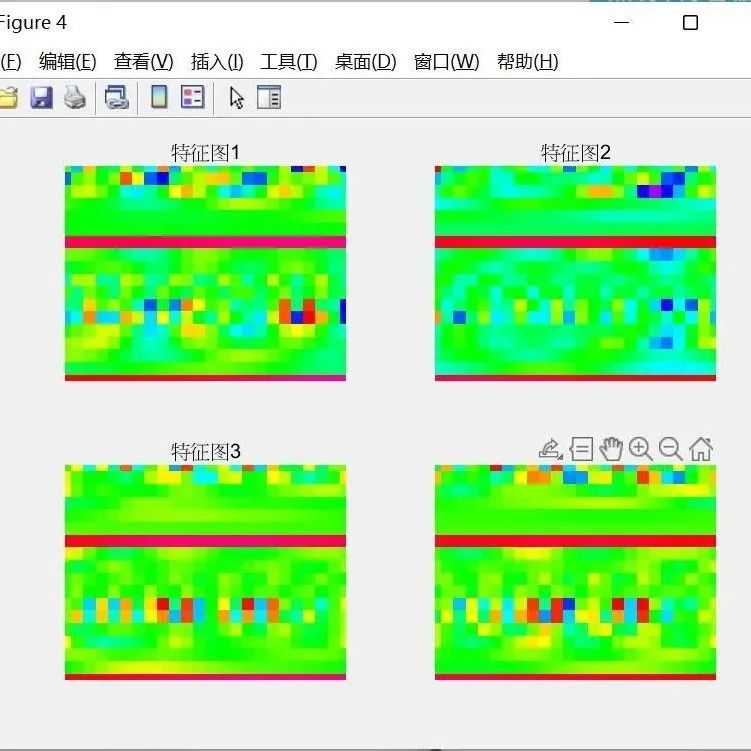

【代码分享】基于KOA-CNN-BiGRU-Attention(开普勒算法优化双向门控循环单元网络融合注意力机制)的时间序列预测

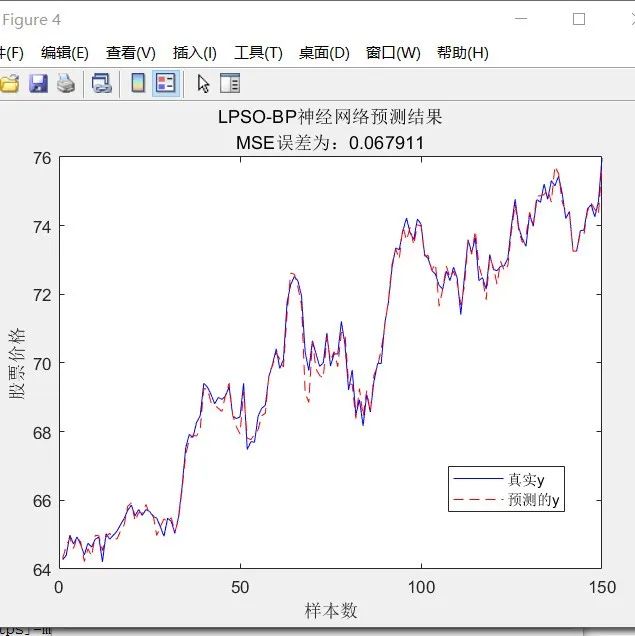

【代码分享】基于改进莱维飞行和混沌映射粒子群优化算法(LPSO)-BP神经网络的时间序列预测模型

【代码分享】CNN-GRU-Attention基于卷积神经网络和门控循环单元网络结合注意力机制的时间序列多变量回归预测

【代码分享】基于KOA-CNN-BiGRU-Attention(开普勒算法优化双向门控循环单元网络融合注意力机制)的时间序列预测

【代码分享】基于RIME-CNN-LSTM-Attention(霜冰算法优化卷积神经网络融合注意力机制)的时间序列回归预测

【代码分享】基于VMD(变分模态分解)-RIME(霜冰算法优化)-LSTM的时间序列预测模型

【代码分享】基于量子粒子群算法(QPSO)优化LSTM的时间序列预测算法

【代码分享】基于融合正余弦和柯西变异的麻雀优化算法(SCSSA)-CNN-BiLSTM(双向长短期记忆网络)的时间序列预测模型

11万+

11万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?