下述链接均可点击跳转,手机端打开速度较慢!请耐心等待哦~

专题推荐:论文推荐,代码分享,典藏级代码,视角(点击即可跳转)

LSTM(Long Short-Term Memory)时间序列预测的基础实现原理主要围绕其独特的网络结构和门控机制,这些设计使得LSTM能够有效地捕获和保留时间序列中的长期依赖信息。以下是LSTM进行时间序列预测的核心概念和步骤:

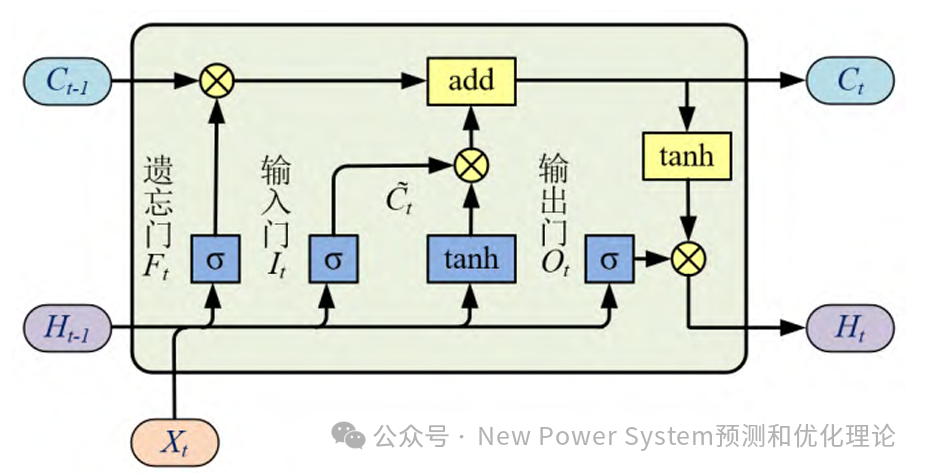

LSTM结构基础

LSTM单元由以下关键组件构成:

-

输入门(Input Gate):决定新信息有多少要加入到单元状态中。

-

遗忘门(Forget Gate):决定单元状态中哪些信息需要被遗忘。

-

细胞状态(Cell State):这是LSTM的记忆单元,能够存储长期依赖信息。输入门添加新信息,遗忘门移除不再需要的信息。

-

输出门(Output Gate):控制细胞状态中有多少信息要输出到下一个时间步,作为当前时间步的隐藏状态。

时间序列预测流程

-

数据预处理:首先,将时间序列数据转换为监督学习问题,通常涉及数据标准化、序列切割成样本(输入-输出对)、滑动窗口技术等。例如,如果要预测未来一个时间点的值,可能需要前n个时间点的数据作为输入。

-

模型构建:利用如Keras或PyTorch等框架,创建一个包含LSTM层的神经网络模型。模型通常包括一个或多个LSTM层,随后可能接有全连接层(Dense Layers)以生成最终预测。模型架构(如LSTM层数、每个层的单元数等)根据问题复杂度和数据特性而定。

-

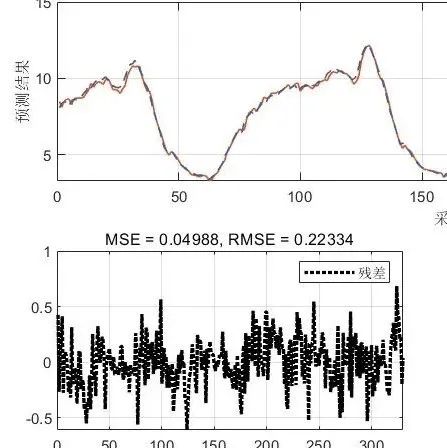

训练:用历史数据训练模型,通过反向传播和梯度下降(或其他优化器)调整权重以最小化预测误差。损失函数(如均方误差MSE)衡量预测值与真实值之间的差异。

-

预测:

-

点到点直接预测:直接输入一个测试样本,模型输出对应的一个预测值。

-

滚动预测:对每个新的预测,将前一步的预测值作为下一次预测的输入之一,不断“滚动”进行多步预测。

-

滑动窗口+滚动预测:在每次预测后,滑动窗口向前移动,更新输入序列,进行连续的多步预测。

-

-

评估与调整:使用诸如均方误差(MSE)、平均绝对误差(MAE)或其它指标评估模型性能,并根据需要调整模型参数或结构。

通过上述过程,LSTM能够学习时间序列中的模式并据此对未来值进行预测,特别适合处理含有长期依赖性的序列数据,如股票价格、天气预报等场景。

在MATLAB中实现LSTM进行时间序列预测,可以使用sequenceDatastore来处理序列数据,以及深度学习工具箱中的lstmLayer来定义LSTM层,再配合其他必要的深度学习层构建模型。下面是一个简单的示例,展示如何使用MATLAB创建一个基本的LSTM模型并应用于时间序列预测任务:

1 % 假设你已经有了一个时间序列数据X,其中X是一个numTimeSteps*numFeatures的矩阵

2% 其中numTimeSteps是时间步数量,numFeatures是每个时间步的特征数量

3% Y是对应的标签数据,假设我们预测单个值,Y是一个numTimeSteps*1的向量

4

5% 数据预处理:分割训练集和测试集

6splitRatio = 0.8; % 80%数据用于训练,20%用于测试

7numSamples = size(X, 1);

8numTrainSamples = round(splitRatio * numSamples);

9XTrain = X(1:numTrainSamples, :);

10YTrain = Y(1:numTrainSamples);

11XTest = X(numTrainSamples+1:end, :);

12YTest = Y(numTrainSamples+1:end);

13

14% 创建序列数据存储对象

15dsTrain = sequenceDatastore(XTrain, YTrain, 'SequenceLength', numTimeSteps);

16dsTest = sequenceDatastore(XTest, YTest, 'SequenceLength', numTimeSteps);

17

18% 定义LSTM网络架构

19numFeatures = size(X, 2); % 特征数量

20numHiddenUnits = 100; % LSTM隐藏层单元数

21numClasses = 1; % 预测任务,假设为回归问题则为1

22

23layers = [

24 sequenceInputLayer(numFeatures)

25 lstmLayer(numHiddenUnits, 'OutputMode', 'last')

26 fullyConnectedLayer(numClasses)

27 regressionLayer

28];

29

30% 训练选项

31options = trainingOptions('adam', ...

32'MaxEpochs', 100, ...

33'MiniBatchSize', 64, ...

34'Shuffle', 'every-epoch', ...

35'Verbose', false, ...

36'Plots', 'training-progress');

37

38% 训练模型

39net = trainNetwork(dsTrain, layers, options);

40

41% 预测

42YPredTrain = predict(net, dsTrain);

43YPredTest = predict(net, dsTest);

44

45% 可以进一步计算预测误差等指标

LSTM时间序列预测的改进与创新可以从多个角度进行,以下是一些常用的方法和技术:

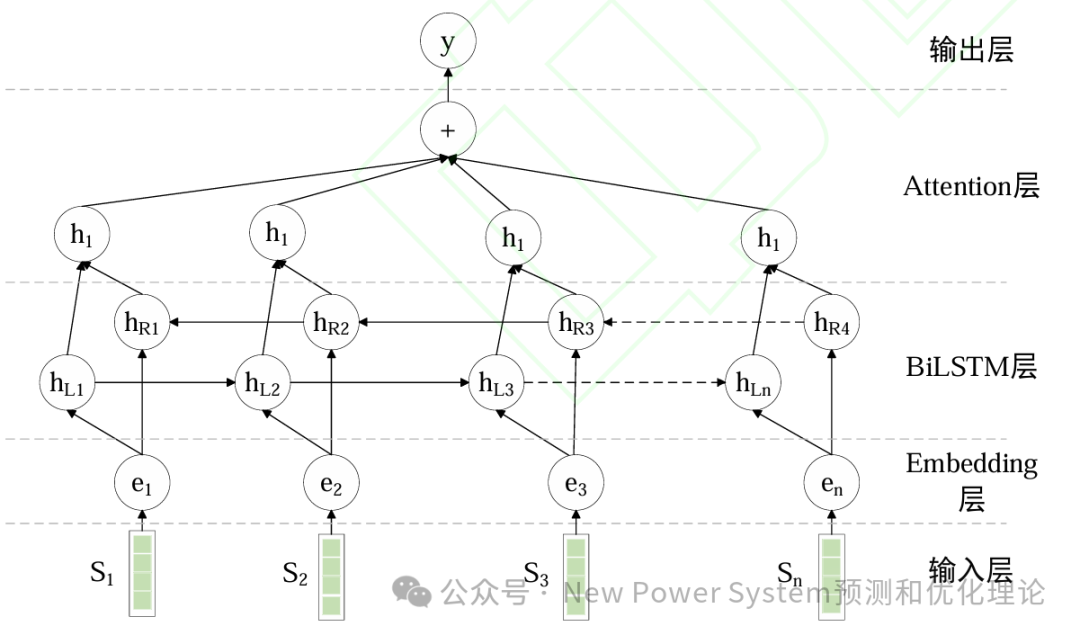

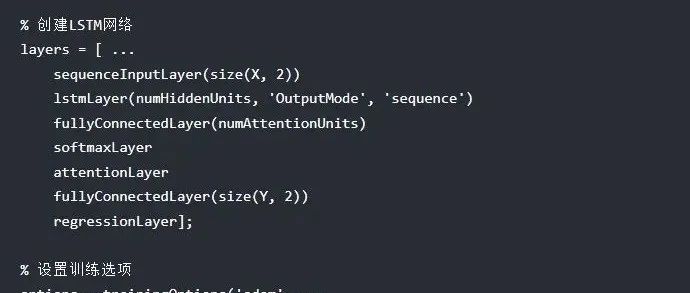

1.注意力机制(Attention Mechanisms):在LSTM基础上引入注意力机制,允许模型在处理序列数据时动态地聚焦于不同的时间步,特别是对于那些对预测更为关键的部分。这提高了模型处理复杂序列特征的能力,尤其是在长序列中。

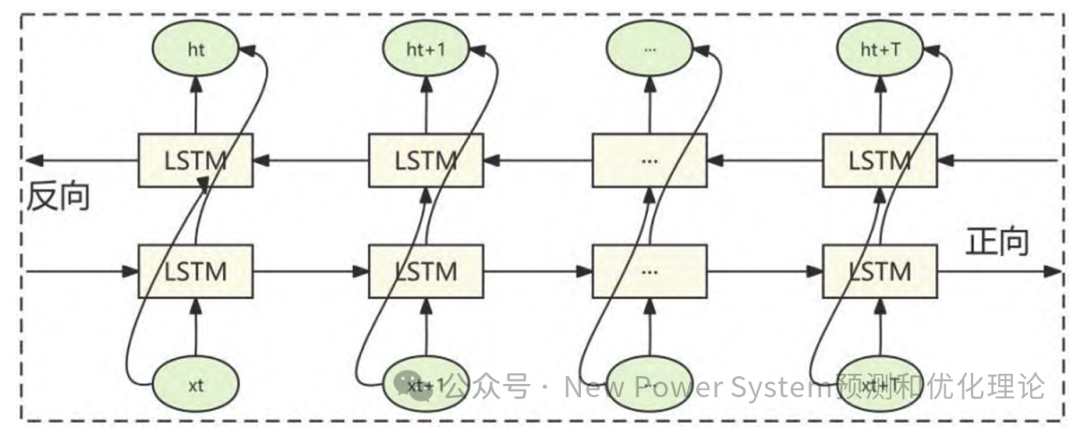

2.双向LSTM(Bi-LSTM):结合正向和反向LSTM,使得模型不仅能够考虑过去的信息,也能捕捉未来的上下文,这对于某些序列预测任务特别有效,比如自然语言处理中的情感分析或时间序列中的趋势预测。

3.多层LSTM(Stacked LSTM):通过堆叠多个LSTM层,模型可以学习更复杂的特征表示,每一层都能从更低层次的抽象中提取更高级别的特征。

4.集成学习(Ensemble Learning):结合多个LSTM模型的预测结果,可以通过投票、平均或者加权平均等方法来提高预测的稳定性和准确性。

5.残差连接(Residual Connections):引入残差连接,如同ResNet中的做法,可以帮助解决深层网络中的梯度消失问题,使得模型能更容易训练,并可能达到更好的性能。

6.变分LSTM(Variational LSTM):在LSTM中引入贝叶斯思想,通过给权重引入概率分布,可以为预测提供不确定性估计,这对于风险敏感的应用尤其重要。

7.混合模型(Hybrid Models):将LSTM与其他类型的模型(如卷积神经网络CNN、GRU等)或经典统计模型(如ARIMA)结合,利用各自的优势,提高预测精度。

8.超参数优化与自动机器学习(Hyperparameter Optimization & AutoML):使用网格搜索、随机搜索、贝叶斯优化等方法自动寻找最佳的超参数配置,或者应用AutoML技术自动设计网络结构,以提升模型性能。

9.外部数据融合(Integration of External Data):将其他相关数据源(如宏观经济指标、社交媒体情绪等)融入模型,以增强模型对环境变化的敏感性和预测能力。

10.进化算法与强化学习优化(Evolutionary Algorithms & Reinforcement Learning):利用遗传算法、粒子群优化等进化算法或强化学习策略来优化LSTM的结构或参数,进一步提升模型效率和预测准确率。

通过这些改进和创新方法,可以针对特定任务定制LSTM模型,使其在时间序列预测领域达到更高的准确性和实用性。

智能优化算法与LSTM(长短期记忆网络)相结合,主要是用来优化LSTM模型的超参数,以提升模型在特定任务上的预测或分类性能。这种结合方式能够自动化地寻找模型的最佳配置,避免了手动试错的繁琐过程。以下是智能优化算法与LSTM结合的一般步骤和概念:

1. 确定优化目标

首先,需要明确优化的目标,通常是预测或分类任务的损失函数(如均方误差MSE、交叉熵损失等),目标是使该损失函数值最小化。

2. 定义超参数空间

LSTM模型中包含多种可调参数,如学习率、批次大小、隐藏层单元数、层数、激活函数类型、正则化参数、Dropout比例等。这些参数构成了优化算法的搜索空间。

3. 选择智能优化算法

根据任务需求和资源限制,选择合适的智能优化算法,如:

-

鲸鱼优化算法(WOA):模拟鲸鱼的社会行为,通过搜索、围攻、泡沫网等操作寻找全局最优解。

-

贝叶斯优化(Bayesian Optimization):利用概率模型(通常是高斯过程)来建模目标函数,并基于此模型指导探索,特别适合黑盒函数优化。

-

麻雀搜索算法(SSA):模仿麻雀觅食和逃避天敌的行为,通过集群、分散和突袭等策略搜索最优解。

-

量子粒子群优化(QPSO):结合量子理论与粒子群优化,通过量子位态和量子旋转操作提高搜索效率。

-

群智能算法:如蚁群优化、粒子群优化等,模拟自然界中的群体行为进行优化。

4. 实现结合

-

初始化优化算法的种群或代理点,每个点代表一组LSTM模型的超参数配置。

-

对于每个超参数配置,训练相应的LSTM模型,并计算目标函数值(如验证集上的损失或准确率)。

-

根据优化算法的规则(如WOA中的追捕、围攻等行为,或是贝叶斯优化中的置信区间更新),更新种群或代理点,生成新的超参数配置。

-

重复上述训练和评估过程,直至满足停止条件(如最大迭代次数、收敛标准等)。

5. 结果应用

找到最优或近似最优的超参数组合后,使用这些参数重新训练LSTM模型,并在测试集上评估最终性能。

实践中的考量

-

计算成本:智能优化算法可能需要大量计算资源,特别是在处理高维度参数空间和大规模数据集时。

-

早停机制:为避免不必要的计算,可以设置早停准则,当验证性能长时间无明显改善时提前终止训练。

-

参数初始化和边界约束:合理设置超参数的初始范围和边界,可以加快收敛速度并避免无效解。

通过这种结合,智能优化算法能够高效地为LSTM模型找到最佳的超参数配置,进而提高模型在各种时间序列预测和序列分析任务上的表现。

专题推荐:论文推荐,代码分享,典藏级代码,视角(点击即可跳转)

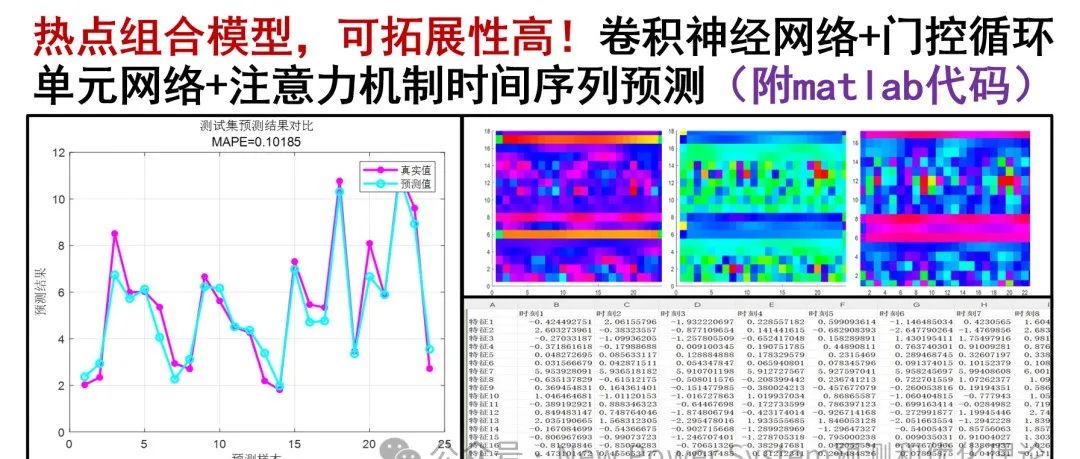

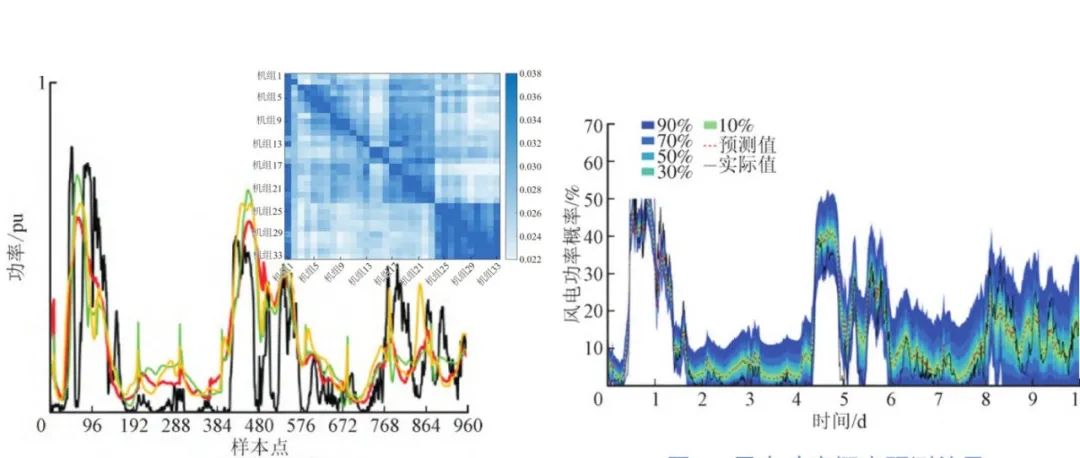

热点组合预测模型,可拓展性高!卷积神经网络+门控循环单元网络+注意力机制时间序列预测(附matlab代码实现)

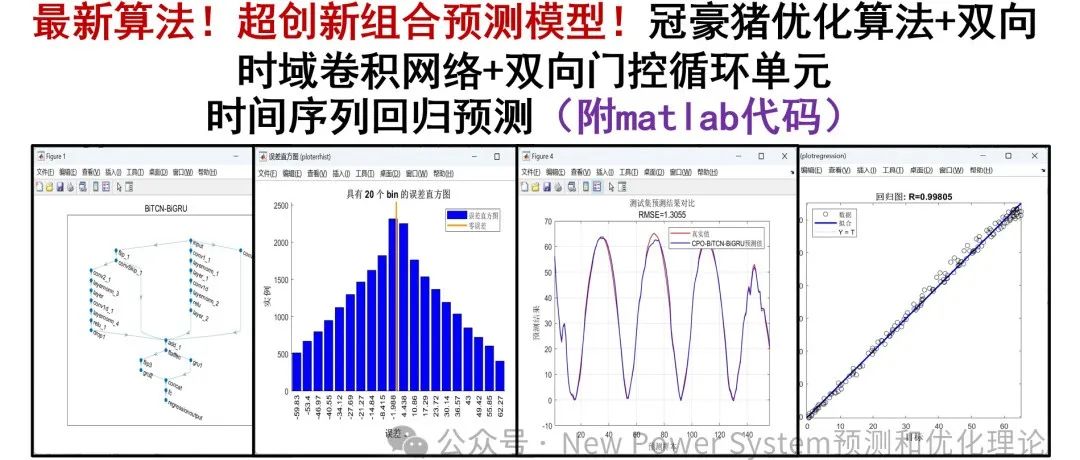

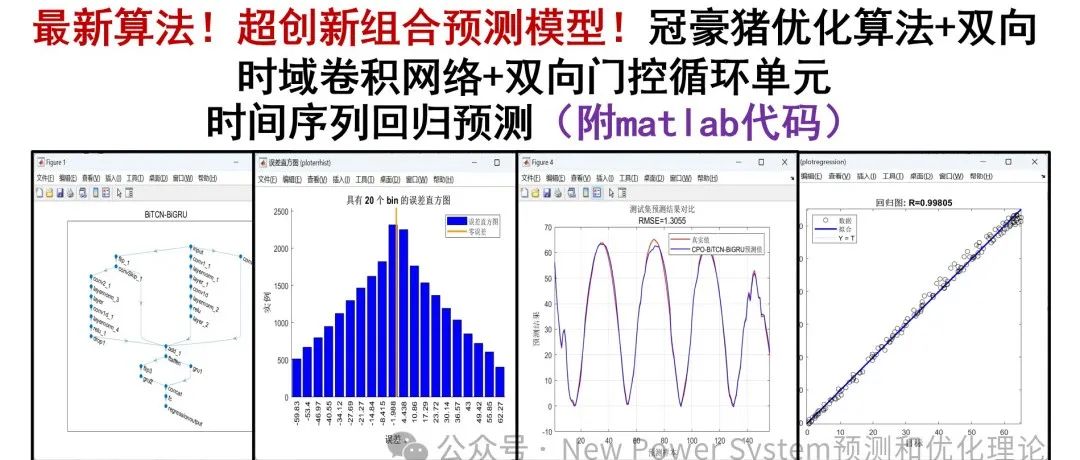

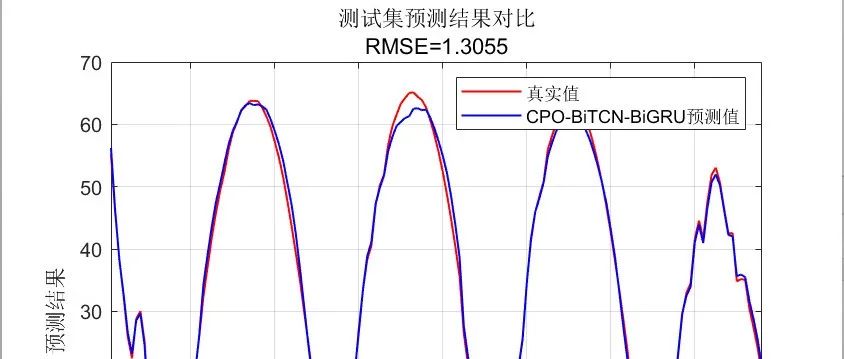

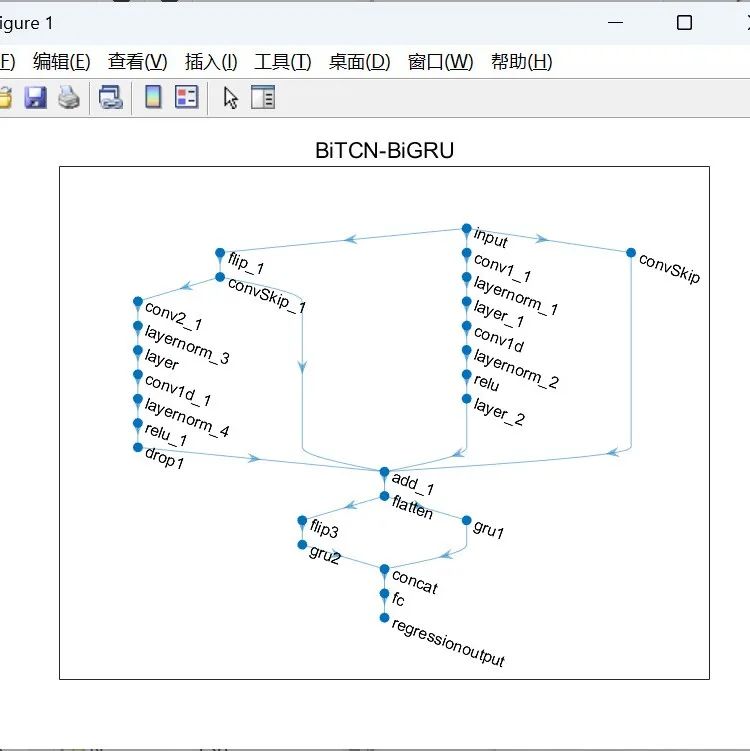

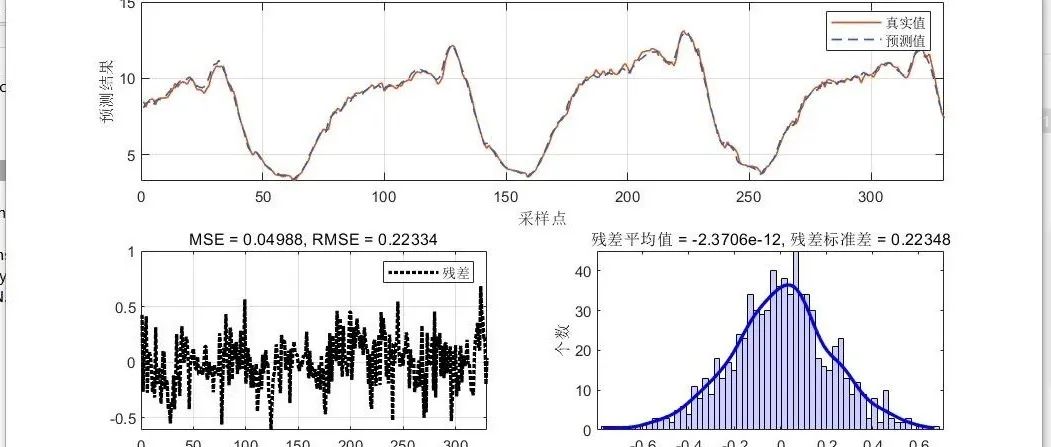

超创新组合预测模型!冠豪猪优化算法+双向时域卷积网络+双向门控循环单元时间序列回归预测(附matlab代码)

听说你还在为时间序列预测方向发不出小论文而烦恼?太不应该了!(附matlab代码实现)

结合智能优化算法的时间序列预测,从入门到创新,从代码实现到发论文,看这篇就够了!(附matlab代码实现)

使用LSTM进行时间序列预测的准确度与哪些因素有关?为什么要用智能算法优化LSTM超参数?(附时间序列预测matlab代码)

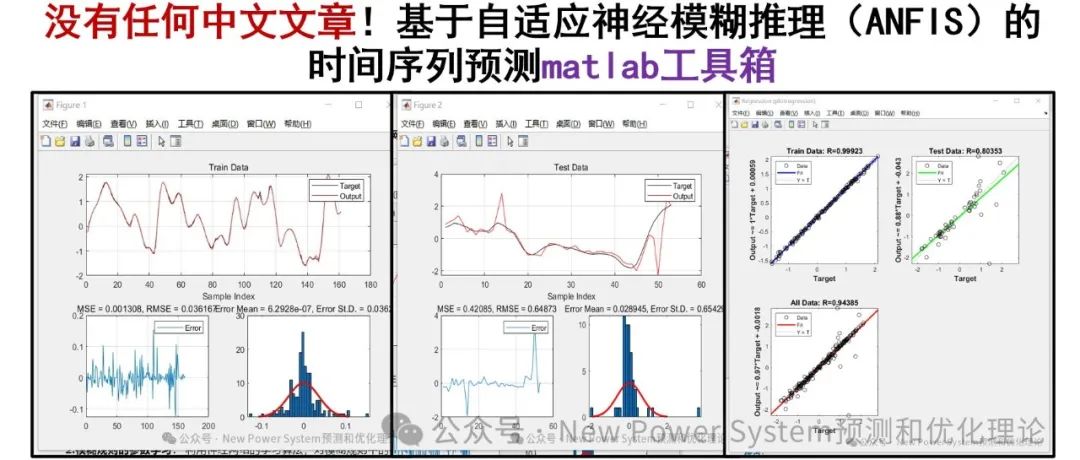

【免费分享】没有任何中文文章!基于自适应神经模糊推理(ANFIS)的时间序列预测matlab工具箱

更新啦!高创新组合模型和算法典藏级matlab代码(电力系统优化和时间序列预测方向)倾情推送24.5.2

使用LSTM进行时间序列预测有什么优势?如何对LSTM进行改进以提高时间序列预测的准确度?(附matlab代码实现)

时间序列预测方向是不是一个好方向,目前有哪些常用算法与创新点?(附高创新算法matlab代码实现)

超创新组合预测模型!冠豪猪优化算法+双向时域卷积网络+双向门控循环单元时间序列回归预测(附matlab代码)

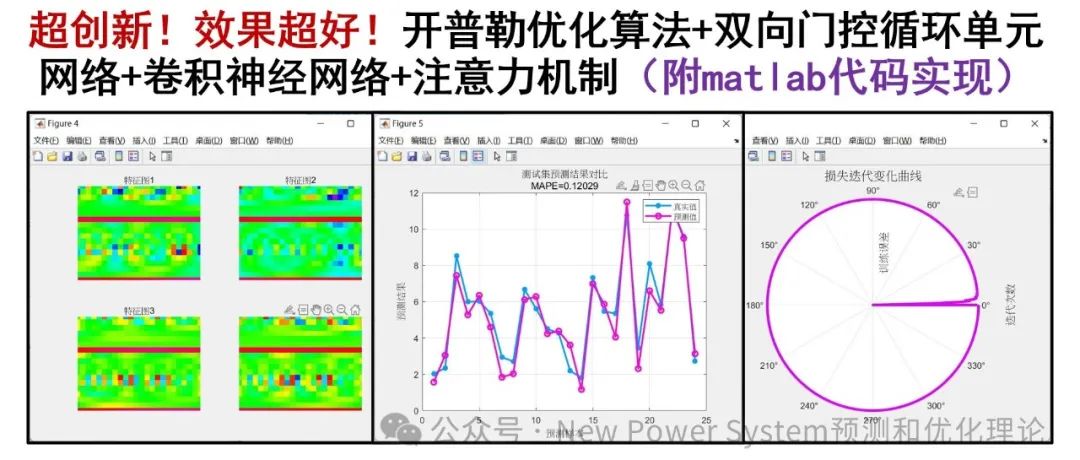

超创新!效果超好!开普勒优化算法+双向门控循环单元网络+卷积神经网络+注意力机制的时间序列预测算法(附matlab代码实现)

【免费分享】基于PSO(粒子群算法)-BP神经网络的时间序列预测算法matlab代码

时间序列/回归/分类预测创新性matlab代码,助力科研!可用于电气工程领域风光负荷、电价、碳价、故障诊断、用电模式识别等预测

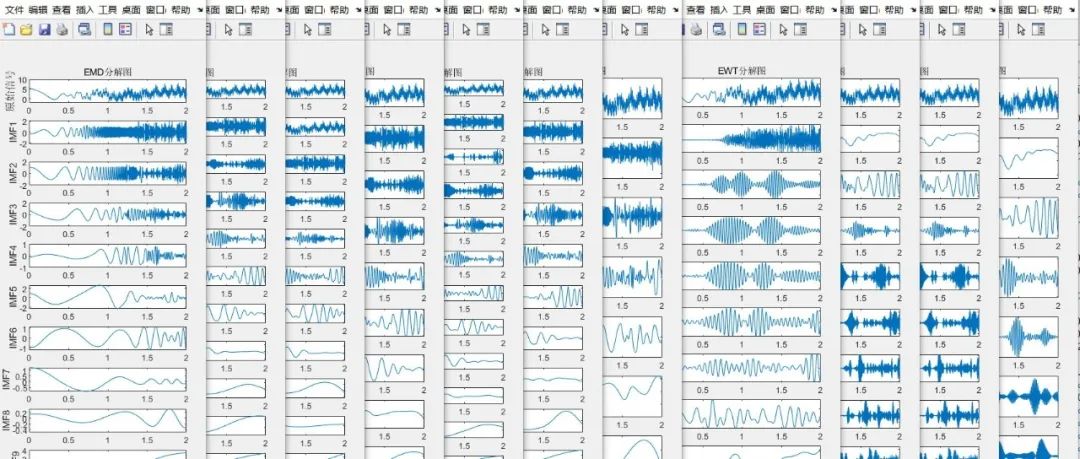

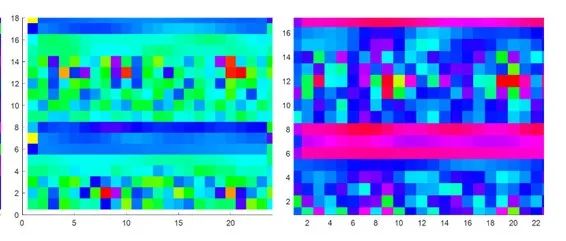

【代码分享】16种最新时间序列数据模态分解算法,高创新性,与预测算法结合小论文随便发!

高创新性!风光负荷、电价、碳价、故障诊断、用电模式识别等任意预测,时间序列/回归/分类预测创新性matlab代码,助力科研!

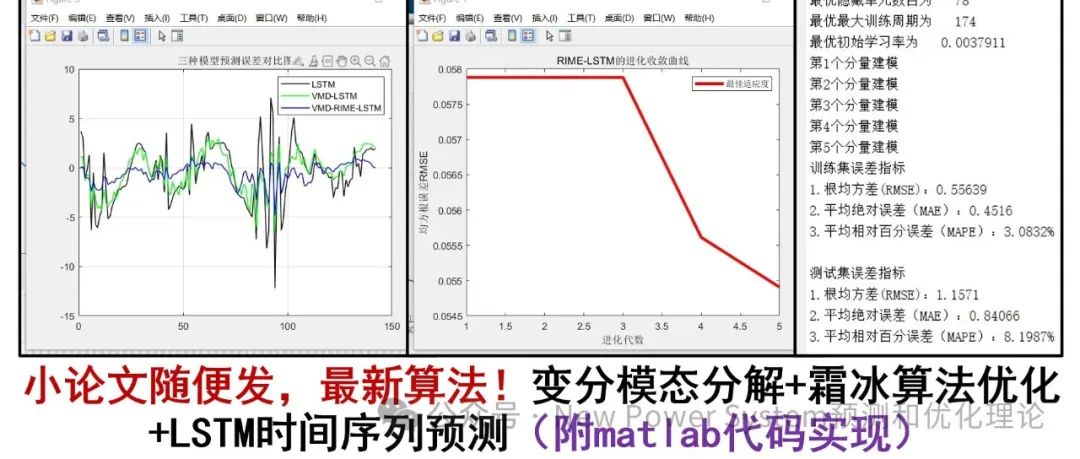

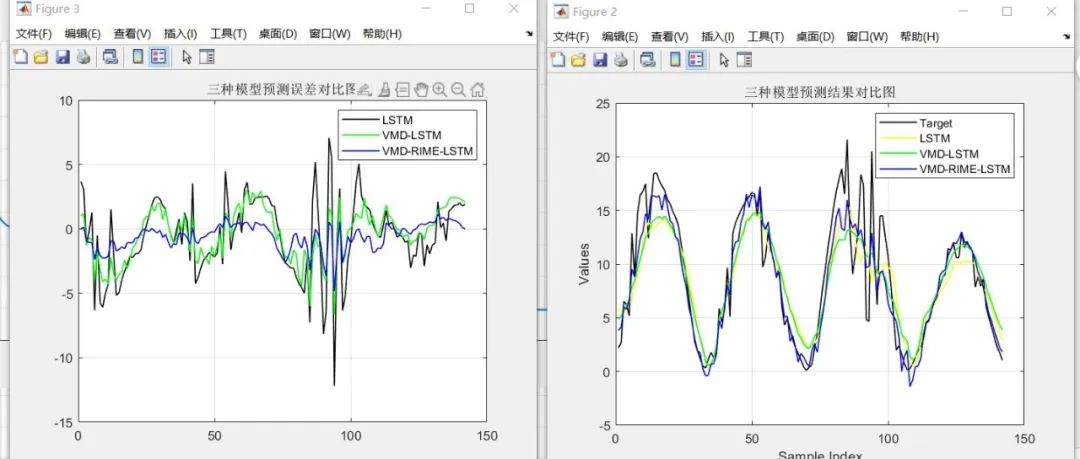

小论文随便发,最新算法!变分模态分解+霜冰算法优化+LSTM时间序列预测(附matlab代码实现)

【代码分享】基于CPO(冠豪猪优化)-BiTCN(双向时域卷积网络)-BiGRU(双向门控循环单元)的多变量时间序列回归预测模型

群智能优化算法和模态分解算法在基于深度学习模型时间序列预测中的运用(matlab代码实现)

【代码分享】基于CPO(冠豪猪优化)-BiTCN(双向时域卷积网络)-BiGRU(双向门控循环单元)的多变量时间序列回归预测模型

时间序列/回归/分类预测创新性matlab代码,助力科研!可用于电气工程领域风光负荷、电价、碳价、故障诊断、用电模式识别等预测

【知识点】什么是注意力机制?时间序列预测中LSTM如何与注意力机制结合?

【知识点】什么是时间序列?怎么用LSTM对时间序列进行预测?LSTM的优缺点是什么?如何对LSTM进行改进?

【代码分享】基于VMD(变分模态分解)-RIME(霜冰算法优化)-LSTM的时间序列预测模型

【代码分享】基于RIME-CNN-LSTM-Attention(霜冰算法优化卷积神经网络融合注意力机制)的时间序列回归预测

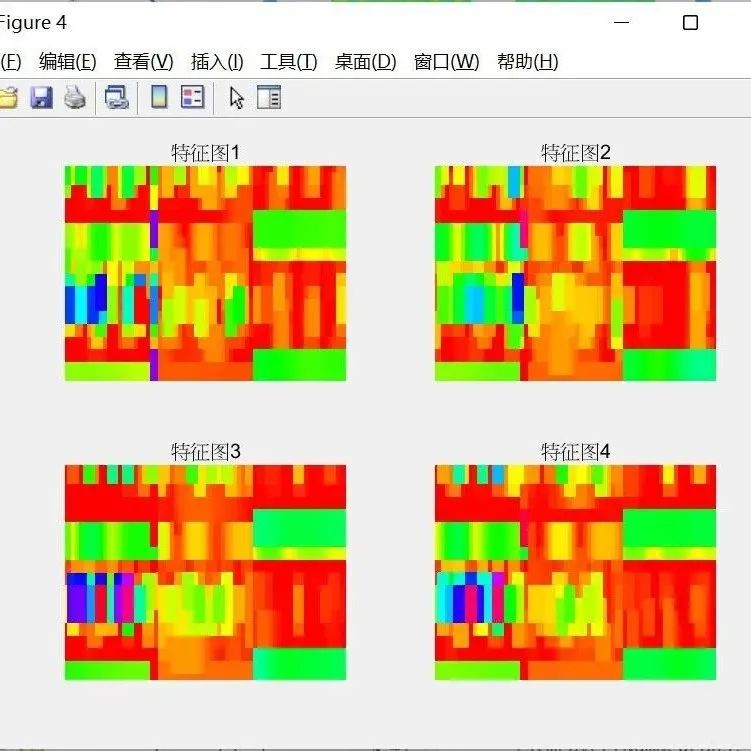

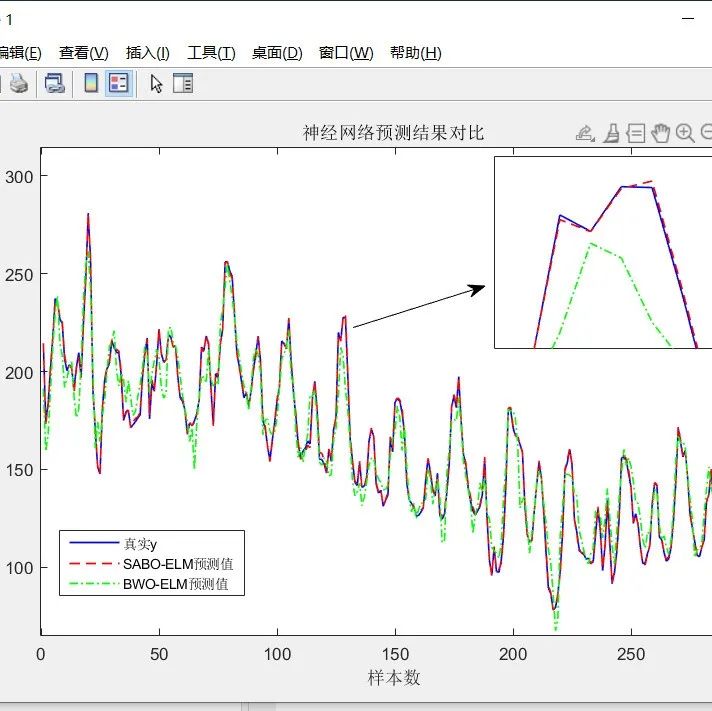

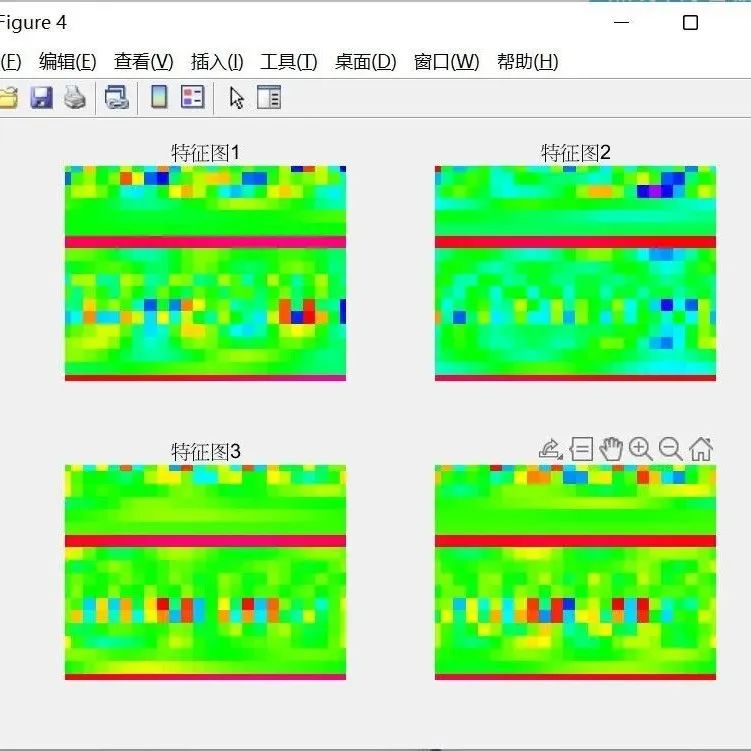

【代码分享】基于减法平均优化器优化算法(SABO)-极限学习机(ELM)的时间序列预测模型

【代码分享】基于KOA-CNN-BiGRU-Attention(开普勒算法优化双向门控循环单元网络融合注意力机制)的时间序列预测

【代码分享】CNN-GRU-Attention基于卷积神经网络和门控循环单元网络结合注意力机制的时间序列多变量回归预测

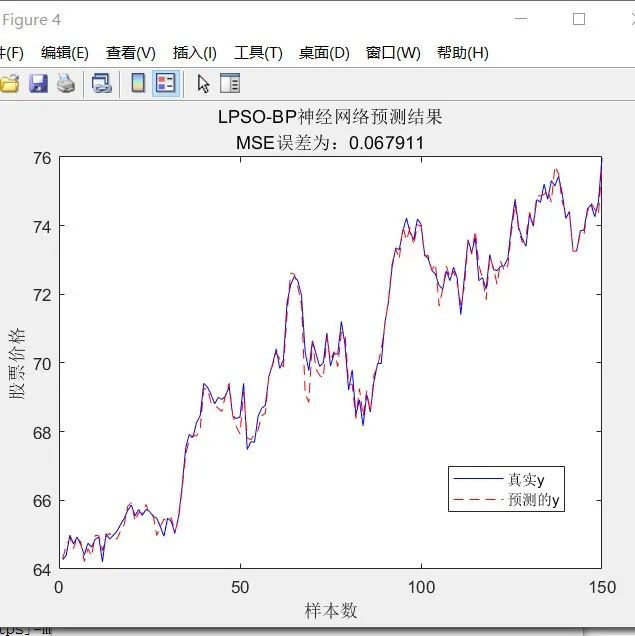

【代码分享】基于改进莱维飞行和混沌映射粒子群优化算法(LPSO)-BP神经网络的时间序列预测模型

【代码分享】基于VMD(变分模态分解)-RIME(霜冰算法优化)-LSTM的时间序列预测模型

【代码分享】基于RIME-CNN-LSTM-Attention(霜冰算法优化卷积神经网络融合注意力机制)的时间序列回归预测

【代码分享】基于KOA-CNN-BiGRU-Attention(开普勒算法优化双向门控循环单元网络融合注意力机制)的时间序列预测

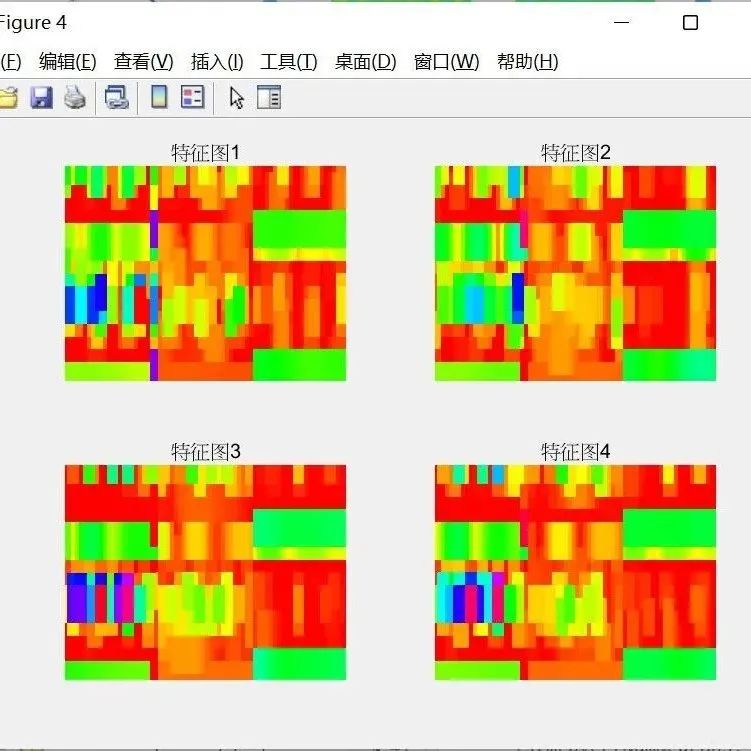

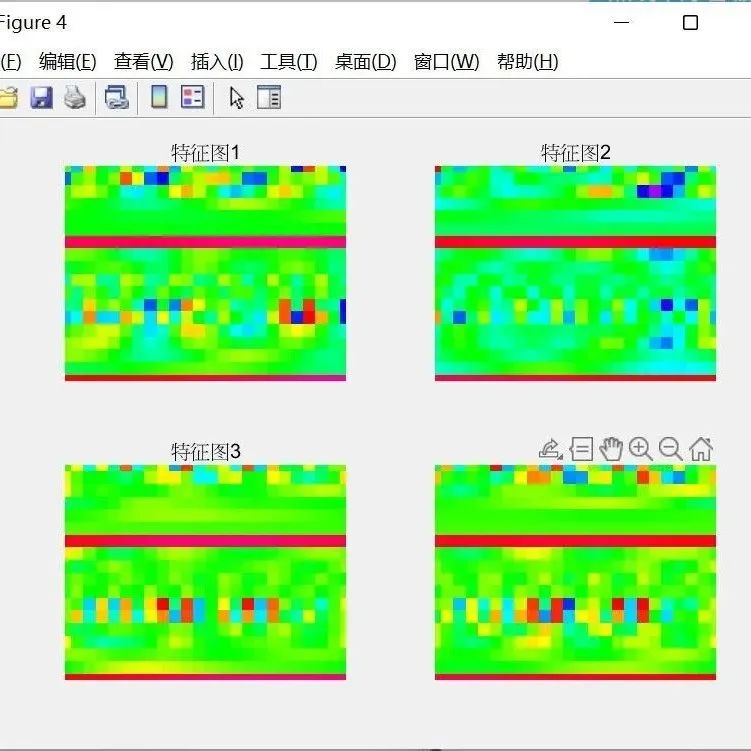

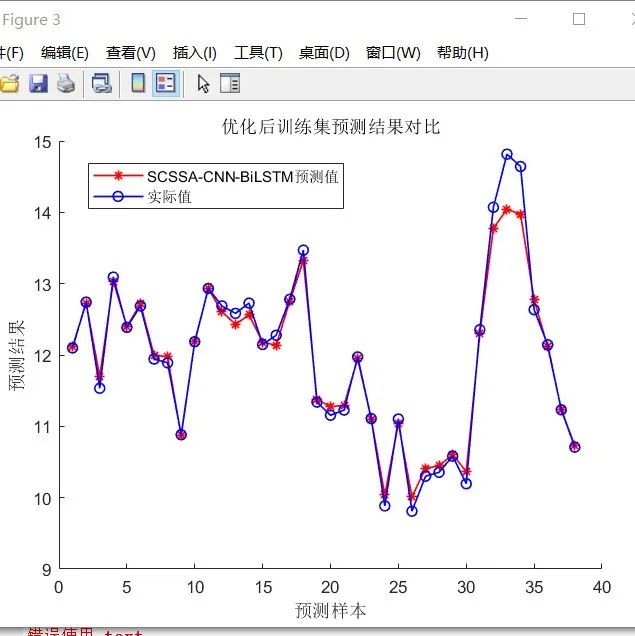

【代码分享】基于融合正余弦和柯西变异的麻雀优化算法(SCSSA)-CNN-BiLSTM(双向长短期记忆网络)的时间序列预测模型

【代码分享】基于量子粒子群算法(QPSO)优化LSTM的时间序列预测算法

2820

2820

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?