今年一波 DeepSeek 的大热潮,让大模型家喻户晓。去年跟人讲「想不想学习 AI?」,感觉自己像大街上的算命先生。是的,网络门槛还要付费,根本没人信这东西是普通人能学的。

今年这普及率有点夸张。就说一个身边发生的真事:去参加一个传统行业的培训,最后需要刷题考试,结果考试题只有答案没有解析,老师说「你下个 DeepSeek 把题目复制进去,就有答案了」。

使用起来实在是太简单了,下个软件,输入点文字。

按照之前的经验,等大家熟悉了大模型的能力。就会来思考智能体,毕竟需求是不断进步的。

今天就给大家解析下 4 大智能体平台。

一、技术架构对比

-

FastGPT

-

架构模式:基于Node.js+React的微服务架构,核心采用DAG(有向无环图)可视化Flow Engine,支持Python代码节点注入。

-

部署:通过Docker Compose实现私有化部署,支持独立组件(如知识库引擎、LLM网关)拆分。

-

扩展性:提供Go语言中间件开发自定义插件,适合企业级复杂场景的深度定制。

-

-

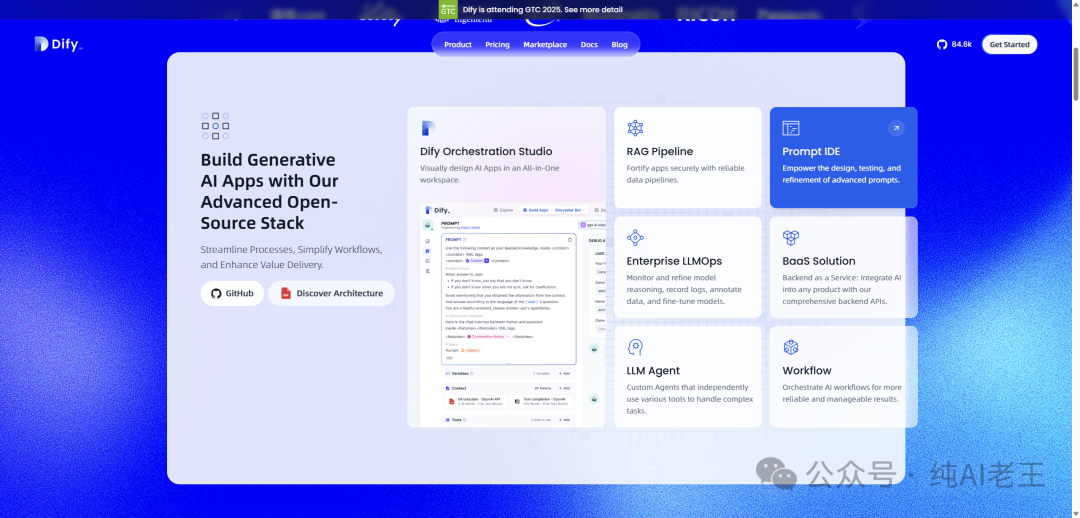

Dify

-

架构模式:BaaS(后端即服务)架构,抽象为「Dataset - LLM - App」三层结构,支持 OneAPI 协议动态切换模型。

-

扩展能力:基于 Kubernetes 实现水平扩展,Celery 异步任务队列处理长文本分片。

-

运维:提供企业级LLMOps工具链,集成日志监控与灰度发布。

-

-

Coze

-

架构模式:云原生架构,前端采用 WebAssembly 优化交互性能,后端依赖字节 MLaaS 平台,内置 NLU 引擎和有限状态机管理多轮对话。

-

局限性:暂不支持私有化部署,依赖字节云基础设施。

-

-

MaxKB

-

架构模式:企业知识管理导向,基于 Python/Django 后端,支持 PostgreSQL + pgvector 混合检索,模块化设计便于集成。

-

部署:支持私有化部署与 API 开放对接,适配企业级权限管理。

-

二、兼容性支持

| 平台 | 核心协议兼容性 | 特色与限制 |

| FastGPT | 兼容OpenAI API,支持OneAPI协议适配私有模型 | 支持LoRA微调注入,灵活适配金融/医疗场景的私有模型;混合检索(关键词+向量)优化复杂业务场景。 |

| Dify | 原生支持OneAPI与LiteLLM代理,兼容20+主流模型(如GPT-4、Claude3等) | 动态路由层降低Token成本,支持AB测试多模型对比;企业版支持本地化部署和私有协议扩展。 |

| Coze | 国内版绑定豆包/通义千问,国际版仅支持OpenAI API;自研API网关封闭 | 电商场景CV图像理解能力突出(如直播弹幕实时处理),但协议扩展性弱,依赖字节云基础设施。 |

| MaxKB | 兼容本地模型(Llama3、Qwen2)及国内外商用模型,支持HTTP/HTTPS协议扩展 | 企业级混合检索(文本+多模态),支持权限分级与私有化部署,适配金融/医疗等高合规场景。 |

| 平台 | 微调支持 | 典型应用场景 |

| FastGPT | 支持LoRA适配器注入,可深度定制私有模型参数 | 需技术团队介入,适合金融合规审查、医疗知识库等需高度定制化的场景。 |

| Dify | 依赖Prompt工程优化,企业版支持有限参数微调 | 适用于需快速迭代的智能客服、多语言翻译等场景;通过用户行为反馈优化模型响应。 |

| Coze | 仅专业版支持豆包系列模型微调(需火山方舟平台),黑盒式优化,用户无法直接干预 | 适合电商客服、社交媒体管理等轻量化场景,但灵活性受限。 |

| MaxKB | 支持本地模型微调(如Llama3)及商用模型适配,结合LangChain优化RAG流程 | 企业知识库构建、精准问答系统,需结合业务数据定制训练。 |

| 平台 | 多模态支持 | 典型功能 |

| FastGPT | 实验性支持图像生成(SDXL集成),文本+结构化数据处理能力突出 | 金融报告生成、医疗影像结构化分析,需结合外部工具扩展。 |

| Dify | 集成Stable Diffusion等文生图模型,支持图像生成与文本联动 | 营销内容创作、多模态客服(如商品图文问答),需依赖插件扩展。 |

| Coze | 电商场景CV能力突出(自研图像理解引擎),支持直播弹幕实时处理 | 电商导购机器人、短视频内容分析,深度集成抖音生态。 |

| MaxKB | 企业级多模态扩展(语音/图像知识库),支持混合检索与权限管理 | 工业质检知识库、多模态培训系统,需定制开发接口。 |

三、工作流引擎技术实现

-

FastGPT

-

核心技术:基于 JSON Schema 的节点属性定义,支持条件分支和循环控制,提供全链路 TraceID 调试。

-

瓶颈:复杂DAG调度可能引发延迟,需手动优化并行度。

-

-

Dify

-

低代码设计:Blockly 可视化编程生成 Swagger API,集成 LLM 缓存层(向量相似度匹配)节省Token。

-

特色功能:支持工作流版本灰度发布与自动化分片处理。

-

-

Coze

-

对话流管理:基于状态转移图(State Chart)实现多轮对话,嵌套深度限制为 5 层。

-

局限性:缺乏代码级调试能力,依赖预置插件。

-

-

MaxKB

-

流程编排:内置工作流引擎支持 RAG 流程自动化,结合 LangChain 实现企业级任务分解。

-

四、知识库技术对比

| 指标 | FastGPT | Dify | Coze | MaxKB |

| 索引构建 | Elasticsearch + FAISS | Pinecone 向量数据库 | 自研分布式索引 | 多数据源统一接入 |

| 数据预处理 | PDF表格解析 | Notion API 同步增量更新 | 基于多源技术文档与实践案例 | 支持网页/文档自动爬取 |

| 查询优化 | BM25权重调节 + rerank模型 | 用户行为反馈学习 | 基于会话上下文的动态召回 | 混合检索+权限分级 |

五、生态系统与开发者支持

-

FastGPT「https://tryfastgpt.ai/zh」

开源社区活跃(GitHub Star 23k),但商业支持较弱,适合技术团队深度定制。

-

Dify「https://dify.ai/」

云市场提供45+行业模板(如多语言客服、合同分析),VS Code插件支持本地调试。

-

Coze「https://www.coze.cn/」

深度集成抖音 / 飞书生态,内置创作者分成体系,适合 C 端快速变现。优先使用Zion+Coze组合,1天内完成支付系统搭建。

-

MaxKB「https://maxkb.cn/」

企业级服务体系完善,支持SLA保障与定制化运维,适合内部知识库/教育等场景。

六、选型建议

-

企业级复杂场景:优先选择 FastGPT,开源架构支持私有模型集成与 RAG 流水线定制。

-

敏捷开发需求:Dify 的 LLMOps 工具链可提升 3 倍效率,适合跨境电商客服等需多模型切换的场景。

-

快速验证:Coze 源于字节,生态内无敌。打开即用,无需任何技术背景,用户友好度极高。

-

企业知识管理:MaxKB 的混合检索与权限管理能力,适合构建精准问答系统。

结语

当前智能体火热,尤其 DeepSeek 火爆之后,很多行业开始关注商业化应用。

最适合的策略就是,结合 FastGPT 的开源灵活性、Dify 的标准化工具链、Coze 的场景化效率及 MaxKB 的企业服务能力,实现技术互补。

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

基于此,我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近70次后,终于把整个AI大模型的学习门槛,降到了最低!

在这个版本当中:

第一您不需要具备任何算法和数学的基础

第二不要求准备高配置的电脑

第三不必懂Python等任何编程语言

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型教程已经给大家整理并打包,现在将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、LLM大模型经典书籍

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套LLM大模型报告合集

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、LLM大模型系列视频教程

四、LLM大模型开源教程(LLaLA/Meta/chatglm/chatgpt)

五、AI产品经理大模型教程

LLM大模型学习路线 ↓

阶段1:AI大模型时代的基础理解

-

目标:了解AI大模型的基本概念、发展历程和核心原理。

-

内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践

- L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

-

目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

-

内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例

- L2.2 Prompt框架

- L2.3 流水线工程

- L2.4 总结与展望

阶段3:AI大模型应用架构实践

-

目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

-

内容:

- L3.1 Agent模型框架

- L3.2 MetaGPT

- L3.3 ChatGLM

- L3.4 LLAMA

- L3.5 其他大模型介绍

阶段4:AI大模型私有化部署

-

目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

-

内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?