wget https://mirrors.aliyun.com/apache/hive/hive-3.1.2/apache-hive-3.1.2-bin.tar.gz

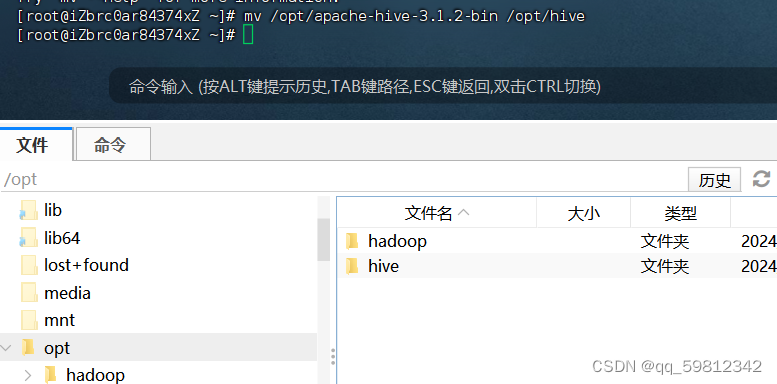

3. 我解压hive安装包至/opt/hive

tar -zxvf apache-hive-3.1.2-bin.tar.gz -C /opt/

mv /opt/apache-hive-3.1.2-bin /opt/hive

4. 加上hive环境变量

echo ‘export HIVE_HOME=/opt/hive/’ >> /etc/profile

echo ‘export PATH=

P

A

T

H

:

PATH:

PATH:HIVE_HOME/bin’ >> /etc/profile

source /etc/profile

hive --version

5. 初始化 Hive 的元数据存储结构

schematool -dbType derby -initSchema

先测试下,后面改完hive与mysql的相关配置后再-dbType mysql

## 4. 配置元数据到MySQL

1. 拷贝JDBC

cp mysql-connector-java-5.1.49.jar $HIVE_HOME/lib

2. 添加hive配置文件

vi $HIVE_HOME/conf/hive-site.xml

<!--指定Hive元数据存储的JDBC连接URL -->

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://localhost:3306/metastore?useSSL=false</value>

</property>

<!--指定JDBC驱动程序的名称,mysql5这么写-->

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<!--指定Hive数据仓库的默认位置-->

<property>

<name>hive.metastore.warehouse.dir</name>

<value>/user/hive/warehouse</value>

</property>

<!--指定连接MySQL数据库的密码-->

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>sql密码</value>

</property>

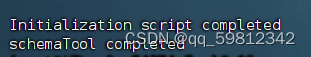

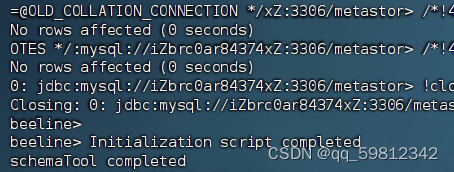

3. 采用MySQL存储元数据

schematool -dbType mysql -initSchema -verbose

这步真的遇到很多问题,就到处看帖子把和我报错信息一样的都拿来试试…实在不行就重装咯毕竟不懂什么底层逻辑…

4. 使用hive

hive> show databases;

hive> show tables;

hive> create table stu(id int, name string);

hive> insert into stu values(1,“ss”);

hive> select * from stu;

## 5. hiveserver2服务

作用:开启用户模拟访问Hadoop集群数据

### 配置文件

配置访问hadoop的权限

vi $HADOOP_HOME/etc/hadoop/core-site.xml

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>\*</value>

</property>

<property>

<name>hadoop.proxyuser.root.users</name>

<value>\*</value>

</property>

hiveserver2连接的ip

vi $HIVE_HOME/conf/hive-site.xml

**先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前在阿里**

**深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!**

**因此收集整理了一份《2024年最新Linux运维全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。**

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化的资料的朋友,可以点击这里获取!](https://bbs.csdn.net/topics/618542503)**

,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上运维知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化的资料的朋友,可以点击这里获取!](https://bbs.csdn.net/topics/618542503)**

1089

1089

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?