break;

default:

break;

}

});

}

然后在initData中调用

设置页面的代码就写好了,下面写主页面的代码,打开activity_main.xml。

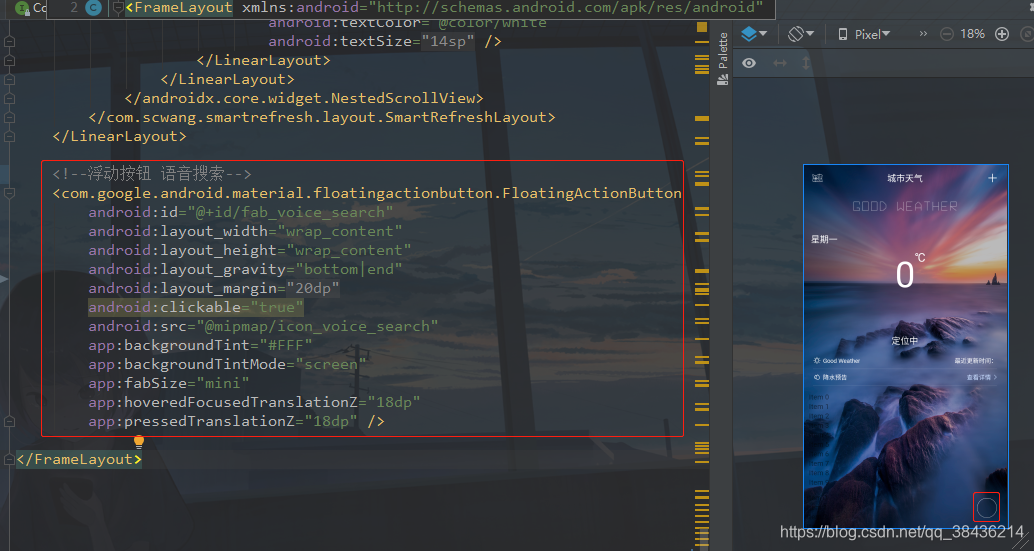

增加浮动按钮代码。

<com.google.android.material.floatingactionbutton.FloatingActionButton

android:id=“@+id/fab_voice_search”

android:layout_width=“wrap_content”

android:layout_height=“wrap_content”

android:layout_gravity=“bottom|end”

android:layout_margin=“@dimen/dp_20”

android:clickable=“true”

android:src=“@mipmap/icon_voice_search”

app:backgroundTint=“@color/white”

app:backgroundTintMode=“screen”

app:fabSize=“mini”

app:hoveredFocusedTranslationZ=“@dimen/dp_18”

app:pressedTranslationZ=“@dimen/dp_18” />

这是按钮的图标,添加代码的位置如下所示:

进入主页面MainActivity,绑定ID。

@BindView(R.id.fab_voice_search)

FloatingActionButton fabVoiceSearch;//语音搜索浮动按钮

然后在onResume方法回调中。

//是否显示语音搜索按钮

if (SPUtils.getBoolean(Constant.VOICE_SEARCH_BOOLEAN, true, context)) {

fabVoiceSearch.show();

} else {

fabVoiceSearch.hide();

}

在这里通过缓存变量值来控制是否显示这个按钮,默认是的显示这个按钮,而当你去设置中关闭开关之后,这个按钮就不再显示了。

前面说到了有这个按钮,那么点击这个按钮自然要做一些事情,下面来看看做什么事情。还记得在上篇文章中我新增了一个语音工具类SpeechUtil。下面的配置,同样要写在这个工具类中,理由同样是,让主页面的代码逻辑更清晰和简洁,同时方便其他页面调用。当然如果你只是想在一个页面中使用的话,可以看看这一篇文章Android 科大讯飞语音识别,下面进入到SpeechUtil。

先创建成员变量

/语音识别****/

private static SpeechRecognizer mIat;// 语音听写对象

private static RecognizerDialog mIatDialog;// 语音听写UI

// 用HashMap存储听写结果

private static HashMap<String, String> mIatResults = new LinkedHashMap<String, String>();

private static SharedPreferences mSharedPreferences;//缓存

private static String language = “zh_cn”;//识别语言

private static String resultType = “json”;//结果内容数据格式

private static String dictationResults;//听写结果

然后新增mInitListener变量完成对语音SDK初始化的监听,这里其实和语音合成用的是一样的InitListener ,只是用了不同的变量名来接收,可以更精简一些,如果你是自己写的话,就直接用一个变量就好了。

/**

- 初始化语音听写监听器

*/

private static InitListener mInitListener = code -> {

Log.d(TAG, "SpeechRecognizer init() code = " + code);

if (code != ErrorCode.SUCCESS) {

showTip(“初始化失败,错误码:” + code + “,请点击网址https://www.xfyun.cn/document/error-code查询解决方案”);

}

};

然后创建语音识别回调变量

/**

- 听写UI监听器

*/

private static RecognizerDialogListener mRecognizerDialogListener = new RecognizerDialogListener() {

/**

- 识别结果

*/

@Override

public void onResult(RecognizerResult results, boolean isLast) {

parsingResult(results);//结果数据解析

}

/**

- 识别回调错误

*/

@Override

public void onError(SpeechError error) {

showTip(error.getPlainDescription(true));

}

};

下面在写parsingResult方法之前,先做好一些准备工作。首先在你的app模块下的utils包下新建一个JsonParser类,里面的代码如下:

package com.llw.goodweather.utils;

import org.json.JSONArray;

import org.json.JSONObject;

import org.json.JSONTokener;

/**

- Json结果解析类

*/

public class JsonParser {

public static String parseIatResult(String json) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

JSONArray words = joResult.getJSONArray(“ws”);

for (int i = 0; i < words.length(); i++) {

// 转写结果词,默认使用第一个结果

JSONArray items = words.getJSONObject(i).getJSONArray(“cw”);

JSONObject obj = items.getJSONObject(0);

ret.append(obj.getString(“w”));

// 如果需要多候选结果,解析数组其他字段

// for(int j = 0; j < items.length(); j++)

// {

// JSONObject obj = items.getJSONObject(j);

// ret.append(obj.getString(“w”));

// }

}

} catch (Exception e) {

e.printStackTrace();

}

return ret.toString();

}

public static String parseGrammarResult(String json) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

JSONArray words = joResult.getJSONArray(“ws”);

for (int i = 0; i < words.length(); i++) {

JSONArray items = words.getJSONObject(i).getJSONArray(“cw”);

for(int j = 0; j < items.length(); j++)

{

JSONObject obj = items.getJSONObject(j);

if(obj.getString(“w”).contains(“nomatch”))

{

ret.append(“没有匹配结果.”);

return ret.toString();

}

ret.append(“【结果】” + obj.getString(“w”));

ret.append(“【置信度】” + obj.getInt(“sc”));

ret.append(“\n”);

}

}

} catch (Exception e) {

e.printStackTrace();

ret.append(“没有匹配结果.”);

}

return ret.toString();

}

public static String parseLocalGrammarResult(String json) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

JSONArray words = joResult.getJSONArray(“ws”);

for (int i = 0; i < words.length(); i++) {

JSONArray items = words.getJSONObject(i).getJSONArray(“cw”);

for(int j = 0; j < items.length(); j++)

{

JSONObject obj = items.getJSONObject(j);

if(obj.getString(“w”).contains(“nomatch”))

{

ret.append(“没有匹配结果.”);

return ret.toString();

}

ret.append(“【结果】” + obj.getString(“w”));

ret.append(“\n”);

}

}

ret.append(“【置信度】” + joResult.optInt(“sc”));

} catch (Exception e) {

e.printStackTrace();

ret.append(“没有匹配结果.”);

}

return ret.toString();

}

public static String parseTransResult(String json, String key) {

StringBuffer ret = new StringBuffer();

try {

JSONTokener tokener = new JSONTokener(json);

JSONObject joResult = new JSONObject(tokener);

String errorCode = joResult.optString(“ret”);

if(!errorCode.equals(“0”)) {

return joResult.optString(“errmsg”);

}

JSONObject transResult = joResult.optJSONObject(“trans_result”);

ret.append(transResult.optString(key));

/*JSONArray words = joResult.getJSONArray(“results”);

for (int i = 0; i < words.length(); i++) {

JSONObject obj = words.getJSONObject(i);

ret.append(obj.getString(key));

}*/

} catch (Exception e) {

e.printStackTrace();

}

return ret.toString();

}

}

这个类用于对听写结果进行解析处理,然后在SpeechUtil中新增如下接口。

//语音回调

private static SpeechCallback mSpeechCallback;

/**

- 语音回调接口

*/

public interface SpeechCallback {

/**

- 听写结果

*/

void dictationResults(String cityName);

}

并创建一个变量,下面就可以编写parsingResult方法了,代码如下:

/**

-

语音识别结果数据解析

-

@param results

*/

private static void parsingResult(RecognizerResult results) {

//获取解析结果

String text = JsonParser.parseIatResult(results.getResultString());

String sn = null;

// 读取json结果中的sn字段

try {

JSONObject resultJson = new JSONObject(results.getResultString());

sn = resultJson.optString(“sn”);

} catch (JSONException e) {

e.printStackTrace();

}

mIatResults.put(sn, text);

StringBuffer resultBuffer = new StringBuffer();

for (String key : mIatResults.keySet()) {

resultBuffer.append(mIatResults.get(key));

}

dictationResults = resultBuffer.toString();//听写结果显示

//回调

mSpeechCallback.dictationResults(dictationResults);

Log.d(TAG,dictationResults);

}

然后是配置语音识别的参数,新增setDictationParam方法。

/**

-

听写参数设置

-

@return

*/

public static void setDictationParam() {

// 清空参数

mIat.setParameter(SpeechConstant.PARAMS, null);

// 设置听写引擎

mIat.setParameter(SpeechConstant.ENGINE_TYPE, mEngineType);

// 设置返回结果格式

mIat.setParameter(SpeechConstant.RESULT_TYPE, resultType);

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Android工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Android移动开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Android开发知识点,真正体系化!

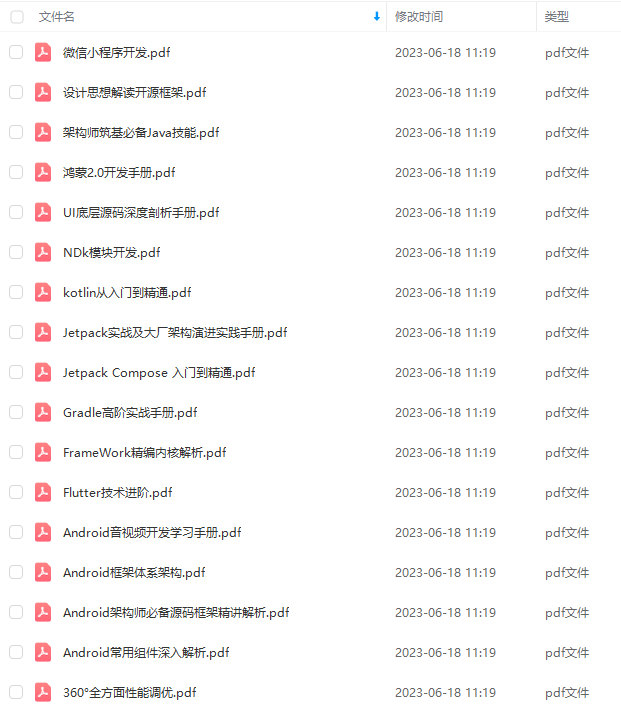

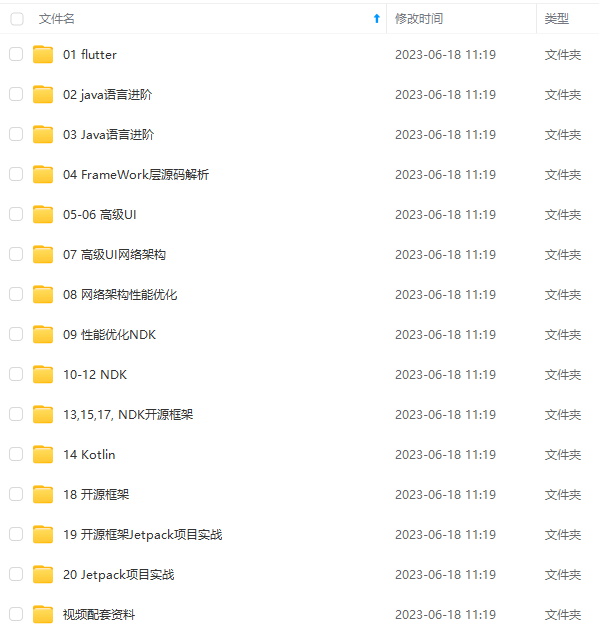

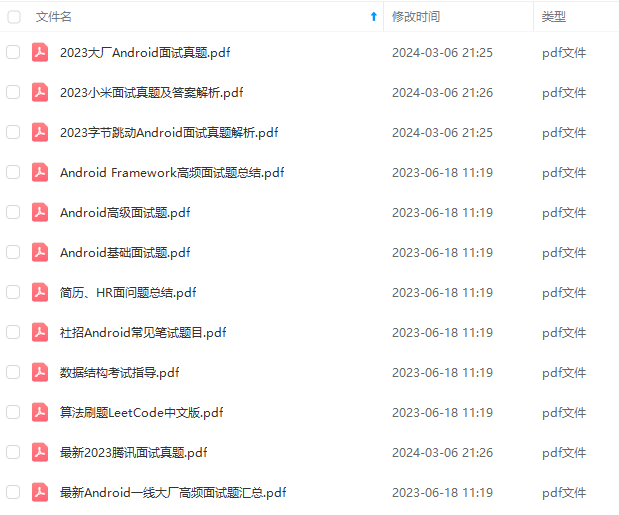

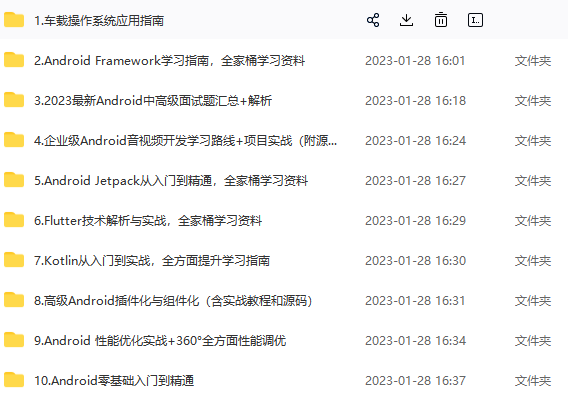

由于文件比较大,这里只是将部分目录大纲截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新

如果你觉得这些内容对你有帮助,可以添加V获取:vip204888 (备注Android)

结语

由于篇幅限制,文档的详解资料太全面,细节内容太多,所以只把部分知识点截图出来粗略的介绍,每个小节点里面都有更细化的内容!以下是目录截图:

由于整个文档比较全面,内容比较多,篇幅不允许,下面以截图方式展示 。

再附一部分Android架构面试视频讲解:

一个人可以走的很快,但一群人才能走的更远。如果你从事以下工作或对以下感兴趣,欢迎戳这里加入程序员的圈子,让我们一起学习成长!

AI人工智能、Android移动开发、AIGC大模型、C C#、Go语言、Java、Linux运维、云计算、MySQL、PMP、网络安全、Python爬虫、UE5、UI设计、Unity3D、Web前端开发、产品经理、车载开发、大数据、鸿蒙、计算机网络、嵌入式物联网、软件测试、数据结构与算法、音视频开发、Flutter、IOS开发、PHP开发、.NET、安卓逆向、云计算

[外链图片转存中…(img-fYN7kbDh-1712493323079)]

结语

由于篇幅限制,文档的详解资料太全面,细节内容太多,所以只把部分知识点截图出来粗略的介绍,每个小节点里面都有更细化的内容!以下是目录截图:

[外链图片转存中…(img-3kFZtXE4-1712493323079)]

由于整个文档比较全面,内容比较多,篇幅不允许,下面以截图方式展示 。

再附一部分Android架构面试视频讲解:

[外链图片转存中…(img-sMnYMF4r-1712493323079)]

一个人可以走的很快,但一群人才能走的更远。如果你从事以下工作或对以下感兴趣,欢迎戳这里加入程序员的圈子,让我们一起学习成长!

AI人工智能、Android移动开发、AIGC大模型、C C#、Go语言、Java、Linux运维、云计算、MySQL、PMP、网络安全、Python爬虫、UE5、UI设计、Unity3D、Web前端开发、产品经理、车载开发、大数据、鸿蒙、计算机网络、嵌入式物联网、软件测试、数据结构与算法、音视频开发、Flutter、IOS开发、PHP开发、.NET、安卓逆向、云计算

777

777

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?