其他机器要使用root定义定时器

[root@tianqinglong02 .ssh]#crontab -e

-

-

-

-

- /usr/sbin/ntpdate -u tianqinglong01 > /dev/null 2>&1

-

-

-

:wq

[root@tianqinglong03 .ssh]#crontab -e

-

-

-

-

- /usr/sbin/ntpdate -u tianqinglong01 > /dev/null 2>&1

-

-

-

:wq

02 03的jdk环境配置

[root@tianqinglong01 local]# scp -r jdk /tianqinglong02:$PWD

[root@tianqinglong01 local]# scp -r jdk /tianqinglong03:$PWD

6.Hadoop安装与环境变量配置

1.上传和解压两个软件包

[root@tianqinglong01 ~J# tar -zxvf jdk-8u221-linux-x64.tar.gz -C /usr/local/

[root@tianqinglong01 ~J# tar -zxvf hadoop-2.7.6.tar.gz -C /usr/local/

2.进入local里,给两个软件更名

[root@tianqinglong01 ~J# cd /usr/local/

[root@tianqinglong01 localJ# mv 1.8.0_221/jdk

[root@tianqinglong01 localJ# mv hadoop-2.7.6/ hadoop

3.配置环境变量

[root@tianqinglong01 hadoopJ# vim /etc/profile

export HADOOP_HOME=/usr/local/hadoop

export PATH= P A T H : PATH: PATH:HADOOP_HOME/bin:$HADOOP_HOME/sbin

[root@tianqinglong01 hadoopJ# source /etc/profile

[root@tianqinglong01 hadoopJ# cd

[root@tianqinglong01 ~J# hadoop version

02 03 也要安装hadoop

[root@tianqinglong01 localJ# scp -r hadoop /tianqinglong02:$PWD

[root@tianqinglong01 localJ# scp -r hadoop /tianqinglong03:$PWD

[root@tianqinglong01 localJ# scp /etc/profile tianqinglong02:/etc/

[root@tianqinglong01 localJ# scp /etc/profile tianqinglong03:/etc/

02

[root@tianqinglong02 .sshJ# source /etc/profile

[root@tianqinglong02 ~J# hadoop version

03

[root@tianqinglong03 .sshJ# source /etc/profile

[root@tianqinglong03 ~J# hadoop version

NameNode :是用来维护集群的目录树结构,并对外提供服务的节点

DateNode : 数据存储的节点

我们需要通过配置若干配置文件,来实现Hadoop集群的配置信息。需要配置的文件有:

hadoop-env.sh

yarn-env.sh

core-site.xml

hdfs-site.xml

mapred-site.xml

yarn-site.xml

core-site.xml

[root@tianqinglong01 ~]# cd $HADOOP_HOME/etc/hadoop/

[root@tianqinglong01 hadoop]# vi core-site.xml

fs.defaultFS

hdfs://tianqinglong01:8020

hodoop.tmp.dir

/usr/local/hodoop/tmp

hdfs-site.xml

[root@tianqinglong01 hadoop]# vi hdfs-site.xml

dfs.namenode.name.dir

file://${hadoop.tmp.dir}/dfs/name

</ property>

dfs.datanode.data.dir

file://${hadoop.tmp.dir}/dfs/data

dfs.replicationc

3

dfs.blocksize

134217728

dfs.namenode.secondary.http-address

tianqinglong02:50090

dfs.nomenode.http-address

tianqinglong01:50070

mapred-site.xml

[root@tianqinglong01 hadoop]# cp mapred-site.xml.template mapred-site.xml

[root@tianqinglong01 hadoop]# vi mapred-site .xml

mapreduce.framework.name

yarn

mapreduce.jobhistory.address

tianqinglong01:10020

mopreduce-jobhistory.webapp.address

tianqinglong01:19888

yarn-site.xml

[root@tianqinglong01 hadoop]# vi yarn-site.xml

yarn.nodemanager.aux-services

mapreduce_shuffle

yarn.resourcemanager.hostname

tianqinglong01

yarn.nodemanager.aux-services.mapreduce_shuffle.class

org.apache.hadoop.mapred.ShuffleHandler

yarn.resourcemanager.address

tianqinglong01:8032

yarn.resourcemanager.scheduler.address

tianqinglong01:8030

yarn.resourcemanager.resource-tracker.address

tianqinglong01:8031

yarn.resourcemanager.admin.address

tianqinglong01:8033

yarn.resourcemanager.webapp.address

tianqinglong01:8088

hadoop-env.sh

[root@tianqinglong01 hadoop]# vim hadoop-env.sh

…

The java implementation to use

export JAVA_HOME=/usr/local/jdk

…

yarn-env.sh

[root@tianqinglong01 hadoop]# yarn-env.sh

…

some Java Paramters

JAVA_HOME=/usr/local/jdk

…

slaves

此文件用于指定datanode守护进程所在的机器节点主机名

[root@tianqinglong01 hadoop]# vim slaves

tianqinglong01

tianqinglong02

tianqinglong03

分发到另外两台

[root@tianqinglong01 hadoop]# cd …

[root@tianqinglong01 etc]# ll

[root@tianqinglong01 etc]# scp -r hadoop/ tianqinglong02:$PWD

[root@tianqinglong01 etc]# scp -r hadoop/ tianqinglong03:$PWD

格式化集群

1.在tianqinglong01机器上运行命令

[root@tianqinglong01 ~]# hdfs namenode -format

[root@tianqinglong01 ~]# cd /usr/local/hadoop/tmp/dfs/name/current

启动

1.启动脚本

– start-dfs.sh :用于启动hdfs集群的脚本

– start-yarn.sh :用于启动yarn守护进程

– start-all.sh :用于启动hdfs和yarn

2.关闭脚本

– stop-dfs.sh :用于关闭hdfs集群的脚本

– stop-yarn.sh :用于关闭yarn守护进程

– stop-all.sh :用于关闭hdfs和yarn

[root@tianqinglong01 ~]# ssh-copy-id tianqinglong01

[root@tianqinglong01 ~]# start-dfs.sh

[root@tianqinglong01 ~]# jps #查看

HDFS其实就是一个分布式的文件系统,我们可以使用一些命令来操作这个分布式文件系统上的文件。

-访问HDFS的命令:

hadoop dfs —已过时

hdfs dfs

-小技巧

1.在命令行中输入hdfs。回车后,就会提示hdfs.后可以使用哪些命令,其中有一个是dfs.

2.在命令行中输入hdfs dfs,回车后,就会提示dfs后可以添加的一些常用shell命令。

-注意事项

分布式文件系统的路径在命令行中,要从/开始写,即绝对路径。

创建目录

hdfs dfs -mkdir (-p) /目录

hdfs dfs -mkdir (-p) /data

上传指令

echo “hello hdfs” >> a1

hdfs dfs -put a1 /data

创建空文件

hdfs dfs -mkdir /empty

hdfs dfs touchz /empty/empty1

向分布式文件系统中的文件里追加内容

echo “hello world” >> e1

hdfs dfs -appendToFile e1 /empty/empty1

下载指令

hdfs dfs -get /empty/empty1 ./

##扩展 拷贝指令

hdfs dfs -copyToLocal /empty ./

合并下载

- 把多个文件里面数据合并成一个

echo “hello 1” >> file1

echo “hello 2” >> file2

echo “hello 3” >> file3

hdfs dfs -put file* /

hdfs dfs -getmerge /file* ./file

cat file

hello 1

hello 2

hello 3

移动文件

hdfs dfs -mv /file* /data

重命名

hdfs dfs -mv /test /test1

复制

hdfs dfs -cp /data/file1 /

删除命令

hdfs dfs -rm /file1

hdfs dfs -rm -r /a #递归删除

hdfs dfs -rmdir /test1 #只能删除空文件夹

查看磁盘利用率和文件大小

hdfs dfs -df /

hdfs dfs -df -h / #可以直观的看

hdfs dfs -du -h /data #查看data文件夹里面的每个文件大小

hdfs dfs -du -s /data #查看data文件夹里面的总文件大小

修改权限的

hdfs dfs -chmod 777 /data

hdfs dfs -chown shawn:shwan /data

修改副本数量

hdfs dfs -setrep 5 /data #默认为3

查看文件状态

测试

hdfs dfs -test -e /data/a1 # 看不出来什么

hdfs dfs -test -e /data/a1 && echo “exists” || echo “none”

hdfs不适合小文件的存储!块是固定的~ 你存1M和127M都要占用那么多空间

HDFS的优点

1, 高容错性(硬件故障是常态)数据自动保存多个副本,副本丢失后,会自动恢复

2, 适合大数据集:GB。TB、甚至PB级数据、千万规模以上的文件数量,1000以上节点规模。

3, 数据访问:一次性写入。多次读取;保证致据一致性,安全性

4, 构建成本低:可以构建在廉价机器上。

5, 多种软硬件平台中的可移植性

6, 高效性:Hodoop能够在节点之间动态地移动数据,并保证各个节点的动态平衡,因此处理速度非常快。

7, 高可靠性:Hadoop的存储和处理数据的能力值得人们信赖,

HDFS的缺点

1.不适合做低延迟数据访问:

HDFS的设计目标有一点是:处理大型数据集,高吞吐率。这一点势必要以高延迟为代价的。

因此HDFS不适合处理用户要求的毫秒级的低延迟应用请求

2.不适合小文件存储:

一个是大量小文件需要消耗大量的寻址时间,违反了HDFS的尽可能减少寻址时间比例约设计目标。

第二个是内存有限,一个block元数据大内存消耗大约为159个字节,存储一亿个block和

一亿个小文件都会消耗20G内存。因此相对来说。大文件更省内存。

3.不适合并发写入,文件随机修改:

HOFS上的文件只能拥有一个写者,仅仅支持append操作。不支持多用户对同一个文件的写操作,

以及在文件任意位置进行修改

非第一次启动集群

第一次启动集群

SecondaryNamenode,是HDFS集群中的重要组成部分,它可以辅助Namenode进行fsimage和editlog的合并工作,减小edtlog文件大小,以便缩短下次Namenode的重启时间,能尽快退出安全模式。

两个文件的合并周期,称之为检查点机制(checkpoint),是可以通过hdfs-default.xml配置文件进行修改的:

dfs.namenode.checkpoint.period</ name>

3600

两次检查点间隔的秒数,默认是1个小时I

dfs.namenode.checkpoint.txns

1000000

txid执行的次数达到100w次,也执行checkpoint

dfs.namenode.checkpoint.check.period

60

60秒一检查txid的执行次数

通过上图,可以总结如下:

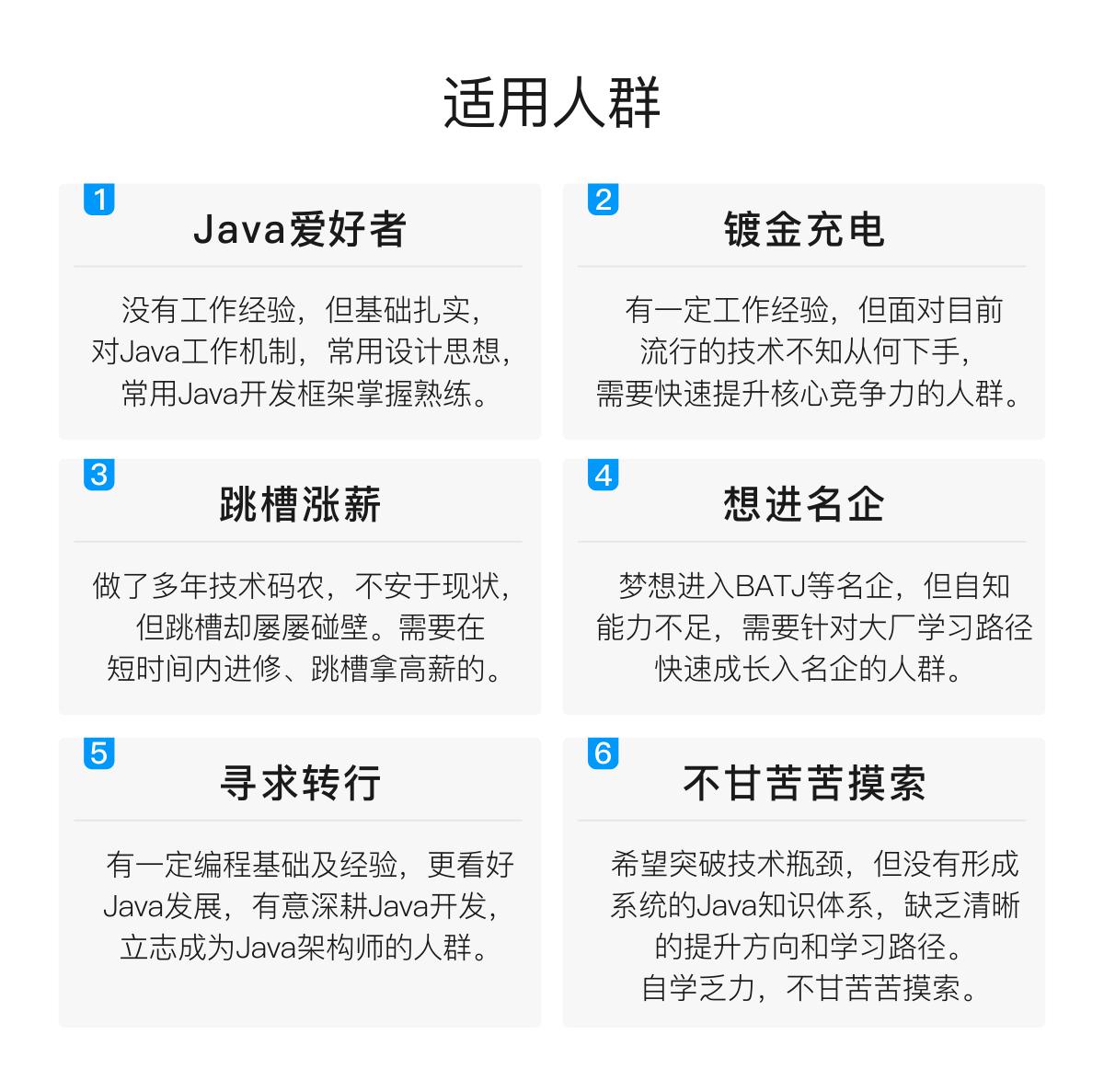

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Java工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Java开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。

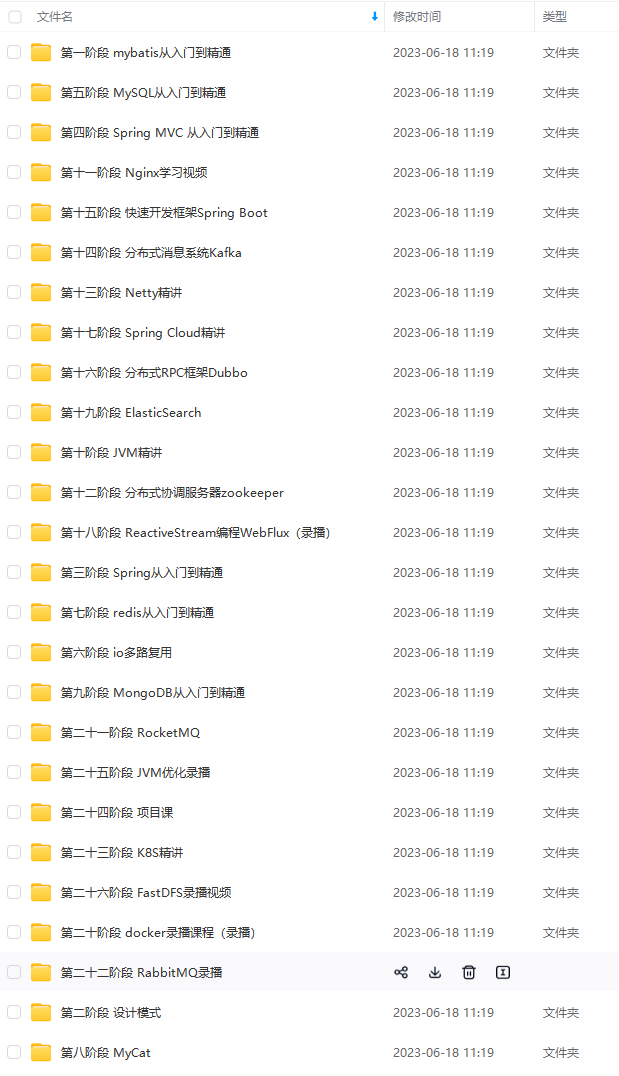

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Java开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且会持续更新!

如果你觉得这些内容对你有帮助,可以扫码获取!!(备注Java获取)

最后

各位读者,由于本篇幅度过长,为了避免影响阅读体验,下面我就大概概括了整理了

《互联网大厂面试真题解析、进阶开发核心学习笔记、全套讲解视频、实战项目源码讲义》点击传送门即可获取!

lor_FFFFFF,t_70,g_se,x_16#pic_center)

通过上图,可以总结如下:

自我介绍一下,小编13年上海交大毕业,曾经在小公司待过,也去过华为、OPPO等大厂,18年进入阿里一直到现在。

深知大多数Java工程师,想要提升技能,往往是自己摸索成长或者是报班学习,但对于培训机构动则几千的学费,着实压力不小。自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年Java开发全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友,同时减轻大家的负担。[外链图片转存中…(img-il15DoPS-1713306444277)]

[外链图片转存中…(img-TWNkz5s0-1713306444278)]

[外链图片转存中…(img-JPvHrYkY-1713306444278)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,基本涵盖了95%以上Java开发知识点,真正体系化!

由于文件比较大,这里只是将部分目录截图出来,每个节点里面都包含大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且会持续更新!

如果你觉得这些内容对你有帮助,可以扫码获取!!(备注Java获取)

最后

各位读者,由于本篇幅度过长,为了避免影响阅读体验,下面我就大概概括了整理了

[外链图片转存中…(img-ecqOkZo9-1713306444278)]

[外链图片转存中…(img-LSVfHduK-1713306444278)]

[外链图片转存中…(img-ExGl3bo9-1713306444279)]

[外链图片转存中…(img-DiJjiLTc-1713306444279)]

《互联网大厂面试真题解析、进阶开发核心学习笔记、全套讲解视频、实战项目源码讲义》点击传送门即可获取!

本文详细描述了在Linux服务器上配置Java环境,安装Hadoop并进行环境变量设置,包括HDFS的安装、配置文件编辑、NameNode和DataNode角色,以及HDFS的命令行操作、格式化、启动流程和优缺点分析。

本文详细描述了在Linux服务器上配置Java环境,安装Hadoop并进行环境变量设置,包括HDFS的安装、配置文件编辑、NameNode和DataNode角色,以及HDFS的命令行操作、格式化、启动流程和优缺点分析。

5561

5561

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?