使用案例

这里给大家分享一下如何将此项目用来爬取去自己需要的图片。原作者介绍了几种关键字输入的方式。这里以文件读取的形式将关键字传入。这里爬取图片的数量选为500张,需要下载、安装Selenium库chromedriver。

1、搭建爬虫环境

pip install selenuium

pip install requests

pip install google_images_download

2、下载chromedriver驱动

因为下载的图片数量大于100,所以还需要在安装chromedriver,在代码配置chromedriver位置即可。

首先要查看自己电脑上安装的google浏览器版本号

▲谷歌浏览器版本号▲

github给的下载路径国内是无法下载的,不过小编已经将大多数驱动下载下来,需要的可以后台私信获取。当然也可以通过别的渠道获取。

▲github给的下载地址▲

在chrome官网找到与本机的google浏览器版本号一致的chromedriver

▲chrome官网对应的驱动版本号▲

下载完后,安装的路径根据操作系统自己指定。我使用的时win系统,安装在了D盘,具体路径如下:

“D:\download\chromedriver.exe”

3、编辑爬取的关键字文件:

如图所示,只需要在keywords.csv文件里面按图所示填写对应老师的名称即可。

4、代码展示:

import csv

import os

import sys

from google_images_download import google_images_download

实例化一个下载器

downloader = google_images_download.googleimagesdownload()

BASE_DIR = os.path.dirname(os.path.abspath(file))

sys.path.insert(0, BASE_DIR)

读取关键字文件

csv_file = csv.reader(open(BASE_DIR + “\google_images\keywords.csv”, “r”))

def download_images(csv_file):

“”"

传入关键字等参数,下载对应的图片文件

files: 读取的关键字文件

limit: 爬取的图片数量

print_urls: 是否显示爬取的图片url

chromedriver: chromedriver安装的路径。不填此参数,默认爬取前100张图片

output_directory:自定义保存图片的位置

“”"

for key_word in csv_file:

arguments = {“keywords”: key_word, “limit”: 500, “print_urls”: True,

“chromedriver”: “D:\download\chromedriver.exe”,

“output_directory”: BASE_DIR + “\files\”}

downloader.download(arguments)

if name == ‘main’:

download_images(csv_file)

#在学习Python的过程中,往往因为没有资料或者没人指导从而导致自己不想学下去了,因此姐姐我特意准备了个群 631441315 ,群里有大量的PDF书籍、教程都给大家免费使用!不管是学习到哪个阶段的小伙伴都可以获取到自己相对应的资料!

运行:python google_download.py,你就会发现有源源不断的老师图片进入你的硬盘,接下来就是坐等爬完所有你要的图片了。

此文章主要还是给大家分享这个开源项目,至于使用,本文只是做了一个简单的使用,想要了解更多的,可以直接在github查看。在实际中,我们可以利用这个python脚本去爬取基于google的任何图片了。

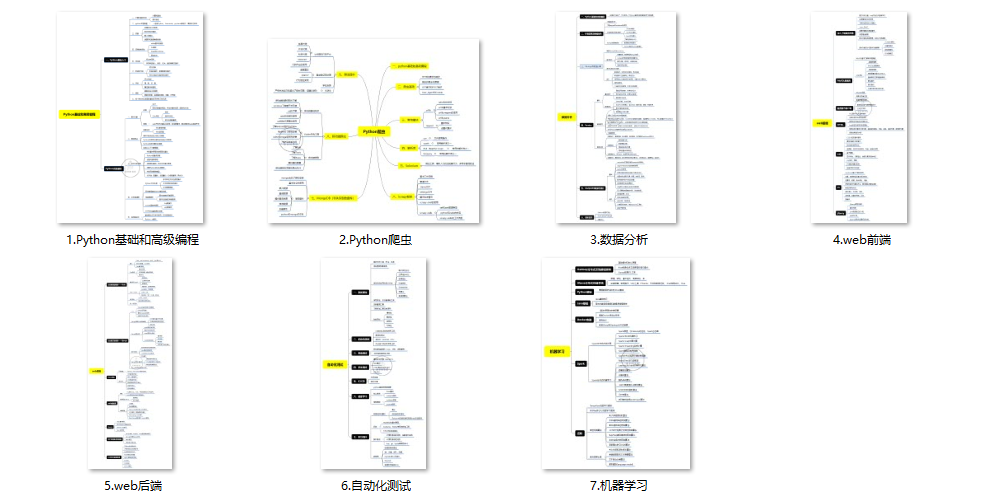

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

413

413

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?