mv jdk1.8.0_401 /usr/java/jdk

#编辑/etc/profile文件

vi /etc/profile

#添加环境变量

export JAVA_HOME=/usr/java/jdk

export PATH=

J

A

V

A

_

H

O

M

E

/

b

i

n

:

JAVA\_HOME/bin:

JAVA_HOME/bin:PATH

#刷新环境变量

source /etc/profile

#验证

java -version

###### 6.安装hadoop

node01节点、node01节点、node03节点都做以下配置

下载地址:https://dlcdn.apache.org/hadoop/common

#解压

tar -zxvf hadoop-3.3.6.tar.gz

#移动hadoop到对应的文件夹

mv hadoop-3.3.6 /usr/hadoop

#编辑/etc/profile文件

vi /etc/profile

#添加环境变量

export HADOOP_HOME=/usr/hadoop

export PATH=

H

A

D

O

O

P

_

H

O

M

E

/

b

i

n

:

HADOOP\_HOME/bin:

HADOOP_HOME/bin:HADOOP_HOME/sbin:$PATH

#刷新环境变量

source /etc/profile

#验证

hdfs version

###### 7.ssh免密(NameNode需要能ssh免密到其他节点)

1)安装ssh

#安装ssh

yum install ssh

2)生成RSA密钥和公钥

需要先进入对应用户再生成密钥和公钥

node01节点、node01节点、node03节点都进入hadoop用户

su hadoop

生成密钥和公钥

#生成RSA密钥和公钥,-t表示type

ssh-keygen -t rsa -P ‘’ -f ~/.ssh/id_rsa

3)在~/.ssh文件夹下新增config,配置需要ssh的服务器信息

#编辑~/.ssh/config

vi ~/.ssh/config

在~/.ssh/config文件下添加ssh的服务器信息

Host node01

HostName 192.168.132.101

User hadoop

IdentitiesOnly yes

Host node02

HostName 192.168.132.102

User hadoop

IdentitiesOnly yes

Host node03

HostName 192.168.132.103

User hadoop

IdentitiesOnly yes

修改下config的权限

chmod 600 ~/.ssh/config

4)将公钥发送到对应服务器,实现对对应服务器的免密登录

node01和node02有NameNode节点,所以需要能ssh到其他节点

#将公钥发给自己

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

#在node01上执行,将node01的公钥发给所有node节点,让node01能直接免密登录到其他node节点

ssh-copy-id node02

ssh-copy-id node03

#在node02上执行,将node02的公钥发给所有node节点,让node02能直接免密登录到其他node节点

ssh-copy-id node01

ssh-copy-id node03

#修改下authorized_keys的权限,否则会无法免密登录

chmod 600 ~/.ssh/authorized_keys

6)验证免密登录

node01应能ssh到node02和node03

node02应能ssh到node01和node03

ssh localhost

ssh node01

ssh node02

ssh node03

###### 8.安装Zookeeper

node01节点、node01节点、node03节点都做以下配置

下载地址:https://zookeeper.apache.org/releases.html

1)安装zookpper

#解压

tar -zxvf apache-zookeeper-3.8.3-bin.tar.gz

#移动zookeeper文件夹

mv apache-zookeeper-3.8.3-bin /usr/zookeeper

#编辑/etc/profile文件

vi /etc/profile

#添加环境变量

export ZOOKEEPER_HOME=/usr/zookeeper

export PATH=

P

A

T

H

:

PATH:

PATH:ZOOKEEPER_HOME/bin

#刷新环境变量

source /etc/profile

#新建一个存放数据的文件夹

mkdir -p /bigdata/zookeeper

2)配置zookpper

**复制zoo\_sample.cfg为zoo.cfg,默认启动读取zoo.cfg文件**

#复制conf/zoo_sample.cfg

cp /usr/zookeeper/conf/zoo_sample.cfg /usr/zookeeper/conf/zoo.cfg

**修改zoo.cfg文件,客户端连接需要配置一个端口,服务需要配置两个端口,一个端口是有主从的使用状态,另一个端口是无主从的选举状态**

#编辑zoo.cfg文件

vi /usr/zookeeper/conf/zoo.cfg

#修改以下内容

dataDir=/bigdata/zookeeper

clientPort=2181

#添加以下内容

server.1=node01:2888:3888

server.2=node02:2888:3888

server.3=node03:2888:3888

**创建myid并添加zoo.cfg配置文件里server后面的权重值**

在上面的zoo.cfg配置文件中,node01是server.1,node02是server.2,node03是server.3

因此

在node01节点配置:echo 1 > /bigdata/zookeeper/myid

在node02节点配置:echo 2 > /bigdata/zookeeper/myid

在node03节点配置:echo 3 > /bigdata/zookeeper/myid

echo 1 > /bigdata/zookeeper/myid

3)配置权限并启动

修改zookeeper文件权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /usr/zookeeper

chown -R hadoop /usr/zookeeper

chmod -R 770 /usr/zookeeper

修改zookpper数据文件夹权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /bigdata/zookeeper

chown -R hadoop /bigdata/zookeeper

chmod -R 770 /bigdata/zookeeper

启动

需要先切换到对应用户

node01节点、node01节点、node03节点都切换到hadoop用户

su hadoop

node01节点、node01节点、node03节点都需要启动后再验证

zkServer.sh start

验证

出现Mode: follower或Mode: leader就是启动成功

zkServer.sh status

###### 9.hadoop配置hdfs(所有节点可以用同一份配置)

1)修改hadoop-env.sh文件,添加启动的java路径,分布式部署后,每个地方的java路径不一定相同

#编辑hadoop-env.sh文件

vi $HADOOP_HOME/etc/hadoop/hadoop-env.sh

#取消对应注释并修改为对应java路径

export JAVA_HOME=/usr/java/jdk

2)修改core-site.xml文件,添加启动的namenode节点、zookeeper 节点和对应端口

#编辑core-site.xml文件

vi $HADOOP_HOME/etc/hadoop/core-site.xml

#修改并添加启动的namenode节点、zookeeper 节点和对应端口

fs.defaultFS

hdfs://mycluster

ha.zookeeper.quorum

node01:2181,node02:2181,node03:2181

hadoop.tmp.dir

/bigdata/hadoop/tmp

io.file.buffer.size

131702

3)编辑workers,指定从哪些节点里启动DataNode(2.x版本是编辑slaves)

#编辑workers文件

vi $HADOOP_HOME/etc/hadoop/workers

#在workers文件里修改并添加DataNode启动节点(把里面默认的localhost去掉)

node02

node03

4)修改hdfs-site.xml文件,添加副本数量、hdfs的web访问地址、SecondaryNameNode的web访问地址等配置

#编辑hdfs-site.xml文件

vi $HADOOP_HOME/etc/hadoop/hdfs-site.xml

#设置namenode,datanode文件存储地址,web地址等配置

dfs.namenode.name.dir

/bigdata/hadoop/hdfs_name

dfs.datanode.data.dir

/bigdata/hadoop/hdfs_data

dfs.nameservices

mycluster

dfs.ha.namenodes.mycluster

nn1,nn2

dfs.namenode.rpc-address.mycluster.nn1

node01:8081

dfs.namenode.rpc-address.mycluster.nn2

node02:8081

dfs.namenode.http-address.mycluster.nn1

node01:50070

dfs.namenode.http-address.mycluster.nn2

node02:50070

dfs.namenode.shared.edits.dir

qjournal://node01:8485;node02:8485;node03:8485/mycluster

dfs.journalnode.edits.dir

/bigdata/hadoop/ha_hdfs_journal

dfs.client.failover.proxy.provider.mycluster

org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider

dfs.ha.fencing.methods

sshfence

dfs.ha.fencing.ssh.private-key-files

~/.ssh/id_rsa

dfs.ha.automatic-failover.enabled

true

###### 10.格式化并启动

1)修改hadoop文件权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /usr/hadoop

chown -R hadoop /usr/hadoop

chmod -R 770 /usr/hadoop

2)创建数据存储文件夹

node01节点、node01节点、node03节点都需要创建

mkdir -p /bigdata/hadoop

3)修改数据存储文件夹权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /bigdata

chown -R hadoop /bigdata

chmod -R 770 /bigdata

4)切换到对应用户

node01节点、node01节点、node03节点都切换到hadoop用户

su hadoop

5)把所有JournalNode节点的JournalNode启动一下

这里node01、node02、node03都作为JournalNode节点,所以都需要启动

hdfs --daemon start journalnode

6)选择一个NameNode做格式化,只需要格式化一次NameNode就行,不然会出现不同id,其他NameNode进行同步即可

这里node01、node02都作为NameNode节点,这里选择在node01上执行,并启动NameNode,以备其他NameNode同步

hdfs namenode -format

hdfs --daemon start namenode

7)在其他NameNode节点中同步NameNode

这里node01、node02都作为NameNode节点,这里node01格式化了,所以在node02执行同步即可

hdfs namenode -bootstrapStandby

8)格式化Zookeeper

只需一个节点进行格式化即可

hdfs zkfc -formatZK

9)启动hdfs

start-dfs.sh

10)验证

使用jps验证

node01应有:NameNode、DFSZKFailoverController、QuorumPeerMain、JournalNode

node02应有:NameNode、DFSZKFailoverController、DataNode、QuorumPeerMain、JournalNode

node03应有:DataNode、QuorumPeerMain、JournalNode

jps

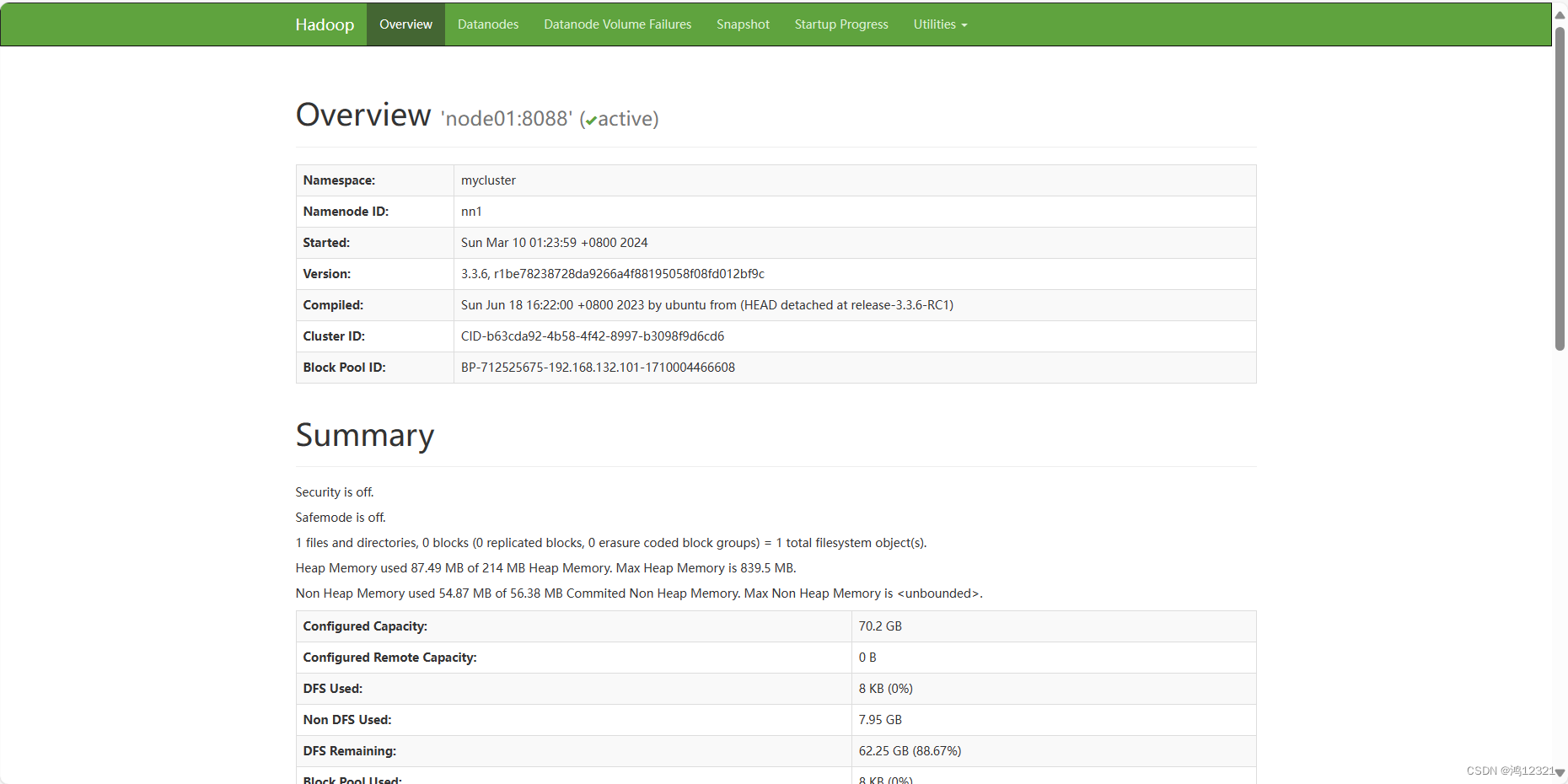

11)可以通过http://192.168.132.101:50070查看NameNode管理页面,多个NameNode只会有一个active

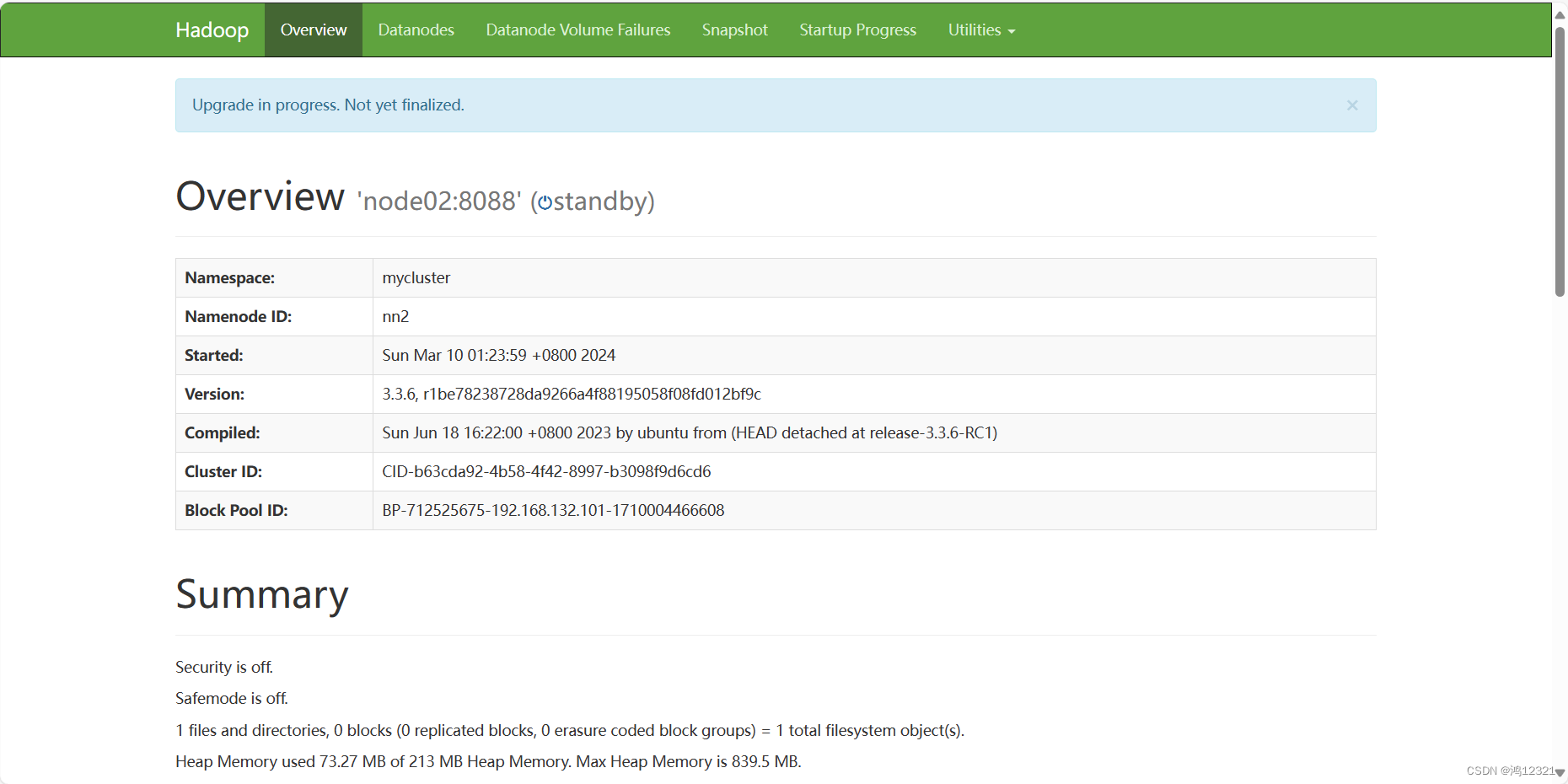

12)可以通过http://192.168.132.102:50070查看NameNode管理页面,多个NameNode只会有一个active

### 三、MapReduce环境

###### 1.MapReduce节点

MapReduce主要用于分布式计算,分为ResourceManager和NodeManager。

ResourceManager:主要用于资源管理。

NodeManager:每个DataNode节点上都会有NodeManager,会定时向ResourceManager汇报自身DataNode的资源情况。

###### 2.执行原理

1)用户向yarn的ResourceManager提交应用

2)ResourceManager通知一台不忙的NodeManager启动一个Container,在里面启动一个AppMaster。

3)AppMaster启动后从hdfs下载对应的切片清单,然后向ResourceManager请求获取切片清单对应的资源

4)ResourceManager收到AppMaster的请求后,会根据自己掌握的资源情况找到对应合适的NodeManager分配一个Container并反向注册到AppMaster

5)AppMaster将任务Task发送给Container

6)Container会反射相应的Task类为对象,调用方法执行

###### 3.高可用故障转移原理

1)ResourceManager高可用性是通过活动/备用架构实现的。

2)在任何时间点,其中一个ResourceManager都是活动的,而一个或多个ResourceManager处于备用模式,等待在活动RM发生任何情况时接管。

3)当活动ResourceManager停止工作或变得无响应时,另一个ResourceManager会自动被选为活动ResourceManager,然后接管工作。ResourceManager中嵌入的ActiveStandbyElector充当故障检测器和领导者选举器,而不是单独的ZKFC守护程序。

### 四、MapReduce搭建(3个节点可以用同一份配置)

###### 1.文件配置

1)修改mapred-site.xml

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

rceManager处于备用模式,等待在活动RM发生任何情况时接管。

3)当活动ResourceManager停止工作或变得无响应时,另一个ResourceManager会自动被选为活动ResourceManager,然后接管工作。ResourceManager中嵌入的ActiveStandbyElector充当故障检测器和领导者选举器,而不是单独的ZKFC守护程序。

### 四、MapReduce搭建(3个节点可以用同一份配置)

###### 1.文件配置

1)修改mapred-site.xml

[外链图片转存中...(img-d8bojFqQ-1714232364305)]

[外链图片转存中...(img-Ck10NUW0-1714232364306)]

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

本文详细介绍了如何在多节点环境中安装和配置Java、Hadoop、Zookeeper以及MapReduce,包括环境变量设置、SSH免密登录、Zookeeper集群配置、HDFS和YARN的高级配置,以及MapReduce的节点结构和故障转移机制。

本文详细介绍了如何在多节点环境中安装和配置Java、Hadoop、Zookeeper以及MapReduce,包括环境变量设置、SSH免密登录、Zookeeper集群配置、HDFS和YARN的高级配置,以及MapReduce的节点结构和故障转移机制。

779

779

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?