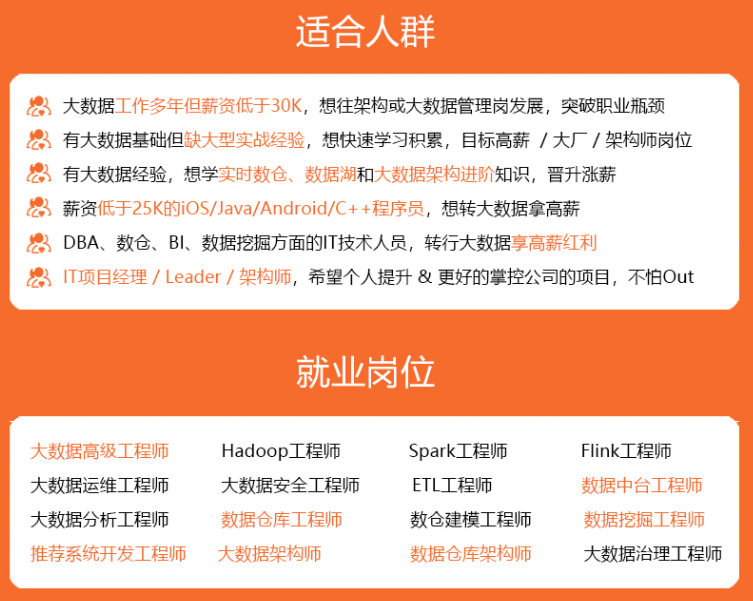

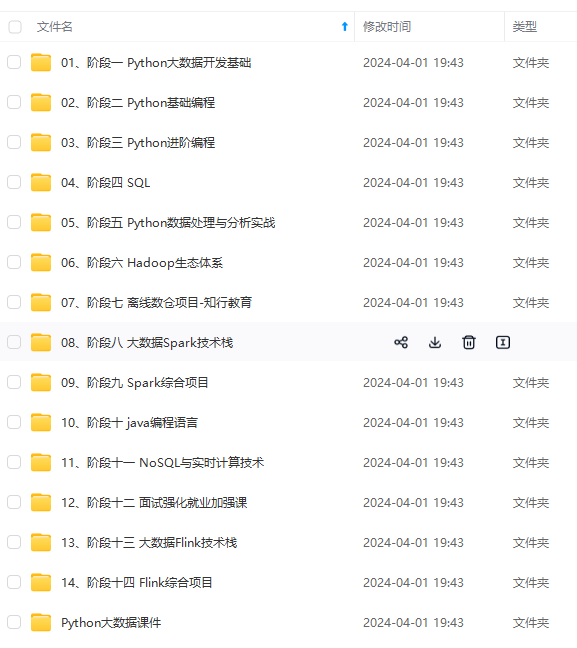

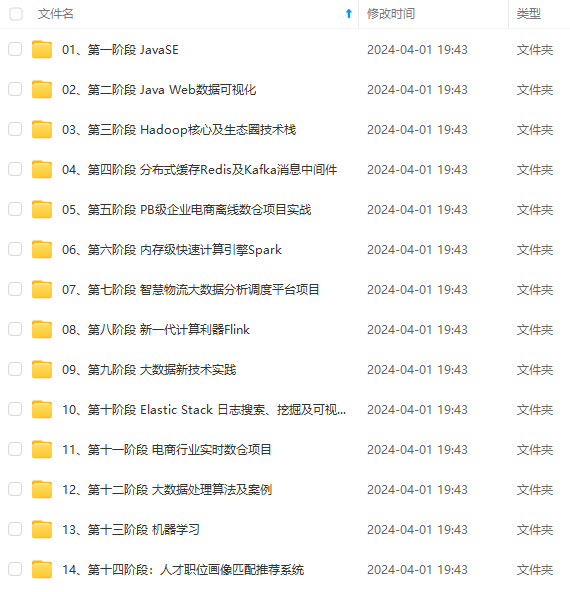

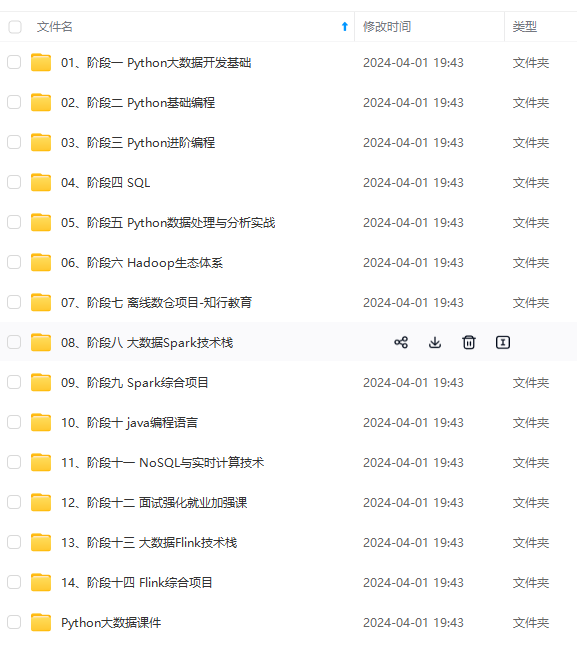

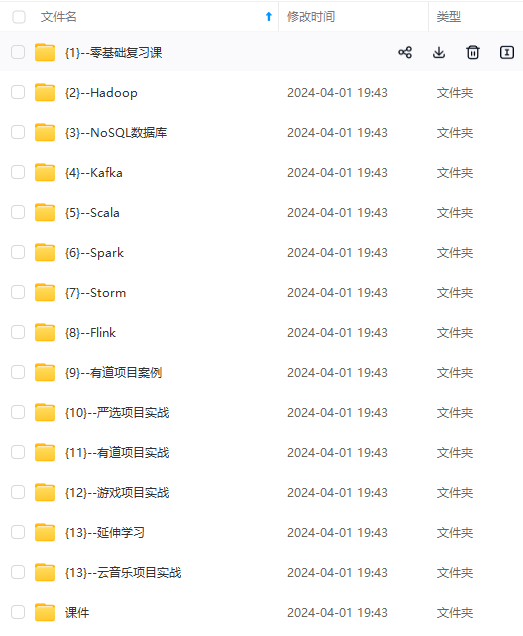

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

每天一道大厂SQL题【Day16】腾讯外包(微信相关)真题实战(一)

大家好,我是Maynor。相信大家和我一样,都有一个大厂梦,作为一名资深大数据选手,深知SQL重要性,接下来我准备用100天时间,基于大数据岗面试中的经典SQL题,以每日1题的形式,带你过一遍热门SQL题并给出恰如其分的解答。

一路走来,随着问题加深,发现不会的也愈来愈多。但底气着实足了不少,相信不少朋友和我一样,日积月累才是最有效的学习方式!

前五天我们学习了微众银行的5道SQL题,不良率,逾期率,Vintage账龄各种率搞的头昏脑胀,今天换一种口味,来道Python题。

每日语录

遇到困难的时候暂时放一放,第二天的时候,就再也想不起来了。

第16题:Python数据清洗转换

需求列表

1. Python数据清洗转换

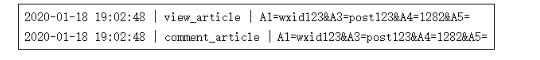

数据分析师小 Q 收到一份微信用户行为 log 文件,文件中每一行包含三列 (ftime, event_code, event_value) 数据样例如下:

2020-01-18 19:02:48 | view_article | A1=wxid123&A3=post123&A4=1282&A5=

2020-01-18 19:02:48 | comment_article | A1=wxid123&A3=post123&A4=1282&A5=

说明:

说明:

第一列 ftime 记录了用户行行为时间例如 2020-01-18 19:02:48

第二列 event_code 记录了用户事件id, 例如 ‘view_article’ = 阅读文章,

‘comment_article’ = 评论文章

第三列 event_value 记录了事件详情,例如 ‘A1=wxid123&A3=post123&A4=1&A5=’ A1 表示用户 ID

A3 表 示 文 章 ID

A4 表示文章类型

请帮助小 Q 实现一个函数,从文件中提取出用户阅读文章的行为字段(时间,用户ID,文章 ID)

思路分析

使用PySpark读取微信日志数据,并对数据进行转换和清洗,最终将清洗后的结果RDD保存到HDFS中。在if name == ‘main’:代码块中,先创建了一个SparkConf配置对象和一个SparkContext上下文对象,然后使用SparkContext上下文对象从本地文件系统中读取微信日志数据,并将每行数据作为RDD的一个元素。接着定义了一个函数data_wash用于将每行日志数据进行转换清洗,并返回清洗后的结果。最后,使用RDD的map函数将原始日志数据RDD中的每个元素都应用data_wash函数进行清洗和转换,得到清洗后的结果RDD,并将结果RDD保存到HDFS中。最后,使用SparkContext的stop函数关闭SparkContext上下文对象,释放资源。

答案获取

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

7814

7814

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?