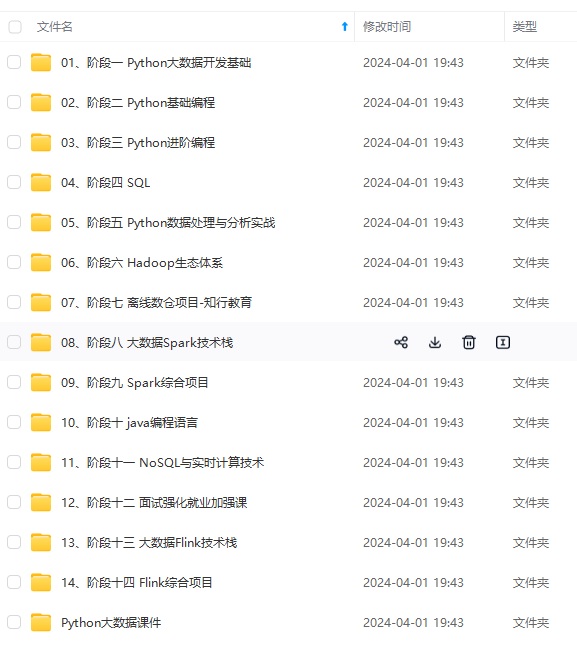

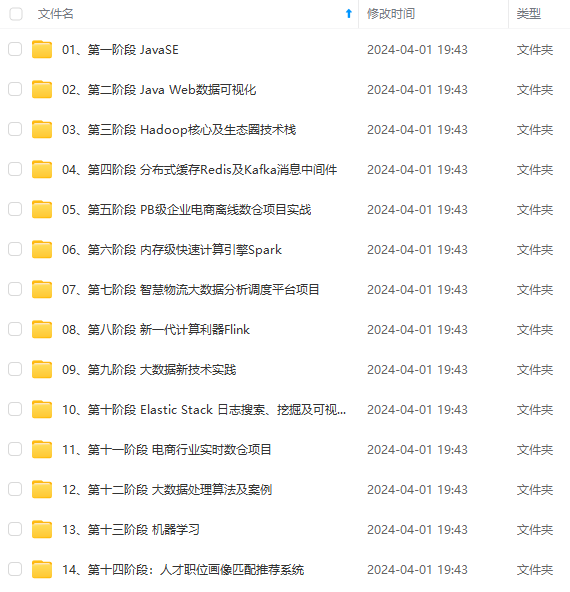

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

三、flume安装配置

1、flume下载安装

# 下载解压

wget --no-check-certificate https://dlcdn.apache.org/flume/1.11.0/apache-flume-1.11.0-bin.tar.gz

tar -xzvf apache-flume-1.11.0-bin.tar.gz

mv apache-flume-1.11.0-bin/ /data/flume/

2、配置环境变量

新增环境变量文件

vi /etc/profile.d/flume_env.sh

export FLUME\_HOME=/data/flume

export PATH=$PATH:$FLUME\_HOME/bin

使用source让新增环境生效

source /etc/profile

在命令行中输入flume-ng version命令,如果返回Flume的版本信息,则说明安装成功。

3、配置flume服务器属性

本例演示 flume 读取日志文件,然后发送到kafka中

1)配置日志存储路径

在flume主目录,执行 vim conf/log4j2.xml

<Property name="LOG_DIR">/data/flume/logs</Property>

2)新建配置文件 conf/job/file_to_kafka.conf,内容如下:

# 定义Agent的组件

# 设置source的名称为rl

al.sources = rl

# 设置channel的名称为cl

al.channels = cl

# 配置source

# 指定source的类型为TAILDIR,这是一个能够追踪文件变化并读取新增内容的source

al.sources.rl.type = TAILDIR

# 定义文件组fl,这里fl是一个标识符,可以定义多个文件组,每个文件组可以包含多个文件模式

al.sources.rl.filegroups = fl

# 指定文件组fl的文件路径模式,/data/applog/log/app.* 表示匹配/data/applog/log/目录下以app开头的所有文件

al.sources.rl.filegroups.fl = /data/applog/log/app.*

# 指定positionFile的位置,该文件用于记录TAILDIR source读取文件的偏移量,以便在Flume重启后可以从上次的位置继续读取

al.sources.rl.positionFile = /data/flume/data/taildir_position.json

# 配置channel

# 设置channel的类型为KafkaChannel,即数据将发送到Kafka

al.channels.cl.type = org.apache.flume.channel.kafka.KafkaChannel

# 指定Kafka集群的地址和端口,这里配置了3个Kafka broker

al.channels.cl.kafka.bootstrap.servers = hadoop131:9092,hadoop132:9092,hadoop133:9092

# 设置发送到Kafka的主题名称

al.channels.cl.kafka.topic = topic_log

# 设置parseAsFlumeEvent为false,表示发送到Kafka的数据不会被封装为Flume的Event格式,而是保持原始格式

al.channels.cl.parseAsFlumeEvent= false

# 组装source和channel

# 将source rl连接到channel cl,表示rl读取的数据将发送到cl指定的Kafka channel中

al.sources.rl.channels = cl

这份配置文件定义了一个简单的Flume Agent,它使用TAILDIR source来监控某个目录下的日志文件变化,并将新增的日志内容发送到Kafka。配置文件中的注释详细解释了每个配置项的作用和含义。在实际部署时,需要根据实际环境调整配置文件中的路径、Kafka集群地址、主题名称等参数。

另外,请注意,Flume的Kafka Channel在某些版本中可能已经被标记为过时,推荐使用Kafka Sink。如果你使用的是较新的Flume版本,并且希望使用推荐的配置,那么应该使用Kafka Sink而不是Kafka Channel。在这种情况下,你需要配置一个Kafka Sink并将其绑定到一个普通的Memory Channel或File Channel。

使用Kafka Sink的配置示例如下:

# Define the components of the agent

agent.sources = tailSource

agent.channels = memoryChannel

agent.sinks = kafkaSink

# Configure the source - TAILDIR

agent.sources.tailSource.type = TAILDIR

agent.sources.tailSource.filegroups = f1

agent.sources.tailSource.filegroups.f1 = /path/to/your/logfile.log

agent.sources.tailSource.positionFile = /path/to/flume/taildir_position.json

agent.sources.tailSource.fileHeader = true

# Configure the channel - Memory

agent.channels.memoryChannel.type = memory

agent.channels.memoryChannel.capacity = 10000

agent.channels.memoryChannel.transactionCapacity = 1000

# Configure the sink - KafkaSink

agent.sinks.kafkaSink.type = org.apache.flume.sink.kafka.KafkaSink

agent.sinks.kafkaSink.kafka.bootstrap.servers = kafka-server-1:9092,kafka-server-2:9092

agent.sinks.kafkaSink.kafka.topic = flume-logs

agent.sinks.kafkaSink.channel = memoryChannel

# Bind the source and channel, and the sink and channel

agent.sources.tailSource.channels = memoryChannel

agent.sinks.kafkaSink.channel = memoryChannel

在这个示例中,我们配置了一个TAILDIR Source、一个Memory Channel和一个Kafka Sink。TAILDIR Source读取日志文件,Memory Channel在内存中缓存事件,Kafka Sink负责将事件发送到Kafka。

5、启动flume

1)创建flume启动脚本f1.sh

vi /usr/bin/f1.sh

# 修改文件权限

chmod 777 /usr/bin/f1.sh

2)复制如下内容

#!/bin/bash

#1. 判断参数个数

if [ $# -lt 1 ]

then

echo Not Enough Arguement!

exit;

fi

case $1 in

"start")

#遍历集群所有机器

for host in hadoop131

do

echo -------------------- $host flume 启动 --------------------

ssh $host "/data/flume/bin/flume-ng agent -n al -c /data/flume/conf/ -f /data/flume/conf/job/file\_to\_kafka.conf >/dev/null 2>&1 &"

done

;;

"stop")

#遍历集群所有机器

for host in hadoop131

do

echo -------------------- $host flume 停止 --------------------

ssh $host "ps -ef | grep file\_to\_kafka | grep -v grep | awk '{print \$2}' |xargs -n1 kill 9"

done

;;

*)

echo "Input Args Error..."

;;

esac

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?