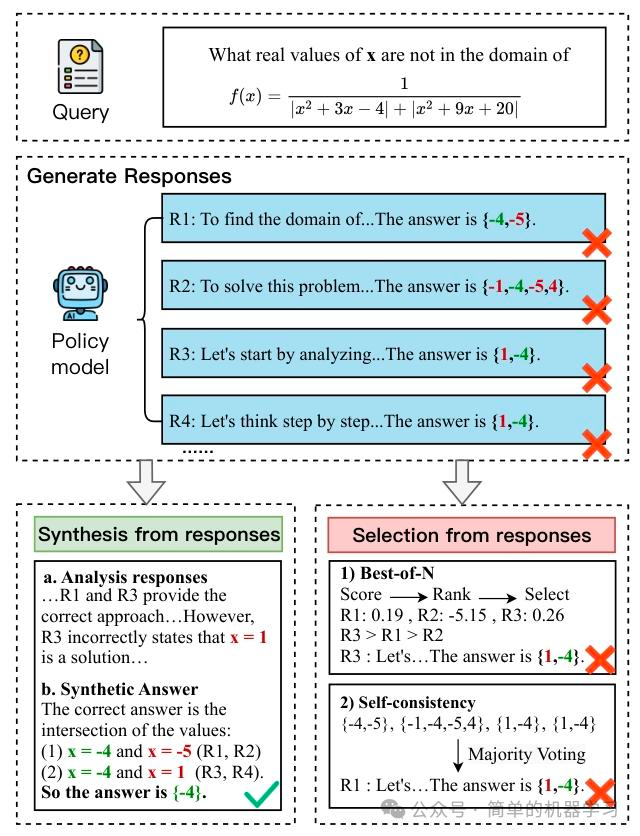

大语言模型(LLM)在处理复杂推理任务时,往往难以一次性生成准确的答案。虽然如 Self-consistency(自一致性) 和 Best-of-N(N选一) 等在一定程度上提高了模型的推理性能,但它们依赖于候选回答的质量,且在所有候选回答都错误时无法生成正确答案。基于此,本文介绍《CoT-based Synthesizer: Enhancing LLM Performance through Answer Synthesis》,提出了CoT-based Synthesizer,通过结合Chain-of-Thought(CoT)推理,分析多个候选回答的互补信息,合成更优的答案,即使所有候选回答都存在错误。

问题定义

给定一个用户查询 ,策略模型会从概率分布中进行 次随机采样生成,生成一组候选回答,记为 ,其中 表示第 个候选答案。这些候选回答与用户查询 一起组成 。随后,一个称为 合成器(Synthesizer) 的分析与合成模型会被用来重新生成一个新的答案 。这个过程可以形式化为:

其中, 表示应用于查询 和候选回答集 的合成函数,最终生成答案 。

❝

策略模型:策略模型是指直接生成用户查询响应的模型。它通过多次随机采样生成多个候选回答。

候选回答集:策略模型生成的多个候选回答 ,这些回答可能包含正确的、部分正确的或完全错误的答案。

合成器:合成器是一个后处理模型,它的任务是通过分析候选回答集中的信息,生成一个新的、更优的答案 。

示例

方法论

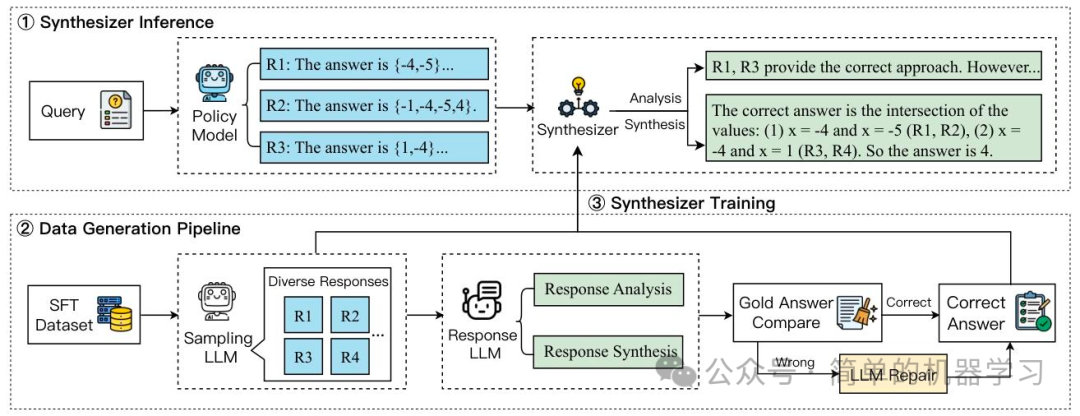

CoT-based Synthesizer,通过分析多个候选回答的互补信息,合成更优的答案。为了实现这一目标,设计了一个两阶段的数据生成管道,用于构建高质量的合成训练数据,并基于这些数据训练了一个较小的LLM(Synthesizer-8B),以提升大模型的推理性能。

合成器推理

多样化回答生成

为了生成多样且高质量的候选回答,采用了以下解码策略:

-

高采样温度:设置较高的采样温度(),以增加生成回答的随机性,促进多样性。

-

Top-P采样:使用Top-P采样(),仅保留累积概率达到的最可能的token,避免生成语义无关的低概率候选回答,确保生成的回答具有连贯性和相关性。

通过这些策略,生成一组多样且连贯的候选回答 。

回答分析与合成

生成候选回答后,合成器会对这些回答进行分析和合成,生成最终的答案。具体步骤如下:

-

回答分析:合成器首先分析用户查询 与每个候选回答 之间的关系,考虑回答的频率、相关性和准确性。虽然高频回答可能具有较高的可信度,但合成器并不完全依赖频率作为评估标准,而是优先考虑逻辑一致性和事实准确性,从而识别出部分正确或误导性的回答,并从中提取有价值的信息。

-

回答合成:如果候选回答中存在正确答案,合成器会进一步从其他候选回答中提取有效的推理步骤,丰富最终答案。如果所有候选回答都存在缺陷,合成器会利用其推理能力,整合多个候选回答中的合理元素,构建一个更连贯和准确的答案。

数据生成管道

为了训练CoT-based Synthesizer,设计了一个两阶段的数据生成管道,确保生成的训练数据具有高质量和多样性。

合成答案生成

对于给定的训练查询 ,首先使用采样LLM(如Llama3-8B-Instruct)生成候选回答集 。然后,将这些候选回答输入到高性能响应LLM(如Llama3.1-70B-Instruct)中,生成合成答案。由于查询 的复杂性,响应LLM可能无法在第一次尝试中生成准确的答案。因此,进行了多次采样(如 次),显著增加了获得正确答案的可能性。为了确保合成答案的质量,使用黄金答案 进行过滤,保留包含CoT分析和合成的正确回答 。

LLM修复

当所有候选回答 都错误时,响应模型在初始采样阶段难以生成正确的合成答案。为此,需明确告知响应模型所有候选回答 都是错误的,并提示其反思这些回答中的错误。通过分析错误的回答,模型能够识别出有效的推理步骤,并生成更可能正确的答案。然后,对新生成的回答进行过滤,保留正确的回答 。

合成器训练

通过上述数据生成管道,构建了合成训练数据集 ,其中 表示用户查询, 是候选回答集, 是由响应LLM生成的正确合成答案。基于该数据集,本文训练了CoT-based Synthesizer-8B模型。该模型以用户查询 和候选回答集 作为输入,生成正确答案 作为输出。生成概率定义为:

其中, 是序列长度, 是第 个目标token, 表示已生成的上下文(即所有之前的token)。

通过训练,模型学会了如何利用用户查询 和候选回答集 生成准确且上下文相关的答案 ,从而增强了其推理和合成能力。

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

学习路线

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?