大模型技术迭代的速度正以“月”为单位颠覆行业认知——2025年的面试战场,早已不是比拼手写Transformer公式或调参技巧的擂台。随着技术落地深水区的到来,企业对人才的筛选逻辑发生剧变:能否用大模型撕开商业缺口,成为衡量价值的唯一标尺。

本文基于上百场真实面试复盘,提炼出2025年大厂高频考题的四大核心模块:

- 技术深水区攻坚(如多模态对齐中的模态冲突消解、MoE架构的动态负载优化)

- 工程化绞杀战(千亿模型端侧部署、推理延迟与成本的帕累托最优解)

- 商业闭环设计(从Agent工作流重构传统业务,到AB测试框架量化模型收益)

- 合规性攻防(模型幻觉的实时监测、数据隐私与输出安全性的平衡术)

题目覆盖字节“直播场景多模态实时互动方案”、阿里“大模型驱动的供应链决策系统”、腾讯“游戏NPC人格一致性保持”等真实业务场景,每道题附三阶解析:技术方案设计→工程陷阱预判→ROI测算推演。

无论你是想冲刺大厂的应届生,还是计划从传统算法转型的老兵,这份手册将帮你跳过“技术内卷”的泥潭,直击“技术变现”的靶心——2025年,大模型的竞争注定属于那些左手握算法,右手执商业的“双核破壁人”。

字X跳动 大模型高频面试题

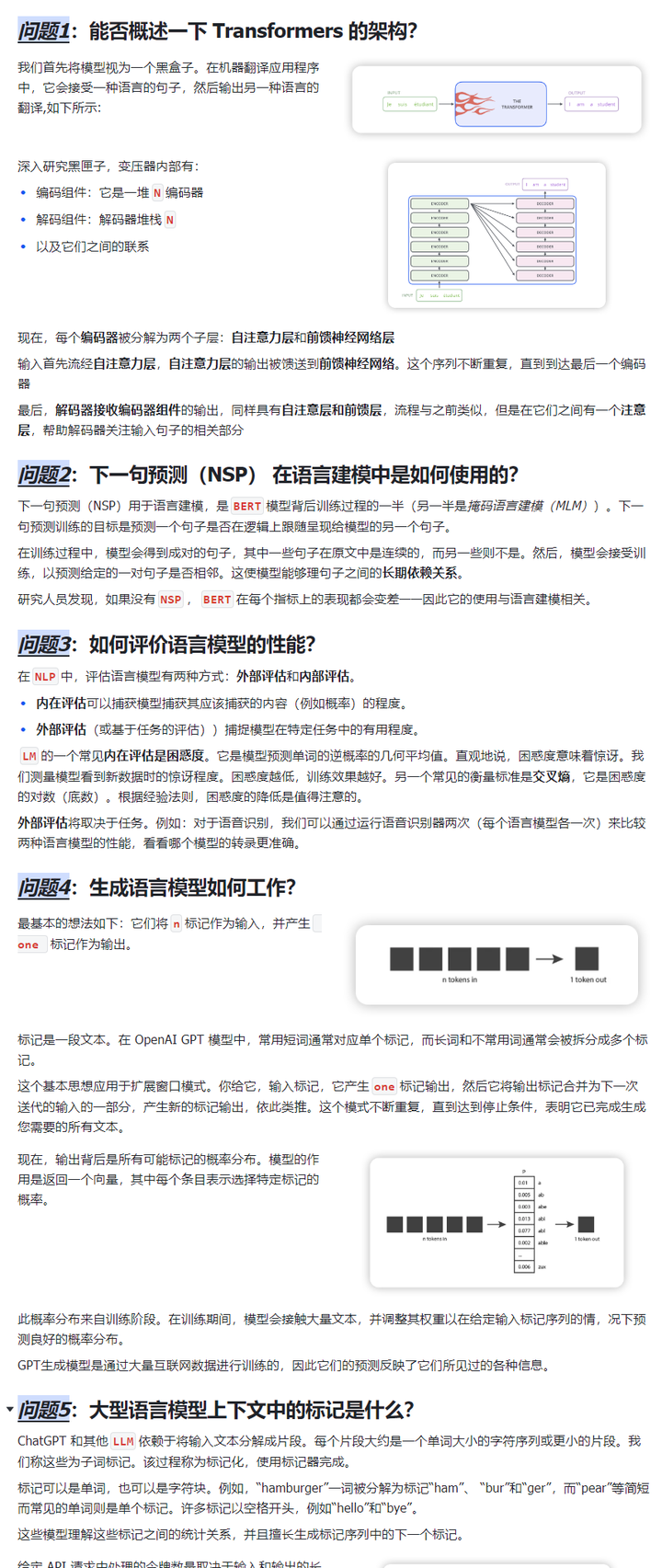

- 能否概述一下 Transformers 的架构?

- 下一句预测(NSP)在语言建模中是如何使用的?

- 如何评价语言模型的性能?

- 生成语言模型如何工作?

- 大型语言模型上下文中的标记是什么?

- 在NLP中使用基于Transformer的架构与基于LSTM的架构有何优势?

- 能是供一些大型语言模型中对齐问题的例子吗?

- 自适应 Softmax在大型语言模型中有何用处?

- BERT训练如何进行?

- Transformer 网络比比CNN和RNN有何优势?

- 有没有办法训练大型语言模型(LLM)来存储特定的上下文?

- 您可以在LLM中使用哪些迁移学习技术?

- 什么是迁移学习?为什么它很重要?

- 编码器和解码器模型有什么区别?

- Wordpiece和 BPE有什么区别?

- (LLMD) 中的全局注意力和局部注意力有何区别?

- LLM 中的next-token-prediction和 masked-language-modeling有什么区别?

- 为什么基于Transformer 的架构中需要多头注意力机制?

- 为什么要使用编码册-解码册RNN而不是普通的序列到序列RNN进行自动翻译?

- 解释一下Transformer 架构中的Self-Attention机刷是什么?

- 迁移学习如何在(LLM)中发挥作用?

- LLM参数与神经网络中的权量有何关系?

- 精细调整LLM有哪些缺点?

- BERT 中的Word Embedding、Position Embedding和 PositionalEncoding有什么区别?

- 基于特征的迁移学习与(LLM)中的微调有何区别?

- 为什么transformer 需要位量编码?

腾X 大模型高频面试题

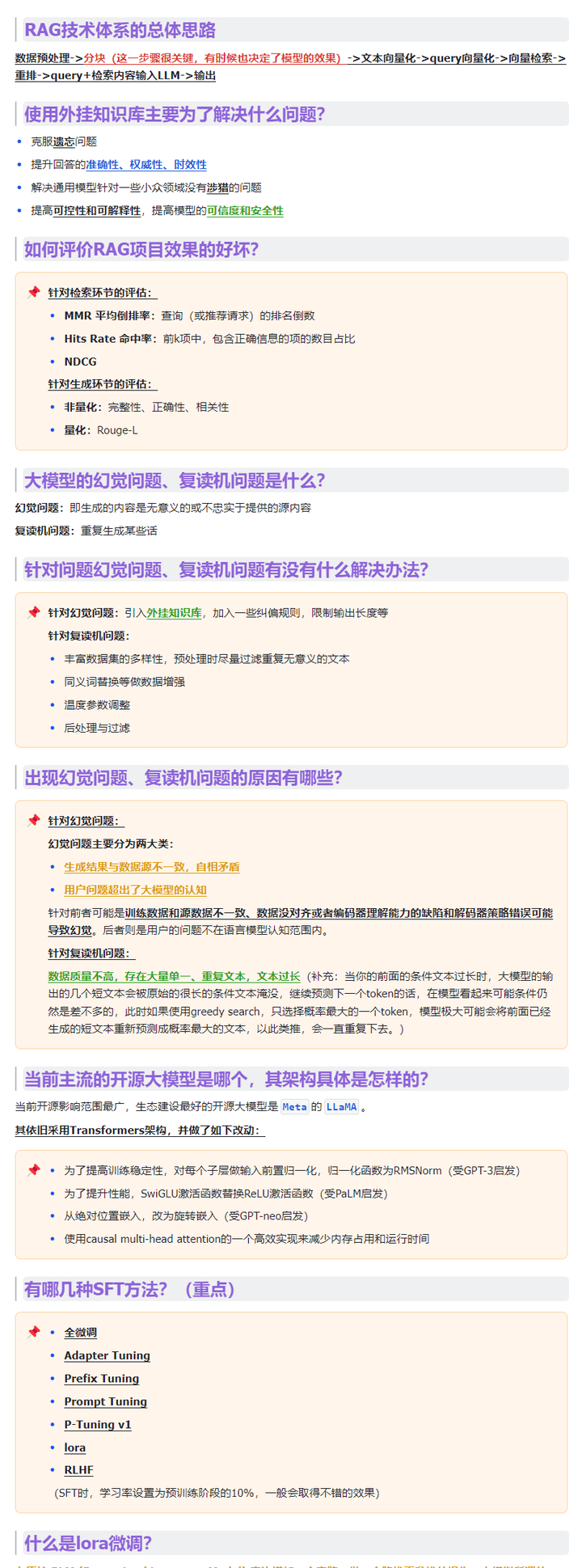

- RAG技术体系的总体思路

- 使用外挂知识库主要为了解决什么问题?

- 如何评价RAG项目效果的好坏?

- 大模型的幻觉问题、复读机问题是什么?

- 针对问题幻觉问题、复读机问题有没有什么解决办法?

- 出现幻觉问题、复读机问题的原因有哪些?

- 当前主流的开源大模型是哪个,其架构具体是怎样的?

- 有哪几种SFT方法?(点)

- 什么是lona微调?

- RAG的检素阶段,常见的向量检素模型有哪些?

- 针对通用的RAG,你觉得还有哪些改进点?

- 什么是LangChain?

- LangChain的常用模块有哪些?

- SFT和RLHF优劣对比比

- 大模型训练经常出现一些OOM问题,在现有硬件基础下,有什么性能提升trick

- LLaMA模型输入句子理论上可以无限长吗?

- 如何让大横型处理更长的文本?

- 大模型推理时,显存中有那几那分数据?

- 介绍下ChatGLM

- 介绍下GLU撇活语数和SwiGLU邀活通数

- LLaMA1/2的异同

- 模型在训练和推理的时候各占用显存的多少?

- 详细说说Deepspeed的机制

- 什么是混合精度训练?

- 什么是prefix LLM和casual LLM

- 说一说针对MHA后续的一些计算优化工作

- 说说attention几种常见的计算方式

阿X巴巴 大模型高频面试题

一、基础面

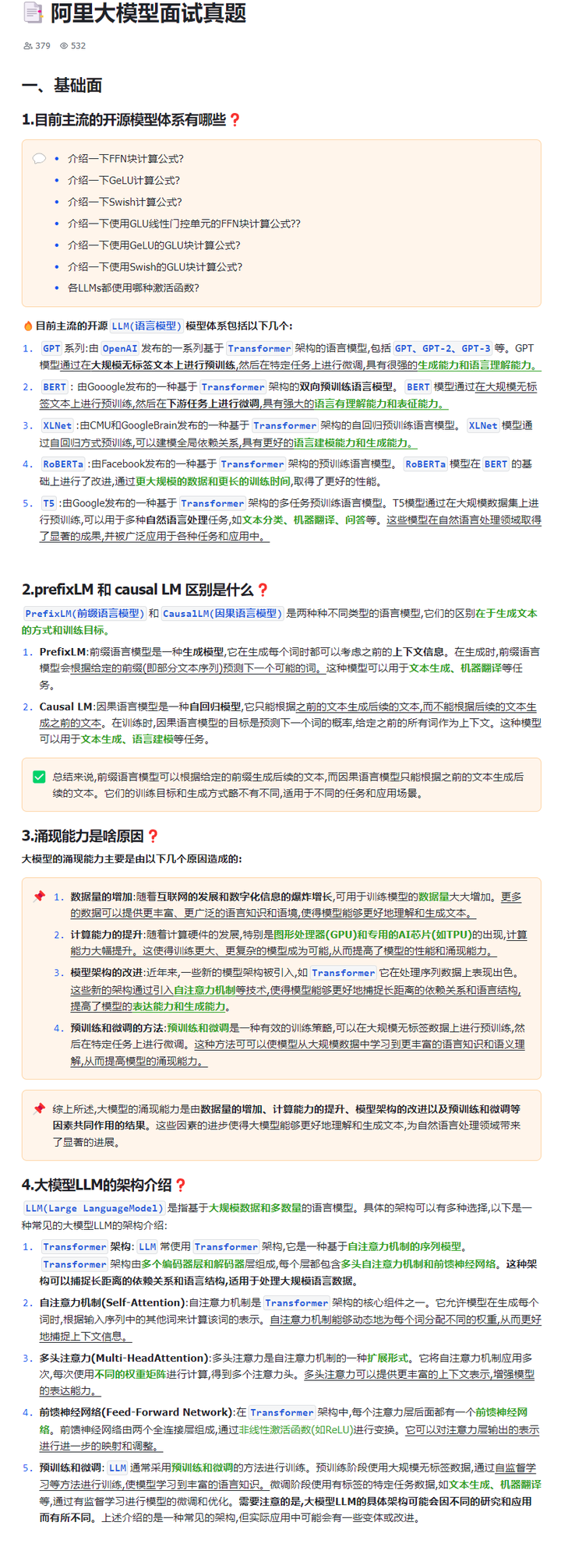

- 目前主流的开源模型体系有哪些?

- prefixLM和causal LM区别是什么?

- 涌现能力是啥原因?

- 大模型LLM的架构介绍?

二、进阶面

- 什么是LLMS复读机问题?

- 为什么会出现LLMS复读机问题?

- 如何缓解LLMS复读机问题?

- llama输入句子长度理论上可以无限长吗?

大厂LLM面试必考题

- Transformer的优缺点

- Encoder端和Decoder端是如何进行交互的?

- 为什么需要multi-head attention?

- QK为什么要除以dk来进行Scale?

- 为什么使用不同的K和Q,为什么不能使用同一个值?

- 在计attention score的时如何对padding做mask操作?

- self-attention是什么?

- 关于 self-attention为什么它能发挥如此大的作用?

- Transformer 中的Add & Norm 模块,具体是怎么做的?

- 简单介绍一下Transformer的位量编码?有什么意义和优缺点?

- 为什么transformer块使用LayerNormi而不是BatchNorm?

- Decoder阶段的多头自注意力和encoder的多头自注意力有什么区别?

- Transformer attention的注意力矩阵的计算为什么用乘法而不是加法?

- Transformer的残差结构及意义

- Transformer的并行化体现在哪里,Decoder可以做并行化吗?

如何学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

学习路线

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?