coding=gbk

“”"

作者:川川

公众号:玩转大数据

@时间 : 2022/2/18 19:03

群:701163024

“”"

from pandas import read_csv

from pandas import datetime

from sklearn.metrics import mean_squared_error

from math import sqrt

from matplotlib import pyplot

加载数据

def parser(x):

return datetime.strptime(x, ‘%Y/%m/%d’) #年月日

series = read_csv(‘data_set/BT.csv’, header=0, parse_dates=[0], index_col=0, squeeze=True,

date_parser=parser)

分成训练和测试集合,前24列给训练集,后12行给测试集

X = series.values

train, test = X[0:-12], X[-12:]

‘’’

步进验证模型:

其实相当于已经用train训练好了模型

之后每一次添加一个测试数据进来

1、训练模型

2、预测一次,并保存预测结构,用于之后的验证

3、加入的测试数据作为下一次迭代的训练数据

‘’’

#把数组train赋值给一个history列表

history = [x for x in train]

#创建一个predictions列表,这个列表记录了观测值,创建一个predictions数组中第n个元素,对应test数组中第n-1个元素

predictions = list()

for i in range(len(test)):

predictions.append(history[-1]) # history[-1],就是执行预测,这里我们只是假设predictions数组就是我们预测的结果

history.append(test[i]) # 将新的测试数据加入模型

预测效果评估

rmse = sqrt(mean_squared_error(test, predictions))#返回的结果是测试数组test,和观测数组predictions的标准差,https://www.cnblogs.com/nolonely/p/7009001.html

print(‘RMSE:%.3f’ % rmse)

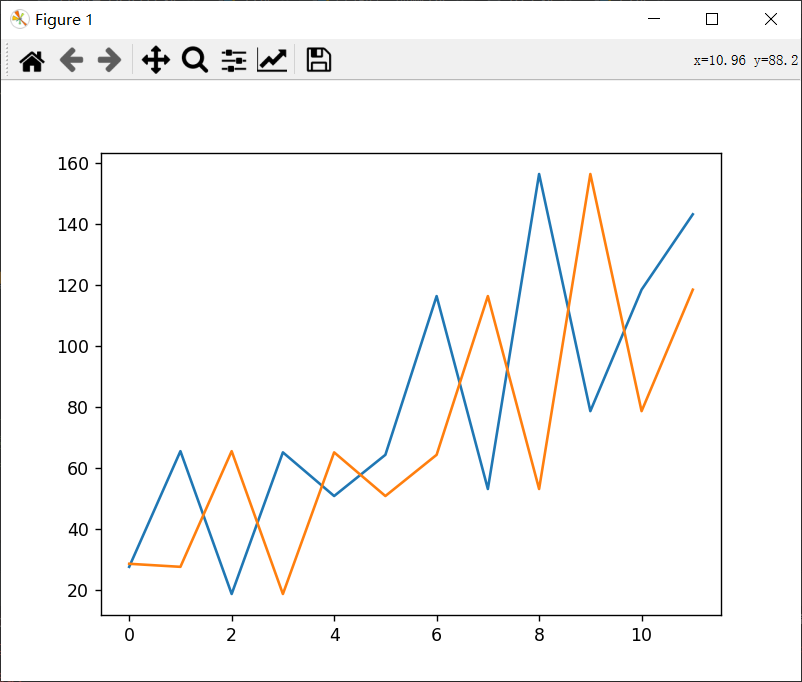

画出预测+观测值

pyplot.plot(test)#测试数组

pyplot.plot(predictions)#观测数组

pyplot.show()

完整文件:

链接:https://pan.baidu.com/s/1FgDKr6ZF__OBuahkpy2PFg?pwd=dat5

提取码:dat5

–来自百度网盘超级会员V3的分享

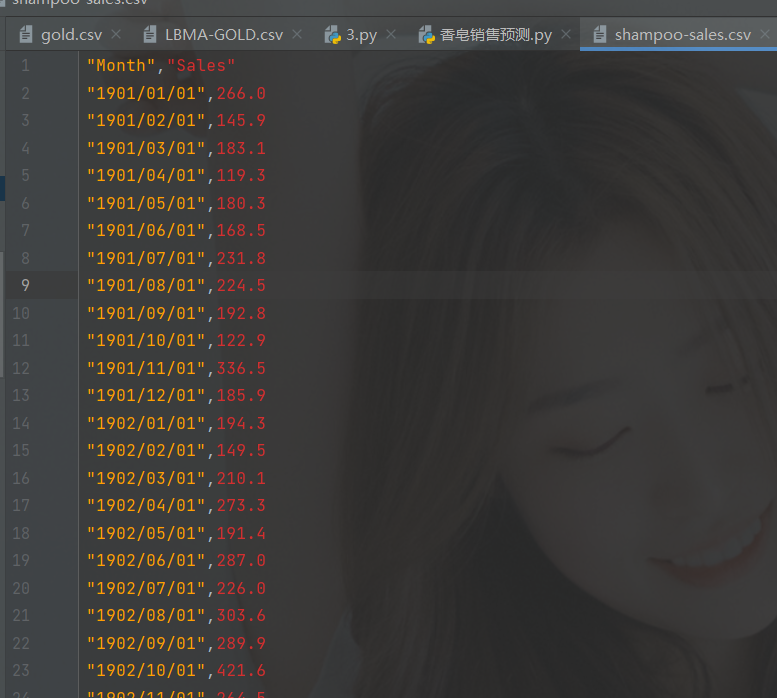

数据还是如下:

代码如下,你可以根据自己的数据集修改一下路径罢了:

coding=utf-8

from pandas import read_csv

from pandas import datetime

from pandas import concat

from pandas import DataFrame

from pandas import Series

from sklearn.metrics import mean_squared_error

from sklearn.preprocessing import MinMaxScaler

from keras.models import Sequential

from keras.layers import Dense

from keras.layers import LSTM

from math import sqrt

from matplotlib import pyplot

import numpy

读取时间数据的格式化

def parser(x):

return datetime.strptime(x, ‘%Y/%m/%d’)

转换成有监督数据

def timeseries_to_supervised(data, lag=1):

df = DataFrame(data)

columns = [df.shift(i) for i in range(1, lag + 1)] # 数据滑动一格,作为input,df原数据为output

columns.append(df)

df = concat(columns, axis=1)

df.fillna(0, inplace=True)

return df

转换成差分数据

def difference(dataset, interval=1):

diff = list()

for i in range(interval, len(dataset)):

value = dataset[i] - dataset[i - interval]

diff.append(value)

return Series(diff)

逆差分

def inverse_difference(history, yhat, interval=1): # 历史数据,预测数据,差分间隔

return yhat + history[-interval]

缩放

def scale(train, test):

根据训练数据建立缩放器

scaler = MinMaxScaler(feature_range=(-1, 1))

scaler = scaler.fit(train)

转换train data

train = train.reshape(train.shape[0], train.shape[1])

train_scaled = scaler.transform(train)

转换test data

test = test.reshape(test.shape[0], test.shape[1])

test_scaled = scaler.transform(test)

return scaler, train_scaled, test_scaled

逆缩放

def invert_scale(scaler, X, value):

new_row = [x for x in X] + [value]

array = numpy.array(new_row)

array = array.reshape(1, len(array))

inverted = scaler.inverse_transform(array)

return inverted[0, -1]

fit LSTM来训练数据

def fit_lstm(train, batch_size, nb_epoch, neurons):

X, y = train[:, 0:-1], train[:, -1]

X = X.reshape(X.shape[0], 1, X.shape[1])

model = Sequential()

添加LSTM层

model.add(LSTM(neurons, batch_input_shape=(batch_size, X.shape[1], X.shape[2]), stateful=True))

model.add(Dense(1)) # 输出层1个node

编译,损失函数mse+优化算法adam

model.compile(loss=‘mean_squared_error’, optimizer=‘adam’)

for i in range(nb_epoch):

按照batch_size,一次读取batch_size个数据

model.fit(X, y, epochs=1, batch_size=batch_size, verbose=0, shuffle=False)

model.reset_states()

print(“当前计算次数:”+str(i))

return model

1步长预测

def forcast_lstm(model, batch_size, X):

X = X.reshape(1, 1, len(X))

yhat = model.predict(X, batch_size=batch_size)

return yhat[0, 0]

加载数据

series = read_csv(‘data_set/shampoo-sales.csv’, header=0, parse_dates=[0], index_col=0, squeeze=True,

date_parser=parser)

让数据变成稳定的

raw_values = series.values

diff_values = difference(raw_values, 1)#转换成差分数据

把稳定的数据变成有监督数据

supervised = timeseries_to_supervised(diff_values, 1)

supervised_values = supervised.values

数据拆分:训练数据、测试数据,前24行是训练集,后12行是测试集

train, test = supervised_values[0:-12], supervised_values[-12:]

数据缩放

scaler, train_scaled, test_scaled = scale(train, test)

fit 模型

lstm_model = fit_lstm(train_scaled, 1, 100, 4) # 训练数据,batch_size,epoche次数, 神经元个数

预测

train_reshaped = train_scaled[:, 0].reshape(len(train_scaled), 1, 1)#训练数据集转换为可输入的矩阵

lstm_model.predict(train_reshaped, batch_size=1)#用模型对训练数据矩阵进行预测

测试数据的前向验证,实验发现,如果训练次数很少的话,模型回简单的把数据后移,以昨天的数据作为今天的预测值,当训练次数足够多的时候

才会体现出来训练结果

predictions = list()

for i in range(len(test_scaled)):#根据测试数据进行预测,取测试数据的一个数值作为输入,计算出下一个预测值,以此类推

1步长预测

X, y = test_scaled[i, 0:-1], test_scaled[i, -1]

yhat = forcast_lstm(lstm_model, 1, X)

逆缩放

yhat = invert_scale(scaler, X, yhat)

逆差分

yhat = inverse_difference(raw_values, yhat, len(test_scaled) + 1 - i)

predictions.append(yhat)

expected = raw_values[len(train) + i + 1]

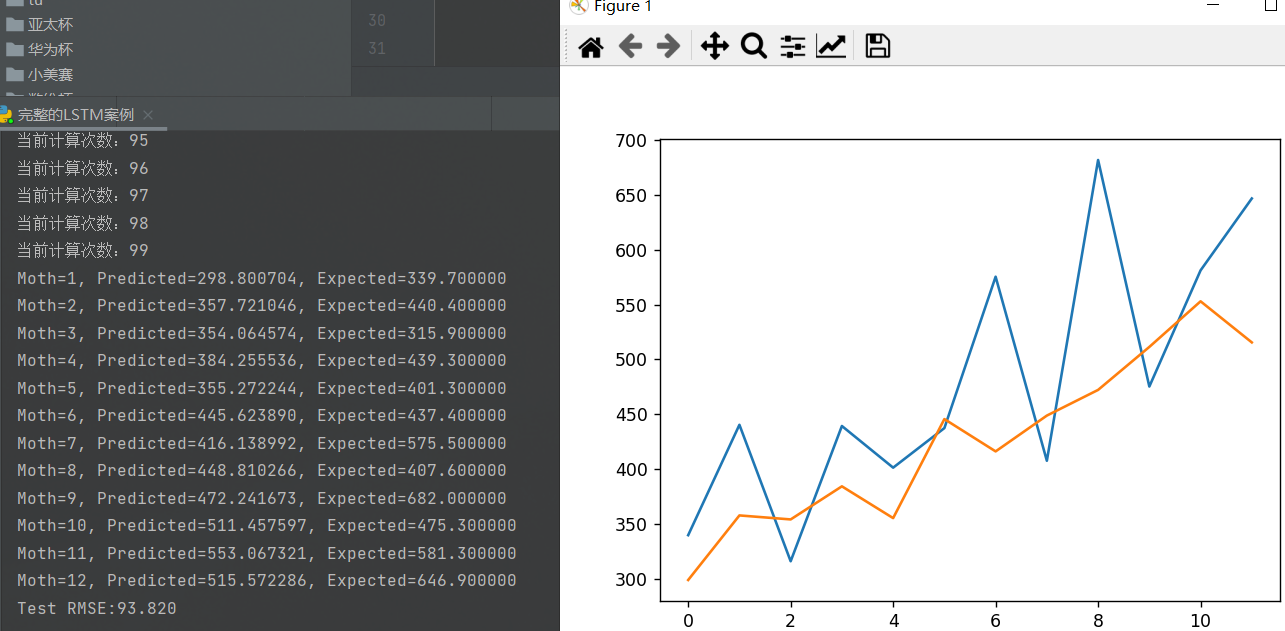

print(‘Moth=%d, Predicted=%f, Expected=%f’ % (i + 1, yhat, expected))

性能报告

rmse = sqrt(mean_squared_error(raw_values[-12:], predictions))

print(‘Test RMSE:%.3f’ % rmse)

绘图

pyplot.plot(raw_values[-12:])

pyplot.plot(predictions)

pyplot.show()

结果如下:

具体自己改改,给个参考。

完整文件:

链接:https://pan.baidu.com/s/1tYDb44Ge5S6Wwt1sPE8iHA?pwd=hkkc

提取码:hkkc

–来自百度网盘超级会员V3的分享

数模q un:912166339比赛期间禁止交流,赛后再聊,订阅本专栏,观看更多数学模型套路与分析。

数据集不变,代码如下:

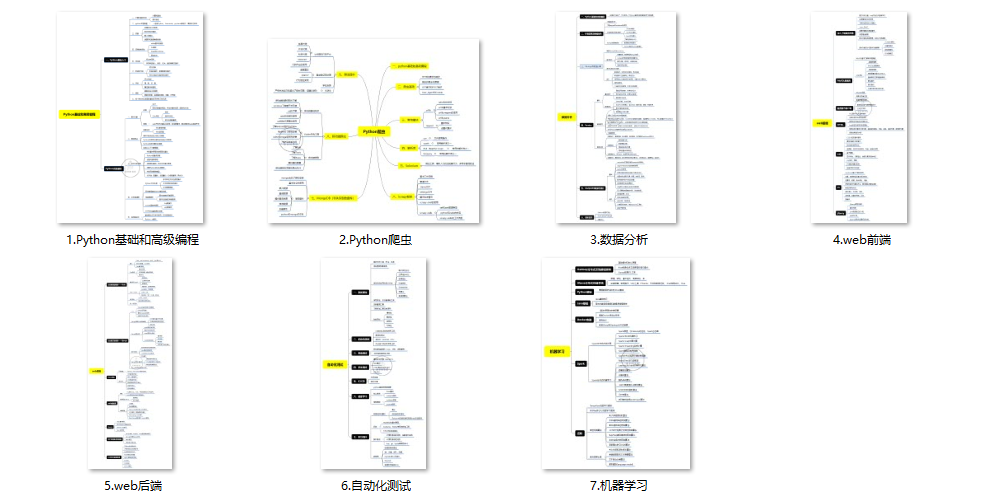

(1)Python所有方向的学习路线(新版)

这是我花了几天的时间去把Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

最近我才对这些路线做了一下新的更新,知识体系更全面了。

(2)Python学习视频

包含了Python入门、爬虫、数据分析和web开发的学习视频,总共100多个,虽然没有那么全面,但是对于入门来说是没问题的,学完这些之后,你可以按照我上面的学习路线去网上找其他的知识资源进行进阶。

(3)100多个练手项目

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?