网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

Balancer bandwidth is set to 52428800 for nn01.sudops.com/10.233.100.161:9000

Balancer bandwidth is set to 52428800 for nn02.sudops.com/10.233.100.162:9000

* **调整balance的平衡比例:**

将原来的%5 提高到20%,调整原则就是尽量先让balance影响到最需要平衡数据的节点。

简单说明一下:原有集群的hdfs占用率为80%,新增加3个节点后,集群hdfs的整体占用量为70%, 如果比例是%5的话,那么原有节点都在这个调整范围内,所以各个节点都要被balance,而接受balance的节点只有三个,所以轮到迫切需要balance的节点的概率就比较小;

如果调整到20%,那么原来使用量小于90%的节点都不会被balance,那几台占用量90%以上的节点才会被最先balance,这样只有3个节点符合这个条件,balance的精确性就高了很多。

综合以上两点,balance的效果好多了,解决了最紧迫的节点的磁盘占满的问题,balance的速度终于快于新增数据,20%时需要balance的数据为6TB左右,待这次balance结束后,再运行一次%5的balance,还有2TB的数据要balance,这样经过两次的balance的操作,集群基本平衡了。

hdfs dfsadmin -setBalancerBandwidth 52428800

nohup hdfs balancer -threshold 20 &

tail -F nohup.out

### 一、概述

>

> hdfs 需要存写大量文件,有时磁盘会成为整个集群的性能瓶颈,所以需要**优化 hdfs 存取速度**,将数据目录配置多磁盘,既可以提高并发存取的速度,还可以**解决一块磁盘空间不够的问题**。

>

>

>

Hadoop 环境部署可以参考我之前的文章:[大数据Hadoop之——Hadoop 3.3.4 HA(高可用)原理与实现(QJM)]( )

### 二、Hadoop DataNode多目录磁盘配置

#### 1)配置hdfs-site.xml

在配置文件中`$HADOOP_HOME/etc/hadoop/hdfs-site.xml`添加如下配置:

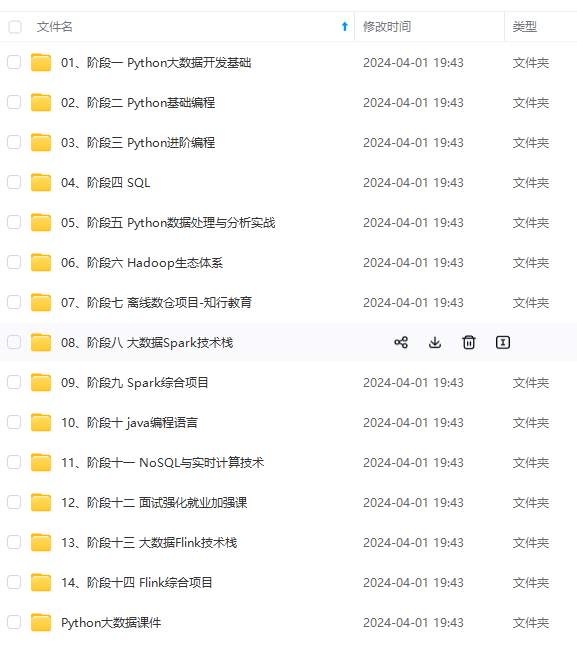

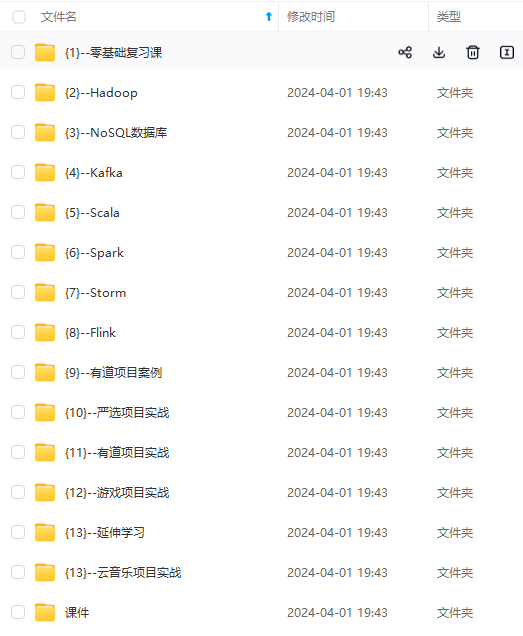

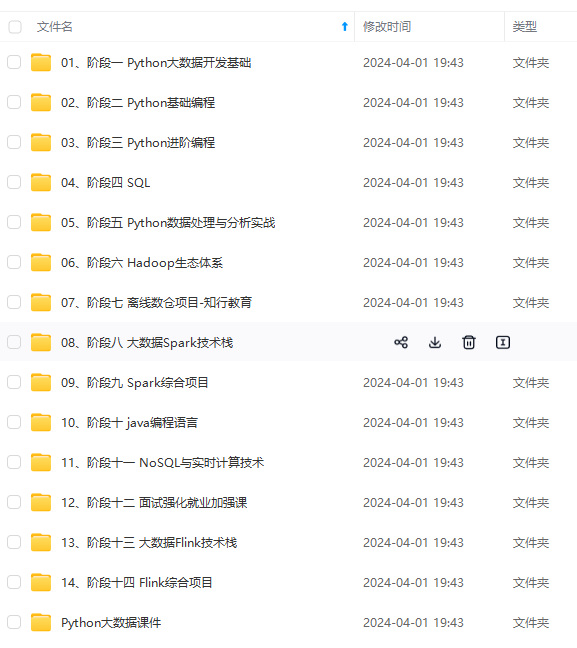

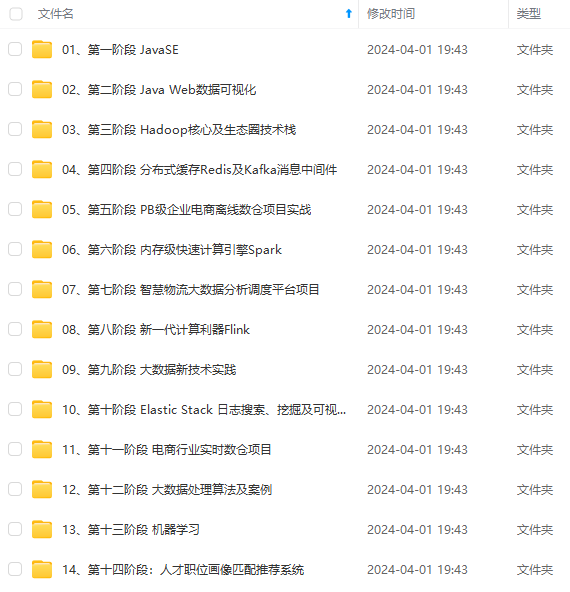

**既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!**

**由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

并且后续会持续更新**

**[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

769

769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?