前言

**Flux**模型腾空出世有一小段时间了。这是一款目前最大且优秀的文生图模型。同时目前Flux模型的社区生态已逐步构建起来,包括ControlNet和Lora在不断完善,从此可以看到社区对该模型的认可和积极推进。但FLUX.1模型有点大(当然也有精炼版本的),对电脑硬件(内存和显存)要求都比较高,无形中劝退了一些爱玩AI的伙伴。而GGUF也是在FLUX.1的模型框架里运行,GGUF只是一种量化方式。

网上公众号介绍GGUF的文章很多,大多是转发原开发者的描述,本人在此不作赘述!考虑到大多数伙伴没能科学上网“爬墙”。

在此介绍一些简单的安装步骤:

1)、XLabs:XLabs-AI官方推荐的是GGUF方式。插件地址:https://github.com/XLabs-AI/x-flux-comfyui。

2)、当前最新版本的ComfyUI结合社区插件ComfyUI-GGUF已支持在ComfyUI中体验。需要更新ComfyUI到最新版本,同时通过插件管理器搜索ComfyUI-GGUF并安装。

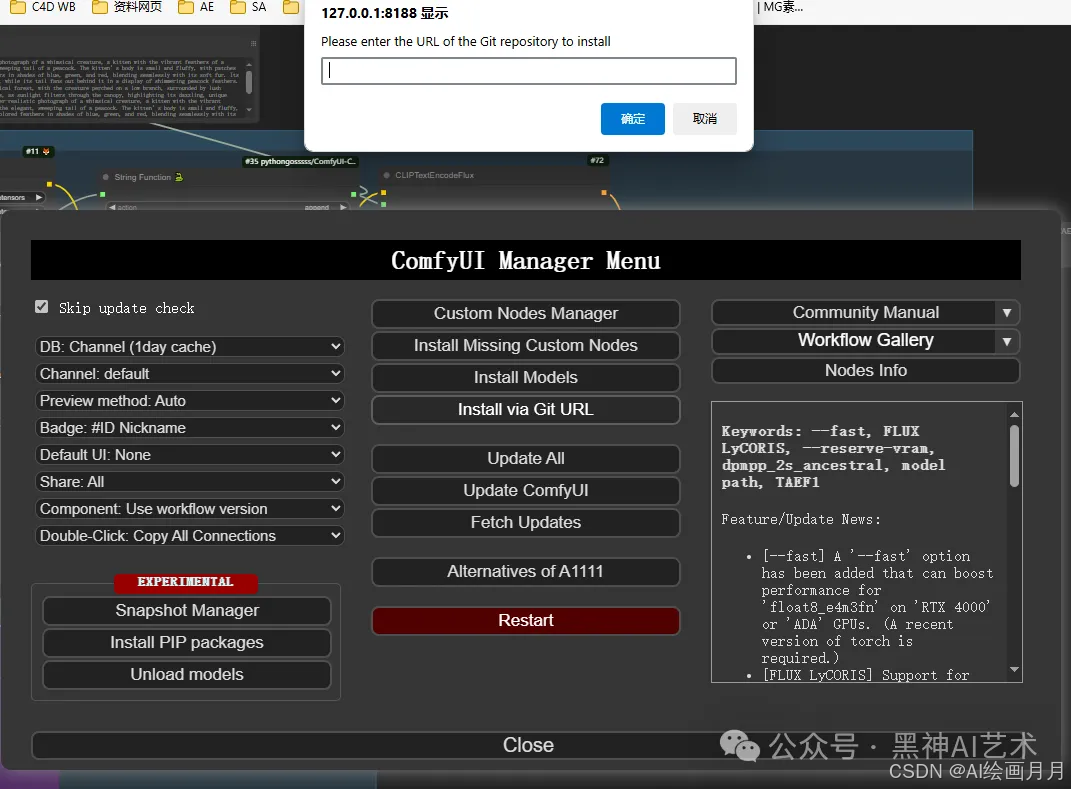

3)、在ComfyUI 管理器中安装插件:

ComfyUI插件地址:https://github.com/city96/ComfyUI-GGUF(把橙色地址填入方框),确定,然后按下面的红色按钮:“Restart”,重启。

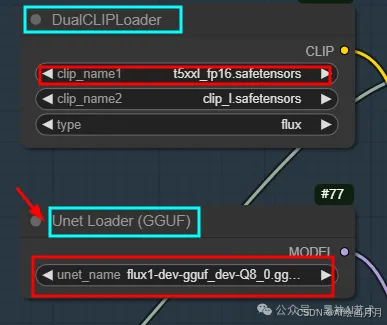

4)、同时还需要下载对应的flux1-dev GGUF模型并放置在安装根目录硬盘… /ComfyUI/models/unet 目录下。

flux1-dev GGU LIBLIB模型地址:https://www.liblib.art/modelinfo/e3a5aacc49ea4c2eaef2792c899e7352

https://huggingface.co/city96/FLUX.1-dev-gguf/tree/main(需要科学上网)

注:(模型网站实例里带有工作流,复制工作流信息到comfyUI界面,修改节点就可以开心的玩了)

官方同时提供了flux1-schnell GGUF版本,这是蒸馏版模型的量化版本,更推荐大家选择合适量化精度的flux1-dev GGUF版本模型体验。

GGUF有很多版本,建议如果只有6G显存则使用GGUF-4模型,12G以上显存可尝试GGUF-6/8模型。

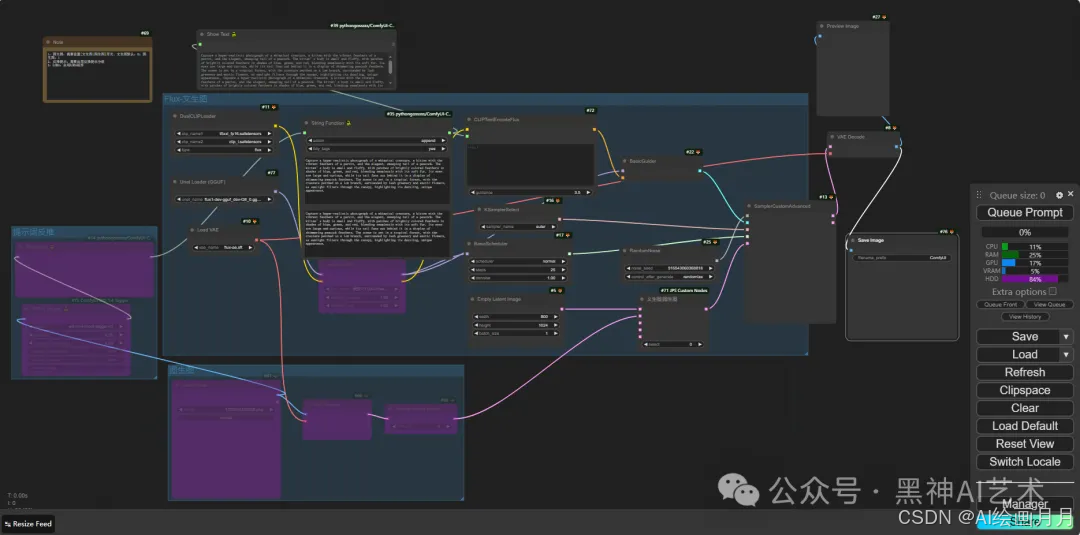

5)、工作流连接情况:切记节点切换成像我这样,不然运行会出现大片红字提示,头就大了!切记切记!

全部工作流图如下:

完整工作流:

链接: https://pan.baidu.com/s/1R7Gde8RR4mwxUoeX9PomMg?pwd=6srw 提取码: 6srw

体验

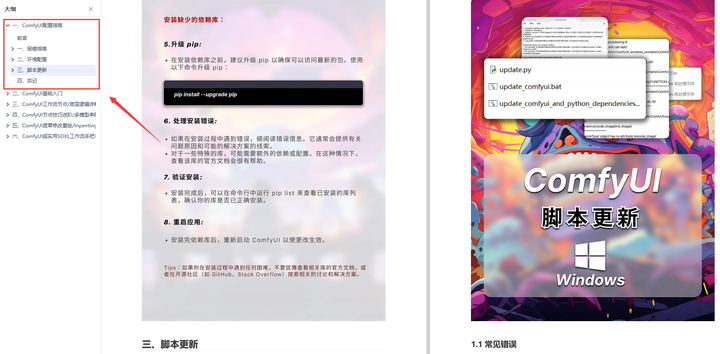

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

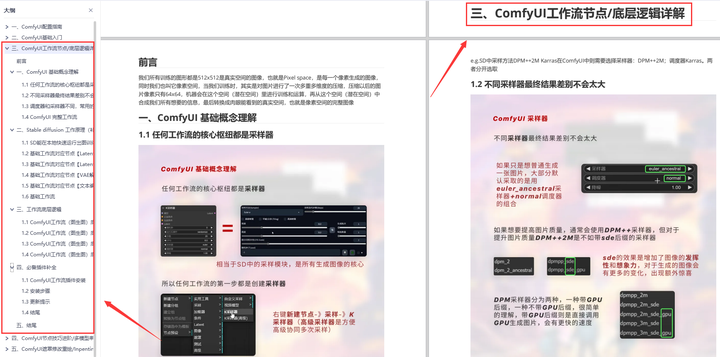

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

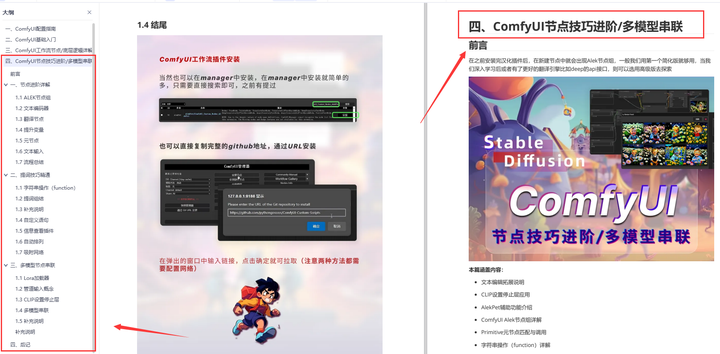

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

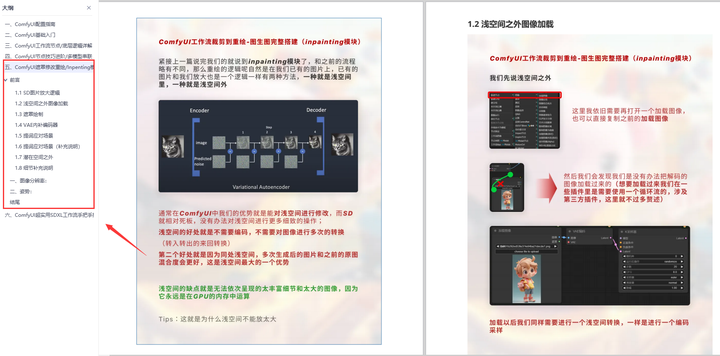

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

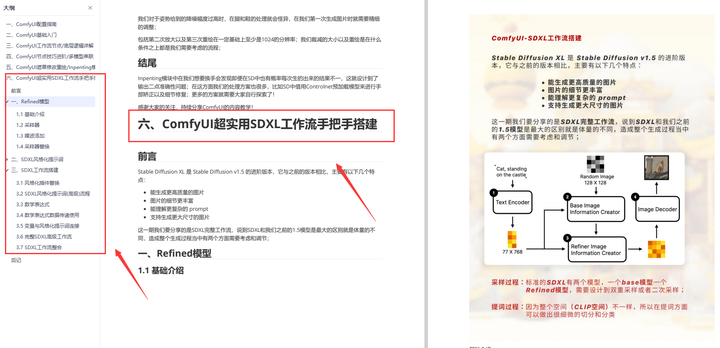

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

3000

3000

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?